首页BERT比lstm好在那里?

BERT比lstm好在那里?

时间: 2023-08-24 08:04:33 浏览: 125

BERT(Bidirectional Encoder Representations from Transformers)相较于LSTM(Long Short-Term Memory)在以下几个方面具有优势:

1. 上下文理解能力:BERT是一种基于Transformer的预训练模型,它能够同时考虑前后文的信息,从而更好地理解单词或句子的含义。而LSTM只能通过有限的记忆单元来处理序列上下文信息。

2. 预训练和微调:BERT通过大规模无监督的预训练任务,学习到通用语言表示,然后再通过有监督的微调任务进行特定任务的迁移学习。这种方式使得BERT能够在各种NLP任务上取得良好的性能,而LSTM则需要单独训练每个特定任务的模型。

3. 句子级别任务:BERT可以直接处理句子级别的任务,如文本分类、情感分析等,而LSTM需要额外的注意力机制或池化操作来处理整个句子。

4. 长序列处理:BERT通过自注意力机制(self-attention)来建模长距离依赖关系,从而更好地处理长序列。而LSTM在处理长序列时可能会出现梯度消失或梯度爆炸的问题。

需要注意的是,BERT和LSTM都有各自的使用场景和适用性,具体选择哪种模型还要考虑任务的特点和数据集的规模等因素。

阅读全文

CSDN会员

开通CSDN年卡参与万元壕礼抽奖

最新推荐

boost-chrono-1.53.0-28.el7.x86_64.rpm.zip

文件放服务器下载,请务必到电脑端资源详情查看然后下载

atlas-devel-3.10.1-12.el7.x86_64.rpm.zip

文件太大放服务器下载,请务必到电脑端资源详情查看然后下载

atkmm-2.24.2-1.el7.i686.rpm.zip

文件太大放服务器下载,请务必到电脑端资源详情查看然后下载

bsf-javadoc-2.4.0-19.el7.noarch.rpm.zip

文件放服务器下载,请务必到电脑端资源详情查看然后下载

hive 优化策略、、、、

hive 优化策略、、、、

Angular程序高效加载与展示海量Excel数据技巧

资源摘要信息: "本文将讨论如何在Angular项目中加载和显示Excel海量数据,具体包括使用xlsx.js库读取Excel文件以及采用批量展示方法来处理大量数据。为了更好地理解本文内容,建议参阅关联介绍文章,以获取更多背景信息和详细步骤。"

知识点:

1. Angular框架: Angular是一个由谷歌开发和维护的开源前端框架,它使用TypeScript语言编写,适用于构建动态Web应用。在处理复杂单页面应用(SPA)时,Angular通过其依赖注入、组件和服务的概念提供了一种模块化的方式来组织代码。

2. Excel文件处理: 在Web应用中处理Excel文件通常需要借助第三方库来实现,比如本文提到的xlsx.js库。xlsx.js是一个纯JavaScript编写的库,能够读取和写入Excel文件(包括.xlsx和.xls格式),非常适合在前端应用中处理Excel数据。

3. xlsx.core.min.js: 这是xlsx.js库的一个缩小版本,主要用于生产环境。它包含了读取Excel文件核心功能,适合在对性能和文件大小有要求的项目中使用。通过使用这个库,开发者可以在客户端对Excel文件进行解析并以数据格式暴露给Angular应用。

4. 海量数据展示: 当处理成千上万条数据记录时,传统的方式可能会导致性能问题,比如页面卡顿或加载缓慢。因此,需要采用特定的技术来优化数据展示,例如虚拟滚动(virtual scrolling),分页(pagination)或懒加载(lazy loading)等。

5. 批量展示方法: 为了高效显示海量数据,本文提到的批量展示方法可能涉及将数据分组或分批次加载到视图中。这样可以减少一次性渲染的数据量,从而提升应用的响应速度和用户体验。在Angular中,可以利用指令(directives)和管道(pipes)来实现数据的分批处理和显示。

6. 关联介绍文章: 提供的文章链接为读者提供了更深入的理解和实操步骤。这可能是关于如何配置xlsx.js在Angular项目中使用、如何读取Excel文件中的数据、如何优化和展示这些数据的详细指南。读者应根据该文章所提供的知识和示例代码,来实现上述功能。

7. 文件名称列表: "excel"这一词汇表明,压缩包可能包含一些与Excel文件处理相关的文件或示例代码。这可能包括与xlsx.js集成的Angular组件代码、服务代码或者用于展示数据的模板代码。在实际开发过程中,开发者需要将这些文件或代码片段正确地集成到自己的Angular项目中。

总结而言,本文将指导开发者如何在Angular项目中集成xlsx.js来处理Excel文件的读取,以及如何优化显示大量数据的技术。通过阅读关联介绍文章和实际操作示例代码,开发者可以掌握从后端加载数据、通过xlsx.js解析数据以及在前端高效展示数据的技术要点。这对于开发涉及复杂数据交互的Web应用尤为重要,特别是在需要处理大量数据时。

管理建模和仿真的文件

管理Boualem Benatallah引用此版本:布阿利姆·贝纳塔拉。管理建模和仿真。约瑟夫-傅立叶大学-格勒诺布尔第一大学,1996年。法语。NNT:电话:00345357HAL ID:电话:00345357https://theses.hal.science/tel-003453572008年12月9日提交HAL是一个多学科的开放存取档案馆,用于存放和传播科学研究论文,无论它们是否被公开。论文可以来自法国或国外的教学和研究机构,也可以来自公共或私人研究中心。L’archive ouverte pluridisciplinaire

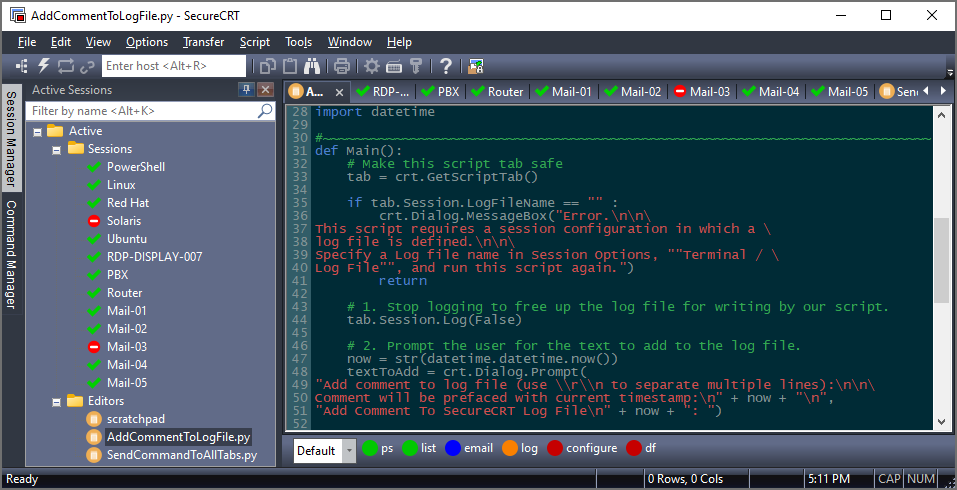

【SecureCRT高亮技巧】:20年经验技术大佬的个性化设置指南

参考资源链接:[SecureCRT设置代码关键字高亮教程](https://wenku.csdn.net/doc/6412b5eabe7fbd1778d44db0?spm=1055.2635.3001.10343)

# 1. SecureCRT简介与高亮功能概述

SecureCRT是一款广泛应用于IT行业的远程终端仿真程序,支持

如何设计一个基于FPGA的多功能数字钟,实现24小时计时、手动校时和定时闹钟功能?

设计一个基于FPGA的多功能数字钟涉及数字电路设计、时序控制和模块化编程。首先,你需要理解计时器、定时器和计数器的概念以及如何在FPGA平台上实现它们。《大连理工数字钟设计:模24计时器与闹钟功能》这份资料详细介绍了实验报告的撰写过程,包括设计思路和实现方法,对于理解如何构建数字钟的各个部分将有很大帮助。

参考资源链接:[大连理工数字钟设计:模24计时器与闹钟功能](https://wenku.csdn.net/doc/5y7s3r19rz?spm=1055.2569.3001.10343)

在硬件设计方面,你需要准备FPGA开发板、时钟信号源、数码管显示器、手动校时按钮以及定时闹钟按钮等

Argos客户端开发流程及Vue配置指南

资源摘要信息:"argos-client:客户端"

1. Vue项目基础操作

在"argos-client:客户端"项目中,首先需要进行项目设置,通过运行"yarn install"命令来安装项目所需的依赖。"yarn"是一个流行的JavaScript包管理工具,它能够管理项目的依赖关系,并将它们存储在"package.json"文件中。

2. 开发环境下的编译和热重装

在开发阶段,为了实时查看代码更改后的效果,可以使用"yarn serve"命令来编译项目并开启热重装功能。热重装(HMR, Hot Module Replacement)是指在应用运行时,替换、添加或删除模块,而无需完全重新加载页面。

3. 生产环境的编译和最小化

项目开发完成后,需要将项目代码编译并打包成可在生产环境中部署的版本。运行"yarn build"命令可以将源代码编译为最小化的静态文件,这些文件通常包含在"dist/"目录下,可以部署到服务器上。

4. 单元测试和端到端测试

为了确保项目的质量和可靠性,单元测试和端到端测试是必不可少的。"yarn test:unit"用于运行单元测试,这是测试单个组件或函数的测试方法。"yarn test:e2e"用于运行端到端测试,这是模拟用户操作流程,确保应用程序的各个部分能够协同工作。

5. 代码规范与自动化修复

"yarn lint"命令用于代码的检查和风格修复。它通过运行ESLint等代码风格检查工具,帮助开发者遵守预定义的编码规范,从而保持代码风格的一致性。此外,它也能自动修复一些可修复的问题。

6. 自定义配置与Vue框架

由于"argos-client:客户端"项目中提到的Vue标签,可以推断该项目使用了Vue.js框架。Vue是一个用于构建用户界面的渐进式JavaScript框架,它允许开发者通过组件化的方式构建复杂的单页应用程序。在项目的自定义配置中,可能需要根据项目需求进行路由配置、状态管理(如Vuex)、以及与后端API的集成等。

7. 压缩包子文件的使用场景

"argos-client-master"作为压缩包子文件的名称,表明该项目可能还涉及打包发布或模块化开发。在项目开发中,压缩包子文件通常用于快速分发和部署代码,或者是在模块化开发中作为依赖进行引用。使用压缩包子文件可以确保项目的依赖关系清晰,并且方便其他开发者快速安装和使用。

通过上述内容的阐述,我们可以了解到在进行"argos-client:客户端"项目的开发时,需要熟悉的一系列操作,包括项目设置、编译和热重装、生产环境编译、单元测试和端到端测试、代码风格检查和修复,以及与Vue框架相关的各种配置。同时,了解压缩包子文件在项目中的作用,能够帮助开发者高效地管理和部署代码。