首页

python 字典效率高的原理

python 字典效率高的原理

时间: 2023-06-03 14:03:00

浏览: 152

Python字典效率高的原因是因为Python内置的字典实现是基于哈希表的,可以达到非常高效的查找和插入数据的性能。具体来说,Python中使用哈希表实现字典时,会将所有的键通过哈希函数计算成一个整数作为下标,然后在索引表中查找对应的值。这样的查找方式平均时间复杂度是O(1),所以Python字典效率很高。

阅读全文

相关推荐

如何高效使用Python字典的方法详解

Dictionary 是 Python 的内置数据类型之一,它定义了键和值之间一对一的关系。下面这篇文章主要给大家介绍了关于如何高效使用Python字典的相关资料,文中通过示例代码介绍的非常详细,需要的朋友可以参考借鉴,下面来一起看看吧。

深入理解Python中字典的原理及其在字母统计中的效率优势

Python中字典的基本概念和用法 ## 1.1 字典的定义和特点 在Python中,字典(dictionary)是一种可变容器模型,可存储任意数量的Python对象。字典以键-值(key-value)对的形式存储数据,具有以下特点: - 字典中...

解密Python字典的哈希表实现原理

Python是一种广泛使用的编程语言,而字典是Python中非常重要的数据结构之一。字典可以存储数据的键值对,并具有快速的查找能力,因此在实际开发中被广泛使用。 ## 1.2 字典的基本概念和用法 字典是一个可变的、...

Python字典推导式秘籍:快速创建字典,提升效率

Python字典推导式的基本语法和原理 字典推导式是一种简洁高效的语法,用于在Python中创建字典。其基本语法如下: python {key: value for key, value in iterable} 其中,iterable是一个可迭代对象(如...

Python字典和集合的高级用法

# 1. Python字典和集合概述 ...本章将对Python字典和集合进行一个快速概览,并在接下来的

【Python字典高级扩展】:自定义字典类实现OrderedDict特性

Python字典基础回顾 ## 1.1 字典的基本概念 Python中的字典是一种可变容器模型,可以存储任意类型对象。字典的每个键值对用冒号 : 分割,每个对之间用逗号 , 分隔,整个字典包括在花括号 {} 中。键必须是...

Python字典序的实现与应用详解

在学习Python字典序时,需要理解字符串排序的原理、如何在字典结构中合理使用键,以及如何使用Python标准库提供的工具来处理排序问题。掌握这些知识点可以帮助编程者在实际开发中更加高效地处理文本数据,编写出更加...

Python字典内部机制解析:PyDictObject与哈希表

Python字典对象是其语言核心中的重要组成部分,它提供了一种高效的方式来存储和检索键值对数据。在Python中,字典的实现依赖于哈希表(也称为散列表)这一数据结构,使得查找、添加和删除操作的时间复杂度理论上为O...

【字典的高级用法】:Python字典的隐藏技巧,让你的代码更加优雅

!...# 1. Python字典概述 Python 字典(dict)是一种灵活且功能强大的数据类型,它提供了一种存储键值对(key-...本章将介绍Python字典的基础知识,包括它的特点、创建和基本操作,为之后更深入的探讨奠定基础。

Python中的列表和字典数据结构原理

# 1. 导言 ### 1.1 数据结构概述 在计算机科学中,数据结构是指用来组织和存储数据的方式。...本文将从列表和字典的定义、基本操作以及存储原理入手,介绍它们在Python中的特点和使用方法。同时,还将对它们的遍

Python字典与集合高级用法:内存优化与速度提升绝招

Python字典和集合基础回顾 Python作为一种高级编程语言,其提供的字典和集合数据结构在日常开发中扮演着至关重要的角色。在本章中,我们将快速回顾这两种数据结构的基础用法,为后续深入分析和优化打下坚实的基础...

优化Python字典的性能来提高统计大数据量字母出现次数的效率

在本章中,我们将介绍关于优化Python字典性能来提高统计大数据量字母出现次数效率的主题。我们会讨论使用Python字典进行数据统计的重要性,以及如何在处理大数据量情况下优化字典操作以提高性能。让我们一起深入探讨...

深入研究Python字典的性能优化方法

## 1.1 Python字典的基本概念 Python中的字典(dictionary)是一种无序的数据类型,它由键(key)和对应值(value)构成的键值对集合。字典是Python中非常常用的数据结构,可以用来存储和管理各种类型的数据。 ## ...

Python字典管理秘籍:高效维护和更新列表中字典的技巧

!...# 1. Python字典管理概述 Python字典是一种灵活且功能...这一章节将对Python字典的概念、用途及其在Python编程中的重要性进行综述,为深入理解Python字典的内部工作原理以及如何有效地进行字典管理奠定基础。 ## 1.1

【Python字典与JSON互通】:交换数据的高级技巧揭秘

Python字典是一种内置的动态数据类型,能够存储键值对映射,它在内存中以哈希表的形式实现,因此提供了高效的数据存取能力。字典中的键必须是不可变类型,且唯一,而值可以是任何数据类型。Python字典的灵活性和高效...

理解Python字典的哈希冲突及解决方案

# 第一章节:Python字典的作用和基本原理 ## 1. 介绍:Python字典的作用和基本原理 Python字典是一种可变、无序、且元素唯一的数据结构。它使用键值对的形式存储数据,通过键来索引值。字典在Python编程中非常常用...

【Python字典与集合深度分析】:掌握高级用法和优化技巧

Python字典和集合是两种非常重要的数据类型,它们在程序设计和数据分析中发挥着巨大的作用。本章将带你入门这两者的基本概念和使用方法。 ## 1.1 字典的定义和用途 字典(Dictionary)是Python中一个可变容器模型...

利用Python字典实现高效的数据存储与检索

在本章节中,我们将会介绍Python字典的定义和特点,并解释为什么Python字典适合用于数据存储与检索的场景。 ## 1.1 Python字典的定义和特点 Python字典是一种无序且可变的集合型数据结构,它由键-值(key-value)...

Python字典与集合性能优化:最佳实践指南

# 摘要 本文旨在为使用CodeBlocks和wxWidgets库的开发者提供详细的安装、配置、实践操作指南和性能优化建议。文章首先介绍了CodeBlocks和wxWidgets库的基本概念和安装流程,然后深入探讨了CodeBlocks的高级功能定制和wxWidgets的架构特性。随后,通过实践操作章节,指导读者如何创建和运行一个wxWidgets项目,包括界面设计、事件

andorid studio 配置ERROR: Cause: unable to find valid certification path to requested target

### 解决 Android Studio SSL 证书验证问题 当遇到 `unable to find valid certification path` 错误时,这通常意味着 Java 运行环境无法识别服务器提供的 SSL 证书。解决方案涉及更新本地的信任库或调整项目中的网络请求设置。 #### 方法一:安装自定义 CA 证书到 JDK 中 对于企业内部使用的私有 CA 颁发的证书,可以将其导入至 JRE 的信任库中: 1. 获取 `.crt` 或者 `.cer` 文件形式的企业根证书; 2. 使用命令行工具 keytool 将其加入 cacerts 文件内: ```

VC++实现文件顺序读写操作的技巧与实践

资源摘要信息:"vc++文件的顺序读写操作" 在计算机编程中,文件的顺序读写操作是最基础的操作之一,尤其在使用C++语言进行开发时,了解和掌握文件的顺序读写操作是十分重要的。在Microsoft的Visual C++(简称VC++)开发环境中,可以通过标准库中的文件操作函数来实现顺序读写功能。 ### 文件顺序读写基础 顺序读写指的是从文件的开始处逐个读取或写入数据,直到文件结束。这与随机读写不同,后者可以任意位置读取或写入数据。顺序读写操作通常用于处理日志文件、文本文件等不需要频繁随机访问的文件。 ### VC++中的文件流类 在VC++中,顺序读写操作主要使用的是C++标准库中的fstream类,包括ifstream(用于从文件中读取数据)和ofstream(用于向文件写入数据)两个类。这两个类都是从fstream类继承而来,提供了基本的文件操作功能。 ### 实现文件顺序读写操作的步骤 1. **包含必要的头文件**:要进行文件操作,首先需要包含fstream头文件。 ```cpp #include <fstream> ``` 2. **创建文件流对象**:创建ifstream或ofstream对象,用于打开文件。 ```cpp ifstream inFile("example.txt"); // 用于读操作 ofstream outFile("example.txt"); // 用于写操作 ``` 3. **打开文件**:使用文件流对象的成员函数open()来打开文件。如果不需要在创建对象时指定文件路径,也可以在对象创建后调用open()。 ```cpp inFile.open("example.txt", std::ios::in); // 以读模式打开 outFile.open("example.txt", std::ios::out); // 以写模式打开 ``` 4. **读写数据**:使用文件流对象的成员函数进行数据的读取或写入。对于读操作,可以使用 >> 运算符、get()、read()等方法;对于写操作,可以使用 << 运算符、write()等方法。 ```cpp // 读取操作示例 char c; while (inFile >> c) { // 处理读取的数据c } // 写入操作示例 const char *text = "Hello, World!"; outFile << text; ``` 5. **关闭文件**:操作完成后,应关闭文件,释放资源。 ```cpp inFile.close(); outFile.close(); ``` ### 文件顺序读写的注意事项 - 在进行文件读写之前,需要确保文件确实存在,且程序有足够的权限对文件进行读写操作。 - 使用文件流进行读写时,应注意文件流的错误状态。例如,在读取完文件后,应检查文件流是否到达文件末尾(failbit)。 - 在写入文件时,如果目标文件不存在,某些open()操作会自动创建文件。如果文件已存在,open()操作则会清空原文件内容,除非使用了追加模式(std::ios::app)。 - 对于大文件的读写,应考虑内存使用情况,避免一次性读取过多数据导致内存溢出。 - 在程序结束前,应该关闭所有打开的文件流。虽然文件流对象的析构函数会自动关闭文件,但显式调用close()是一个好习惯。 ### 常用的文件操作函数 - `open()`:打开文件。 - `close()`:关闭文件。 - `read()`:从文件读取数据到缓冲区。 - `write()`:向文件写入数据。 - `tellg()` 和 `tellp()`:分别返回当前读取位置和写入位置。 - `seekg()` 和 `seekp()`:设置文件流的位置。 ### 总结 在VC++中实现顺序读写操作,是进行文件处理和数据持久化的基础。通过使用C++的标准库中的fstream类,我们可以方便地进行文件读写操作。掌握文件顺序读写不仅可以帮助我们在实际开发中处理数据文件,还可以加深我们对C++语言和文件I/O操作的理解。需要注意的是,在进行文件操作时,合理管理和异常处理是非常重要的,这有助于确保程序的健壮性和数据的安全。

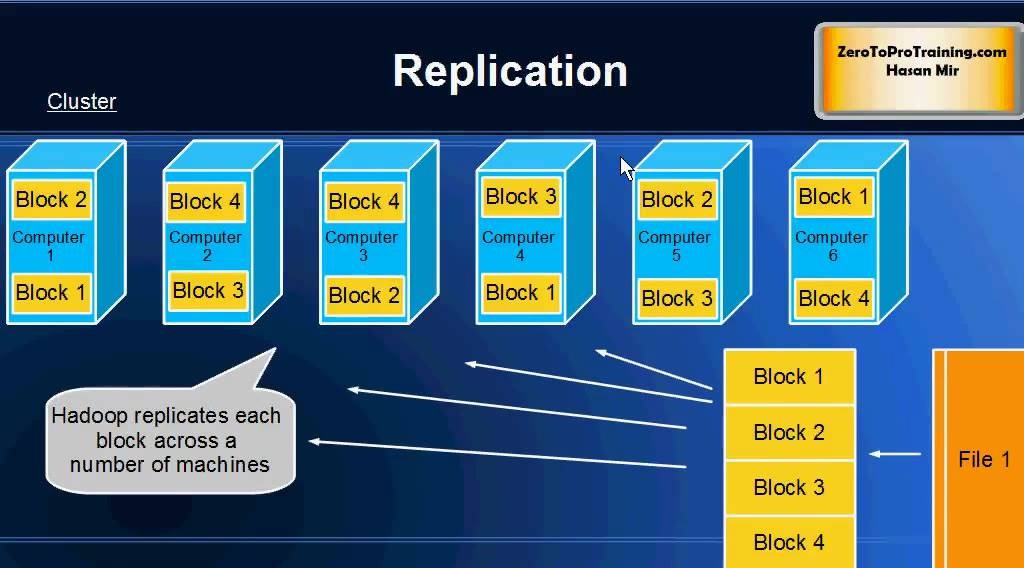

【大数据时代必备:Hadoop框架深度解析】:掌握核心组件,开启数据科学之旅

# 摘要 Hadoop作为一个开源的分布式存储和计算框架,在大数据处理领域发挥着举足轻重的作用。本文首先对Hadoop进行了概述,并介绍了其生态系统中的核心组件。深入分

opencv的demo程序

### OpenCV 示例程序 #### 图像读取与显示 下面展示如何使用 Python 接口来加载并显示一张图片: ```python import cv2 # 加载图像 img = cv2.imread('path_to_image.jpg') # 创建窗口用于显示图像 cv2.namedWindow('image', cv2.WINDOW_AUTOSIZE) # 显示图像 cv2.imshow('image', img) # 等待按键事件 cv2.waitKey(0) # 销毁所有创建的窗口 cv2.destroyAllWindows() ``` 这段代码展示了最基本的图