首页bert crf模型

bert crf模型

时间: 2023-08-18 07:04:34 浏览: 238

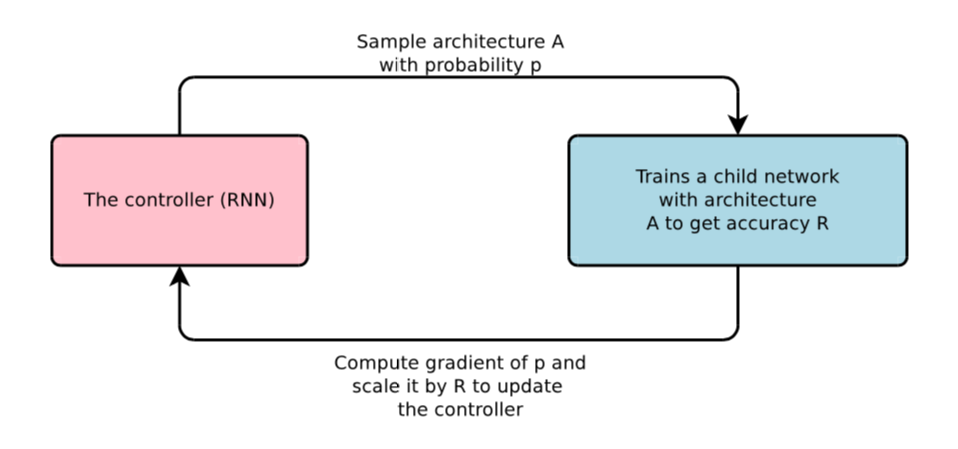

BERT-CRF模型是一种结合了BERT和CRF的模型,用于命名实体识别(NER)任务。它本质上是一个CRF模型,但使用BERT模型来训练CRF模型中的发射矩阵。发射矩阵可以使用BiLSTM来训练,也可以随机初始化训练,但实际效果都不如使用BERT好。在使用BERT-CRF模型进行NER训练时,可以使用谷歌预训练好的BERT模型,并根据自己的NER数据进行微调。通过使用BERT-CRF模型,可以获得较高的准确度,例如在一些实验中,使用10多个实体类别和5000个句子进行训练,最终准确度可以达到96%。BERT模型的构建主要是通过modeling.py文件中的BertModel类和BertConfig类完成的。BertConfig类用于读取BERT模型配置文件并初始化BERT模型的参数。在使用BERT-CRF模型进行NER任务时,可以加载已经训练好的模型,并使用该模型进行预测。例如,可以使用BLSTMCRFModel.load_model方法加载模型,并使用该模型对给定的句子进行预测。

阅读全文

CSDN会员

开通CSDN年卡参与万元壕礼抽奖

最新推荐

基于springboot+Javaweb的二手图书交易系统源码数据库文档.zip

基于springboot+Javaweb的二手图书交易系统源码数据库文档.zip

Linux课程设计.doc

Linux课程设计.doc

课程考试的概要介绍与分析

课程考试资源描述

本资源是为应对各类课程考试而精心准备的综合性学习包。它包含了多门学科的考试指南、历年真题、模拟试题以及详细的答案解析。这些资源旨在帮助学生系统复习课程内容,理解考试要点,提高解题技巧,从而在考试中取得优异成绩。

资源中不仅包含了基础的考试资料,还特别加入了考试技巧讲解和备考策略分析。学生可以通过这些资源了解不同题型的解题方法和思路,学会如何在有限的时间内高效答题。此外,还有针对弱项科目和难点的专项训练,帮助学生攻克学习瓶颈。

为了确保资源的时效性和准确性,我们会定期更新考试资料和模拟试题,及时反映最新的考试动态和趋势。同时,也提供了在线交流平台,方便学生之间互相讨论、分享学习心得。

项目源码示例(简化版,Python)

以下是一个简单的Python脚本示例,用于生成包含选择题和答案的模拟试题:

python

import random

# 定义选择题题库

questions = [

{"question": "Python的创始人是谁?", "options": ["A. 林纳斯·托瓦兹", "B. 巴纳姆", "C. 比尔·盖茨", "D.

基于Django的食堂点餐系统

基于 MySQL+Django 实现校园食堂点餐系统。

主要环境:

PowerDesigner

MySQL Workbench 8.0 CE

Python 3.8

Django 3.2.8

BootStrap 3.3.7

Django-simpleui

基于SpringBoot的同城宠物照看系统源码数据库文档.zip

基于SpringBoot的同城宠物照看系统源码数据库文档.zip

全国江河水系图层shp文件包下载

资源摘要信息:"国内各个江河水系图层shp文件.zip"

地理信息系统(GIS)是管理和分析地球表面与空间和地理分布相关的数据的一门技术。GIS通过整合、存储、编辑、分析、共享和显示地理信息来支持决策过程。在GIS中,矢量数据是一种常见的数据格式,它可以精确表示现实世界中的各种空间特征,包括点、线和多边形。这些空间特征可以用来表示河流、道路、建筑物等地理对象。

本压缩包中包含了国内各个江河水系图层的数据文件,这些图层是以shapefile(shp)格式存在的,是一种广泛使用的GIS矢量数据格式。shapefile格式由多个文件组成,包括主文件(.shp)、索引文件(.shx)、属性表文件(.dbf)等。每个文件都存储着不同的信息,例如.shp文件存储着地理要素的形状和位置,.dbf文件存储着与这些要素相关的属性信息。本压缩包内还包含了图层文件(.lyr),这是一个特殊的文件格式,它用于保存图层的样式和属性设置,便于在GIS软件中快速重用和配置图层。

文件名称列表中出现的.dbf文件包括五级河流.dbf、湖泊.dbf、四级河流.dbf、双线河.dbf、三级河流.dbf、一级河流.dbf、二级河流.dbf。这些文件中包含了各个水系的属性信息,如河流名称、长度、流域面积、流量等。这些数据对于水文研究、环境监测、城市规划和灾害管理等领域具有重要的应用价值。

而.lyr文件则包括四级河流.lyr、五级河流.lyr、三级河流.lyr,这些文件定义了对应的河流图层如何在GIS软件中显示,包括颜色、线型、符号等视觉样式。这使得用户可以直观地看到河流的层级和特征,有助于快速识别和分析不同的河流。

值得注意的是,河流按照流量、流域面积或长度等特征,可以被划分为不同的等级,如一级河流、二级河流、三级河流、四级河流以及五级河流。这些等级的划分依据了水文学和地理学的标准,反映了河流的规模和重要性。一级河流通常指的是流域面积广、流量大的主要河流;而五级河流则是较小的支流。在GIS数据中区分河流等级有助于进行水资源管理和防洪规划。

总而言之,这个压缩包提供的.shp文件为我们分析和可视化国内的江河水系提供了宝贵的地理信息资源。通过这些数据,研究人员和规划者可以更好地理解水资源分布,为保护水资源、制定防洪措施、优化水资源配置等工作提供科学依据。同时,这些数据还可以用于教育、科研和公共信息服务等领域,以帮助公众更好地了解我国的自然地理环境。

管理建模和仿真的文件

管理Boualem Benatallah引用此版本:布阿利姆·贝纳塔拉。管理建模和仿真。约瑟夫-傅立叶大学-格勒诺布尔第一大学,1996年。法语。NNT:电话:00345357HAL ID:电话:00345357https://theses.hal.science/tel-003453572008年12月9日提交HAL是一个多学科的开放存取档案馆,用于存放和传播科学研究论文,无论它们是否被公开。论文可以来自法国或国外的教学和研究机构,也可以来自公共或私人研究中心。L’archive ouverte pluridisciplinaire

Keras模型压缩与优化:减小模型尺寸与提升推理速度

# 1. Keras模型压缩与优化概览

随着深度学习技术的飞速发展,模型的规模和复杂度日益增加,这给部署带来了挑战。模型压缩和优化技术应运而生,旨在减少模型大小和计算资源消耗,同时保持或提高性能。Keras作为流行的高级神经网络API,因其易用性和灵活性,在模型优化领域中占据了重要位置。本章将概述Keras在模型压缩与优化方面的应用,为后续章节深入探讨相关技术奠定基础。

# 2. 理论基础与模型压缩技术

### 2.1 神经网络模型压缩

MTK 6229 BB芯片在手机中有哪些核心功能,OTG支持、Wi-Fi支持和RTC晶振是如何实现的?

MTK 6229 BB芯片作为MTK手机的核心处理器,其核心功能包括提供高速的数据处理、支持EDGE网络以及集成多个通信接口。它集成了DSP单元,能够处理高速的数据传输和复杂的信号处理任务,满足手机的多媒体功能需求。

参考资源链接:[MTK手机外围电路详解:BB芯片、功能特性和干扰滤波](https://wenku.csdn.net/doc/64af8b158799832548eeae7c?spm=1055.2569.3001.10343)

OTG(On-The-Go)支持是通过芯片内部集成功能实现的,允许MTK手机作为USB Host与各种USB设备直接连接,例如,连接相机、键盘、鼠标等

点云二值化测试数据集的详细解读

资源摘要信息:"点云二值化测试数据"

知识点:

一、点云基础知识

1. 点云定义:点云是由点的集合构成的数据集,这些点表示物体表面的空间位置信息,通常由三维扫描仪或激光雷达(LiDAR)生成。

2. 点云特性:点云数据通常具有稠密性和不规则性,每个点可能包含三维坐标(x, y, z)和额外信息如颜色、反射率等。

3. 点云应用:广泛应用于计算机视觉、自动驾驶、机器人导航、三维重建、虚拟现实等领域。

二、二值化处理概述

1. 二值化定义:二值化处理是将图像或点云数据中的像素或点的灰度值转换为0或1的过程,即黑白两色表示。在点云数据中,二值化通常指将点云的密度或强度信息转换为二元形式。

2. 二值化的目的:简化数据处理,便于后续的图像分析、特征提取、分割等操作。

3. 二值化方法:点云的二值化可能基于局部密度、强度、距离或其他用户定义的标准。

三、点云二值化技术

1. 密度阈值方法:通过设定一个密度阈值,将高于该阈值的点分类为前景,低于阈值的点归为背景。

2. 距离阈值方法:根据点到某一参考点或点云中心的距离来决定点的二值化,距离小于某个值的点为前景,大于的为背景。

3. 混合方法:结合密度、距离或其他特征,通过更复杂的算法来确定点的二值化。

四、二值化测试数据的处理流程

1. 数据收集:使用相应的设备和技术收集点云数据。

2. 数据预处理:包括去噪、归一化、数据对齐等步骤,为二值化处理做准备。

3. 二值化:应用上述方法,对预处理后的点云数据执行二值化操作。

4. 测试与验证:采用适当的评估标准和测试集来验证二值化效果的准确性和可靠性。

5. 结果分析:通过比较二值化前后点云数据的差异,分析二值化效果是否达到预期目标。

五、测试数据集的结构与组成

1. 测试数据集格式:文件可能以常见的点云格式存储,如PLY、PCD、TXT等。

2. 数据集内容:包含了用于测试二值化算法性能的点云样本。

3. 数据集数量和多样性:根据实际应用场景,测试数据集应该包含不同类型、不同场景下的点云数据。

六、相关软件工具和技术

1. 点云处理软件:如CloudCompare、PCL(Point Cloud Library)、MATLAB等。

2. 二值化算法实现:可能涉及图像处理库或专门的点云处理算法。

3. 评估指标:用于衡量二值化效果的指标,例如分类的准确性、召回率、F1分数等。

七、应用场景分析

1. 自动驾驶:在自动驾驶领域,点云二值化可用于道路障碍物检测和分割。

2. 三维重建:在三维建模中,二值化有助于提取物体表面并简化模型复杂度。

3. 工业检测:在工业检测中,二值化可以用来识别产品缺陷或确保产品质量标准。

综上所述,点云二值化测试数据的处理是一个涉及数据收集、预处理、二值化算法应用、效果评估等多个环节的复杂过程,对于提升点云数据处理的自动化、智能化水平至关重要。