首页sklearn库中决策树偏置量

sklearn库中决策树偏置量

时间: 2023-08-09 20:04:12 浏览: 99

在sklearn库中,决策树的偏置量是一个超参数,它用于控制决策树模型的复杂度。在sklearn的决策树实现中,有两个与偏置量相关的超参数:最小样本拆分和最大深度。

最小样本拆分(min_samples_split)参数指定了拆分一个内部节点所需的最小样本数。如果一个节点的样本数少于min_samples_split,则不再进行进一步的拆分。

最大深度(max_depth)参数限制了决策树的最大深度。当达到max_depth时,树停止生长。

这两个超参数都可以用来控制决策树的复杂度和防止过拟合。通过调整这些参数,可以找到最佳的模型性能和复杂度平衡点。

阅读全文

CSDN会员

开通CSDN年卡参与万元壕礼抽奖

大家在看

ISO IEC 38505-1中文版.pdf

ISO IEC 38505-1中文版.pdf

The Seasoned Schemer高清PDF

计算机界大牛Daniel P. Friedman写的Scheme进阶书籍,采用问答式的写法,非常苏格拉底,对Scheme有兴趣的朋友推荐下载阅读。

中国电力建设协会 调试工程师题库

中国电力建设协会 调试工程师题库,本题库为电网专业 调试总工程师考试题库。有志于考取调总的,本题库十分有用。

36V转5V,36V转3.3V电源电路图,降压芯片规格书.pdf

PW2558 开发了一种高效的异步降压 DC/DC 调节器输出 0.8A 电流。集成电路采用电流模

式自适应恒关断时间控制。这个 PW2558 可在 4.5V 至 55V 的宽输入电压范围内工作,

并将主开关与非常低的 RDS(开),以最小化传导损耗。输出电压纹波低,外部电压小

电感器和电容器的尺寸以 1.2MHz 的开关频率实现。

【蒙特卡洛模拟】这个项目旨在通过强化学习和蒙特卡洛模拟的结合,解决银行购买股票的最优策略和预期利润折现率的问题KL.zip

【蒙特卡洛模拟】这个项目旨在通过强化学习和蒙特卡洛模拟的结合,解决银行购买股票的最优策略和预期利润折现率的问题【KL】.zip

最新推荐

python使用sklearn实现决策树的方法示例

本示例将详细讲解如何使用`sklearn`库中的`DecisionTreeClassifier`类来构建决策树模型。 首先,确保你有一个合适的开发环境。推荐使用`Anaconda`,因为它是Python科学计算的常用平台,包含了大量的科学计算库。...

Python使用sklearn库实现的各种分类算法简单应用小结

本文将简要介绍如何使用`sklearn`库实现KNN、SVM、逻辑回归(LR)、决策树、随机森林以及梯度提升决策树(GBDT)等分类算法,并提供相应的代码示例。 1. **K近邻(K-Nearest Neighbors, KNN)** KNN是一种基于实例...

基于MapReduce实现决策树算法

6. 决策树算法在MapReduce中的实现细节:在基于MapReduce实现决策树算法中,需要对决策树算法的实现细节进行详细的设计和实现,例如对树的节点进行实现、对决策树的分裂和叶节点的计算等。 7. MapReduce框架在决策...

决策树剪枝算法的python实现方法详解

在Python中实现决策树剪枝,通常可以使用scikit-learn库,它提供了`DecisionTreeClassifier`和`DecisionTreeRegressor`类,支持预剪枝和后剪枝。预剪枝是在树生长过程中设定停止条件,如最大深度、最小样本数等,...

Java实现的决策树算法完整实例

第二步,决策树的剪枝:决策树的剪枝是对上一阶段生成的决策树进行检验、校正和修下的过程,主要是用新的样本数据集(称为测试数据集)中的数据校验决策树生成过程中产生的初步规则,将那些影响预衡准确性的分枝剪除...

易语言例程:用易核心支持库打造功能丰富的IE浏览框

资源摘要信息:"易语言-易核心支持库实现功能完善的IE浏览框"

易语言是一种简单易学的编程语言,主要面向中文用户。它提供了大量的库和组件,使得开发者能够快速开发各种应用程序。在易语言中,通过调用易核心支持库,可以实现功能完善的IE浏览框。IE浏览框,顾名思义,就是能够在一个应用程序窗口内嵌入一个Internet Explorer浏览器控件,从而实现网页浏览的功能。

易核心支持库是易语言中的一个重要组件,它提供了对IE浏览器核心的调用接口,使得开发者能够在易语言环境下使用IE浏览器的功能。通过这种方式,开发者可以创建一个具有完整功能的IE浏览器实例,它不仅能够显示网页,还能够支持各种浏览器操作,如前进、后退、刷新、停止等,并且还能够响应各种事件,如页面加载完成、链接点击等。

在易语言中实现IE浏览框,通常需要以下几个步骤:

1. 引入易核心支持库:首先需要在易语言的开发环境中引入易核心支持库,这样才能在程序中使用库提供的功能。

2. 创建浏览器控件:使用易核心支持库提供的API,创建一个浏览器控件实例。在这个过程中,可以设置控件的初始大小、位置等属性。

3. 加载网页:将浏览器控件与一个网页地址关联起来,即可在控件中加载显示网页内容。

4. 控制浏览器行为:通过易核心支持库提供的接口,可以控制浏览器的行为,如前进、后退、刷新页面等。同时,也可以响应浏览器事件,实现自定义的交互逻辑。

5. 调试和优化:在开发完成后,需要对IE浏览框进行调试,确保其在不同的操作和网页内容下均能够正常工作。对于性能和兼容性的问题需要进行相应的优化处理。

易语言的易核心支持库使得在易语言环境下实现IE浏览框变得非常方便,它极大地降低了开发难度,并且提高了开发效率。由于易语言的易用性,即使是初学者也能够在短时间内学会如何创建和操作IE浏览框,实现网页浏览的功能。

需要注意的是,由于IE浏览器已经逐渐被微软边缘浏览器(Microsoft Edge)所替代,使用IE核心的技术未来可能面临兼容性和安全性的挑战。因此,在实际开发中,开发者应考虑到这一点,并根据需求选择合适的浏览器控件实现技术。

此外,易语言虽然简化了编程过程,但其在功能上可能不如主流的编程语言(如C++, Java等)强大,且社区和技术支持相比其他语言可能较为有限,这些都是在选择易语言作为开发工具时需要考虑的因素。

文件名列表中的“IE类”可能是指包含实现IE浏览框功能的类库或者示例代码。在易语言中,类库是一组封装好的代码模块,其中包含了各种功能的实现。通过在易语言项目中引用这些类库,开发者可以简化开发过程,快速实现特定功能。而示例代码则为开发者提供了具体的实现参考,帮助理解和学习如何使用易核心支持库来创建IE浏览框。

管理建模和仿真的文件

管理Boualem Benatallah引用此版本:布阿利姆·贝纳塔拉。管理建模和仿真。约瑟夫-傅立叶大学-格勒诺布尔第一大学,1996年。法语。NNT:电话:00345357HAL ID:电话:00345357https://theses.hal.science/tel-003453572008年12月9日提交HAL是一个多学科的开放存取档案馆,用于存放和传播科学研究论文,无论它们是否被公开。论文可以来自法国或国外的教学和研究机构,也可以来自公共或私人研究中心。L’archive ouverte pluridisciplinaire

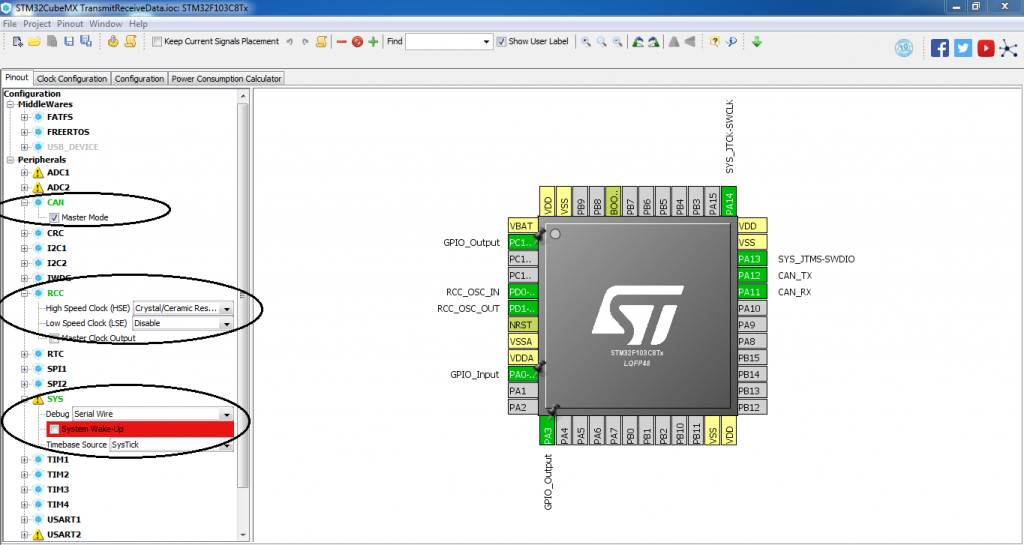

STM32F407ZG引脚功能深度剖析:掌握引脚分布与配置的秘密(全面解读)

# 摘要

本文全面介绍了STM32F407ZG微控制器的引脚特性、功能、配置和应用。首先概述了该芯片的引脚布局,然后详细探讨了标准外设、高级控制以及特殊功能引脚的不同配置和使用方法。在此基础上,文章深入分析了引脚模式配置、高级配置技巧,并提供了实际应用案例,如LED控制和串口通信。在设计方面,阐述了引脚布局策略、多层板设计及高密度引脚应用的解决方案。最后,介绍

给出文档中问题的答案代码

您提到的是需要编写MATLAB代码来实现文档中的实验任务。以下是根据文档内容编写的MATLAB代码示例:

```matlab

% 上机2 实验代码

% 读取输入图像

inputImage = imread('your_face_image.jpg'); % 替换为您的图像文件路径

if size(inputImage, 1) < 1024 || size(inputImage, 2) < 1024

error('图像尺寸必须大于1024x1024');

end

% 将彩色图像转换为灰度图像

grayImage = rgb2gray(inputImage);

% 调整图像大小为5

Docker构建与运行Next.js应用的指南

资源摘要信息:"rivoltafilippo-next-main"

在探讨“rivoltafilippo-next-main”这一资源时,首先要从标题“rivoltafilippo-next”入手。这个标题可能是某一项目、代码库或应用的命名,结合描述中提到的Docker构建和运行命令,我们可以推断这是一个基于Docker的Node.js应用,特别是使用了Next.js框架的项目。Next.js是一个流行的React框架,用于服务器端渲染和静态网站生成。

描述部分提供了构建和运行基于Docker的Next.js应用的具体命令:

1. `docker build`命令用于创建一个新的Docker镜像。在构建镜像的过程中,开发者可以定义Dockerfile文件,该文件是一个文本文件,包含了创建Docker镜像所需的指令集。通过使用`-t`参数,用户可以为生成的镜像指定一个标签,这里的标签是`my-next-js-app`,意味着构建的镜像将被标记为`my-next-js-app`,方便后续的识别和引用。

2. `docker run`命令则用于运行一个Docker容器,即基于镜像启动一个实例。在这个命令中,`-p 3000:3000`参数指示Docker将容器内的3000端口映射到宿主机的3000端口,这样做通常是为了让宿主机能够访问容器内运行的应用。`my-next-js-app`是容器运行时使用的镜像名称,这个名称应该与构建时指定的标签一致。

最后,我们注意到资源包含了“TypeScript”这一标签,这表明项目可能使用了TypeScript语言。TypeScript是JavaScript的一个超集,它添加了静态类型定义的特性,能够帮助开发者更容易地维护和扩展代码,尤其是在大型项目中。

结合资源名称“rivoltafilippo-next-main”,我们可以推测这是项目的主目录或主仓库。通常情况下,开发者会将项目的源代码、配置文件、构建脚本等放在一个主要的目录中,这个目录通常命名为“main”或“src”等,以便于管理和维护。

综上所述,我们可以总结出以下几个重要的知识点:

- Docker容器和镜像的概念以及它们之间的关系:Docker镜像是静态的只读模板,而Docker容器是从镜像实例化的动态运行环境。

- `docker build`命令的使用方法和作用:这个命令用于创建新的Docker镜像,通常需要一个Dockerfile来指定构建的指令和环境。

- `docker run`命令的使用方法和作用:该命令用于根据镜像启动一个或多个容器实例,并可指定端口映射等运行参数。

- Next.js框架的特点:Next.js是一个支持服务器端渲染和静态网站生成的React框架,适合构建现代的Web应用。

- TypeScript的作用和优势:TypeScript是JavaScript的一个超集,它提供了静态类型检查等特性,有助于提高代码质量和可维护性。

- 项目资源命名习惯:通常项目会有一个主目录,用来存放项目的源代码和核心配置文件,以便于项目的版本控制和团队协作。

以上内容基于给定的信息进行了深入的分析,为理解该项目的构建、运行方式以及技术栈提供了基础。在实际开发中,开发者应当参考更详细的文档和指南,以更高效地管理和部署基于Docker和TypeScript的Next.js项目。