首页

bert是几几年提出的

bert是几几年提出的

时间: 2024-06-26 11:00:24

浏览: 318

BERT(Bidirectional Encoder Representations from Transformers)是由Google在2018年提出的语言模型。它首次发布于2018年10月,并在自然语言处理领域引起了巨大反响,为后续的预训练语言模型奠定了基础。BERT使用Transformer架构进行预训练,能够捕捉文本中的上下文信息。

阅读全文

相关推荐

BERT源码解析与应用实践

资源摘要信息: "BERT(Bidirectional Encoder Representations from Transformers)是一种预训练语言表示的方法,由谷歌的Jacob Devlin等人在2018年提出,它能够为NLP(自然语言处理)任务提供深度双向的语境理解。...

基于BERT的THUCNews文本分类实操指南

BERT模型是由Google在2018年提出的一种新型深度双向预训练语言表示方法,通过大量无监督的语料预训练,BERT能够捕捉到文本的深层次语义信息。基于预训练模型,通过在特定任务上进行微调(fine-tuning),BERT能够...

BERT模型实现高效句子向量化技术

BERT模型句子向量化是自然语言处理领域的一项重要技术,BERT(Bidirectional Encoder Representations from Transformers)是谷歌于2018年提出的一种基于Transformer的预训练语言表示方法。它通过大量的文本数据进行...

BERT

**BERT(Bidirectional Encoder Representations from Transformers)**是自然语言处理(NLP)领域的一个重要突破,由Google在2018年提出。BERT模型基于Transformer架构,它改变了以往预训练语言模型仅从左到右或从...

BERT模型工程

BERT(Bidirectional Encoder Representations from Transformers)是由Google AI Language团队在2018年提出的预训练语言模型,它彻底改变了自然语言处理(NLP)领域。BERT模型的主要特点是其双向Transformer架构,...

BERT-GAN

BERT是由Google在2018年提出的预训练模型,它通过双向Transformer架构学习语言模型,能理解单词的上下文关系,从而在多项NLP任务中取得显著效果。而GAN则由Ian Goodfellow等人在2014年提出,由生成器(Generator)和...

bert_models

BERT模型由Google在2018年提出,它通过理解文本的上下文信息来生成高质量的词向量,从而在多项NLP任务中取得了突破性的成绩。 描述中没有提供具体信息,但我们可以推测这个压缩包可能包含了与BERT相关的代码、预...

BERT-AttributeExtraction

BERT,由Google在2018年提出,是基于Transformer架构的深度学习模型,其创新之处在于引入了双向上下文表示,能够从左右两侧同时理解文本信息,极大地提升了语言模型的表现力。在知识图谱的构建过程中,属性抽取是一...

bert代码数据bert代码数据bert代码数据bert代码数据

BERT,全称为Bidirectional Encoder Representations from Transformers,是一种预训练语言模型,由Google在2018年提出。它通过深度学习技术对自然语言文本进行理解和生成,具有强大的上下文理解能力。 描述中的...

Bert的缓存问题

在自然语言处理领域,Bert(Bidirectional Encoder Representations from Transformers)是一种预训练语言模型,由Google在2018年提出。它通过在大规模文本数据上进行无监督学习,学习到丰富的语义表示,广泛应用于...

pytorch-bert文本分类

BERT是由Google在2018年提出的,它在多项NLP任务上取得了前所未有的成绩,尤其是对上下文理解的能力。 首先,让我们详细了解一下BERT。BERT是一种基于Transformer架构的预训练模型,它的核心思想是双向Transformer...

bert_contrastive.zip

其中,BERT(Bidirectional Encoder Representations from Transformers)是Google在2018年提出的一种预训练模型,它极大地推动了NLP的进步。本项目“bert_contrastive.zip”似乎关注的是如何利用BERT进行对比学习,...

从头开始训练BERT代码

**BERT(Bidirectional Encoder Representations from Transformers)**是一种基于Transformer架构的预训练语言模型,由Google在2018年提出。它通过无监督学习在大量未标记文本上进行预训练,然后在特定任务上进行...

TensorFlow 2.0下的BERT、ALBERT及Adapter-BERT实现

BERT(Bidirectional Encoder Representations from Transformers)是一种由Google在2018年提出的预训练语言表示方法,它在自然语言处理(NLP)领域取得了突破性的成果。BERT模型通过预训练大量的文本数据,能够在多...

BERT预测模型后端框架

它由Google AI在2018年提出,能够对双向Transformer进行预训练,以实现对语境的理解。BERT模型广泛应用于各种NLP任务,如问答系统、文本分类、命名实体识别等。 从标题"bert-classify-backend-master.zip"我们可以...

BERT模型深度解析

BERT (Bidirectional Encoder Representations from Transformers) 是由Google在2018年提出的一种预训练模型,通过双向训练Transformer模型来学习文本的上下文表示。在自然语言处理领域,BERT模型的提出引领了一系列...

BERT模型原理与实践

# 1. 引言 1.1 研究背景 在自然语言处理领域,文本表示是一个至关重要的问题...因此,研究者们提出了一种新的预训练模型——Bidirectional Encoder Representations from Transformers (BERT)。 1.2 BERT模型的重要性

BERT与预训练语言模型

# 1. 引言 ## 1.1 背景介绍 ...在过去的几年里,预训练语言模型(Pre-trained Language Model,PLM)在自然语言处理领域取得了巨大的突破。预训练语言模型通过大规模无监督学习从海量文本数据中学习到了丰富的

BERT模型微调的技术要点

BERT(Bidirectional Encoder Representations from Transformers)模型是由Google在2018年提出的基于Transformer架构的预训练模型,大大提升了自然语言处理任务的性能。了解BERT模型的微调过程对于有效地利用这一...

使用BERT进行文本分类任务

BERT(Bidirectional Encoder Representations from Transformers)是由Google于2018年提出的一种预训练模型,它在自然语言处理(NLP)领域取得了巨大的成就。BERT模型引入了Transformer架构,并通过采用双向预训练...

CSDN会员

开通CSDN年卡参与万元壕礼抽奖

海量

VIP免费资源

千本

正版电子书

商城

会员专享价

千门

课程&专栏

全年可省5,000元

立即开通

全年可省5,000元

立即开通

大家在看

js 在线编辑office source 浏览器在线打开office

onlyffice提供在线编辑office桌面程序和文档服务方式,可以免费在线编辑office,这里提供master分支源码功下载研究

flac3d中文用户手册

flac3d 用户手册,帮助您使用flac3d。

如何降低开关电源纹波噪声

1、什么是纹波? 2、纹波的表示方法 3、纹波的测试 4、纹波噪声的抑制方法

UVM基础学习.ppt

UVM基础学习PPT,讲述了UVM的基础内容,包括UVM框架、agent、sequence、phase等基础内容。

plc 课程设计

里面有plc的运料小车的程序,还有仿真,以及课程设计的格式。

最新推荐

3dsmax高效建模插件Rappatools3.3发布,附教程

资源摘要信息:"Rappatools3.3.rar是一个与3dsmax软件相关的压缩文件包,包含了该软件的一个插件版本,名为Rappatools 3.3。3dsmax是Autodesk公司开发的一款专业的3D建模、动画和渲染软件,广泛应用于游戏开发、电影制作、建筑可视化和工业设计等领域。Rappatools作为一个插件,为3dsmax提供了额外的功能和工具,旨在提高用户的建模效率和质量。" 知识点详细说明如下: 1. 3dsmax介绍: 3dsmax,又称3D Studio Max,是一款功能强大的3D建模、动画和渲染软件。它支持多种工作流程,包括角色动画、粒子系统、环境效果、渲染等。3dsmax的用户界面灵活,拥有广泛的第三方插件生态系统,这使得它成为3D领域中的一个行业标准工具。 2. Rappatools插件功能: Rappatools插件专门设计用来增强3dsmax在多边形建模方面的功能。多边形建模是3D建模中的一种技术,通过添加、移动、删除和修改多边形来创建三维模型。Rappatools提供了大量高效的工具和功能,能够帮助用户简化复杂的建模过程,提高模型的质量和完成速度。 3. 提升建模效率: Rappatools插件中可能包含诸如自动网格平滑、网格优化、拓扑编辑、表面细分、UV展开等高级功能。这些功能可以减少用户进行重复性操作的时间,加快模型的迭代速度,让设计师有更多时间专注于创意和细节的完善。 4. 压缩文件内容解析: 本资源包是一个压缩文件,其中包含了安装和使用Rappatools插件所需的所有文件。具体文件内容包括: - index.html:可能是插件的安装指南或用户手册,提供安装步骤和使用说明。 - license.txt:说明了Rappatools插件的使用许可信息,包括用户权利、限制和认证过程。 - img文件夹:包含用于文档或界面的图像资源。 - js文件夹:可能包含JavaScript文件,用于网页交互或安装程序。 - css文件夹:可能包含层叠样式表文件,用于定义网页或界面的样式。 5. MAX插件概念: MAX插件指的是专为3dsmax设计的扩展软件包,它们可以扩展3dsmax的功能,为用户带来更多方便和高效的工作方式。Rappatools属于这类插件,通过在3dsmax软件内嵌入更多专业工具来提升工作效率。 6. Poly插件和3dmax的关系: 在3D建模领域,Poly(多边形)是构建3D模型的主要元素。所谓的Poly插件,就是指那些能够提供额外多边形建模工具和功能的插件。3dsmax本身就支持强大的多边形建模功能,而Poly插件进一步扩展了这些功能,为3dsmax用户提供了更多创建复杂模型的方法。 7. 增强插件的重要性: 在3D建模和设计行业中,增强插件对于提高工作效率和作品质量起着至关重要的作用。随着技术的不断发展和客户对视觉效果要求的提高,插件能够帮助设计师更快地完成项目,同时保持较高的创意和技术水准。 综上所述,Rappatools3.3.rar资源包对于3dsmax用户来说是一个很有价值的工具,它能够帮助用户在进行复杂的3D建模时提升效率并得到更好的模型质量。通过使用这个插件,用户可以在保持工作流程的一致性的同时,利用额外的工具集来优化他们的设计工作。

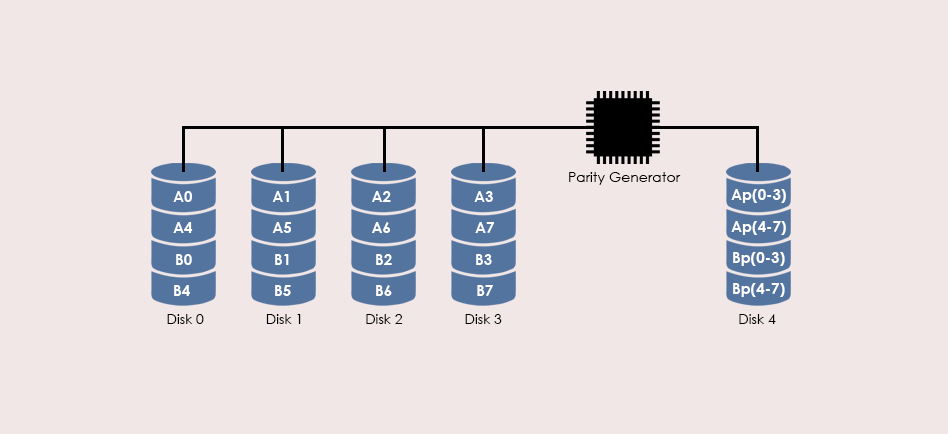

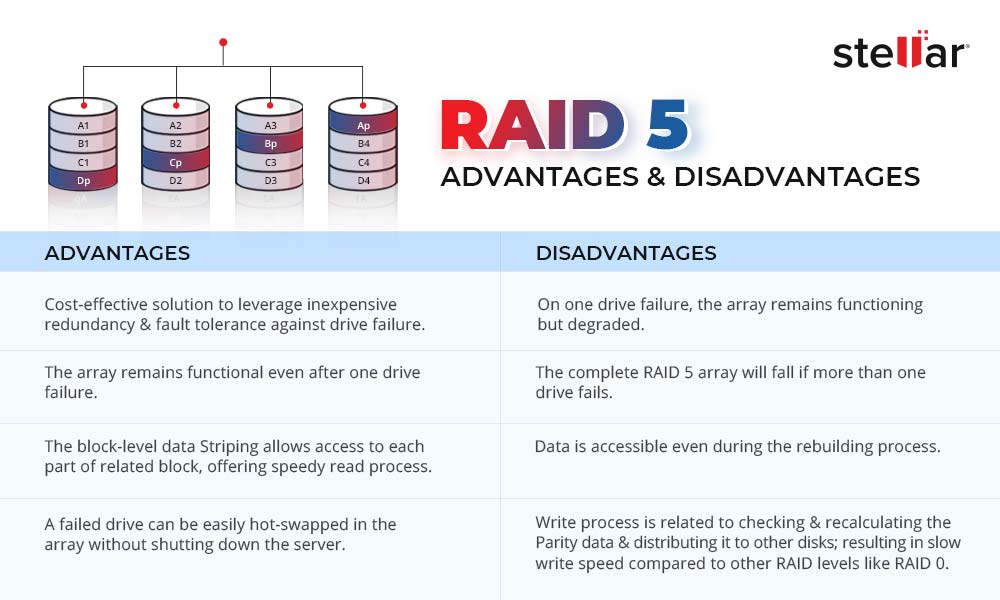

【R-Studio技术路径】:从RAID 5数据恢复基础到高级操作

# 摘要 随着信息技术的发展,数据丢失问题日益突出,RAID 5作为常见的数据存储解决方案,其数据恢复技术显得尤为重要。本文首先介绍了RAID 5数据恢复的基础知识,然后详细解析了R-Studio软件的界面和核心功能,重点探讨了其在RAID 5数据恢复中的应用实践,包括磁盘镜像创建、数据提取、数据重组策略及一致性验证。进一步,本文还涉及了R-Studio的进阶技术,如脚本编

``` 定义1个圆类,成员有:1个半径成员变量,1个构造方法给成员变量赋初值,1个求面积方法。```定义1个圆类,成员有:1个半径成员变量,1个构造方法给成员变量赋初值,1个求面积方法。

当然,我们可以定义一个简单的`Circle`类,如下所示: ```java public class Circle { // 定义一个私有的半径成员变量 private double radius; // 构造方法,用于初始化半径 public Circle(double initialRadius) { this.radius = initialRadius; } // 求圆面积的方法 public double getArea() { return Math.PI * Math.pow(radiu

Ruby实现PointInPolygon算法:判断点是否在多边形内

资源摘要信息:"PointInPolygon算法的Ruby实现是一个用于判断点是否在多边形内部的库。该算法通过计算点与多边形边界交叉线段的交叉次数来判断点是否在多边形内部。如果交叉数为奇数,则点在多边形内部,如果为偶数或零,则点在多边形外部。库中包含Pinp::Point类和Pinp::Polygon类。Pinp::Point类用于表示点,Pinp::Polygon类用于表示多边形。用户可以向Pinp::Polygon中添加点来构造多边形,然后使用contains_point?方法来判断任意一个Pinp::Point对象是否在该多边形内部。" 1. Ruby语言基础:Ruby是一种动态、反射、面向对象、解释型的编程语言。它具有简洁、灵活的语法,使得编写程序变得简单高效。Ruby语言广泛用于Web开发,尤其是Ruby on Rails这一著名的Web开发框架就是基于Ruby语言构建的。 2. 类和对象:在Ruby中,一切皆对象,所有对象都属于某个类,类是对象的蓝图。Ruby支持面向对象编程范式,允许程序设计者定义类以及对象的创建和使用。 3. 算法实现细节:算法基于数学原理,即计算点与多边形边界线段的交叉次数。当点位于多边形内时,从该点出发绘制射线与多边形边界相交的次数为奇数;如果点在多边形外,交叉次数为偶数或零。 4. Pinp::Point类:这是一个表示二维空间中的点的类。类的实例化需要提供两个参数,通常是点的x和y坐标。 5. Pinp::Polygon类:这是一个表示多边形的类,由若干个Pinp::Point类的实例构成。可以使用points方法添加点到多边形中。 6. contains_point?方法:属于Pinp::Polygon类的一个方法,它接受一个Pinp::Point类的实例作为参数,返回一个布尔值,表示传入的点是否在多边形内部。 7. 模块和命名空间:在Ruby中,Pinp是一个模块,模块可以用来将代码组织到不同的命名空间中,从而避免变量名和方法名冲突。 8. 程序示例和测试:Ruby程序通常包含方法调用、实例化对象等操作。示例代码提供了如何使用PointInPolygon算法进行点包含性测试的基本用法。 9. 边缘情况处理:算法描述中提到要添加选项测试点是否位于多边形的任何边缘。这表明算法可能需要处理点恰好位于多边形边界的情况,这类点在数学上可以被认为是既在多边形内部,又在多边形外部。 10. 文件结构和工程管理:提供的信息表明有一个名为"PointInPolygon-master"的压缩包文件,表明这可能是GitHub等平台上的一个开源项目仓库,用于管理PointInPolygon算法的Ruby实现代码。文件名称通常反映了项目的版本管理,"master"通常指的是项目的主分支,代表稳定版本。 11. 扩展和维护:算法库像PointInPolygon这类可能需要不断维护和扩展以适应新的需求或修复发现的错误。开发者会根据实际应用场景不断优化算法,同时也会有社区贡献者参与改进。 12. 社区和开源:Ruby的开源生态非常丰富,Ruby开发者社区非常活跃。开源项目像PointInPolygon这样的算法库在社区中广泛被使用和分享,这促进了知识的传播和代码质量的提高。 以上内容是对给定文件信息中提及的知识点的详细说明。根据描述,该算法库可用于各种需要点定位和多边形空间分析的场景,例如地理信息系统(GIS)、图形用户界面(GUI)交互、游戏开发、计算机图形学等领域。

【R-Studio恢复工具解析】:RAID 5恢复的功能优势与实际应用

# 摘要 RAID 5技术因其高效的数据存储和容错能力被广泛应用。然而,数据丢失问题仍时有发生,R-Studio作为一种功能强大的恢复工具,为解决这一问题提供了有效的技术方案。本文概述了RAID 5的基本概念、R-Studio的理论基础及其数据恢复原理。通过分析R-Studio的主要功能和恢复流程,本文还探讨了该工具

汇编程序编写一个程序,实现在屏幕上输出helloworld。

汇编语言是一种低级编程语言,它直接操作计算机硬件。要在汇编程序中编写一个简单的"Hello, World!"程序,你需要针对特定的CPU架构编写指令。这里以x86架构为例,使用Intel x86汇编: ```assembly section .data message db 'Hello, World!',0 ; 字符串常量 len equ $ - message ; 计算字符串长度 section .text global _start ; 标记程序入口点 _start: ; 设置段寄存

Salesforce Field Finder扩展:快速获取API字段名称

资源摘要信息:"Salesforce Field Finder-crx插件" Salesforce Field Finder是一个专为Salesforce平台设计的浏览器插件,它极大地简化了开发者和管理员在查询和管理Salesforce对象字段时的工作流程。该插件的主要功能是帮助用户快速找到任何特定字段的API名称,从而提高工作效率和减少重复性工作。 首先,插件设计允许用户在Salesforce的各个对象中快速浏览字段。用户可以在需要的时候选择相应的对象名称,然后该插件会列出所有相关的字段及其对应的API名称。这个特性对于初学者和有经验的开发者都是极其有用的,因为它允许用户避免记忆和查找每个字段的API名称,尤其是在处理具有大量字段的复杂对象时。 其次,Salesforce Field Finder提供了搜索功能,这使得用户可以在众多字段中快速定位到他们想要的信息。这意味着,无论字段列表有多长,用户都可以直接输入关键词,插件会立即筛选出匹配的字段,并展示其API名称。这一点尤其有助于在开发过程中,当需要引用特定字段的API名称时,能够迅速而准确地找到所需信息。 插件的使用操作也非常简单。用户只需安装该插件到他们的浏览器中,然后在使用Salesforce时,打开Field Finder界面,选择相应的对象,就可以看到一个字段列表,其中列出了字段的标签名称和API名称。对于那些API名称不直观或难以记忆的场景,这个功能尤其有帮助。 值得注意的是,该插件支持的浏览器类型和版本,用户需要确保在自己的浏览器上安装了最新版本的Salesforce Field Finder插件,以获得最佳的使用体验和完整的功能支持。 总体来说,Salesforce Field Finder是一个非常实用的工具,它可以帮助用户在使用Salesforce平台进行开发和管理时,极大地减少查找字段API名称所需的时间和精力,提高工作效率。对于那些每天需要和Salesforce API打交道的用户来说,这个插件无疑是一个时间节省利器。 另外,由于Salesforce Field Finder是一个浏览器插件,它也展示了浏览器扩展在提高生产力和用户体验方面的潜力。通过为特定的在线应用或服务开发专门的插件,开发者能够为用户提供更加高效和定制化的服务,这是现代IT行业不断追求的目标之一。因此,了解和使用类似Salesforce Field Finder这样的工具,对于提高个人的技术能力以及适应不断变化的IT行业环境都具有重要意义。

【故障诊断与恢复】:R-Studio技术解决RAID 5数据挑战

# 摘要 RAID 5技术广泛应用于数据存储领域,提供了容错性和数据冗余,尽管如此,故障和数据丢失的风险依然存在。本文综合探讨了RAID 5的工作原理、常见故障类型、数据恢复的挑战以及R-Studio工具在数据恢复中的应用和高级功能。通过对RAID 5故障风险的分析和R-Studio使用案例的深入解析,本文旨在提供针对RAID 5数据恢复的实用知识和最佳实践,同时强调数据保护和预防措施的重要性,以增强系统稳定性并提升数据恢复效率。

我把一个FLEXCAN_RxMbFilterType 类型的结构体数组赋值给FLEXCAN_RxMbFilterType *Filterlist;

在C语言中,数组名实际上是指向数组第一个元素的指针。因此,你可以直接将一个结构体数组赋值给一个指向相同结构体类型的指针。以下是一个示例代码,展示了如何将一个`FLEXCAN_RxMbFilterType`类型的结构体数组赋值给`FLEXCAN_RxMbFilterType *Filterlist;`: ```c #include <stdio.h> #include <stdlib.h> // 假设FLEXCAN_RxMbFilterType结构体定义如下 typedef struct { int id; int data; } FLEXCAN_RxMbFilterType

Homebridge-Pilight插件:轻松管理与控制pilight设备

资源摘要信息:"homebridge-pilight:用于Homebridge的附件插件,允许管理和控制pilight设备" 知识点: 1. Homebridge-Pilight插件概述 Homebridge Pilight插件是一个为Homebridge系统开发的扩展程序,允许用户通过Homebridge平台管理和控制连接到pilight的智能设备。Homebridge是一个开源项目,它允许用户将非苹果制造的智能家居设备接入苹果的HomeKit系统中,从而实现与iPhone、iPad、Apple Watch等设备的无缝整合。 2. Pilight的介绍 Pilight是一款开源的硬件和软件平台,用于发送和接收无线信号,特别是红外和射频信号。Pilight通过控制继电器板或类似硬件模块来操作各种传统家电,比如通过红外信号控制电视、空调等。 3. Pilight插件的工作机制 Homebridge-Pilight插件通过pilight守护进程的WebSocket API实现与pilight硬件设备的通信。因此,为了保证插件能够正常工作,必须确保pilight守护进程已经启动,并且WebSocket API处于激活状态。此外,需要确认配置的WebSocket API端口没有被任何防火墙阻止,从而确保数据能够自由地在Homebridge和pilight守护进程之间传输。 4. 安装要求 根据文档的描述,Homebridge-Pilight插件需要在支持ES6 / ES2015特性的环境中安装运行,例如Node.js的版本需为4或更高版本。这意味着开发者需要确保他们所使用的开发环境满足这一要求,以保证插件能够被正确安装和执行。 5. 安装过程 用户有多种方式安装Homebridge-Pilight插件。对于那些已经在系统中全局安装了Homebridge的用户,可以通过npm(Node.js的包管理器)使用全局安装命令来安装该插件: npm install -g homebridge-pilight 这种方式会将插件安装为一个全局可用的Node.js模块,任何Homebridge实例都能访问到该插件。 对于将Homebridge项目作为本地项目的用户,可以通过npm将Homebridge-Pilight插件作为依赖项安装到本地项目中: npm install -S homebridge-pilight 这样做可以将插件与项目的其他依赖项一起管理,适合需要进行版本控制的场景。 6. 相关技术与工具 - Homebridge: 一个让非HomeKit智能家居设备能够被苹果HomeKit控制的平台。 - pilight: 一个开源的无线通信平台,可以用来发送和接收不同类型的无线信号,包括但不限于红外和射频信号。 - Node.js: 一个基于Chrome V8引擎的JavaScript运行时环境,常用于构建服务器端应用程序。 - npm: Node.js的包管理器,用于安装、发布和管理Node.js应用程序的依赖项。 7. 应用场景与优势 通过使用Homebridge-Pilight插件,用户可以将诸如电视、空调、灯光等传统电器接入苹果的HomeKit生态系统,利用iPhone、iPad等设备通过Siri或者Home应用程序来控制。这种方法不仅提高了家电的智能化水平,还为用户提供了更多的便捷和智能场景应用。 总结: Homebridge-Pilight插件是连接pilight智能家居设备与苹果HomeKit生态系统的桥梁。通过其简单易用的配置和安装方法,以及与Homebridge平台的无缝整合,使得用户可以轻松地管理和控制自己的智能家电。同时,该插件的兼容性和对新JavaScript特性的支持,确保了它的可靠性和未来技术的兼容性。