首页优化代码:# 调参改进算法 - SVM ('C'为SVM算法的超参数) scaler = StandardScaler().fit(X_train) rescaledX = scaler.transform(X_train).astype(float) param_grid = {} param_grid['C'] = [0.1, 0.3, 0.5, 0.7, 0.9, 1.0, 1.3, 1.5, 1.7, 2.0] param_grid['kernel'] = ['linear', 'poly', 'rbf', 'sigmoid'] model = SVC() kfold = KFold(n_splits=num_folds, random_state=seed) grid = GridSearchCV(estimator=model, param_grid=param_grid, scoring=scoring, cv=kfold) grid_result = grid.fit(X=rescaledX, y=Y_train) print('最优:%s 使用%s' % (grid_result.best_score_, grid_result.best_params_)) cv_results = zip(grid_result.cv_results_['mean_test_score'], grid_result.cv_results_['std_test_score'], grid_result.cv_results_['params']) for mean, std, param in cv_results: print('%f (%f) with %r' % (mean, std, param))

优化代码:# 调参改进算法 - SVM ('C'为SVM算法的超参数) scaler = StandardScaler().fit(X_train) rescaledX = scaler.transform(X_train).astype(float) param_grid = {} param_grid['C'] = [0.1, 0.3, 0.5, 0.7, 0.9, 1.0, 1.3, 1.5, 1.7, 2.0] param_grid['kernel'] = ['linear', 'poly', 'rbf', 'sigmoid'] model = SVC() kfold = KFold(n_splits=num_folds, random_state=seed) grid = GridSearchCV(estimator=model, param_grid=param_grid, scoring=scoring, cv=kfold) grid_result = grid.fit(X=rescaledX, y=Y_train) print('最优:%s 使用%s' % (grid_result.best_score_, grid_result.best_params_)) cv_results = zip(grid_result.cv_results_['mean_test_score'], grid_result.cv_results_['std_test_score'], grid_result.cv_results_['params']) for mean, std, param in cv_results: print('%f (%f) with %r' % (mean, std, param))

时间: 2024-02-29 16:57:30 浏览: 95

这段代码本身已经使用了网格搜索(GridSearchCV)来调参,并且使用了交叉验证(KFold)来评估模型性能。因此,可以考虑从以下几个方面进一步优化:

1. 算法选择:SVM虽然是一种经典的机器学习算法,但是不一定适用于所有的数据集和问题。可以考虑使用其他的分类器或者回归器来提高模型的性能。

2. 特征工程:特征工程是机器学习中非常重要的一环,可以大幅提高模型的性能。可以考虑对数据进行更深入的分析和处理,例如特征选择、特征提取、特征变换等。

3. 数据预处理:数据预处理也是机器学习中非常重要的一环,可以大幅提高模型的性能。可以考虑对数据进行更加全面和深入的预处理,例如数据清洗、数据归一化、数据标准化等。

4. 模型集成:模型集成是一种提高模型性能的有效方法,可以考虑使用集成学习方法,例如Bagging、Boosting等。

5. 模型评估:模型评估也是非常重要的一环,可以考虑使用更加全面和准确的评估方法,例如自助法(Bootstrap)、学习曲线等。

6. 算法参数:在进行网格搜索(GridSearchCV)时,可以使用更大范围的参数,例如更大的C值或更多的核函数类型,以获得更好的效果。

阅读全文

CSDN会员

开通CSDN年卡参与万元壕礼抽奖

大家在看

AWS(亚马逊)云解决方案架构师面试三面作业全英文作业PPT

笔者参加亚马逊面试三面的作业,希望大家参考,少走弯路。

形成停止条件-c#导出pdf格式

(1)形成开始条件

(2)发送从机地址(Slave Address)

(3)命令,显示数据的传送

(4)形成停止条件

PS 1 1 1 0 0 1 A1 A0 A

Slave_Address

A

Command/Register

ACK ACK

A

Data(n)

ACK

D3 D2 D1 D0 D3 D2 D1 D0

图12

9 I2C 串行接口

本芯片由I2C协议2线串行接口来进行数据传送的,包含一个串行数据线SDA和时钟线SCL,两线内

置上拉电阻,总线空闲时为高电平。

每次数据传输时由控制器产生一个起始信号,采用同步串行传送数据,TM1680每接收一个字节数

据后都回应一个ACK应答信号。发送到SDA 线上的每个字节必须为8 位,每次传输可以发送的字节数量

不受限制。每个字节后必须跟一个ACK响应信号,在不需要ACK信号时,从SCL信号的第8个信号下降沿

到第9个信号下降沿为止需输入低电平“L”。当数据从最高位开始传送后,控制器通过产生停止信号

来终结总线传输,而数据发送过程中重新发送开始信号,则可不经过停止信号。

当SCL为高电平时,SDA上的数据保持稳定;SCL为低电平时允许SDA变化。如果SCL处于高电平时,

SDA上产生下降沿,则认为是起始信号;如果SCL处于高电平时,SDA上产生的上升沿认为是停止信号。

如下图所示:

SDA

SCL

开始条件

ACK ACK

停止条件

1 2 7 8 9 1 2 93-8

数据保持 数据改变

图13

时序图

1 写命令操作

PS 1 1 1 0 0 1 A1 A0 A 1

Slave_Address Command 1

ACK

A

Command i

ACK

X X X X X X X 1 X X X X X X XA

ACK ACK

A

图14

如图15所示,从器件的8位从地址字节的高6位固定为111001,接下来的2位A1、A0为器件外部的地

址位。

MSB LSB

1 1 1 0 0 1 A1 A0

图15

2 字节写操作

A PS A

Slave_Address

ACK

0 A

Address byte

ACK

Data byte

1 1 1 0 0 1 A1 A0 A6 A5 A4 A3 A2 A1 A0 D3 D2 D1 D0 D3 D2 D1 D0

ACK

图16

python大作业基于python实现的心电检测源码+数据+详细注释.zip

python大作业基于python实现的心电检测源码+数据+详细注释.zip

【1】项目代码完整且功能都验证ok,确保稳定可靠运行后才上传。欢迎下载使用!在使用过程中,如有问题或建议,请及时私信沟通,帮助解答。

【2】项目主要针对各个计算机相关专业,包括计科、信息安全、数据科学与大数据技术、人工智能、通信、物联网等领域的在校学生、专业教师或企业员工使用。

【3】项目具有较高的学习借鉴价值,不仅适用于小白学习入门进阶。也可作为毕设项目、课程设计、大作业、初期项目立项演示等。

【4】如果基础还行,或热爱钻研,可基于此项目进行二次开发,DIY其他不同功能,欢迎交流学习。

【备注】

项目下载解压后,项目名字和项目路径不要用中文,否则可能会出现解析不了的错误,建议解压重命名为英文名字后再运行!有问题私信沟通,祝顺利!

python大作业基于python实现的心电检测源码+数据+详细注释.zippython大作业基于python实现的心电检测源码+数据+详细注释.zippython大作业基于python实现的心电检测源码+数据+详细注释.zippython大作业基于python实现的心电检测源码+数据+详细注释.zippython大作业基于python实现的心电检测源码+数据+详细注释.zippython大作业基于python实现的心电检测源码+数据+详细注释.zippython大作业基于python实现的心电检测源码+数据+详细注释.zippython大作业基于python实现的心电检测源码+数据+详细注释.zippython大作业基于python实现的心电检测源码+数据+详细注释.zippython大作业基于python实现的心电检测源码+数据+详细注释.zippython大作业基于python实现的心电检测源码+数据+详细注释.zip

python大作业基于python实现的心电检测源码+数据+详细注释.zip

IEC 62133-2-2021最新中文版.rar

IEC 62133-2-2021最新中文版.rar

SAP各模块字段与表的对应关系

SAP各模块字段与表对应在个模块的关系以及描述

最新推荐

手把手教你python实现SVM算法

【Python实现SVM算法】 机器学习(Machine Learning)是一种让计算机通过学习和适应来改进自身性能的技术,它是人工智能的核心组成部分。机器学习主要包括分类和问题求解两大类任务。支持向量机(Support Vector ...

前端面试攻略(前端面试题、react、vue、webpack、git等工具使用方法)

javascript

前端面试攻略(前端面试题、react、vue、webpack、git等工具使用方法)

租赁合同编写指南及下载资源

资源摘要信息:《租赁合同》是用于明确出租方与承租方之间的权利和义务关系的法律文件。在实际操作中,一份详尽的租赁合同对于保障交易双方的权益至关重要。租赁合同应当包括但不限于以下要点:

1. 双方基本信息:租赁合同中应明确出租方(房东)和承租方(租客)的名称、地址、联系方式等基本信息。这对于日后可能出现的联系、通知或法律诉讼具有重要意义。

2. 房屋信息:合同中需要详细说明所租赁的房屋的具体信息,包括房屋的位置、面积、结构、用途、设备和家具清单等。这些信息有助于双方对租赁物有清晰的认识。

3. 租赁期限:合同应明确租赁开始和结束的日期,以及租期的长短。租赁期限的约定关系到租金的支付和合同的终止条件。

4. 租金和押金:租金条款应包括租金金额、支付周期、支付方式及押金的数额。同时,应明确规定逾期支付租金的处理方式,以及押金的退还条件和时间。

5. 维修与保养:在租赁期间,房屋的维护和保养责任应明确划分。通常情况下,房东负责房屋的结构和主要设施维修,而租客需负责日常维护及保持房屋的清洁。

6. 使用与限制:合同应规定承租方可以如何使用房屋以及可能的限制。例如,禁止非法用途、允许或禁止宠物、是否可以转租等。

7. 终止与续租:租赁合同应包括租赁关系的解除条件,如提前通知时间、违约责任等。同时,双方可以在合同中约定是否可以续租,以及续租的条件。

8. 解决争议的条款:合同中应明确解决可能出现的争议的途径,包括适用法律、管辖法院等,有助于日后纠纷的快速解决。

9. 其他可能需要的条款:根据具体情况,合同中可能还需要包括关于房屋保险、税费承担、合同变更等内容。

下载资源链接:【下载自www.glzy8.com管理资源吧】Rental contract.DOC

该资源为一份租赁合同模板,对需要进行房屋租赁的个人或机构提供了参考价值。通过对合同条款的详细列举和解释,该文档有助于用户了解和制定自己的租赁合同,从而在房屋租赁交易中更好地保护自己的权益。感兴趣的用户可以通过提供的链接下载文档以获得更深入的了解和实际操作指导。

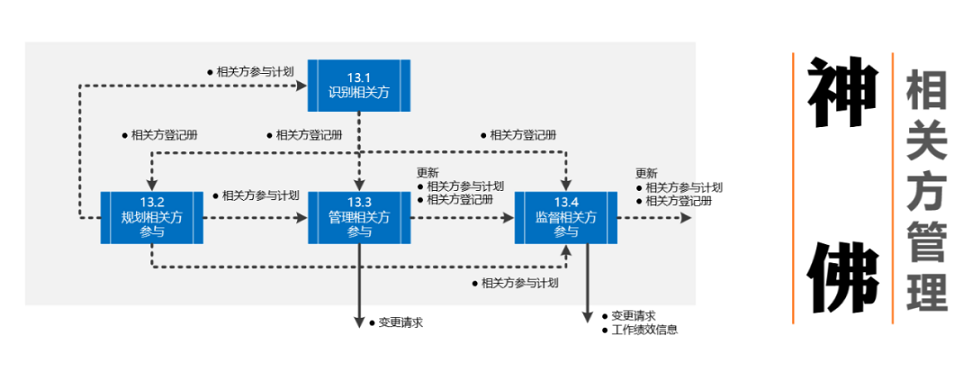

【项目管理精英必备】:信息系统项目管理师教程习题深度解析(第四版官方教材全面攻略)

# 摘要

信息系统项目管理是确保项目成功交付的关键活动,涉及一系列管理过程和知识领域。本文深入探讨了信息系统项目管理的各个方面,包括项目管理过程组、知识领域、实践案例、管理工具与技术,以及沟通和团队协作。通过分析不同的项目管理方法论(如瀑布、迭代、敏捷和混合模型),并结合具体案例,文章阐述了项目管理的最佳实践和策略。此外,本文还涵盖了项目管理中的沟通管理、团队协作的重要性,

最具代表性的改进过的UNet有哪些?

UNet是一种广泛用于图像分割任务的卷积神经网络结构,它的特点是结合了下采样(编码器部分)和上采样(解码器部分),能够保留细节并生成精确的边界。为了提高性能和适应特定领域的需求,研究者们对原始UNet做了许多改进,以下是几个最具代表性的变种:

1. **DeepLab**系列:由Google开发,通过引入空洞卷积(Atrous Convolution)、全局平均池化(Global Average Pooling)等技术,显著提升了分辨率并保持了特征的多样性。

2. **SegNet**:采用反向传播的方式生成全尺寸的预测图,通过上下采样过程实现了高效的像素级定位。

3. **U-Net+

惠普P1020Plus驱动下载:办公打印新选择

资源摘要信息: "最新惠普P1020Plus官方驱动"

1. 惠普 LaserJet P1020 Plus 激光打印机概述:

惠普 LaserJet P1020 Plus 是惠普公司针对家庭、个人办公以及小型办公室(SOHO)市场推出的一款激光打印机。这款打印机的设计注重小巧体积和便携操作,适合空间有限的工作环境。其紧凑的设计和高效率的打印性能使其成为小型企业或个人用户的理想选择。

2. 技术特点与性能:

- 预热技术:惠普 LaserJet P1020 Plus 使用了0秒预热技术,能够极大减少打印第一张页面所需的等待时间,首页输出时间不到10秒。

- 打印速度:该打印机的打印速度为每分钟14页,适合处理中等规模的打印任务。

- 月打印负荷:月打印负荷高达5000页,保证了在高打印需求下依然能稳定工作。

- 标配硒鼓:标配的2000页打印硒鼓能够为用户提供较长的使用周期,减少了更换耗材的频率,节约了长期使用成本。

3. 系统兼容性:

驱动程序支持的操作系统包括 Windows Vista 64位版本。用户在使用前需要确保自己的操作系统版本与驱动程序兼容,以保证打印机的正常工作。

4. 市场表现:

惠普 LaserJet P1020 Plus 在上市之初便获得了市场的广泛认可,创下了百万销量的辉煌成绩,这在一定程度上证明了其可靠性和用户对其性能的满意。

5. 驱动程序文件信息:

压缩包内包含了适用于该打印机的官方驱动程序文件 "lj1018_1020_1022-HB-pnp-win64-sc.exe"。该文件是安装打印机驱动的执行程序,用户需要下载并运行该程序来安装驱动。

另一个文件 "jb51.net.txt" 从命名上来看可能是一个文本文件,通常这类文件包含了关于驱动程序的安装说明、版本信息或是版权信息等。由于具体内容未提供,无法确定确切的信息。

6. 使用场景:

由于惠普 LaserJet P1020 Plus 的打印速度和负荷能力,它适合那些需要快速、频繁打印文档的用户,例如行政助理、会计或小型法律事务所。它的紧凑设计也使得这款打印机非常适合在桌面上使用,从而不占用过多的办公空间。

7. 后续支持与维护:

用户在购买后可以通过惠普官方网站获取最新的打印机驱动更新以及技术支持。在安装新驱动之前,建议用户先卸载旧的驱动程序,以避免版本冲突或不必要的错误。

8. 其它注意事项:

- 用户在使用打印机时应注意按照官方提供的维护说明定期进行清洁和保养,以确保打印质量和打印机的使用寿命。

- 如果在打印过程中遇到任何问题,应先检查打印机设置、驱动程序是否正确安装以及是否有足够的打印纸张和墨粉。

综上所述,惠普 LaserJet P1020 Plus 是一款性能可靠、易于使用的激光打印机,特别适合小型企业或个人用户。正确的安装和维护可以确保其稳定和高效的打印能力,满足日常办公需求。

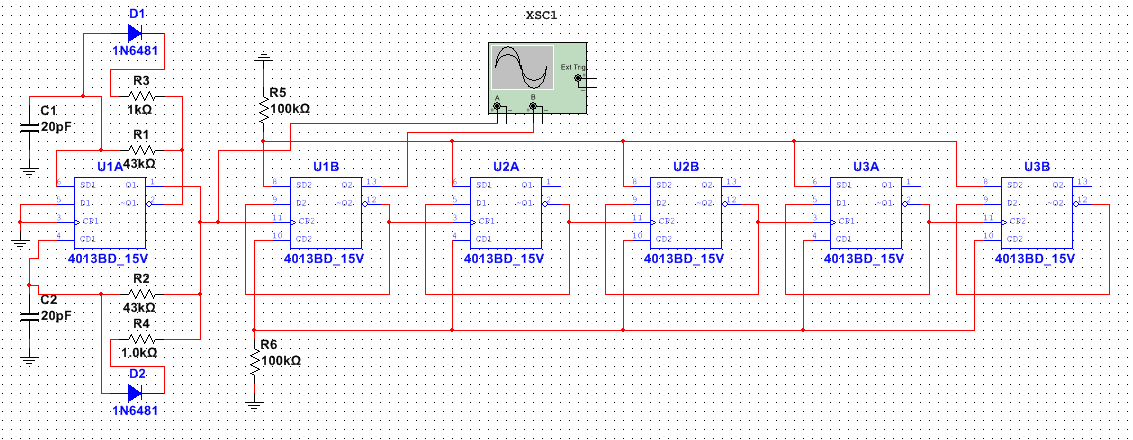

数字电路实验技巧:10大策略,让你的实验效率倍增!

# 摘要

本论文详细介绍了数字电路实验的基础理论、设备使用、设计原则、实践操作、调试与故障排除以及报告撰写与成果展示。首先探讨了数字电路实验所需的基本理论和实验设备的种类与使用技巧,包括测量和故障诊断方法。接着,深入分析了电路设计的原则,涵盖设计流程、逻辑简化、优化策略及实验方案的制定。在实践操作章节中,具体

altium designer布线

### Altium Designer 布线教程和技巧

#### 一、环境设置与准备

为了更高效地完成布线工作,前期的准备工作至关重要。确保原理图已经完全无误并编译成功[^2]。

#### 二、同步查看原理图与PCB布局

通过在原理图标题栏处右键点击并选择 "Split Vertical" 可实现原理图和PCB视图的同时展示,这有助于理解电路连接关系以及提高布线效率。

#### 三、自动布线器配置

Altium Designer内置有强大的自动布线功能。进入“Tools -> PCB Rules and Constraints Editor”,可以自定义诸如最小间距、过孔尺寸等参数来满足

Rust与OpenGL共同打造的迷宫游戏

资源摘要信息:"迷宫游戏开发指南"

在Rust和OpenGL环境下开发迷宫游戏涉及多个方面的知识点,包括编程语言Rust的基本语法和高级特性,OpenGL的图形编程原理以及游戏循环和资源管理等。以下详细说明了这些知识点:

1. Rust编程语言基础

Rust是一种系统编程语言,它提供了内存安全而无需垃圾回收器。Rust的目标是防止空指针解引用、缓冲区溢出等内存安全问题。迷宫游戏开发中,使用Rust可以高效利用系统资源并保证运行时的稳定性和性能。基础知识点包括但不限于:

- 变量和可变性

- 数据类型:整型、浮点型、字符、布尔类型、元组、数组、切片等

- 控制流:if、循环(for, while)、模式匹配

- 函数和闭包

- 所有权、借用和生命周期

- 结构体、枚举和特征

- 模块和使用语句

- 错误处理:Result和Option枚举

- 异步编程:async和await

2. OpenGL图形编程基础

OpenGL(Open Graphics Library)是一个跨语言、跨平台的API,用于渲染2D和3D矢量图形。在Rust中,可以使用gl-rs或其他类似的库来创建OpenGL上下文,并进行渲染操作。迷宫游戏开发中,开发者需要掌握的知识点包括:

- OpenGL上下文的创建和管理

- 着色器语言GLSL的基本语法

- 纹理映射、光源和材质处理

- 几何体的创建和管理(如顶点缓冲、索引缓冲等)

- 渲染管线的各个阶段(顶点处理、裁剪、光栅化等)

- 深度缓冲和模板缓冲的使用

- OpenGL状态机的理解和管理

3. 游戏开发循环

游戏开发循环是指游戏运行时不断循环进行的一系列步骤,通常包括输入处理、游戏状态更新和渲染。迷宫游戏开发中,游戏循环的设计与实现是至关重要的部分。涉及到的知识点包括:

- 游戏状态机的设计

- 输入事件的监听和处理(如键盘、鼠标事件)

- 游戏逻辑的更新(如玩家移动、碰撞检测、迷宫生成逻辑等)

- 场景的渲染和重绘

- 游戏帧率的控制和时间管理

4. 资源管理

资源管理是指游戏中各类资源(如图像、音频、模型等)的加载、使用和释放。在Rust中,这通常涉及到文件读取、内存管理和生命周期控制。迷宫游戏开发中需要的知识点包括:

- 文件系统的操作(如读取迷宫数据文件)

- 内存管理策略(如资源的动态加载和卸载)

- 图像和纹理的加载和使用

- 音频播放控制

- 资源释放时机的确定以避免内存泄漏

5. 迷宫游戏逻辑实现

迷宫游戏的逻辑实现是指游戏中迷宫的生成、玩家的引导和游戏的胜负判定等核心游戏机制。迷宫游戏逻辑实现中的关键知识点包括:

- 迷宫生成算法(如深度优先搜索算法、Prim算法或Kruskal算法等)

- 玩家和游戏对象的移动逻辑

- 路径寻找和导引逻辑(如A*算法)

- 胜负判定和游戏重置逻辑

6. 使用Rust和OpenGL库

实际开发中,开发者会使用一些Rust库来简化OpenGL的调用和管理。相关的知识点包括:

- cargo工具和Rust包管理

- 使用Rust的OpenGL绑定库(如gl-rs、glium等)

- 管理依赖和构建项目的配置文件(Cargo.toml)

- 使用第三方库来处理窗口创建和事件循环(如 glutin)

7. 调试和性能优化

在开发迷宫游戏的过程中,调试和性能优化是重要的环节,以确保游戏运行的流畅性和稳定性。相关的知识点包括:

- 使用调试工具(如gdb、rr、Valgrind等)进行错误追踪和性能分析

- 代码的性能优化策略(如循环展开、内存对齐、缓存优化等)

- 图形渲染的性能优化(如批处理渲染、优化状态切换、减少绘制调用等)

- 使用诊断工具(如Rust的cargo-expand等)来查看代码展开和宏展开

综上所述,Rust和OpenGL迷宫游戏的开发涉及众多知识点,需要开发者具备扎实的编程基础、图形编程经验、游戏开发知识和系统性能优化能力。通过使用Rust的现代编程特性和OpenGL的强大图形处理能力,可以开发出运行高效且稳定的迷宫游戏。

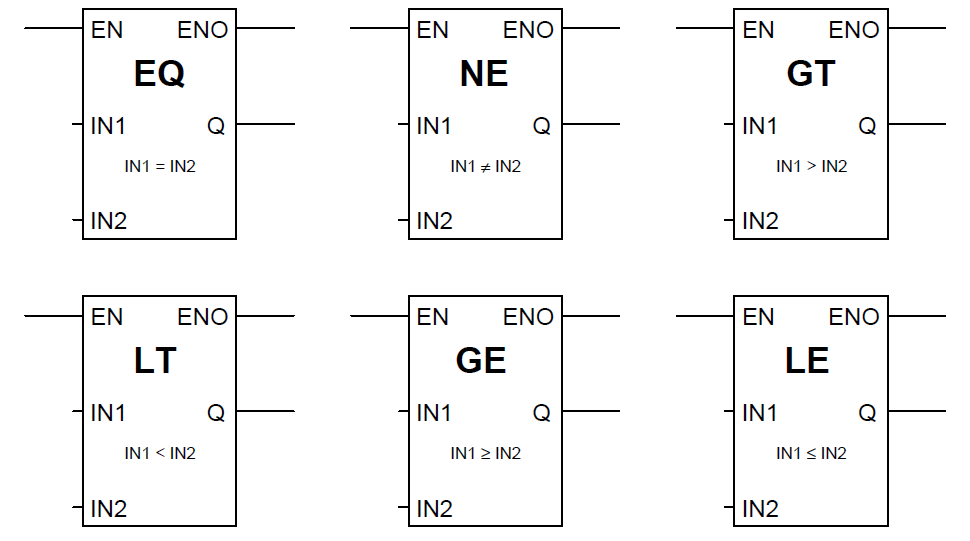

数字电路设计基础:9大技巧带你从理论飞跃到实践

# 摘要

数字电路设计是电子工程领域中的核心部分,它涵盖了从基本概念到高级技巧的广泛知识。本文首先介绍了数字电路设计的基本概念和原理,接着深入探讨了理论基础,包括逻辑门、组合逻辑电路以及时序逻辑电路的设计。随后,文章转向实践应用,讨论了设计工具、仿真测试方法和数字电路在不同领域的应用实例。最后,本