首页

将sql文件转换为字符串

将sql文件转换为字符串

时间: 2023-05-17 21:04:53

浏览: 102

可以使用Python中的open函数读取sql文件,然后使用字符串的join方法将读取的内容连接成一个字符串。示例代码如下: ```python with open('example.sql', 'r') as f: sql_str = ''.join(f.readlines()) ``` 其中,example.sql是要转换的sql文件名,sql_str是转换后的字符串。

阅读全文

立即开通

100%中奖

相关推荐

XMLSQL:将SQL查询结果转换为XML字符串的开源工具

通过将查询结果格式化为XML字符串,XMLSQL为数据的进一步处理提供了便利,比如可以方便地通过网络传输或集成到其他系统中。 XMLSQL的开源特性意味着它遵循开源软件的开发和使用规则。开源软件通常具有自由使用、...

PowerBuilder中将日期转换为字符串的源码

图像存储在数据库中通常是通过将图像文件转换为二进制流,然后将该二进制流存储在数据库的BLOB(Binary Large Object)类型的字段中实现的。" 知识点: 1. PowerBuilder应用开发: PowerBuilder是一种由Sybase公司...

ASP.NET中SQL Server连接字符串详解

- How to Convert a LocalDB Connection String to SQL Server Express:反之亦然,将LocalDB的连接字符串转换回SQL Server Express可能需要调整服务器地址和数据源参数。 3. CommonConnectionStringSettings:...

sql-varbinary转换成字符串

其中,从varbinary类型转换为字符串类型的场景非常常见,尤其是在处理图像、文件或其他二进制数据时。本文将详细介绍如何在SQL Server环境中实现varbinary到字符串的转换。 #### 一、背景介绍 varbinary是一...

解决sql server保存对象字符串转换成uniqueidentifier失败的问题

在Hibernate映射文件中,ID的生成策略设置为uuid.hex,这意味着在持久化对象时,会尝试将一个由uuid.hex生成的16进制字符串转换为uniqueidentifier,导致了错误。 解决这个问题的方法是将映射文件中的ID生成...

CSharp将任何文件转成字符串保存到数据库及文件加密

本主题聚焦于如何使用C#语言将任意文件转换为字符串,并将其保存到数据库中,以及如何对这些文件进行加密,确保数据的安全性。这里我们将深入探讨相关知识点。 首先,让我们了解如何将文件转换为字符串。在C#中,这...

SQL常用字符串函数

根据提供的文件信息,我们可以整理出关于SQL中常用的字符串函数的相关知识点。这些函数广泛应用于数据库查询、数据处理等场景,能够帮助我们高效地管理和操作文本数据。 ### 1. ASCII() **功能**: 将一个字符转换...

sql 字符串处理大全

根据提供的文件信息,本文将详细介绍SQL中用于处理字符串的各种实用函数。这些函数涵盖了字符串的截取、转换、搜索以及格式化等多个方面,是数据库开发人员不可或缺的工具。 ### SQL字符串处理函数 #### 1. 字符串...

sql字符串处理函数

根据提供的文件信息,我们可以归纳总结出一系列关于SQL字符串处理函数的知识点。这些函数在数据库管理和数据操作中扮演着重要的角色,能够帮助用户高效地完成字符串的处理任务。 ### ASCII() ASCII()函数用于获取...

将SQL Server CLR存储过程安装为十六进制字符串

2. **转换为十六进制字符串**:使用PowerShell或其他编程语言,读取DLL文件的二进制内容,并将其转换为十六进制字符串。例如,在PowerShell中,可以使用[System.IO.File]::ReadAllBytes()函数读取文件,然后通过-...

ASP的SQL Server连接字符串介绍

例如,如何将SQL Server Express的连接字符串转换为LocalDB,反之亦然。这在迁移数据或在不同开发阶段选择不同的数据库服务器时非常有用。 为了进一步增强连接字符串的灵活性和安全性,可能还需要了解如何在代码中...

sql连接字符串和驱动类名

例如,在上面的部分内容中提到了使用java.sql.Date.valueOf方法来将字符串转换为java.sql.Date对象。 java import java.sql.Date; import java.text.SimpleDateFormat; public class DateExample { public...

对字典表的数值转换为字符串

在IT行业中,尤其是在Java编程领域,我们经常遇到需要将字典表(Dictionary Table)的数值转换为对应的字符串表示。字典表是一种存储枚举类型数据的数据库表,它通常包含两个字段:一个用于存储数值ID,另一个用于...

Sqlserver 2014 之 自定义字符串聚合函数

标准的T-SQL提供了一些内置的聚合函数,如SUM、AVG、MAX和MIN,但它们并不支持将多个字符串合并为一个单一的字符串。在描述中提到的“Sqlserver 2014 之 自定义字符串聚合函数”正是针对这个需求而展开的讨论。 在...

将sql表转换为xml文件

在标题为“将sql表转换为xml文件”的主题中,我们探讨的是如何将SQL Server中的数据表转换成XML格式,这是一种广泛用于数据交换和存储的轻量级标记语言。描述中提到的数据集WriteXml方法是C#编程环境下处理这一问题...

IP连接SQL SERVER失败(配置为字符串失败)图文解决方法

本文将详细解析如何解决使用IP连接SQL Server失败以及配置为连接字符串失败的问题。 首先,让我们分析标题和描述中提到的两个常见问题场景: **情景一:配置为字符串连接失败** 这是指在Web应用程序的配置文件...

字符串转换

字符串转换涉及到将一种字符串格式或类型转化为另一种,以便适应不同的应用场景或满足特定的需求。这个“字符串转换工具”很可能是为了帮助开发者和用户更加便捷地进行各种字符串操作。 在编程中,常见的字符串转换...

SQLServer字符串函数详解与示例

5. **UPPER** 函数:与LOWER相反,它将字符串转换为大写。UPPER('sql server课程')返回'SQL SERVER课程'。 6. **LTRIM** 函数:清除字符串左边的空格,但保留右边的空格。例如,LTRIM (' 周智宇 ')返回'周智宇 ...

SQL存储过程处理JSON字符串及循环控制

在SQL Server 2016及以后版本中,可以使用OPENJSON()函数来解析JSON字符串,并将其转换为一个可查询的结果集,或者使用JSON_VALUE()和JSON_QUERY()函数来提取特定的值或对象。在这个存储过程中,虽然没有显示...

Java字符串操作进阶:BWT转换、游程编码、CSV到SQL转换

资源摘要信息:"string-manipulation:Burrows Wheeler转换,游程编码,从CSV字符串提取到SQL语法的超快速字符串操作,句子结尾检测(NLP)等" 标题和描述中提到了多个与字符串操作相关的高级技术,包括Burrows ...

CSDN会员

开通CSDN年卡参与万元壕礼抽奖

海量

VIP免费资源

千本

正版电子书

商城

会员专享价

千门

课程&专栏

全年可省5,000元

立即开通

全年可省5,000元

立即开通

大家在看

STM8L051F3P6使用手册(中文).zip

STM8L051

华为2403安装手册.

domain default enable system # local-server nas-ip 127.0.0.1 key huawei #interface Aux0/0 vlan 1 description pc #

TwinCAT3.1学习笔记

德国倍福工控机和嵌入式控制器的软件开发环境学习笔记,对初学者非常有帮助

新代plc资料

台湾新代plc编辑软件使用说明书,梯形图解编程说明

先栅极还是后栅极 业界争论高K技术

随着晶体管尺寸的不断缩小,HKMG(high-k绝缘层+金属栅极)技术几乎已经成为45nm以下级别制程的必备技术.不过在制作HKMG结构晶体管的 工艺方面,业内却存在两大各自固执己见的不同阵营,分别是以IBM为代表的Gate-first(先栅极)工艺流派和以Intel为代表的Gate-last(后栅极)工艺流派,尽管两大阵营均自称只有自己的工艺才是最适合制作HKMG晶体管的技术,但一般来说使用Gate-first工艺实现HKMG结构的难点在于如何控制 PMOS管的Vt电压(门限电压);而Gate-last工艺的难点则在于工艺较复杂,芯片的管芯密度同等条件下要比Gate-first工艺低,需要设 计方积极配合修改电路设计才可以达到与Gate-first工艺相同的管芯密度级别。

最新推荐

SQL Server中实现二进制与字符类型之间的数据转换

例如,当需要分析存储在二进制字段中的设备通信协议数据,或者需要将用户可读的十六进制字符串写入数据库时,这些转换函数就显得尤为重要。值得注意的是,虽然在应用程序级别处理这种转换更常见,但有时出于性能或...

用Python将Excel数据导入到SQL Server的例子

5. **构建SQL插入语句**:在循环中,遍历Excel文件中的每一行和每一列,将单元格的值转化为字符串,并用逗号分隔。这些值最终会组合成一个大的`INSERT INTO`语句,用于插入数据到SQL Server的表中。 6. **批量插入*...

Linux awk将文件某列按照逗号分隔的例子

相反,如果你有一个由逗号分隔的列表,比如`1,2,3,4,5`,并且想要将它们合并成单个字符串`12345`,你可以改变输入记录分隔符(Input Record Separator, IRS): ```bash cat temp.txt | awk 'BEGIN{RS=","} {print ...

Silverlight4中上传EXCEL并将EXCEL文件数据插入到SQL数据库中

在 Silverlight 4.0 应用程序中,将 Excel 文件数据上传并插入到 SQL 数据库涉及多个步骤,包括文件选择、数据读取、转换以及与数据库交互。以下是一个详细的实现过程: 1. **文件选择**: 首先,在用户界面(UI)...

从python读取sql的实例方法

如果你的SQL语句已经存在于字符串中,你可以这样使用Pandas: ```python import pandas as pd df = pd.read_sql(sql_content, con) ``` 这会将SQL查询的结果转换为Pandas DataFrame,便于进一步的数据处理和分析...

掌握HTML/CSS/JS和Node.js的Web应用开发实践

资源摘要信息:"本资源摘要信息旨在详细介绍和解释提供的文件中提及的关键知识点,特别是与Web应用程序开发相关的技术和概念。" 知识点一:两层Web应用程序架构 两层Web应用程序架构通常指的是客户端-服务器架构中的一个简化版本,其中用户界面(UI)和应用程序逻辑位于客户端,而数据存储和业务逻辑位于服务器端。在这种架构中,客户端(通常是一个Web浏览器)通过HTTP请求与服务器端进行通信。服务器端处理请求并返回数据或响应,而客户端负责展示这些信息给用户。 知识点二:HTML/CSS/JavaScript技术栈 在Web开发中,HTML、CSS和JavaScript是构建前端用户界面的核心技术。HTML(超文本标记语言)用于定义网页的结构和内容,CSS(层叠样式表)负责网页的样式和布局,而JavaScript用于实现网页的动态功能和交互性。 知识点三:Node.js技术 Node.js是一个基于Chrome V8引擎的JavaScript运行时环境,它允许开发者使用JavaScript来编写服务器端代码。Node.js是非阻塞的、事件驱动的I/O模型,适合构建高性能和高并发的网络应用。它广泛用于Web应用的后端开发,尤其适合于I/O密集型应用,如在线聊天应用、实时推送服务等。 知识点四:原型开发 原型开发是一种设计方法,用于快速构建一个可交互的模型或样本来展示和测试产品的主要功能。在软件开发中,原型通常用于评估概念的可行性、收集用户反馈,并用作后续迭代的基础。原型开发可以帮助团队和客户理解产品将如何运作,并尽早发现问题。 知识点五:设计探索 设计探索是指在产品设计过程中,通过创新思维和技术手段来探索各种可能性。在Web应用程序开发中,这可能意味着考虑用户界面设计、用户体验(UX)和用户交互(UI)的创新方法。设计探索的目的是创造一个既实用又吸引人的应用程序,可以提供独特的价值和良好的用户体验。 知识点六:评估可用性和有效性 评估可用性和有效性是指在开发过程中,对应用程序的可用性(用户能否容易地完成任务)和有效性(应用程序是否达到了预定目标)进行检查和测试。这通常涉及用户测试、反馈收集和性能评估,以确保最终产品能够满足用户的需求,并在技术上实现预期的功能。 知识点七:HTML/CSS/JavaScript和Node.js的特定部分使用 在Web应用程序开发中,开发者需要熟练掌握HTML、CSS和JavaScript的基础知识,并了解如何将它们与Node.js结合使用。例如,了解如何使用JavaScript的AJAX技术与服务器端进行异步通信,或者如何利用Node.js的Express框架来创建RESTful API等。 知识点八:应用领域的广泛性 本文件提到的“基准要求”中提到,通过两层Web应用程序可以实现多种应用领域,如游戏、物联网(IoT)、组织工具、商务、媒体等。这说明了Web技术的普适性和灵活性,它们可以被应用于构建各种各样的应用程序,满足不同的业务需求和用户场景。 知识点九:创造性界限 在开发Web应用程序时,鼓励开发者和他们的合作伙伴探索创造性界限。这意味着在确保项目目标和功能要求得以满足的同时,也要勇于尝试新的设计思路、技术方案和用户体验方法,从而创造出新颖且技术上有效的解决方案。 知识点十:参考资料和文件结构 文件名称列表中的“a2-shortstack-master”暗示了这是一个与作业2相关的项目文件夹或代码库。通常,在这样的文件夹结构中,可以找到HTML文件、样式表(CSS文件)、JavaScript脚本以及可能包含Node.js应用的服务器端代码。开发者可以使用这些文件来了解项目结构、代码逻辑和如何将各种技术整合在一起以创建一个完整的工作应用程序。

管理建模和仿真的文件

管理Boualem Benatallah引用此版本:布阿利姆·贝纳塔拉。管理建模和仿真。约瑟夫-傅立叶大学-格勒诺布尔第一大学,1996年。法语。NNT:电话:00345357HAL ID:电话:00345357https://theses.hal.science/tel-003453572008年12月9日提交HAL是一个多学科的开放存取档案馆,用于存放和传播科学研究论文,无论它们是否被公开。论文可以来自法国或国外的教学和研究机构,也可以来自公共或私人研究中心。L’archive ouverte pluridisciplinaire

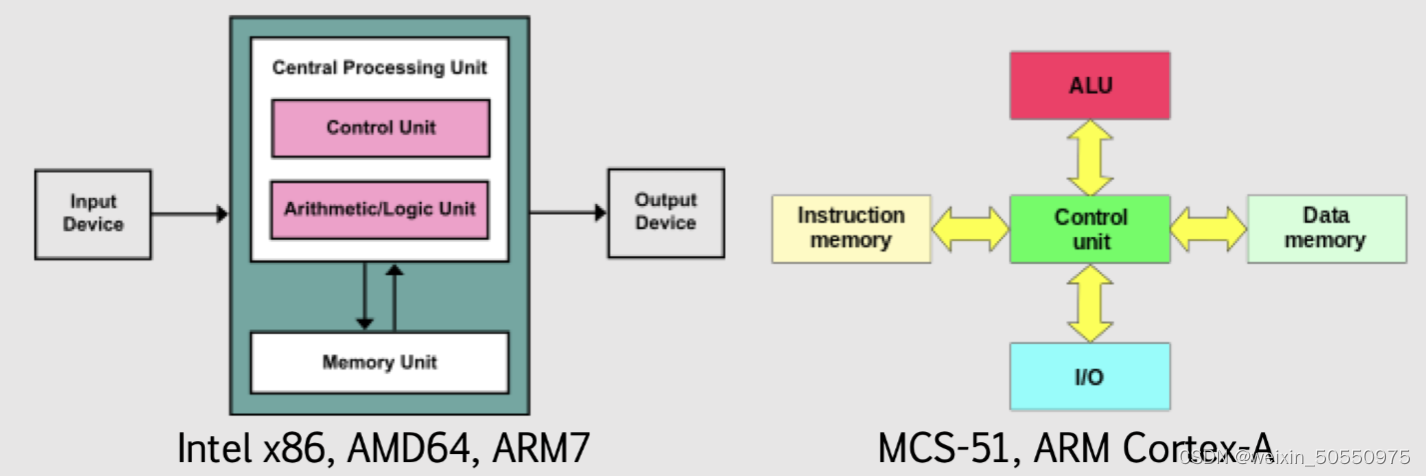

计算机体系结构概述:基础概念与发展趋势

# 摘要 计算机体系结构作为计算机科学的核心领域,经历了从经典模型到现代新发展的演进过程。本文从基本概念出发,详细介绍了冯·诺依曼体系结构、哈佛体系结构以及RISC和CISC体系结构的设计原则和特点。随后,文章探讨了现代计算机体系结构的新发展,包括并行计算体系结构、存储体系结构演进和互连网络的发展。文中还深入分析了前沿技术如量子计算机原理、脑启发式计算以及边缘计算和物联网的结合。最后,文章对计算机体系结构未来的发展趋

int a[][3]={{1,2},{4}}输出这个数组

`int a[][3]={{1,2},{4}}` 定义了一个二维数组,它有两行三列,但是只填充了前两行的数据。第一行是 {1, 2},第二行是 {4}。 当你尝试输出这个数组时,需要注意的是,由于分配的空间是固定的,所以对于只填充了两行的情况,第三列是未初始化的,通常会被默认为0。因此,常规的打印方式会输出类似这样的结果: ``` a[0][0]: 1 a[0][1]: 2 a[1][0]: 4 a[1][1]: (未初始化,可能是0) ``` 如果需要展示所有元素,即使是未初始化的部分,可能会因为语言的不同而有不同的显示方式。例如,在C++或Java中,你可以遍历整个数组来输出: `

勒玛算法研讨会项目:在线商店模拟与Qt界面实现

资源摘要信息: "lerma:算法研讨会项目" 在本节中,我们将深入了解一个名为“lerma:算法研讨会项目”的模拟在线商店项目。该项目涉及多个C++和Qt框架的知识点,包括图形用户界面(GUI)的构建、用户认证、数据存储以及正则表达式的应用。以下是项目中出现的关键知识点和概念。 标题解析: - lerma: 看似是一个项目或产品的名称,作为算法研讨会的一部分,这个名字可能是项目创建者或组织者的名字,用于标识项目本身。 - 算法研讨会项目: 指示本项目是一个在算法研究会议或研讨会上呈现的项目,可能是为了教学、展示或研究目的。 描述解析: - 模拟在线商店项目: 项目旨在创建一个在线商店的模拟环境,这涉及到商品展示、购物车、订单处理等常见在线购物功能的模拟实现。 - Qt安装: 项目使用Qt框架进行开发,Qt是一个跨平台的应用程序和用户界面框架,所以第一步是安装和设置Qt开发环境。 - 阶段1: 描述了项目开发的第一阶段,包括使用Qt创建GUI组件和实现用户登录、注册功能。 - 图形组件简介: 对GUI组件的基本介绍,包括QMainWindow、QStackedWidget等。 - QStackedWidget: 用于在多个页面或视图之间切换的组件,类似于标签页。 - QLineEdit: 提供单行文本输入的控件。 - QPushButton: 按钮控件,用于用户交互。 - 创建主要组件以及登录和注册视图: 涉及如何构建GUI中的主要元素和用户交互界面。 - QVBoxLayout和QHBoxLayout: 分别表示垂直和水平布局,用于组织和排列控件。 - QLabel: 显示静态文本或图片的控件。 - QMessageBox: 显示消息框的控件,用于错误提示、警告或其他提示信息。 - 创建User类并将User类型向量添加到MainWindow: 描述了如何在项目中创建用户类,并在主窗口中实例化用户对象集合。 - 登录和注册功能: 功能实现,包括验证电子邮件、用户名和密码。 - 正则表达式的实现: 使用QRegularExpression类来验证输入字段的格式。 - 第二阶段: 描述了项目开发的第二阶段,涉及数据的读写以及用户数据的唯一性验证。 - 从JSON格式文件读取和写入用户: 描述了如何使用Qt解析和生成JSON数据,JSON是一种轻量级的数据交换格式,易于人阅读和编写,同时也易于机器解析和生成。 - 用户名和电子邮件必须唯一: 在数据库设计时,确保用户名和电子邮件字段的唯一性是常见的数据完整性要求。 - 在允许用户登录或注册之前,用户必须选择代表数据库的文件: 用户在进行登录或注册之前需要指定一个包含用户数据的文件,这可能是项目的一种安全或数据持久化机制。 标签解析: - C++: 标签说明项目使用的编程语言是C++。C++是一种高级编程语言,广泛应用于软件开发领域,特别是在性能要求较高的系统中。 压缩包子文件的文件名称列表: - lerma-main: 这可能是包含项目主要功能或入口点的源代码文件或模块的名称。通常,这样的文件包含应用程序的主要逻辑和界面。 通过这些信息,可以了解到该项目是一个采用Qt框架和C++语言开发的模拟在线商店应用程序,它不仅涉及基础的GUI设计,还包括用户认证、数据存储、数据验证等后端逻辑。这个项目不仅为开发者提供了一个实践Qt和C++的机会,同时也为理解在线商店运行机制提供了一个良好的模拟环境。