数据清洗与预处理:用Plotly探索性数据分析(实战技巧)

发布时间: 2024-09-30 03:42:40 阅读量: 3 订阅数: 14

# 1. 数据清洗与预处理概述

数据清洗与预处理是数据分析和机器学习流程中的关键步骤,为后续的模型训练与决策分析提供了可靠和高质量的数据基础。在本章中,我们将简要介绍数据清洗与预处理的概念,概述其在数据分析流程中的重要性,并讨论一些常见的数据质量问题。

## 1.1 数据清洗与预处理简介

在实际应用中,原始数据往往包含着各种各样的问题,如缺失值、重复记录、格式错误或不一致性等。数据清洗的目的就在于识别并纠正这些数据问题,以提高数据质量。而预处理则是将清洗后的数据转换成适合模型训练的格式。预处理技术包括数据标准化、归一化、特征构造等,它们在提升模型性能和准确率方面起着至关重要的作用。

## 1.2 数据清洗的重要性

数据清洗对于任何数据驱动的项目来说都是必不可少的。质量差的数据可能导致误导性的分析结果,进而影响业务决策。高准确度的数据清洗有助于提升数据洞察的质量,为决策制定者提供更加可靠的参考依据。此外,数据预处理还能够减少模型训练的时间,并提高模型的泛化能力。

## 1.3 数据质量问题与解决策略

数据质量问题多种多样,包括但不限于数据不一致性、异常值、缺失值以及格式错误等。解决这些问题通常需要一系列步骤,例如:

- 使用统计分析方法来识别异常值;

- 采用数据填充或删除记录来处理缺失值;

- 标准化数据格式,以确保数据的一致性。

数据清洗与预处理是数据科学领域中的基础技能,它们能够为数据分析和模型构建奠定坚实的基础。在下一章节中,我们将深入探讨探索性数据分析的基础知识,以及如何利用数据可视化工具进行数据集探索。

# 2. 探索性数据分析基础

## 2.1 数据探索的基本概念

### 2.1.1 数据探索的目的和重要性

数据探索是数据分析的初级阶段,其目的是为了理解数据集的内在结构和内容。通过数据探索可以揭示变量之间的关系,发现数据的模式,以及识别数据中的异常点或离群值。这一步骤对于后续的数据处理、模型构建以及最终的决策制定至关重要。

数据探索能够帮助分析师:

- 确定数据的质量和完整性;

- 了解数据的分布和中心趋势;

- 检测并处理异常值;

- 识别变量之间的相关性;

- 理解数据的多维结构;

- 发现潜在的业务洞察。

### 2.1.2 数据集的基本操作与统计描述

在数据探索中,基本操作包括数据的加载、查看、筛选、排序和分组等。统计描述则是使用数学和统计方法对数据进行描述,常用的统计描述包括:

- **集中趋势**:包括均值、中位数和众数。

- **离散程度**:包括方差、标准差和极差。

- **分布形态**:如偏度和峰度。

- **数据集的汇总**:如最小值、最大值、总和和均值。

对数据进行初步的统计描述后,可以借助箱线图、直方图等图形工具帮助理解数据的分布和离散情况。

## 2.2 数据可视化简介

### 2.2.1 可视化的作用和类型

数据可视化是将数据转化为图形,以便于人类直观地理解复杂数据结构的一种手段。数据可视化的作用在于:

- **揭示模式和趋势**:图形可以帮助快速识别数据中的模式和趋势。

- **简化复杂数据**:通过视觉元素,如颜色和形状,简化复杂数据的表示。

- **辅助决策制定**:直观的图表使得决策者可以更快作出基于数据的决策。

数据可视化主要有以下类型:

- **一维**:条形图、直方图;

- **二维**:散点图、线图、箱线图;

- **多维**:热图、多维散点图、气泡图;

- **关系**:网络图、树图;

- **地理信息**:地图、点图。

### 2.2.2 Plotly图表库概述

Plotly是一个强大的图表库,广泛应用于数据可视化领域。它支持多种类型的图表,并且能够创建交互式的图形,用户可以通过缩放、悬停等方式交互式地探索数据。

Plotly图表的特点包括:

- **交互性**:用户可以通过鼠标事件与图表互动。

- **多输出格式**:支持网页、Jupyter Notebook等多种环境。

- **高级定制**:可通过调整选项来自定义图表的每一部分。

以下是创建一个简单的散点图的基本代码:

```python

import plotly.express as px

# 假设df是Pandas DataFrame数据

fig = px.scatter(df, x="列名x", y="列名y")

fig.show()

```

在这段代码中,`px.scatter`是创建散点图的函数,`df`是包含数据的Pandas DataFrame对象,`x`和`y`参数指定了图表的x轴和y轴数据列。

## 2.3 数据预处理流程

### 2.3.1 数据缺失处理

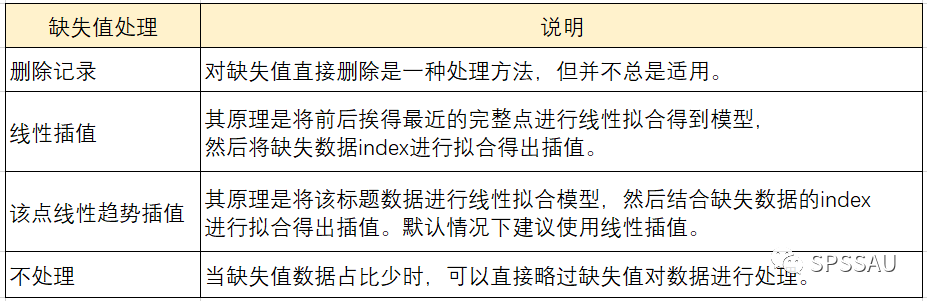

数据集中常存在缺失值,这些缺失值可能会导致分析结果的偏差,因此需要处理。处理方法包括删除含有缺失值的记录、填充缺失值等。

- **删除**:当数据集很大且缺失值比例较小时,可以考虑删除缺失值。

- **填充**:用均值、中位数、众数或预测模型来填充缺失值。

```python

# 删除含有缺失值的行

df_cleaned = df.dropna()

# 使用均值填充数值型数据的缺失值

df_filled = df.fillna(df.mean())

```

在上述代码中,`df.dropna()`用于删除含有缺失值的行,而`df.fillna(df.mean())`则使用数据集的均值填充数值型数据的缺失值。

### 2.3.2 数据类型转换

数据类型转换是为了确保数据的正确性以及后续分析的顺利进行。例如,文本数据可能需要转换为分类变量,日期数据需要转换为日期时间格式。

```python

# 将字符串转换为日期时间对象

df['日期'] = pd.to_datetime(df['日期'])

# 将分类文本转换为分类变量

df['类别'] = df['类别'].astype('category')

```

### 2.3.3 数据标准化和归一化

数据标准化和归一化是将不同范围的特征缩放到统一的范围。标准化通常指的是将数据按比例缩放,使之落入一个小的特定区间,常用的是Z-score标准化。归一化则通常指的是将数据缩放到0和1之间。

```python

from sklearn.preprocessing import StandardScaler, MinMaxScaler

# Z-score标准化

scaler = StandardScaler()

df_scaled = scaler.fit_transform(df)

# Min-Max归一化

min_max_scaler = MinMaxScaler()

df_normalized = min_max_scaler.fit_transform(df)

```

在这段代码中,`StandardScaler`和`MinMaxScaler`都是从`sklearn.preprocessing`模块导入的,用于执行数据的标准化和归一化操作。

通过上述步骤,数据预处理流程能够有效地提高数据的质量,为后续的数据分析和机器学习模型训练提供更好的基础。

# 3. 使用Plotly进行数据探索

在数据科学领域,数据可视化是一个不可或缺的环节,它不仅有助于我们理解数据的分布和结构,还能揭示数据之间隐藏的关系和模式。Plotly是一个强大的图形库,允许用户创建交互式、高质量的图表,并且可以轻松地集成到Web应用程序中。

## 3.1 散点图和气泡图的应用

### 3.1.1 创建散点图和气泡图

散

0

0