深入解析Linux内核:启动流程到核心组件的完全指南

发布时间: 2024-09-26 18:43:34 阅读量: 60 订阅数: 25

# 1. Linux内核启动流程概述

Linux操作系统以其开源性和强大的功能吸引了全球范围内无数的开发者和用户。Linux内核作为整个系统的核心,承载着管理硬件资源、提供系统服务、以及执行用户空间程序等重要职责。本章我们将对Linux内核启动流程进行一个概述,为之后深入各内部模块和机制打下基础。

## 1.1 Linux的启动过程

Linux系统的启动过程可以分为几个主要阶段:

1. **硬件加电自检(POST)**:计算机开启电源后,会首先运行BIOS或UEFI固件程序,执行硬件自检,并确定启动设备。

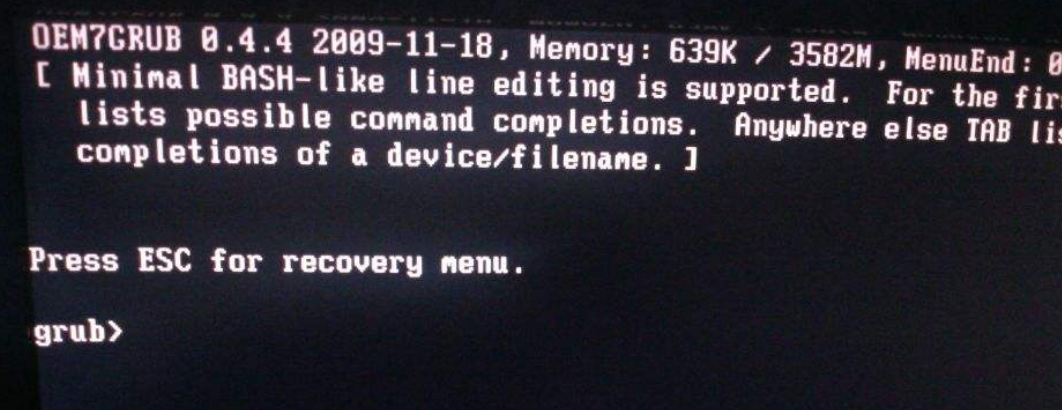

2. **引导加载器(Bootloader)阶段**:引导加载器(如GRUB)接管控制权,负责加载Linux内核镜像到内存中。

3. **内核初始化**:内核开始初始化系统硬件,包括CPU、内存、外设等,并设置内核运行环境。

4. **启动init进程**:内核完成系统初始化后,启动init进程(如systemd)来管理系统的进一步启动和运行级别。

5. **系统服务和用户界面**:最后,init进程启动系统服务,并展示登录界面,等待用户登录。

## 1.2 启动过程中的关键点

在理解启动流程的同时,有几个关键点值得我们注意:

- **内核解压**:在某些Linux发行版中,内核是以压缩的形式存放的,启动时内核自身会进行解压。

- **系统运行级别**:Linux通过运行级别来定义系统启动后的行为,不同的级别对应不同的服务和守护进程。

- **引导加载器配置**:引导加载器的配置文件通常位于`/boot`目录下,它决定系统如何加载内核和初始化ramdisk。

通过本章的概述,我们为接下来深入探讨Linux内核的启动流程、架构、核心组件、网络功能、模块和驱动开发以及内核的未来展望奠定了基础。接下来的章节中,我们将逐一深入分析每个部分的细节和工作原理。

# 2. 深入理解Linux内核架构

## 2.1 Linux内核的概念和结构

### 2.1.1 内核的主要功能和角色

Linux内核是操作系统的核心部分,负责管理系统资源、硬件与软件的交互,以及提供系统服务。其主要功能可以概括为以下几点:

- 进程管理:内核负责创建和销毁进程,调度进程执行,并管理进程间的通信。

- 内存管理:包括物理内存和虚拟内存的管理,内存的分配、回收以及页面置换算法。

- 文件系统:提供文件的创建、删除、读写和权限管理等操作,以及各种文件系统的支持。

- 设备驱动:为各种硬件设备提供驱动程序,使得硬件能够与内核进行交互。

- 网络功能:实现网络协议栈,处理网络数据包的发送和接收。

内核的角色定位使得其在操作系统中扮演着协调者的身份,它需要同时考虑系统的安全、稳定性和性能。

### 2.1.2 Linux内核的子系统概览

Linux内核由若干子系统组成,每个子系统都负责特定的功能。以下是一些主要的子系统:

- 进程调度子系统:负责管理CPU时间,决定哪个进程或线程获得执行机会。

- 内存管理子系统:实现虚拟内存管理、物理内存分配、页面置换等功能。

- 文件系统子系统:负责文件的存储、检索、共享、保护等操作。

- 网络子系统:包含网络协议栈,负责各种网络协议的处理和数据包的路由。

- 安全子系统:提供安全机制,如访问控制和安全策略。

这些子系统的协同工作,确保了Linux操作系统能够高效、稳定地运行。

## 2.2 初始化过程与系统启动

### 2.2.1 引导加载器(Bootloader)的作用和过程

引导加载器(Bootloader)是计算机启动过程的第一步,其主要作用是初始化硬件设备,并加载操作系统内核到内存中,然后将控制权交给内核。在Linux系统中,常见的Bootloader有GRUB和LILO。以下是Bootloader的基本工作流程:

1. 上电自检(POST):启动硬件设备的自我检测,确保计算机硬件正常。

2. BIOS查找活动分区:BIOS根据设定的启动顺序,查找启动设备并加载Bootloader。

3. Bootloader加载内核:Bootloader读取配置文件,确定要加载的内核映像文件。

4. 内核解压与初始设置:Bootloader将内核映像解压到内存中,并将控制权交给内核。

5. 内核初始化硬件和设备:内核接管计算机控制权后,进行硬件和设备的初始化。

6. 系统初始化和用户空间启动:内核启动init进程,完成系统服务的初始化,最后启动用户空间。

### 2.2.2 内核解压与初始设置

当Bootloader将内核映像加载到内存之后,内核的第一项任务是解压自身。内核映像通常以压缩形式存在,以减少占用的存储空间,并缩短加载时间。在解压之后,内核会进行一系列初始设置:

1. 初始化CPU和内存:检测并初始化CPU核心,设置内存管理单元。

2. 创建初始进程:内核创建一个初始进程,通常是PID为1的init进程。

3. 设置内核参数:解析内核启动参数,配置内核行为。

4. 挂载根文件系统:加载并挂载根文件系统,这是启动过程中非常关键的一步。

5. 启动设备驱动和系统服务:加载必要的设备驱动程序,并启动系统关键服务。

### 2.2.3 系统服务和运行级别的配置

系统服务和运行级别的配置是Linux初始化过程中的重要环节。这部分通常涉及到系统初始化脚本(如Systemd或SysVinit),它们根据设定的运行级别启动或停止特定的服务。下面是一些关键的步骤:

1. 配置运行级别:定义系统启动时应该进入的运行级别,常见的有0到6。

2. 启动服务:根据运行级别,启动需要的服务进程,如网络服务、系统日志、定时任务等。

3. 多用户模式:达到指定运行级别后,系统进入多用户模式,此时可以登录系统。

4. 图形界面:在图形运行级别中,启动图形用户界面(GUI)和桌面环境。

5. 系统监控和管理:系统启动后,持续监控服务状态,以便进行故障恢复和性能调优。

## 2.3 内核编译和模块管理

### 2.3.1 内核编译过程解析

内核编译是一个复杂的过程,涉及到配置内核选项、编译内核源代码和模块。以下是内核编译过程的关键步骤:

1. 获取源代码:下载适合系统架构的最新内核源代码。

2. 配置内核:使用`make menuconfig`、`make xconfig`或`make nconfig`命令配置内核选项。

3. 编译内核:执行`make`命令,编译内核源代码,产生内核映像和模块。

4. 安装内核:编译完成后,使用`make modules_install`和`make install`命令安装内核和模块。

5. 更新引导加载器:更新Bootloader的配置文件,以便在启动时可以选择新的内核。

内核编译可以进行高度定制,针对特定的硬件和需求,只包含必要的组件和驱动,从而提高系统的性能和安全性。

### 2.3.2 模块的加载与卸载机制

Linux内核模块是一种可加载的内核组件,它允许在运行时动态地添加或移除内核功能。模块管理涉及到模块的加载、卸载以及依赖管理。以下是模块管理的基本步骤:

1. 模块加载:使用`insmod`、`modprobe`等命令加载模块到内核空间。

2. 模块卸载:使用`rmmod`命令安全地卸载不再需要的模块。

3. 依赖管理:`modprobe`命令会自动处理模块之间的依赖关系。

4. 自动加载:通过`/etc/modules-load.d/`目录下的配置文件,在启动时自动加载指定的模块。

模块化设计是Linux内核的一大特点,它使得内核能够更加灵活,系统管理员可以根据需要添加特定功能,而无需重新编译整个内核。

### 2.3.3 模块依赖和版本控制

Linux内核模块的依赖关系和版本控制确保了模块的兼容性和稳定性。当加载模块时,内核会检查模块的依赖项是否满足,并处理版本兼容性问题。以下是模块依赖和版本控制的细节:

1. 依赖关系:模块可以声明它依赖的其他模块,内核在加载时会确保所有依赖都得到满足。

2. 版本控制:内核使用一种版本控制系统来确保加载的模块与当前运行的内核版本兼容。

3. 自动处理:`modprobe`命令能够自动解析模块间的依赖关系,并加载所有必需的模块。

4. 避免冲突:模块版本控制有助于避免不同版本的模块之间发生冲突。

5. 模块卸载策略:在卸载一个模块之前,内核会检查是否有其他模块依赖它,确保不会造成系统不稳定。

通过有效管理模块依赖和版本,Linux内核保证了系统运行的稳定性和安全性。

# 3. 核心内核组件分析

Linux内核是操作系统的核心,它负责管理系统资源,执行用户指令,并为系统中的软件提供服务。本章节将深入探讨Linux内核的三个主要组件:进程调度和管理、内存管理机制以及文件系统和I/O操作。理解这些组件的工作原理是优化系统性能和开发系统软件的关键。

## 进程调度和管理

### 进程状态和调度策略

Linux内核采用了一种多层次的调度机制,它支持多种不同的进程调度策略,其中包括轮转调度(Round Robin),完全公平调度(Completely Fair Scheduler, CFS),以及实时调度策略等。这些策略对应于不同的进程状态,如运行态、就绪态、睡眠态和停止态。

内核通过调度器来决定哪个进程获得CPU时间。调度器使用优先级和权重来决定进程的调度顺序。在CFS中,调度器为每个进程分配虚拟运行时间,并基于实际运行时间来调整虚拟时间,以保持调度的公平性。

```c

struct task_struct {

// ...

int state; // 进程状态,如 TASK_RUNNING, TASK_INTERRUPTIBLE 等

struct scheduler_entity se; // 调度实体,用于CFS调度策略

// ...

}

```

调度器的实现细节较为复杂,涉及到许多内核结构体和算法。在实际的系统中,要调整进程调度策略,通常需要修改内核配置或在运行时动态调整。

### 上下文切换和进程同步机制

上下文切换是指CPU从一个进程切换到另一个进程的过程。这个过程涉及到保存当前进程的状态,包括程序计数器、寄存器状态等,并加载下一个进程的状态。上下文切换是内核调度机制的一部分,是多任务操作系统必不可少的功能。

进程同步是另一个重要概念,它保证了进程间的数据一致性和通信。内核提供了诸如互斥锁(mutexes)、信号量(semaphores)和读写锁(rwlocks)等多种同步机制,以避免数据竞争和死锁。

```c

mutex_lock(&mutex); // 使用互斥锁进行进程间同步

// 临界区代码

mutex_unlock(&mutex);

```

Linux内核利用FIFO、优先级和锁定顺序等方式来预防死锁,确保系统稳定运行。

## 内存管理机制

### 虚拟内存和物理内存映射

Linux内核管理内存的方式基于虚拟内存系统,它通过内存管理单元(Memory Management Unit, MMU)将虚拟内存地址映射到物理内存地址。这一过程对于用户进程是透明的,操作系统负责维护虚拟地址空间到物理地址空间的映射关系。

页表是内核中管理虚拟到物理地址映射的核心数据结构。当进程访问虚拟地址时,MMU通过查询页表来找到相应的物理地址。

```c

struct page {

unsigned long flags;

atomic_t _count;

struct address_space *mapping;

// ...

}

```

### 内存分配和回收策略

Linux内核使用伙伴算法(Buddy System)来分配和回收内存页。这个算法通过将内存页分成多个块并保持这些块的合并状态,以优化内存分配。内存回收策略包括按需回收和周期性回收。

内核提供了如 kmalloc() 和 vmalloc() 等函数用于分配内核内存。它们在分配内存时有不同的用例和特性。例如,kmalloc() 用于小块内存分配,而 vmalloc() 则用于大块内存分配,通常分配的内存在物理上可能不连续。

```c

void *kmalloc(size_t size, int flags);

void *vmalloc(unsigned long size);

```

### 分页和交换机制(Swapping)

当物理内存不足时,Linux内核会启用交换机制(也称作分页),它将不再被活跃使用的内容从内存中移动到交换空间(通常是硬盘上的一块区域)。当需要这些信息时,再从交换空间中读回内存。

交换空间的使用影响着系统的性能。频繁的交换操作(也叫页面置换)会显著降低系统的响应速度,因为磁盘的读写速度远远低于物理内存。

Linux通过 /proc/sys/vm/swappiness 参数来控制内存交换的行为。其值介于0到100之间,值越大表示内核越倾向于使用交换空间。

## 文件系统和I/O操作

### 虚拟文件系统(VFS)的架构和作用

Linux虚拟文件系统(VFS)是一个抽象层,位于不同的文件系统之上。VFS定义了一组通用的文件系统操作接口,使得用户可以不必关心底层具体文件系统的实现细节,就能访问不同类型的文件系统。

VFS使得Linux支持多种文件系统,如ext3、xfs、btrfs等。VFS中的每个文件系统都至少需要实现四个主要的接口:inode操作、文件操作、目录操作和超级块操作。

### 块设备和字符设备驱动模型

在Linux内核中,设备驱动程序负责管理硬件设备。驱动程序主要分为块设备驱动和字符设备驱动。块设备处理随机访问的块数据,如硬盘驱动器;字符设备处理串行的字符数据,如键盘或串口。

驱动模型通过注册和注销机制来管理设备驱动。设备通过设备号来识别,分为主设备号(标识驱动类型)和次设备号(标识特定设备)。

```c

static struct block_device_operations my_block_device_ops = {

.owner = THIS_MODULE,

.open = my_open,

.release = my_release,

.ioctl = my_ioctl,

.request = my_request,

// ...

};

```

### 文件系统的注册和卸载

文件系统的注册和卸载是内核模块编程中的常见任务。模块开发者可以编写代码来在运行时加载或卸载文件系统模块。注册文件系统通常需要提供文件系统类型,并实现操作函数。

```c

struct file_system_type my_fs_type = {

.name = "myfs",

.mount = my_mount,

.kill_sb = my_kill_sb,

.fs_flags = FS_REQUIRES_DEV,

};

```

注册文件系统后,它就可以通过mount命令被挂载到目录树上。卸载文件系统则需要确保没有文件系统实例正在使用,这通常由内核的文件系统卸载代码来自动处理。

```bash

# 示例:挂载一个自定义的文件系统

sudo mount -t myfs /dev/sda1 /mnt/myfs_directory

# 示例:卸载文件系统

sudo umount /mnt/myfs_directory

```

在实现文件系统模块时,开发者需要理解文件系统的基本操作,并且要注意到异常情况下的文件系统一致性保护,如使用日志机制或写时复制技术。

通过以上章节的探讨,我们深入理解了Linux内核中核心组件的原理和实现。这些内容对于系统工程师而言是至关重要的知识,它为我们提供了一个强有力的工具箱,用于优化和定制Linux系统以适应各种应用场景。在本章节中,我们从进程调度到内存管理,再到文件系统和I/O操作,逐层深入地讨论了Linux内核的运作机制,每一步都强调了如何将这些知识应用到实际工作中去,从而更好地理解Linux操作系统的强大之处。

# 4. Linux内核的网络功能

## 4.1 网络栈的架构和协议

### 4.1.1 协议栈概述和网络层处理

在第四章节中,我们将深入探讨Linux内核的网络功能,从网络栈的基础架构开始,再到网络层的具体实现以及相关协议的讨论。

Linux网络栈是网络协议的实现,它将复杂的网络通信抽象为一系列易于理解的API接口。一个完整的网络栈通常包括物理层、数据链路层、网络层、传输层以及应用层。Linux内核中的网络栈是基于TCP/IP协议族进行设计的,这是互联网上使用最广泛的协议家族。网络栈的架构设计决定了数据包如何从源端传输到目的地。

网络层主要负责处理逻辑地址(如IP地址)和路由选择,确保数据包能够找到到达目的地的路径。Linux内核中的网络层处理涉及到IP协议的实现,即Internet Protocol,负责网络层数据包的分片与重组,以及路由表的维护。

在Linux内核中,网络层的代码集中在`net/ipv4/`目录下(对于IPv4协议)。主要涉及到数据包的路由判断(`ip_route_input_noref()`)、转发(`ip_forward()`)、以及IP数据包的接收(`ip_local_deliver()`)和发送(`ip_queue_xmit()`)等操作。

代码块演示了网络层路由判断的基本流程:

```c

struct rtable *ip_route_input_noref(struct sk_buff *skb, __be32 daddr, __be32 saddr,

__u32 care_of_address, int oif)

{

const struct net_device *dev = skb->dev;

struct rtable *rt;

int err;

rt = __ip_route_input(skb, daddr, saddr, care_of_address, oif, dev);

if (IS_ERR(rt))

return rt;

if (unlikely(skb->protocol != htons(ETH_P_IP))) {

if (skb->protocol == htons(ETH_P_ARP) && net_eq(dev_net(dev), &init_net))

arp_send(ARPOP_REQUEST, ETH_P_ARP, daddr, dev, saddr, care_of_address);

goto drop;

}

err = ip_check国家安全(net, rt, (struct dst_entry *)rt, skb);

if (err)

goto drop;

return rt;

drop:

kfree_skb(skb);

return ERR_PTR(err);

}

```

### 4.1.2 传输层协议TCP和UDP

传输层位于网络栈的上层,主要提供端到端的数据传输服务。传输层的两个主要协议是传输控制协议(TCP)和用户数据报协议(UDP),它们有着不同的特点和应用场景。

TCP是面向连接的协议,它提供了可靠的、有序的和错误检测的字节流服务。在Linux内核中,TCP协议的实现代码位于`net/ipv4/tcp_ipv4.c`和`net/ipv6/tcp_ipv6.c`(对应于IPv4和IPv6)。TCP协议的关键功能包括拥塞控制、流量控制、以及连接管理。

UDP是无连接的协议,它为应用层提供了一个简单的数据报服务,适用于对传输速度要求高而对数据完整性要求相对较低的应用场景。在Linux内核中,UDP协议的处理代码位于`net/ipv4/udp.c`和`net/ipv6/udp.c`。由于UDP不提供连接管理,其处理通常比TCP简单。

代码块演示了TCP连接建立的三次握手过程:

```c

void tcp_v4_do_rcv(struct sock *sk, struct sk_buff *skb)

{

struct inet_connection_sock *icsk = inet_csk(sk);

struct tcp_sock *tp = tcp_sk(sk);

struct sk_buff *opt_skb = NULL;

struct iphdr *iph;

struct tcphdr *th;

bool refcounted;

if (!sk->sk_rcvlowat) {

sk->sk_rcvlowat = 1;

sk->sk_rcvtimeo = MAX_SCHEDULE_TIMEOUT;

}

if (skb->protocol == htons(ETH_P_IP)) {

iph = ip_hdr(skb);

th = (struct tcphdr *) (((u8 *) iph) + iph->ihl*4);

} else {

/* It should be IPv6, but we fall back to IPv4 in case

some device is broken and sends us v6 packets */

iph = ip6_hdr(skb);

th = (struct tcphdr *) (((u8 *) iph) + sizeof(struct ipv6hdr));

}

if (th->doff < (sizeof(struct tcphdr) >> 2)) {

TCPDEBUG("%s: Junk TCP segment from %pI4.\n", __func__,

&iph->saddr);

goto discard;

}

/* 根据状态进行不同的处理 */

switch (icsk->icsk_state) {

case TCP_LISTEN:

/* 处理新的连接请求 */

tcp_v4_do_rcv_connect(sk, skb);

goto discard;

...

}

}

```

### 4.2 网络设备驱动和接口

#### 4.2.1 网络接口卡(NIC)驱动模型

网络接口卡(NIC)是网络数据传输的关键硬件组件。Linux内核使用网络设备驱动模型来支持各种不同的网络硬件。每个NIC驱动模块负责特定网络硬件的初始化、数据包发送和接收等任务。

NIC驱动模型的基石是`net_device`结构体,它代表了网络设备的内核视图。当网络设备被识别和初始化时,内核会在内存中创建一个`net_device`实例,并将其注册到内核的网络子系统中。

NIC驱动通常包含以下部分:

- 注册和初始化网络设备。

- 数据包的发送(`ndo_start_xmit()`函数)。

- 数据包的接收(中断处理函数和`ndo_poll_controller()`)。

- 网络设备的设置(`ndo_set_mac_address()`, `ndo_change_mtu()` 等)。

代码块展示了NIC驱动初始化函数的一个例子:

```c

static int __init myNicDriver_init(void)

{

int result;

struct net_device *dev;

dev = alloc_etherdev(sizeof(struct myNicPrivStruct));

if (!dev)

return -ENOMEM;

/* 注册操作函数 */

dev->netdev_ops = &myNicDriver_ops;

SET_MODULE_OWNER(dev);

/* 初始化私有数据结构 */

memset(dev->priv, 0, sizeof(struct myNicPrivStruct));

init_timer(&myNicTimer);

/* 注册网络设备 */

result = register_netdev(dev);

if (result != 0) {

free_netdev(dev);

return result;

}

/* 其他初始化代码 */

return 0;

}

```

#### 4.2.2 网络数据包的发送和接收流程

网络数据包的发送和接收是内核网络子系统的核心功能之一。发送过程涉及将内核缓冲区的数据包传输到物理介质上,而接收过程则相反,它需要从物理介质获取数据包,并将其传递给内核。

发送流程大致如下:

1. 用户空间应用程序通过系统调用,如`write()`,将数据包传递给内核网络子系统。

2. 内核的传输层协议(如TCP或UDP)负责数据的封装、分段以及确保数据传输的可靠性。

3. 数据包被传递给下一层,网络层(IP层),在这里被添加了必要的网络层头部信息。

4. 经过网络层的处理后,数据包最终到达数据链路层,并被传递给网络设备驱动。

5. 网络设备驱动根据数据包的目的地,进一步处理数据包,例如计算校验和、添加帧头等,并最终通过NIC发送数据包到网络中。

接收流程可以概述为:

1. 数据包到达网络接口卡(NIC)。

2. NIC触发一个中断,并调用相应的中断处理函数。

3. 中断处理函数通常会进行一些初步处理,并将数据包放入一个由NIC驱动管理的队列中。

4. 通过内核的轮询或软中断机制,内核会从队列中取出数据包,并开始对其进行处理。

5. 数据包被上送给协议栈,经过网络层、传输层,最终由相应的协议模块处理。

6. 传输层将数据包传递给用户空间的等待读取的应用程序。

### 4.3 网络子系统优化和安全

#### 4.3.1 性能调优技巧和网络参数配置

Linux网络子系统的性能调优涉及很多方面,包括配置合适的网络参数、优化内存使用、以及调整内核调度策略等。常见的性能优化技巧包括:

- 调整TCP和UDP缓冲区大小。

- 优化TCP窗口大小和拥塞控制参数。

- 使用多队列NIC和CPU亲和性。

- 应用套接字缓冲区优化(SO_RCVBUF和SO_SNDBUF)。

代码块展示了一种网络参数的调整方法:

```bash

# 通过sysctl命令调整TCP最大缓冲区大小

$ sysctl -w net.core.rmem_max=***

# 通过sysctl命令调整TCP最大窗口大小

$ sysctl -w net.ipv4.tcp_rmem='***'

```

#### 4.3.2 安全机制和防火墙规则设置

Linux内核提供了强大的安全机制来保护系统免受网络攻击。一些重要的安全特性包括:

- 防火墙(netfilter/iptables):基于规则的数据包过滤。

- IPsec:提供网络层上的加密和身份验证。

- TCP SYN cookies:防御SYN洪水攻击。

防火墙规则的设置是通过iptables工具来完成的。Iptables允许系统管理员定义规则,确定数据包是否可以进出网络接口。

代码块演示了使用iptables来配置一个简单的防火墙规则:

```bash

# 允许所有经过状态检查的连接

$ iptables -A INPUT -m conntrack --ctstate ESTABLISHED,RELATED -j ACCEPT

# 丢弃所有SYN包

$ iptables -A INPUT -p tcp --syn -j DROP

# 允许特定端口的入站连接

$ iptables -A INPUT -p tcp --dport 80 -j ACCEPT

```

通过合理配置网络参数和防火墙规则,能够有效提升Linux网络子系统的性能和安全性。

## 4.1 网络栈的架构和协议

### 4.1.1 协议栈概述和网络层处理

Linux网络栈是一个实现网络协议的复杂系统,它处理网络通信的各个方面,从硬件接口到应用程序的API接口。网络栈的架构使得网络通信变得更加高效和可靠。

网络栈的层级结构如下:

- 物理层:负责数据的物理传输。

- 数据链路层:负责在物理链路上传输数据帧,并进行错误检测。

- 网络层:负责将数据包从源端传输到目的地,包括IP协议的实现。

- 传输层:负责端到端的数据传输,包括TCP和UDP协议。

- 应用层:负责处理特定应用程序的协议,如HTTP、FTP等。

在网络层,数据包的处理分为两个主要部分:路由和转发。路由决定数据包的目的地,而转发则负责将数据包交给正确的网络接口。

代码块解释了网络层如何处理IP数据包的转发:

```c

int ip_route_input(struct sk_buff *skb)

{

struct net *net = dev_net(skb->dev);

struct rtable *rt;

int result;

rt = __ip_route_input(skb);

if (IS_ERR(rt))

return PTR_ERR(rt);

result = ip_check国家安全(net, rt, &rt->dst, skb);

if (result)

goto drop;

skb_dst_drop(skb);

skb_dst_set(skb, &rt->dst);

return 0;

drop:

kfree_skb(skb);

return result;

}

```

### 4.1.2 传输层协议TCP和UDP

传输层协议是网络栈中非常关键的组件,它们负责在不同的网络节点间提供可靠的通信服务。

TCP协议是面向连接的,它为应用层提供了一系列的特性,包括:

- 可靠传输:TCP通过确认应答和重传机制来确保数据的可靠传输。

- 流控制:通过窗口机制来控制发送方的数据发送速率,防止接收方处理不过来。

- 拥塞控制:TCP根据网络的拥塞状况来调节数据的发送速率。

代码块展示了TCP连接建立的流程:

```c

struct sock *tcp_v4_create_openreq_child(struct sock *sk, struct open_request *req)

{

struct sock *newsk = tcp_create_openreq_child(sk, req);

if (!newsk)

return NULL;

tcp_set_state(newsk, TCP_CLOSE);

tcp_init_metrics(newsk);

tcp_set_congestion_control(newsk);

tcp_init_pacing_rate(newsk);

tcp_init_buffer_tree(newsk);

tcp_init_buffer_space(newsk);

return newsk;

}

```

UDP协议是无连接的,它的传输速度通常比TCP快,因为没有连接建立和维护的开销。UDP适用于那些对延迟敏感的应用,如音频或视频流。

代码块说明了如何处理UDP数据包的接收:

```c

int udp_rcv(struct sk_buff *skb)

{

const struct udphdr *uh;

struct sock *sk;

struct udphdr _uh;

struct flowi4 fl4;

int ihl, offset, len;

uh = skb_header_pointer(skb, skb_transport_offset(skb), sizeof(_uh), &_uh);

if (unlikely(!uh))

goto drop;

len = skb->len - skb_transport_offset(skb);

if (len < 0)

goto drop;

ihl = skb_network_header_len(skb);

offset = skb_transport_offset(skb) + sizeof(_uh);

if (unlikely(ip_fast_csum((u8 *)uh, ihl)))

goto csum_err;

if (len < offset)

goto drop;

len -= offset;

/* 处理多播地址 */

if (ipv4_is_multicast(uh->dest))

ip mr_input(skb);

/* 处理广播地址 */

if (ipv4_is_broadcast(uh->dest, &skb->dst))

goto drop;

/* 处理目的端口为0的情况 */

if (!uh->dest)

goto drop;

/* 通过目的端口查找socket */

sk = __udp_v4_lookup(dev_net(skb->dev), uh->dest, uh->source,

&fl4, 0);

if (sk != NULL) {

if (unlikely(skb->pkt_type == PACKET_OTHERHOST))

goto checksum_err;

return udp_queue_rcv_skb(sk, skb);

}

if (net_ratelimit())

printk(KERN_INFO "UDP: Dropping bad packet.\n");

drop:

kfree_skb(skb);

return 0;

csum_err:

checksum_err:

skb->ip_summed = CHECKSUM_NONE;

UDP_SKB CB(skb)->ip_summed = CHECKSUM_NONE;

UDP_SKB CB(skb)->csum = 0;

goto drop;

}

```

这些代码段展示了Linux内核中TCP和UDP协议栈的内部实现,以及它们如何处理发送和接收的数据包。了解这些细节可以帮助开发者更好地进行网络编程和故障排查。

# 5. 内核模块和驱动开发

## 5.1 内核模块编程基础

### 5.1.1 模块编程规范和工具链介绍

内核模块是Linux内核的动态可加载组件,它们可以在系统运行时被插入或移除,而无需重新编译整个内核。模块编程规范定义了模块的结构和加载机制,遵循这一规范编写的模块能够保证与内核的兼容性。

编写内核模块需要特定的工具链,包括编译器和头文件。在多数Linux发行版中,`gcc`编译器用于编译模块,`make`工具用于自动化编译过程。模块的源代码文件通常以`.c`为后缀,并且需要包含内核头文件,它们位于`/usr/include/linux`目录下。

内核模块的一个重要特点是可以使用`insmod`和`rmmod`命令手动加载和卸载,而无需重启系统。此外,模块开发过程中,通常需要使用`modprobe`来自动处理模块间的依赖关系。

### 5.1.2 模块加载、卸载与依赖管理

模块的加载和卸载通过一系列内核函数实现,如`module_init()`和`module_exit()`宏,它们分别用于指定模块初始化时调用的函数和模块卸载时调用的函数。

依赖管理是内核模块开发中的一个重要方面。如果一个模块依赖于另一个模块,那么在加载该模块时,系统会自动加载所有未加载的依赖模块。依赖关系在模块的`MODULE_LICENSE`宏中声明。

在编写内核模块时,需要考虑模块加载失败的情况。因此,模块初始化函数应该包含错误处理逻辑,确保在无法正常初始化模块时能够安全地报告错误并退出。

### 代码块和逻辑分析

以下是一个简单的内核模块加载和卸载函数的示例:

```c

#include <linux/module.h> // 包含模块加载卸载宏

#include <linux/kernel.h> // 包含KERN_INFO

MODULE_LICENSE("GPL"); // 指定许可证

MODULE_AUTHOR("Your Name"); // 指定作者

static int __init my_module_init(void) {

printk(KERN_INFO "Loading my_module...\n");

// 初始化模块的代码放在这里

return 0; // 如果初始化成功返回0

}

static void __exit my_module_exit(void) {

printk(KERN_INFO "Unloading my_module...\n");

// 清理模块的代码放在这里

}

module_init(my_module_init); // 指定初始化函数

module_exit(my_module_exit); // 指定卸载函数

```

在这段代码中,`my_module_init`函数是模块加载时调用的初始化函数,它使用`printk`函数输出加载信息到内核日志中。`my_module_exit`函数是模块卸载时调用的清理函数,同样使用`printk`输出卸载信息。`module_init`和`module_exit`宏分别用于声明初始化和清理函数。使用`__init`和`__exit`宏可以进一步指示内核优化这些函数的使用情况。

## 5.2 驱动开发实践

### 5.2.1 字符设备驱动开发流程

字符设备驱动是Linux内核中一种较为常见的驱动类型,主要用于管理无缓冲的顺序数据流设备。字符设备驱动开发通常包括以下几个步骤:

1. 注册设备号:使用`register_chrdev`或`alloc_chrdev_region`函数注册字符设备号。

2. 创建设备类和设备:使用`class_create`和`device_create`函数在用户空间创建设备接口。

3. 实现文件操作函数集:实现`open`、`release`、`read`、`write`、`ioctl`等函数。

4. 初始化和退出模块:使用前面提到的宏`module_init`和`module_exit`。

### 5.2.2 块设备驱动的关键实现

块设备驱动通常处理以块为单位的数据,如硬盘驱动器和SSD。开发块设备驱动时,需要实现以下几个关键点:

1. 请求队列的管理:管理I/O请求,并使用适当的调度算法。

2. 数据传输:实现数据的读写操作,通常通过缓冲区操作完成。

3. 错误处理:检测和处理I/O错误。

4. 块设备注册:使用`register_blkdev`注册块设备,并实现必要的请求处理函数。

### 5.2.3 实用驱动开发案例分析

考虑开发一个简单的字符设备驱动,用于模拟LED灯的开和关。该设备驱动将包含一个设备文件,通过写入特定命令来控制LED灯的状态。

首先,定义设备号并注册字符设备:

```c

#define MY_LED_MAJOR 240 // 设备号为240

static struct cdev my_led_cdev; // 字符设备结构体

static int __init my_led_init(void) {

int ret;

dev_t dev = MKDEV(MY_LED_MAJOR, 0); // 创建设备号

// 注册字符设备

ret = register_chrdev_region(dev, 1, "my_led");

if (ret < 0) {

return ret;

}

cdev_init(&my_led_cdev, &fops); // 初始化字符设备

ret = cdev_add(&my_led_cdev, dev, 1);

if (ret < 0) {

unregister_chrdev_region(dev, 1);

return ret;

}

// 创建设备类和设备

my_led_class = class_create(THIS_MODULE, "my_led_class");

my_led_device = device_create(my_led_class, NULL, dev, NULL, "my_led");

return 0;

}

static void __exit my_led_exit(void) {

dev_t dev = MKDEV(MY_LED_MAJOR, 0); // 获取设备号

device_destroy(my_led_class, dev);

class_destroy(my_led_class);

cdev_del(&my_led_cdev); // 删除字符设备

unregister_chrdev_region(dev, 1); // 注销字符设备号

}

```

在这个例子中,我们首先定义了设备号,然后在初始化函数中注册了字符设备,并创建了设备类和设备。在退出函数中,我们删除了字符设备并清理了注册的设备号。这个简单驱动的完整实现还需要定义和实现`fops`结构体中声明的文件操作函数集,比如`open`、`release`、`write`等。

## 5.3 驱动调试和性能优化

### 5.3.1 内核调试工具和技巧

内核调试可以使用多种工具和技巧,最常用的调试工具是`printk`,它允许开发者将调试信息打印到内核日志。另一个有用的工具是`kgdb`,它允许开发者在内核中设置断点,并以类似于GDB的方式调试。

内核调试时,可以使用`dmesg`命令查看由`printk`生成的调试信息。如果使用`kgdb`,则可以使用GDB的界面与内核进行交互式调试。

### 5.3.2 驱动性能优化策略和案例

驱动性能优化往往依赖于具体的应用场景和硬件特性。一些通用的策略包括减少上下文切换、优化内存使用、减少中断开销等。

优化案例:在块设备驱动中,可以通过合并多个相邻的I/O请求来提高性能。这种技术称为I/O请求合并(I/O merging),通过它可以减少对磁盘的操作次数,从而提高整体性能。

### 代码块和逻辑分析

假设我们有一个块设备驱动,我们可以通过以下方式实现请求合并:

```c

static void my_merge_requests(struct request_queue *q, struct request *rq, struct bio *bio)

{

// 实现请求合并逻辑

// 这里的伪代码表示将bio请求合并到rq请求中

// ...

list_add_tail(&bio->bi_list, &rq->biotail->bi_list);

rq->biotail = bio;

bio->bi_next = NULL;

// 更新请求大小等属性

// ...

}

static int my_request_fn(struct request_queue *q)

{

struct request *rq;

struct bio *bio;

unsigned int segs;

while ((rq = elv_next_request(q)) != NULL) {

bio = rq->bio;

segs = bio_segs(bio);

// 检查是否有新的请求可以合并到rq

while ((bio = bio->bi_next) != NULL && // ... 条件判断

can_merge_request(rq, bio) && segs + bio_segs(bio) <= MAX_SEGMENTS) {

my_merge_requests(q, rq, bio);

segs += bio_segs(bio);

}

// 处理合并后的请求

// ...

}

return 0;

}

```

在这个代码块中,我们展示了请求合并的基本逻辑。函数`my_merge_requests`用于将一个`bio`结构合并到现有的请求`rq`中。函数`my_request_fn`是处理块设备请求的函数,它会遍历请求队列,并对可以合并的请求执行合并操作。注意,这里是一个简化的例子,实际的合并逻辑可能更为复杂,需要考虑硬件的I/O调度策略和队列特性。

在优化性能时,要特别注意避免产生竞态条件和死锁,确保驱动代码的稳定性和可靠性。

# 6. Linux内核的未来和社区

Linux内核作为开源操作系统的核心,一直是技术进步和创新的孵化器。随着技术的发展,内核不仅需要适应新的硬件平台和架构,还要不断引入新的安全机制和稳定性考量。在此过程中,社区的力量不可或缺,它推动了Linux内核的发展和维护。本章节将探讨Linux内核版本管理、社区贡献以及内核安全性、稳定性的发展趋势。

## 6.1 内核的版本管理和特性追踪

### 6.1.1 内核版本的发展路径和命名规则

Linux内核版本的管理遵循严格的规则,以确保版本的连贯性和可预测性。版本号通常由三部分组成:主版本号、次版本号和修订号(例如,5.12.10)。主版本号表示重大更改,偶数版本为稳定版,奇数版本为开发版。次版本号表示新增功能,修订号表示错误修复。

- **主版本号**:表示重要的、不向后兼容的更改。

- **次版本号**:通常添加新的特性,但保持向后兼容。

- **修订号**:用于错误修复和安全更新。

版本号的命名规则有助于开发者和用户了解每个版本的主要特点和兼容性。

### 6.1.2 内核特性介绍和应用场景

每个新版本的Linux内核都会增加新特性和改进。这些特性可能包括对新硬件的支持、性能优化、安全性改进以及对现有功能的增强。例如,Linux 5.13版本引入了对NVMe Over Fabrics的支持,Linux 5.14版本则包含了对英特尔的DG1显卡的支持。

了解这些新特性对于开发者和系统管理员来说至关重要,因为它们可能会带来巨大的性能提升或新功能,从而使他们能够优化系统或开发新应用程序。

## 6.2 Linux内核社区和贡献指南

### 6.2.1 社区结构和贡献流程

Linux内核社区由全球成千上万的开发者组成,他们通过邮件列表、IRC频道和内核峰会等渠道协作。社区结构包括维护者、副维护者和一般贡献者。社区的工作流程如下:

- **邮件列表**:这是社区讨论的主要平台。

- **补丁提交**:贡献者通过邮件列表发送补丁。

- **审查和合并**:维护者负责审查代码并决定是否合并。

贡献流程鼓励开放讨论、代码审查和持续改进。

### 6.2.2 贡献者指南和最佳实践

贡献Linux内核需要遵循一定的指南和最佳实践。以下是一些基本的步骤:

1. 注册邮件列表账号并熟悉邮件列表使用。

2. 确定要贡献的代码部分或修复的bug。

3. 遵循内核编码风格编写代码。

4. 使用`git`版本控制系统准备和提交补丁。

5. 编写清晰的补丁描述,并通过邮件列表发送。

遵守这些指南有助于确保贡献被社区接受,并加速内核的发展。

## 6.3 内核安全性、稳定性和未来展望

### 6.3.1 安全更新和补丁管理

Linux内核的安全更新是社区的一个重要关注点。安全补丁通常通过快速跟踪机制来处理,以确保尽快修复已知漏洞。补丁管理过程包括:

- **漏洞评估**:确定漏洞的严重性和影响。

- **快速跟踪**:优先处理重要的安全补丁。

- **测试和部署**:确保补丁在各种系统上稳定运行。

这些措施有助于保护Linux系统免受攻击。

### 6.3.2 内核稳定性和长期支持(LTS)计划

稳定性和长期支持(LTS)是Linux内核社区提供的特别服务,它为那些需要长期稳定环境的用户提供了保障。LTS内核版本通常由社区的特定团队维护,为用户提供长期的安全更新和bug修复。

### 6.3.3 内核发展趋势和研究方向

未来,Linux内核将继续在其核心价值基础上发展,包括性能优化、对新硬件的支持以及安全和稳定性的持续提升。随着计算环境的变化,例如云计算、边缘计算和物联网的发展,内核将需要适应新的应用场景,并可能引入新的架构和特性。

Linux内核社区也在研究如何更好地支持非传统硬件和操作系统安全模型。此外,改进开发和测试流程也是社区持续关注的重点,这将有助于加速内核发展并确保质量。

0

0