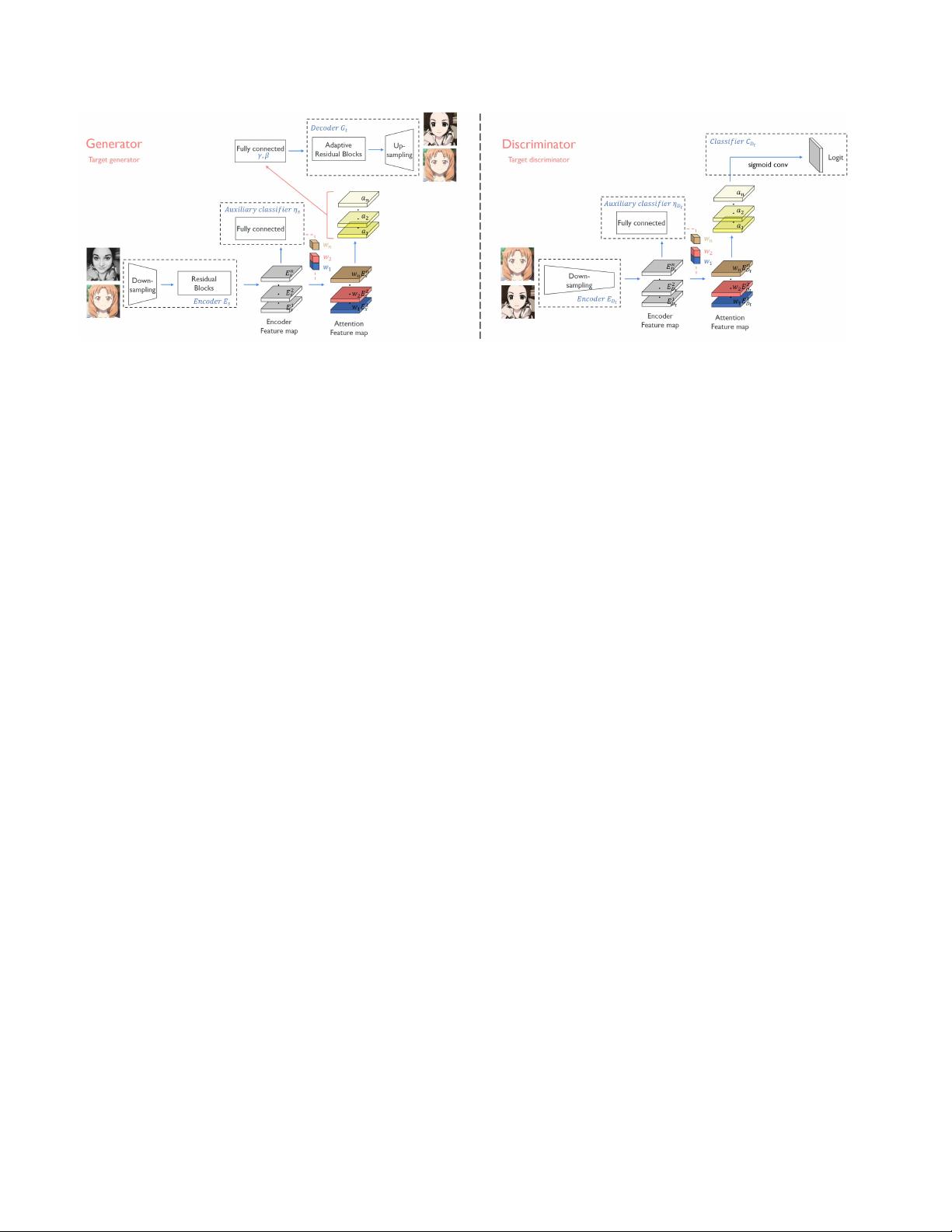

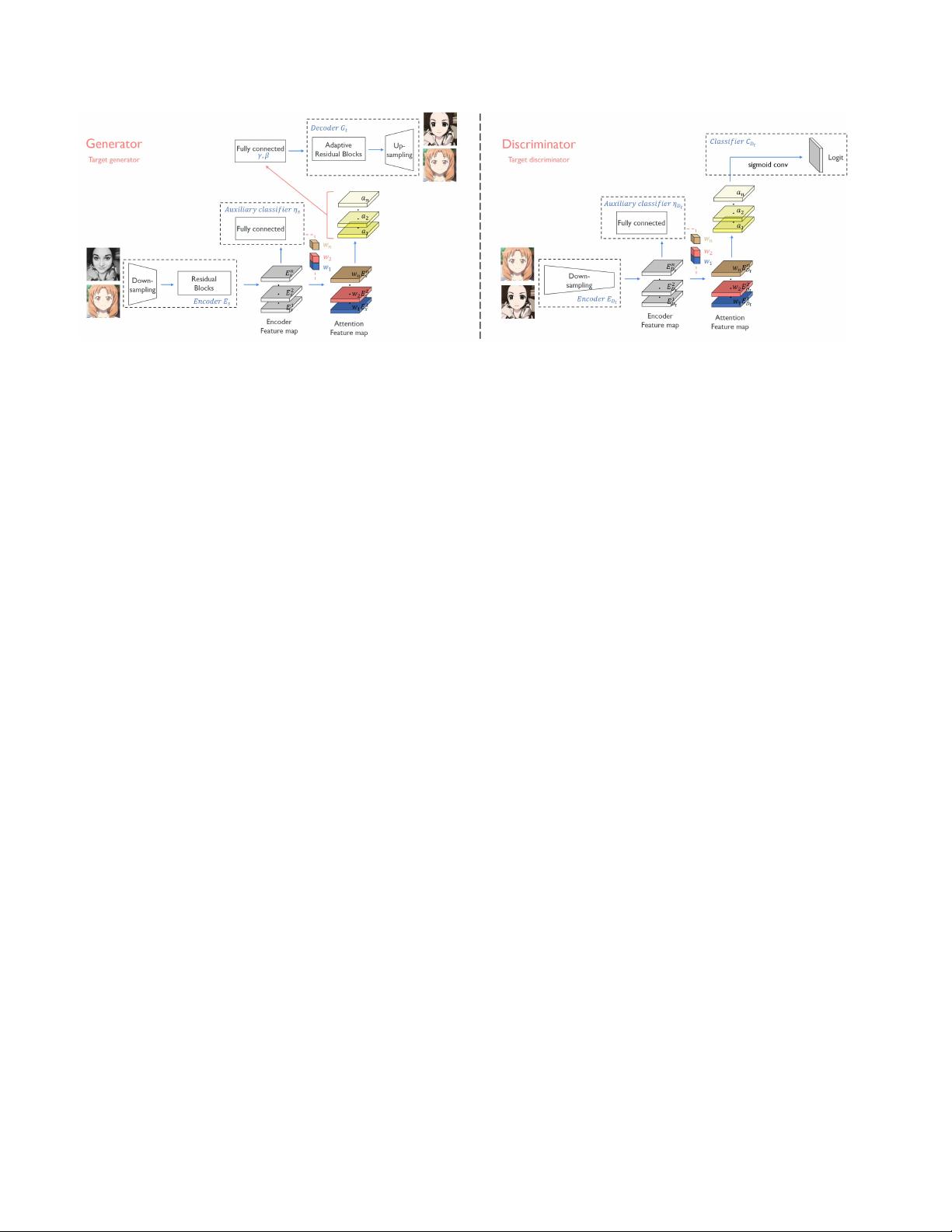

Figure 1. The model architecture of U-GAT-IT. The detailed notations are described in Section 3.1.

Cycle loss To alleviate the mode collapse problem, we

apply a cycle consistency constraint to the generator. Given

an image x ∈ X

s

, after the sequential translations of x from

X

s

to X

t

and from X

t

to X

s

, the image should be success-

fully translated back to the original domain:

L

s→t

cycle

= E

x∼X

s

[|x − G

t→s

(G

s→t

(x)))|

1

] (5)

Identity loss To ensure that the color distributions of in-

put image and output image are similar, we apply an iden-

tity consistency constraint to the generator. Given an image

x ∈ X

t

, after the translation of x using G

s→t

, the image

should not change.

L

s→t

identity

= E

x∼X

t

[|x − G

s→t

(x)|

1

] (6)

CAM loss By exploiting the information from the auxil-

iary classifiers η

s

and η

D

t

, given an image x ∈ {X

s

, X

t

}.

G

s→t

and D

t

get to know where they need to improve or

what makes the most difference between two domains in

the current state:

L

s→t

cam

= −(E

x∼X

s

[log(η

s

(x))]

+ E

x∼X

t

[log(1 − η

s

(x))],

(7)

L

D

t

cam

= E

x∼X

t

[(η

D

t

(x))

2

]

+ E

x∼X

s

[log(1 − η

D

t

(G

s→t

(x)))

2

]

(8)

Full objective Finally, we jointly train the encoders, de-

coders, discriminators, and auxiliary classifiers to optimize

the final objective:

min

G

s→t

,G

t→s

,η

s

,η

t

max

D

s

,D

t

,η

D

s

,η

D

t

λ

1

L

gan

+

λ

2

L

cycle

+ λ

3

L

identity

+ λ

4

L

cam

,

(9)

where λ

1

= 1, λ

2

= 10, λ

3

= 10, λ

4

= 1000. Here,

L

gan

= L

s→t

gan

+ L

t→s

gan

and the other losses are defined in

the similar way (L

cycle

, L

identity

, and L

cam

)

4. Implementation

4.1. Network architecture

The encoder of the generator is composed of two convo-

lution layers with the stride size of two for down-sampling

and four residual blocks. The decoder of the generator con-

sists of four residual blocks and two up-sampling convolu-

tion layers with the stride size of one. Note that we use the

instance normalization for the encoder and AdaLIN for the

decoder, respectively. In general, LN does not perform bet-

ter than batch normalization in classification problems [37].

Since the auxiliary classifier is connected from the encoder

in the generator, to increase the accuracy of the auxiliary

classifier we use the instance normalization(batch normal-

ization with a mini-batch size of 1) instead of the AdaLIN.

Spectral normalization [30] is used for the discriminator.

We employ two different scales of PatchGAN [15] for the

discriminator network, which classifies whether local (70 x

70) and global (286 x 286) image patches are real or fake.

For the activation function, we use ReLU in the generator

and leaky-ReLU with a slope of 0.2 in the discriminator.

4.2. Training

All models are trained using Adam [19] with β

1

=0.5 and

β

2

=0.999. For data augmentation, we flipped the images

horizontally with a probability of 0.5, resized them to 286 x

286, and random cropped them to 256 x 256. The batch size

is set to one for all experiments. We train all models with

a fixed learning rate of 0.0001 until 500,000 iterations and

linearly decayed up to 1,000,000 iterations. We also use a

weight decay at rate of 0.0001. The weights are initialized

from a zero-centered normal distribution with a standard de-

viation of 0.02.

4