Dist-GAN:距离约束优化生成对抗网络

183 浏览量

更新于2024-06-20

收藏 1.59MB PDF 举报

"Dist-GAN: 一种基于距离约束的改进生成对抗网络"

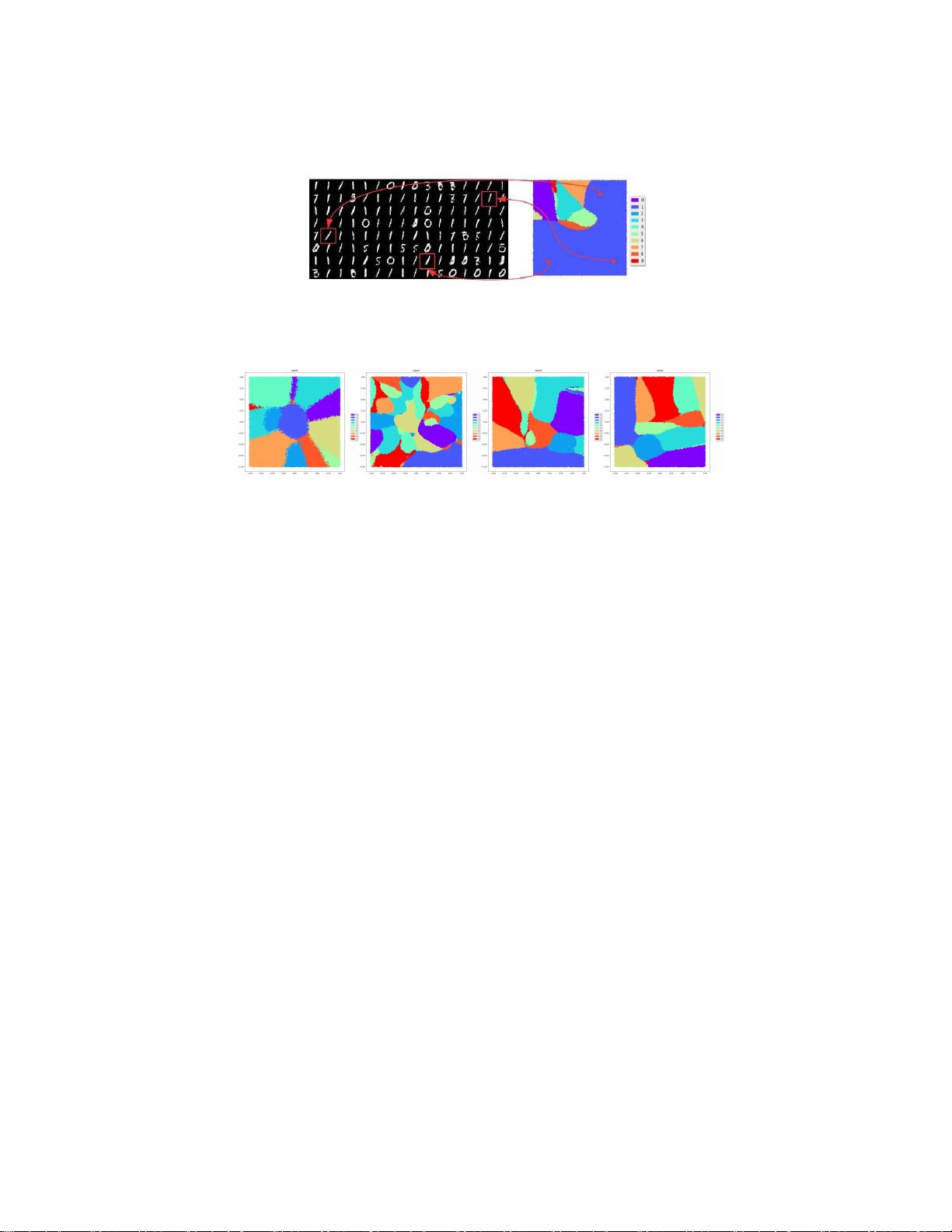

本文介绍了一种名为Dist-GAN的新型生成对抗网络(GAN)框架,该框架通过引入有效的训练算法和距离约束来解决传统GAN在训练过程中常见的问题,如模式崩溃和梯度消失。Dist-GAN的核心在于将生成器(Generator)与自动编码器(Autoencoder, AE)相结合,并引入两种新的距离约束,以优化生成器的性能。

1. 自动编码器耦合

Dist-GAN将生成器与自动编码器耦合,使得鉴别器(Discriminator)不仅考虑真实数据,还考虑来自AE的重建样本。这样,AE的收敛与鉴别器的收敛相互影响,有助于缓解鉴别器过快收敛导致的梯度消失问题,从而稳定整个GAN的训练过程。

2. 潜在数据距离约束

为了防止生成器出现模式崩溃(mode collapse),即生成器倾向于只生成少数几种模式,Dist-GAN提出潜在数据距离约束。这个约束确保生成的潜在样本与对应的真实数据样本之间有合理的距离,增强了生成器的多样性,使其能够生成更多元的样本。

3. 鉴别器分数距离约束

此外,论文提出了鉴别器分数距离约束,目的是通过调整生成样本的鉴别器分数分布,使其更接近于真实样本的分布。这个约束有助于引导生成器生成更加逼真的样本,提高生成质量。

4. 实验与结果

Dist-GAN在多个基准数据集上进行了实验,包括Synthetic、MNIST、MNIST-1K、CelebA、CIFAR-10和STL-10,结果显示其性能优于现有的先进方法,表明提出的距离约束有效提升了GAN的训练效果。

5. 关键技术

Dist-GAN的关键技术包括对生成器的约束优化,以及通过自动编码器与距离约束来改进生成对抗网络的训练稳定性。这些技术为解决GAN训练中的挑战提供了新的思路。

Dist-GAN通过创新的训练策略和距离约束,提高了生成对抗网络的性能,特别是在防止模式崩溃和优化生成样本质量方面。这一研究对于理解如何更好地训练GAN以及提升生成模型的性能具有重要意义。

2021-04-14 上传

2021-05-18 上传

2021-05-21 上传

2021-05-23 上传

2021-02-03 上传

2021-07-02 上传

2021-03-28 上传

cpongm

- 粉丝: 5

- 资源: 2万+

最新资源

- IMDB_sent_analysis

- fyilmaz2312-fyilmaz2312-Ajax-and-AspNetMvc-Page-in-Without-Refreshing-The-Product-Editing-Adding

- 带有实时预览和样式游乐场HTML编辑器

- 【WordPress主题】2022年最新版完整功能demo+插件v4.5.0.zip

- KISS Player:一个简单轻巧的音乐播放器-开源

- TALLER_REFACTORING

- SteamPrivEsc:从最近公开的Steam Client Zero Day升级到NT AUTHORITY \ SYSTEM的简单工具集合

- python-google-automlvision

- Seed_density_workflow

- 华为简历-求职简历-word-文件-简历模版免费分享-应届生-高颜值简历模版-个人简历模版-简约大气-大学生在校生-求职-实习

- Emulator-chip8:微型模拟器

- ColorPickerViewAndroid:适用于 Android 的简单颜色选择器小部件

- kakao-clone-v2:Kakao Talk Clone Verison 2.0

- blueBadgeCocktails-client

- Colorhus_Legacy_Backup:备份旧站点公关客户端请求

- DependencyTrees.jl-9ae0eaca-57f6-5d9a-9b02-4a09e011bd92:来自https的最新快照