深度学习:卷积神经网络原理详解与应用

版权申诉

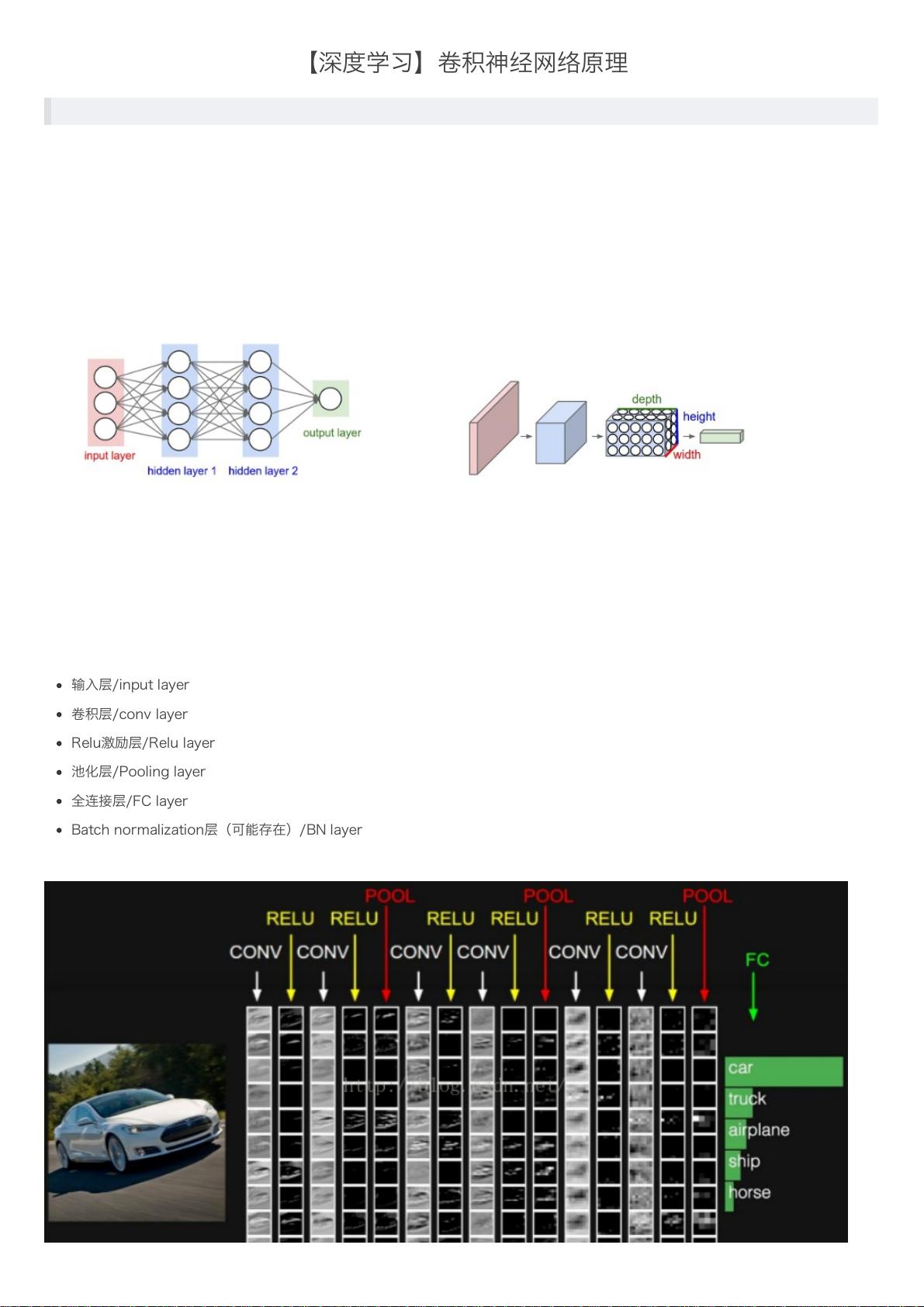

"深度学习卷积神经网络原理是计算机视觉领域的核心技术,它在深度学习框架中占据核心地位。卷积神经网络(CNN)的设计灵感来源于生物神经系统,特别是人脑处理图像的方式,通过模拟神经元对局部特征的响应。CNN的主要组成部分包括卷积层、池化层、激活函数层(如ReLU)、全连接层以及可能存在的批量归一化层。

卷积层是CNN的核心,其特点是局部连接和权重共享。局部连接使得神经元只与其输入空间的一小部分相连,这种连接区域被称为感受野,大小是可调整的超参数。每个神经元拥有一个或多个卷积核(filter或kernel),它们在输入上滑动并进行点乘运算,这样就实现了一种滤波器式的特征提取。权重共享减少了参数数量,避免了过拟合问题,并提高了模型的泛化能力。

池化层,如平均池化和最大池化,通过对输入特征进行下采样,进一步减小了数据维度,同时保持了重要的特征信息,有助于提升模型的计算效率和抗噪性能。

激活函数层,如ReLU(Rectified Linear Unit),引入非线性,增加了模型的表达能力,使网络能够学习到更复杂的模式。

全连接层负责将卷积层和池化层处理后的特征映射转换为最终的输出,进行分类或回归任务。

批量归一化(BN)层则用于加速训练过程,通过规范化每一层的输入,使得网络更加稳定,学习速度加快。

卷积神经网络通过巧妙地结合这些组件,有效地解决了高维数据,尤其是图像数据的特征提取和分类问题,使得深度学习在图像识别、物体检测、自然语言处理等领域取得了显著的成就。"

点击了解资源详情

点击了解资源详情

282 浏览量

313 浏览量

1459 浏览量

1031 浏览量

4556 浏览量

983 浏览量

_webkit

- 粉丝: 31

最新资源

- SQL技术开发大全:实用源代码及练习语句

- Android属性动画高级Demo解析与实现

- 深入解析DrawToolsRedux:强大画图软件的调试与运行

- jQuery与CSS3打造交互式电视墙特效菜单

- 网站开发必备:1000个无背景PNG图标集

- 利用Java打造仿Windows记事本应用程序

- HTML5与CSS3打造的Tela登录界面

- 专业BBS导航与搜索平台,高效引流解决方案

- DeskPins1.30:简化操作,常用程序永久置顶

- ASP.NET注册系统:AJAX验证与用户体验优化

- JavaScript编程实践 Urness147-1

- 实现vsftpd通过MySQL认证的PAM模块

- 汇编语言实战案例:源代码精编与应用

- ModLink插件库XE7与XE10版本支持详解

- PHP实现的留言板功能与操作演示

- Web应用程序3: C#开发核心架构揭秘