图神经网络基础教程:GCN、SAGE与PyTorch实现

需积分: 50 22 浏览量

更新于2024-07-15

收藏 2.52MB PDF 举报

图神经网络(Graph Neural Networks, GNNs)是一种新兴的深度学习模型,它在处理具有结构化数据的领域,如社交网络、化学分子、推荐系统等表现出强大的潜力。这份28页的教程旨在介绍图神经网络的基本概念、主要模型以及实际应用。

首先,章节"图:符号"定义了图的基本元素,包括节点(Nodes)、边(Edges)以及整个图(Graph)。在图中,每个节点通常关联有特征向量,而图分类任务则是每个图对应一个标签。节点分类则是指给定每个节点的特征,预测其所属类别。

接下来,教程介绍了几个关键的图神经网络模型示例:

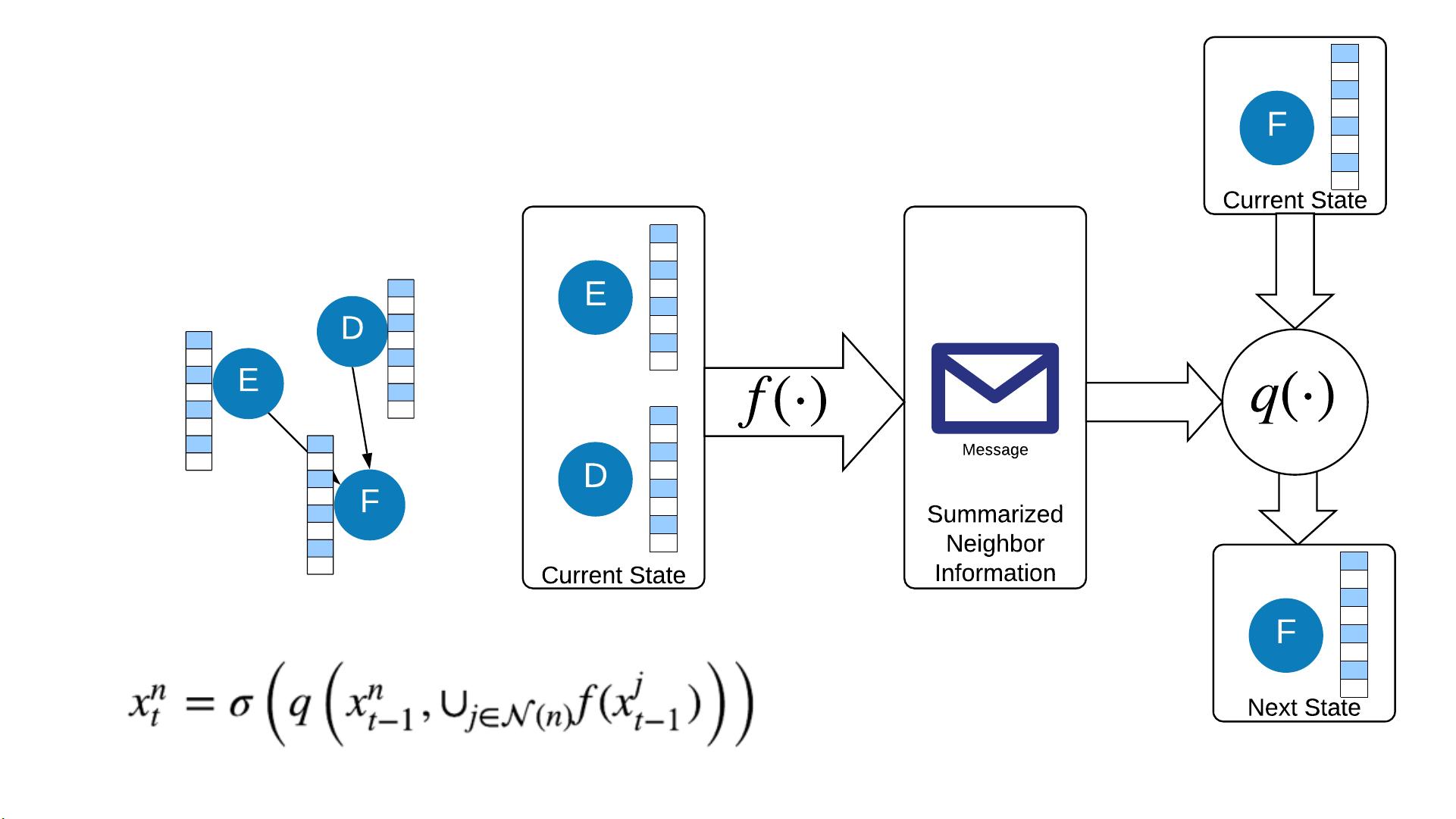

1. **图卷积网络 (Graph Convolutional Networks, GCNs)** - 由Kipf和Welling在2017年的ICLR会议上提出,是GNN的基石之一。GCN通过邻居信息的聚合和卷积操作来更新节点特征,有助于解决节点分类问题。它的核心思想是通过局部连接和权重共享,将节点的特征与邻居的特征相结合。

2. **SAGE (Semi-Supervised Classification with Graph Convolutional Layers)** - 提出于2017年NIPS,SAGE采用了一种随机邻居采样的策略,可以处理大规模图,并且简化了模型架构。

3. **GAT (Graph Attention Networks)** - 由Velickovic等人在2018年的ICLR会议上发布,引入了注意力机制到图神经网络中,使得模型能够自适应地关注不同的邻居节点,提高了模型的表达能力。

在应用方面,教程展示了图神经网络在计算机视觉中的应用,如2020年的CVPR会议论文“Feature Matching”,利用GNN进行图像特征匹配。此外,还提到了一个名为"APPAP"的实际项目,展示了GNN在实际场景中的实践应用。

图神经网络库的选择也是一大亮点,例如**DeepGraphLibrary (DGL)**,这是一个专门用于构建和操作图数据的库,提供了高效且易于使用的接口;另一个是**PyTorch Geometric**,它是基于PyTorch的图神经网络库,由Fey、Matthias和Jan Eric Lenssen在2019年的ICLR workshop上发表的论文中详细介绍。

最后,教程探讨了图神经网络面临的挑战,如**邻居爆炸(Neighbor Explosion)** 和**特征平滑(Feature Oversmoothing)**,这些现象可能导致模型性能下降或过度拟合。作者提醒读者在设计和训练GNN时需注意这些问题,以优化模型的性能。

这份教程提供了一个全面的入门指南,涵盖了图神经网络的基础理论、核心模型、应用实例以及相关工具,对于对这个领域感兴趣的读者来说,是理解和掌握图神经网络不可或缺的参考资料。

574 浏览量

2127 浏览量

2050 浏览量

2024-06-16 上传

169 浏览量

140 浏览量

281 浏览量

点击了解资源详情

113 浏览量

syp_net

- 粉丝: 158

最新资源

- Spring开发指南:V0.8预览版 - 持久层、Web工作流与AOP详解

- 精通Eclipse插件开发:从入门到实践

- DB2驱动的联系人信息管理系统数据库设计与实现

- Struts开发步骤详解:从创建工程到数据操作

- C#编程入门与进阶指南

- C#面试必备:核心概念与题目解析

- ESRI Shapefile格式详解:专业地理信息存储标准

- Hibernate缓存机制详解:事务、进程与集群范围

- Java正则表达式完全指南

- 整合STRUTS、SPRING与HIBERNATE实践笔记

- Oracle函数详解:SQL指令与字符串操作

- JAVA数据库编程详解:连接、操作与事务处理

- Java取余操作谜题:解析isOdd方法的陷阱

- 高质量C++/C编程规范与指南

- 计算机网络习题解析与解答

- 配置多节点JBoss服务器:端口修改指南