数值最优化:线搜索方法与步长选择策略

需积分: 34 136 浏览量

更新于2024-07-18

收藏 2.25MB PPTX 举报

"数值最优化第三章线搜索方法,涵盖了步长选择、线搜索算法的收敛性、收敛速度,以及多种搜索方向如最速下降、牛顿法、拟牛顿法和共轭方向。讲解中涉及到Wolfe-Powell条件、Armijo条件和Goldstein条件等步长选择策略。"

在数值最优化中,线搜索方法是求解优化问题的一种关键技术,主要应用于迭代过程中确定合适的步长αk和搜索方向Pk。这一章的重点在于如何选择使得目标函数f(x)下降最快且能有效收敛的步长。

步长αk的选择至关重要,它直接影响优化算法的效率和收敛性。最理想的情况是选择使函数下降幅度最大的步长,但这通常难以实现,因此采用近似策略,如不精确的线搜索算法。线搜索算法通常包括两个阶段:确定包含合适步长的区间(bracketing phase),然后在这个区间内通过二分或插值方法找到满足特定条件的αk。

常见的搜索方向包括:

1. **最速下降方向**:使用单位矩阵I乘以负梯度,即Bk=I,使得函数值下降最快。

2. **牛顿方向**:基于函数的Hessian矩阵,通常用于二阶优化方法。

3. **拟牛顿方向**:当Hessian矩阵不易计算或不可用时,使用近似对称正定矩阵Bk来模拟Hessian。

4. **共轭方向**:通过一组线性无关的向量,使得沿着这些方向的步长可以独立选择,提高收敛速度。

在步长选择策略中,有以下几个重要的条件:

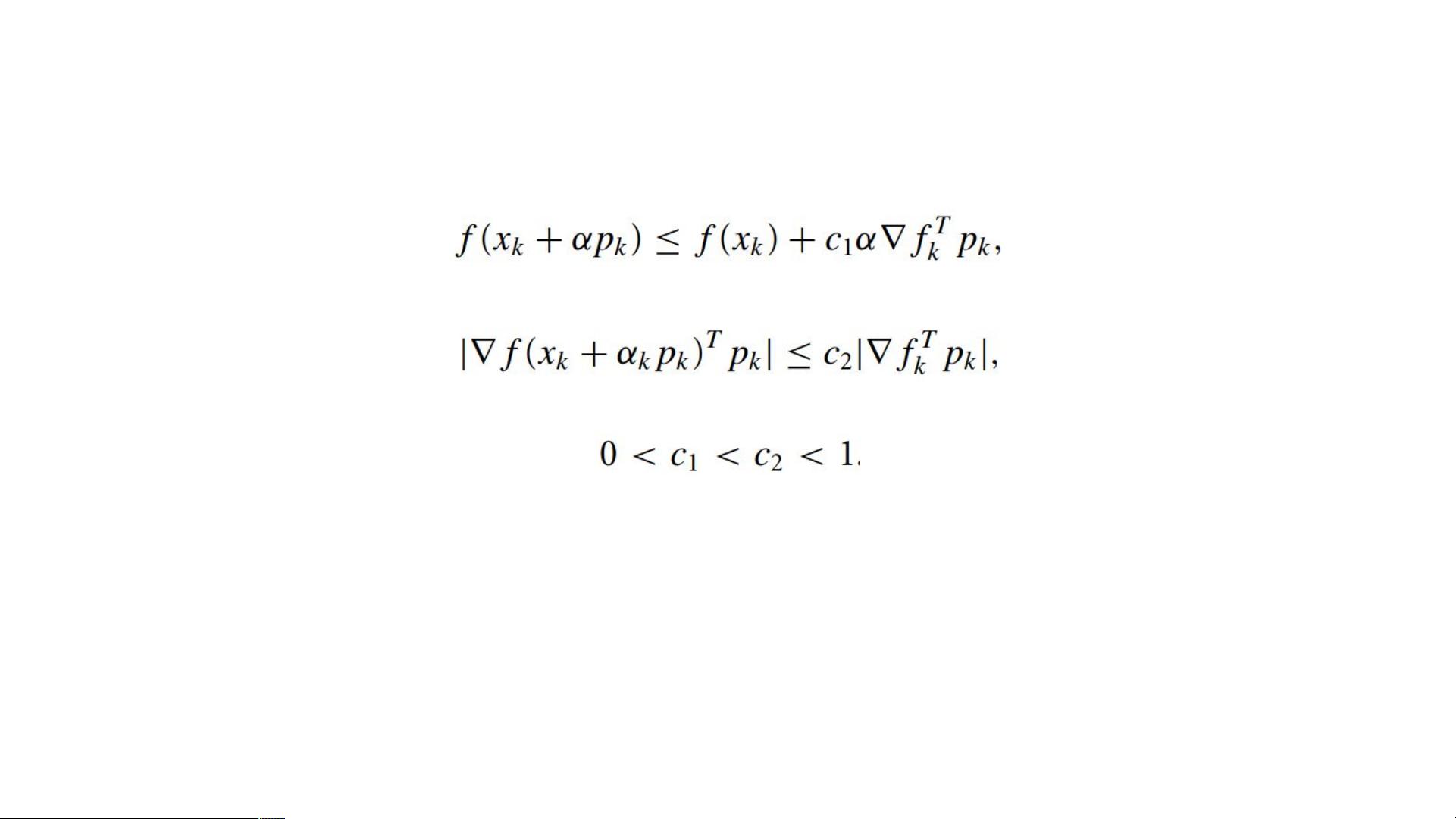

- **Armijo条件(Wolfe-Powell条件-a)**:要求步长αk使得函数值充分下降,一般设定一个常数c1,要求f(xk+αkPk)≤f(xk)+c1αk∇kf(xk)Tpk。

- **曲率条件(Wolfe-Powell条件-b)**:确保步长不太小,即要求f'(xk+αkPk)≥c2∇kf(xk)Tpk,其中c2通常小于1,以保证函数的下降趋势。

- **强Wolfe-Powell条件**:结合了Armijo条件和曲率条件,对步长αk的上限也有要求。

- **Goldstein条件**:同样保证了充分下降和步长不取过小,是另一种常用的步长选择策略。

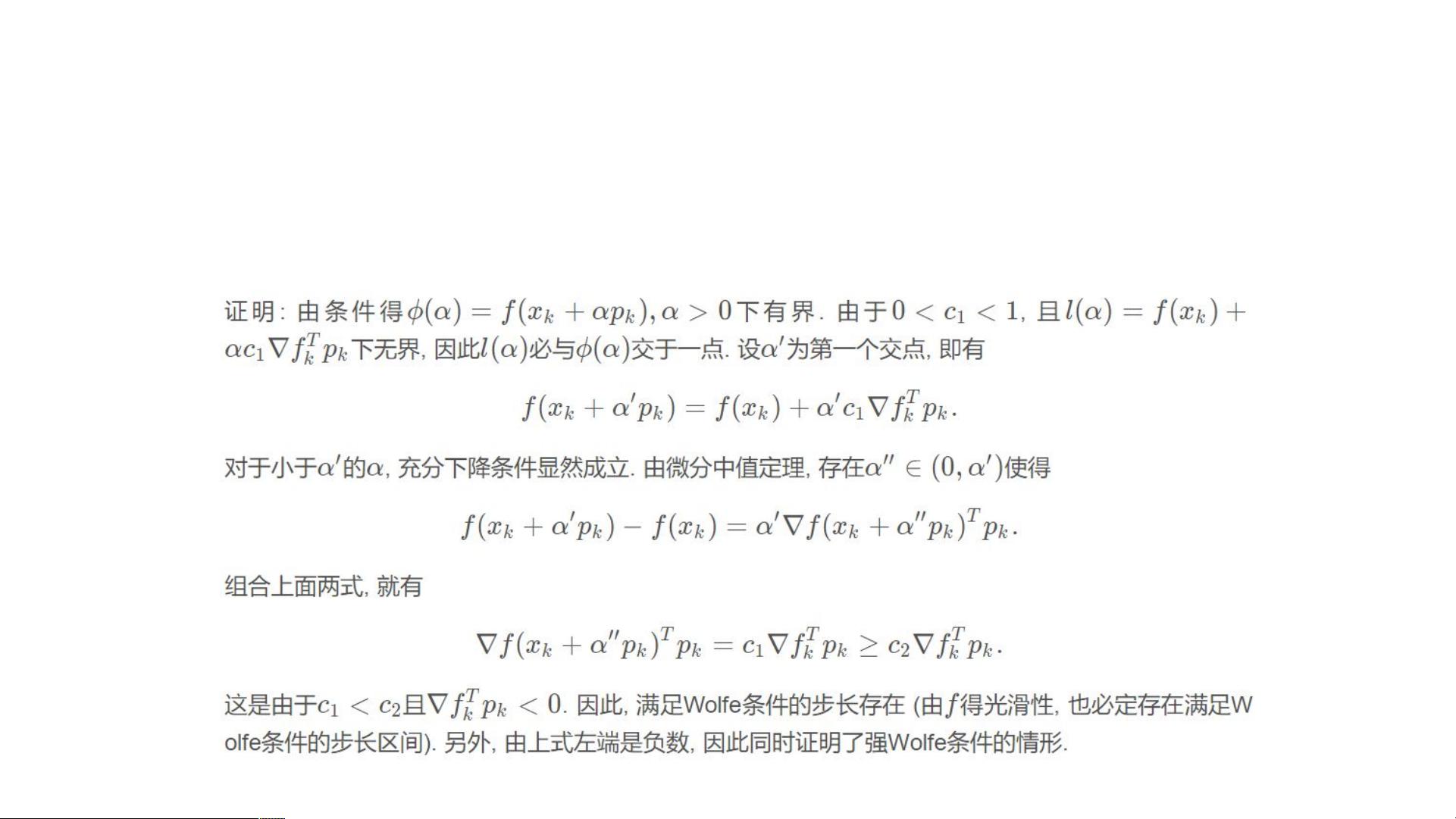

证明步长αk存在的关键在于函数f的性质,如连续可微和搜索方向为下降方向。引理3.1指出,在一定的条件下,总能找到满足Wolfe-Powell条件的步长。

线搜索方法的收敛性分析涉及算法的全局收敛性和局部收敛性,确保在多次迭代后能逼近问题的最优解。收敛速度研究了算法达到最优解的速度,这对于实际应用中的计算效率非常重要。

总结来说,数值最优化第三章的线搜索方法是优化算法的核心部分,它涉及到步长选择策略和搜索方向的综合运用,以及相关条件的理论证明,为优化问题的解决提供了有效的工具和理论支持。

点击了解资源详情

点击了解资源详情

点击了解资源详情

2010-07-23 上传

2010-07-23 上传

2012-11-28 上传

2020-08-17 上传

2023-01-02 上传

2022-08-04 上传

七块七毛七

- 粉丝: 5

- 资源: 8

最新资源

- C语言数组操作:高度检查器编程实践

- 基于Swift开发的嘉定单车LBS iOS应用项目解析

- 钗头凤声乐表演的二度创作分析报告

- 分布式数据库特训营全套教程资料

- JavaScript开发者Robert Bindar的博客平台

- MATLAB投影寻踪代码教程及文件解压缩指南

- HTML5拖放实现的RPSLS游戏教程

- HT://Dig引擎接口,Ampoliros开源模块应用

- 全面探测服务器性能与PHP环境的iprober PHP探针v0.024

- 新版提醒应用v2:基于MongoDB的数据存储

- 《我的世界》东方大陆1.12.2材质包深度体验

- Hypercore Promisifier: JavaScript中的回调转换为Promise包装器

- 探索开源项目Artifice:Slyme脚本与技巧游戏

- Matlab机器人学习代码解析与笔记分享

- 查尔默斯大学计算物理作业HP2解析

- GitHub问题管理新工具:GIRA-crx插件介绍