"这篇文档是关于面向云计算的分布式机器学习优化实践,主要探讨了在深度学习模型训练过程中遇到的挑战,以及如何通过各种优化技术来提升性能和降低成本。作者蓝昶详细介绍了训练优化的背景、目标和技术路径,特别关注了计算图切分、优化器优化、数值压缩和集合通信等方面,尤其是对NCCL通信框架的性能提升进行了深入讨论。"

在当前的AI领域,深度学习模型不断发展壮大,从最初的视觉模型发展到语言模型和多模态模型,再到大规模的预训练模型,这使得模型的参数量和计算需求急剧增加。因此,模型训练面临着算力和显存的双重限制,即所谓的“内存墙”问题。为了应对这些挑战,有两种主要的扩展方式:数据并行和模型并行,以解决算力和显存不足的问题。然而,随着模型规模的扩大,传统的水平扩展方法面临性能瓶颈,主要是因为互联带宽远小于内存带宽,网络带宽又远低于互联带宽,这种差距导致模型训练效率低下。

优化的目标是提升训练性能和降低总体拥有成本(TCO),同时确保优化过程对用户透明,不影响模型的使用。为达到这一目标,文档提出了以下几种技术路径:

1. 计算图切分和并行化策略:如GPipe和GSPMD,这些技术允许模型在多个GPU之间拆分和并行执行,有效利用硬件资源。

2. 优化器footprint优化:ZeRO和DeepSpeed等工具降低了优化器在内存中的占用,使得更大模型能在有限的显存内运行。

3. 混合精度数值压缩:如bfloat16和tf32,这些低精度格式能够在保持模型准确性的前提下减少存储和计算需求。

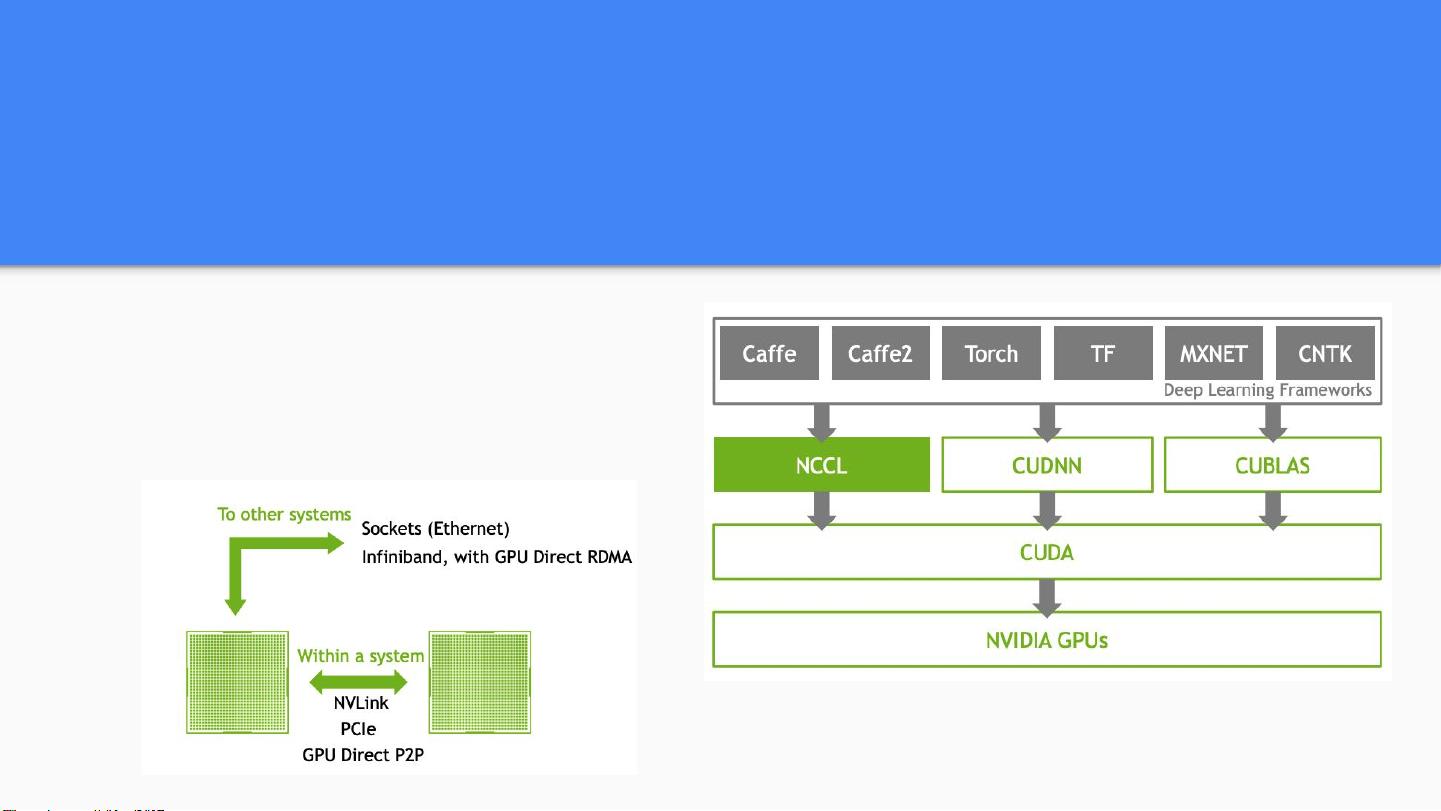

4. 集合通信优化:NCCL是一个用于GPU集群的集合通信框架,支持多机多卡的All-reduce操作。为了提高大消息的吞吐率,文档中还介绍了FastSocket,这是一种针对NCCL的高性能网络栈,旨在解决100GbE环境下吞吐率不足的问题。

NCCL的性能瓶颈在于其多TCP连接并行传输和多NCCL Channel/Ring设计可能导致资源消耗、性能抖动以及受网络环境影响的性能差异。为此,文档提出了动态负载均衡的解决方案,如Proxy Thread和Helper Thread,以动态配置切片负载,优化小切片的数据传输,从而缓解Straggler现象,提高大消息的吞吐率。

这篇文档深入探讨了云计算环境下的分布式机器学习优化,提供了实际可行的解决方案,对于优化深度学习模型的训练效率具有很高的参考价值。