神经网络结构设计:发展历程与关键理论

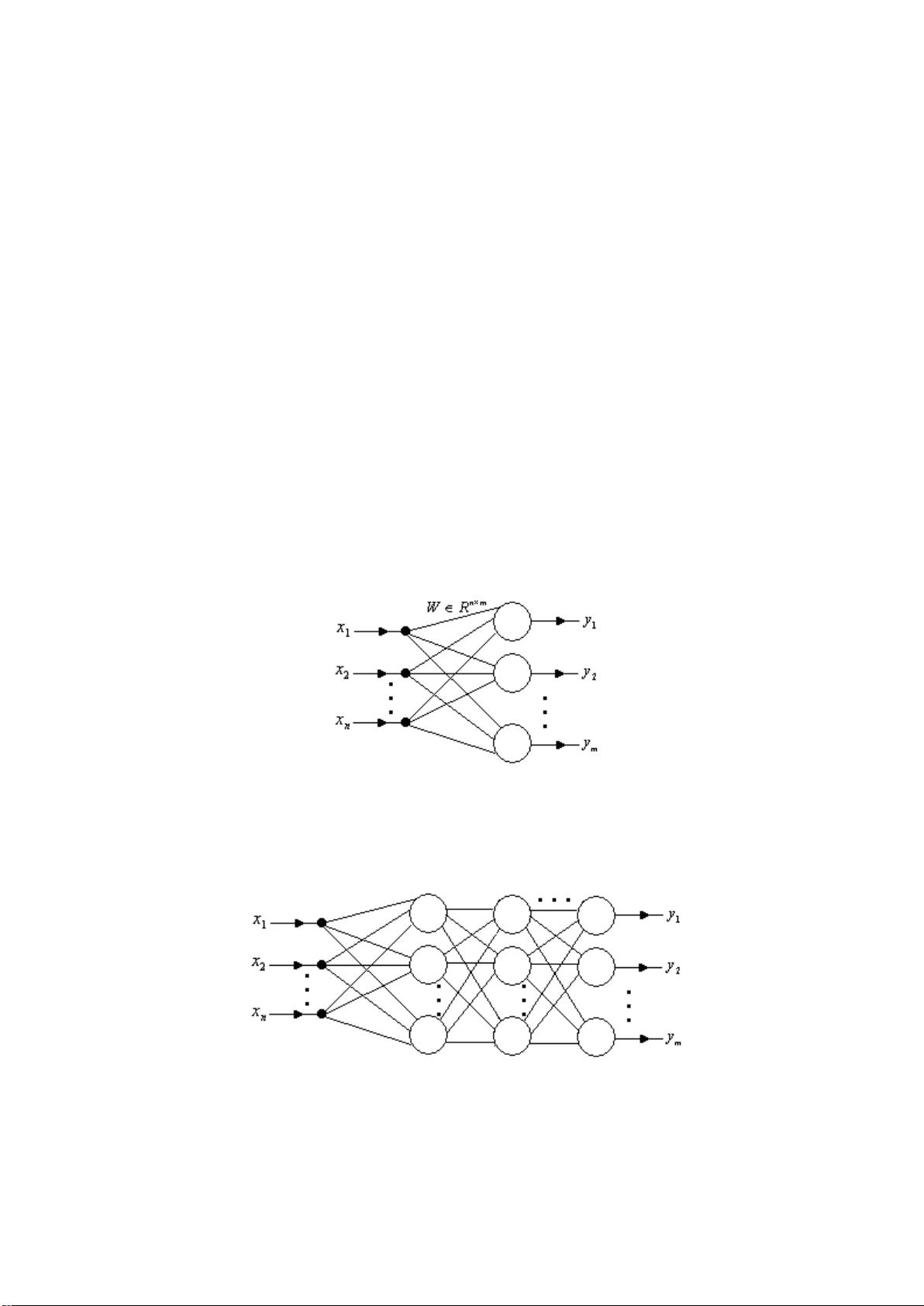

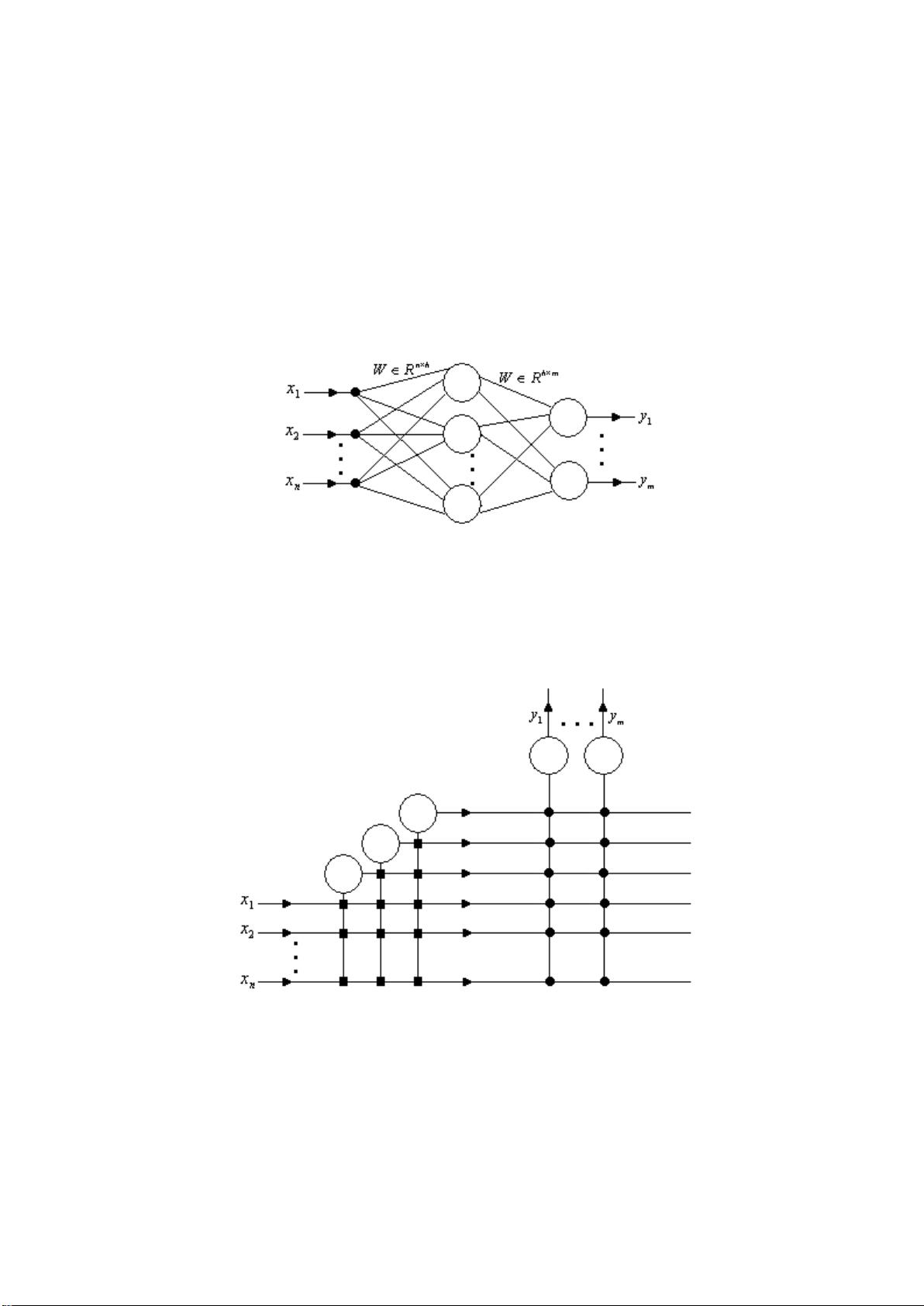

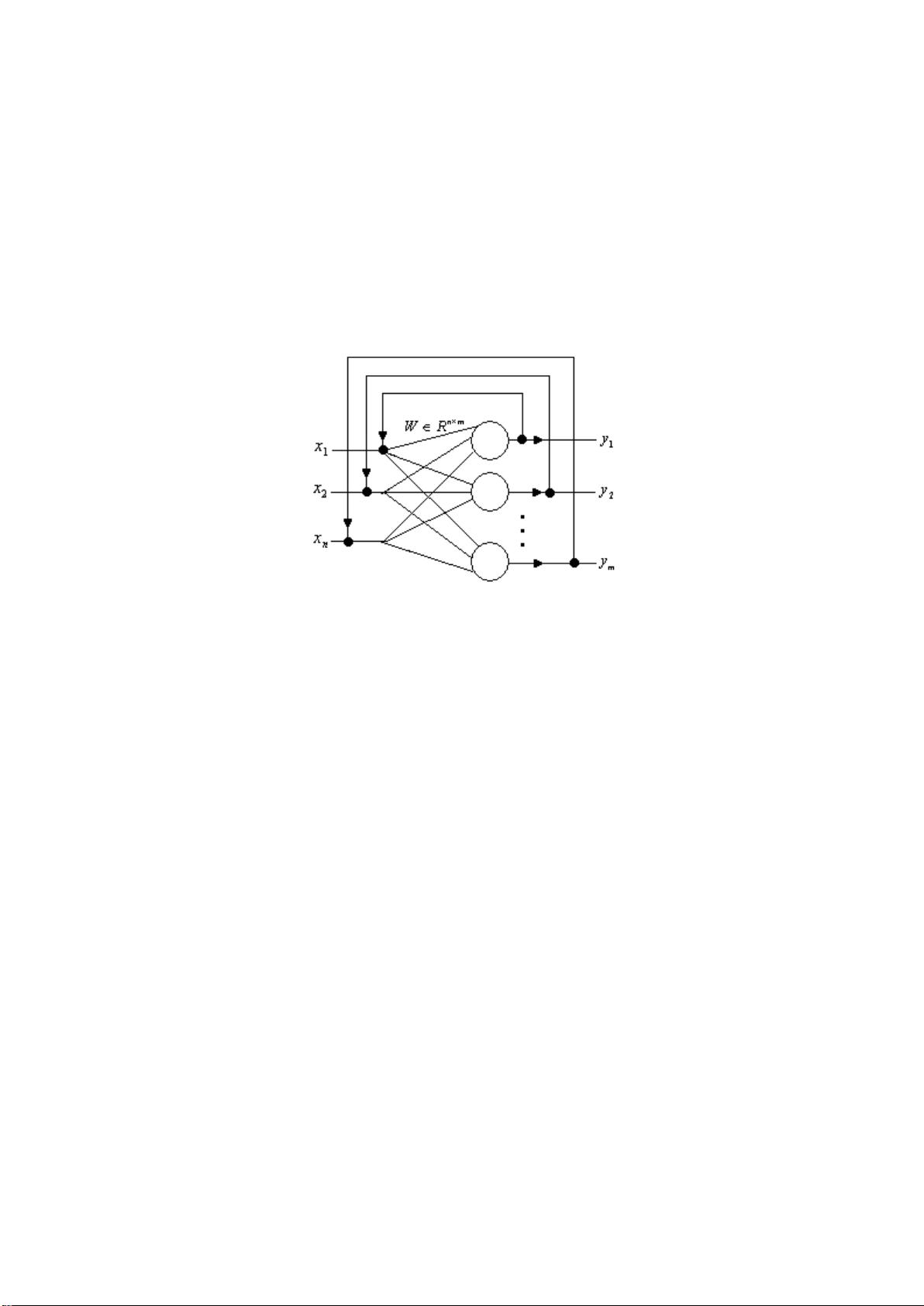

神经网络结构设计的理论和方法是一门综合性的学科,它深入探讨了如何构建和优化模拟人类大脑神经系统的计算模型。该课程的起点是介绍神经网络的基本概念,包括其模仿人脑神经系统的初衷,如非线性映射能力、学习和记忆功能等。神经网络的独特之处在于其灵活性、适应性和并行处理能力,使得它们在各种工程应用领域展现出强大的潜力。

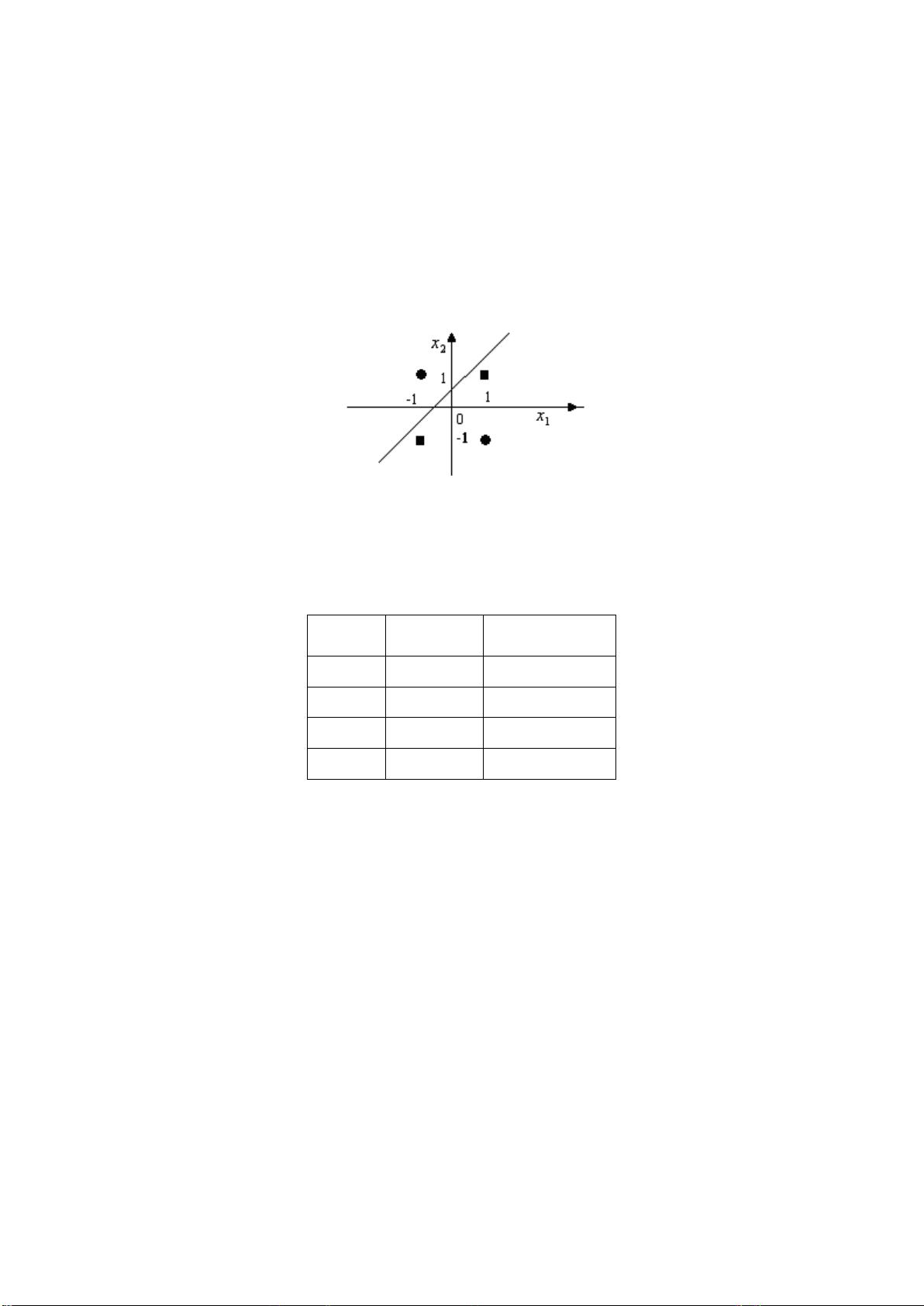

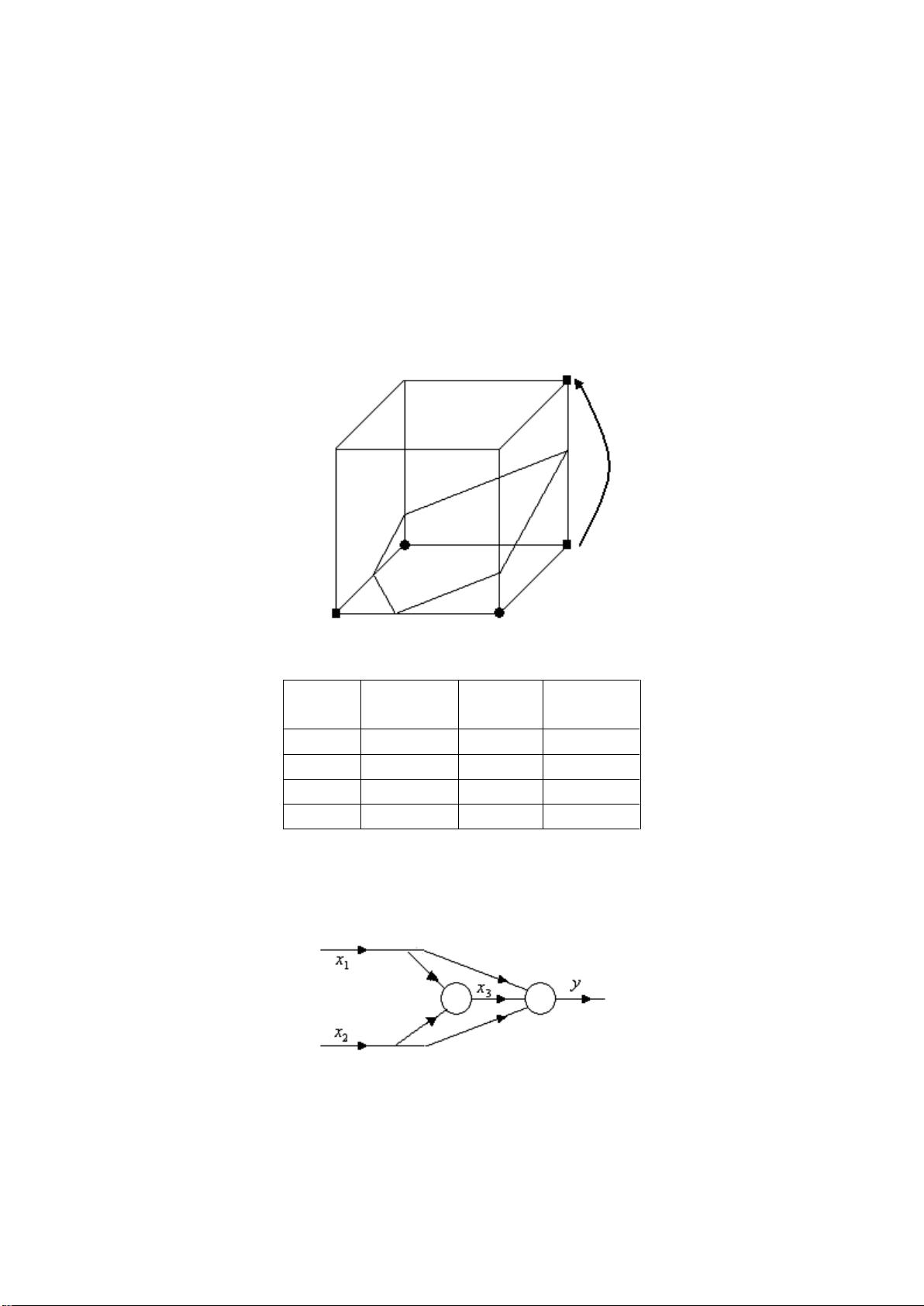

第一章概述了神经网络的历史发展脉络。从1943年的W.McCulloch和W.Pitts提出的MP模型,这个模型奠定了神经元的基本工作原理,到1949年D.Hebb提出的Hebb学习规则,这个规则强调了神经元连接的可塑性,对后世的学习算法有着深远影响。感知器模型在1957年由F.Rosenblat提出,作为早期的前馈神经网络,用于分类任务,展示了神经网络在初步应用中的可行性。

然而,1969年Minsky和Papert的《感知器》一书带来了低潮期,他们指出单层感知器的局限性,导致人们对神经网络的研究兴趣减退。尽管如此,这一时期的学者如H.Hopfield教授并未放弃,他于1982年提出了著名的Hopfield神经网络,这种网络能够在没有外部监督的情况下通过自组织学习来存储和检索信息,这对于解决复杂问题具有重大意义。

后续章节可能会深入讨论神经网络的结构类型,如多层感知器、卷积神经网络、循环神经网络等,以及它们各自的优缺点和适用场景。还会涉及神经网络的设计原则,如选择合适的激活函数、优化算法、网络层数和节点数量的确定,以及如何防止过拟合等问题。此外,实际应用中的神经网络训练、调参和部署技术也是重要内容,包括反向传播算法、深度学习框架如TensorFlow或PyTorch的使用等。

神经网络结构设计的理论和方法是一门涉及生物学、计算机科学和统计学等多个领域的交叉学科,通过深入理解其理论基础和实践技巧,可以推动人工智能和机器学习技术的不断进步。

相关推荐

181 浏览量

zhadam

- 粉丝: 7

最新资源

- VB在OPC客户端开发中实现分布式监控与RS-232/485通信

- Metarhia教育计划:编程课程索引与视频讲座

- VB实现摇奖系统的关键代码解析

- VC++实现的简易指针时钟:定时与响铃功能

- SSM框架整合实践:Struts2、MyBatis与Spring

- MTK安卓驱动自动安装识别解决方案

- Visual C++开发的录音程序界面及设置

- SSM框架整合必备Jar包清单

- VB技术隐藏进程与禁用快捷键的实现方法

- VideoSplitter:强大的视频剪辑与分割软件

- 《项目管理知识体系指南》中文版详尽介绍

- Java模拟太阳系运行程序:界面美观,细节丰富

- 轻量级Node.js会话中间件:cookie-session的特性与应用

- 使用OpenCV模板匹配技术快速识别人眼与人脸

- 周立功移植ucosII单片机开发解决方案

- Java/Unix/Oracle技术面试题库精粹