概率与朴素贝叶斯:数据挖掘中的预测模型

124 浏览量

更新于2024-07-14

收藏 19.36MB PDF 举报

"数据挖掘-第6章-概率与朴素贝叶斯"

在计算机科学领域,数据挖掘中经常涉及到统计学和机器学习方法,而朴素贝叶斯算法是其中一种重要的分类技术。本章节深入讨论了概率论和朴素贝叶斯分类器在处理实际问题中的应用,以女性运动员的运动类型识别为例。

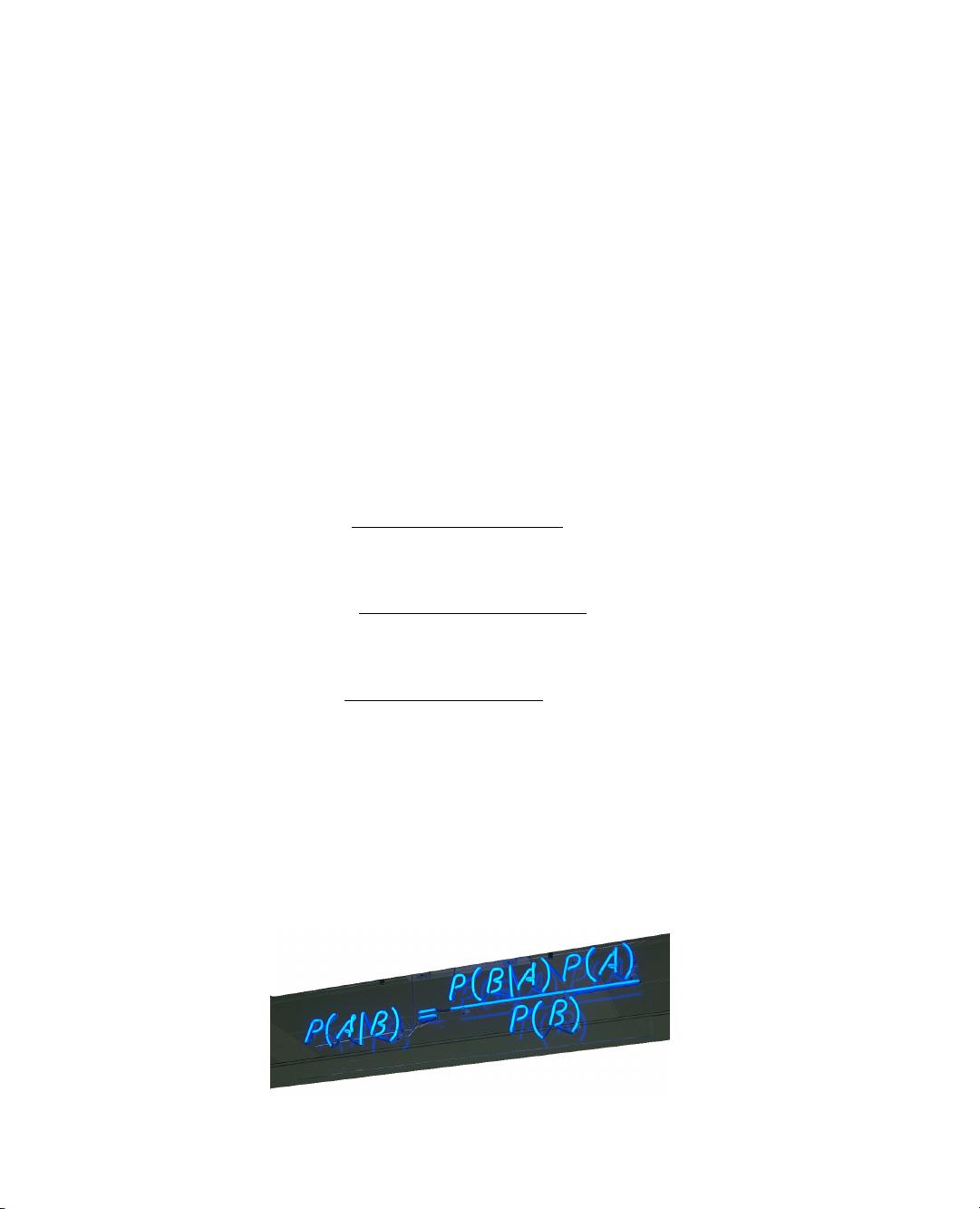

朴素贝叶斯算法基于贝叶斯定理,该定理阐述了如何在已知某些特征的情况下,计算某一事件发生的概率。在这个例子中,我们考虑了运动员的身高和体重作为特征来预测她们可能参与的运动:体操、马拉松或篮球。首先,假设我们要预测Brittney Griner的运动项目,她身高6英尺8英寸,体重207磅,根据常识,我们很可能会推测她是篮球运动员,并且对这个预测感到相当自信。

然后,对于Heather Zurich,她身高6英尺1英寸,体重176磅,我们的预测可能就没有那么确定了。虽然篮球也是一个可能的选择,但她的体型也可能是马拉松运动员。因此,我们的预测信心降低。

最后,面对Yumiko Hara,她身高5英尺4英寸,体重95磅,我们很可能推断她是体操运动员,但我们的信心相对较低,因为也有许多马拉松运动员具有类似的身高和体重。

朴素贝叶斯算法的“朴素”在于它假设特征之间相互独立,即一个特征的存在不会影响其他特征的存在。这在实际问题中可能并不总是成立,但在许多情况下,这种方法仍然表现出良好的性能,尤其是在文本分类和垃圾邮件过滤等领域。

在本章中,还会探讨最近邻算法(K-Nearest Neighbors, K-NN),这是一种基于实例的学习方法。K-NN算法通过找到训练集中与新样本最相似的K个邻居,根据这些邻居的类别进行预测。在这种情况下,如果我们用K-NN来预测运动员的运动,那么我们会根据运动员的身高和体重来寻找最接近的运动员,并根据他们的运动类型来决定预测结果。

朴素贝叶斯和K-NN都是数据挖掘中常用的分类算法,它们各有优势和局限性。朴素贝叶斯算法计算效率高,但依赖于特征独立的假设;而K-NN则不假设特征之间的关系,但计算复杂度较高,特别是当数据集较大时。

总结来说,本章节通过实际案例讲解了概率论和朴素贝叶斯算法的概念,以及它们在数据挖掘中的应用,同时也对比了与K-NN算法的异同,帮助读者理解这些基础的机器学习工具如何用于解决实际问题。

2019-02-21 上传

2021-04-22 上传

2021-04-22 上传

2021-04-22 上传

2024-12-28 上传

weixin_38719540

- 粉丝: 6

- 资源: 908

最新资源

- 基于元胞自动机的拓扑排序算法(pdf)

- RISC-DSP组合处理器设计优化

- ATL-之深入淺出,ATL是ActiveX Template Library 的缩写,它是一套C++模板库。

- c语言的面相对象设计

- GCC中文手册-gcc中文手册-相当详细的使用讲解手册

- VB小程序随即选数程序源码

- CSS及其应用 书籍

- 图书馆管理系统 需求分析

- IC生产流程与测试系统

- 达内实训笔记相关下载

- RDLC使用手册v2

- Quartus常见错误分析.doc

- VC++ 中实现进制2进制,10进制,16进制的相互转换

- IFIX 154学生手册

- Thinking.In.Java.3rd.Edition.Chinese.eBook

- css2.0高级技巧