YOLO系列详解:目标识别的移动端神速模型

需积分: 0 142 浏览量

更新于2024-06-14

收藏 3.66MB PDF 举报

本文主要介绍了YOLO系列(从V1到V5)模型,一种用于目标识别问题的深度学习架构,其初衷是使非专业人士也能理解和掌握这些模型的工作原理。YOLO最初是通过名为idetection的移动应用引入公众视野,该应用展示了YOLOv5在实时性和精度上的优势,特别适合移动端场景。

YOLO的核心特点是快速且模型小巧,这归功于其高效的设计,尤其是前向传播部分,它占用计算的90%以上。模型的实现流程主要分为三部分:前向传播、损失函数和反向传播。前向传播负责将输入图像经过多层卷积和全连接层处理,转化为包含目标类别和位置信息的预测。

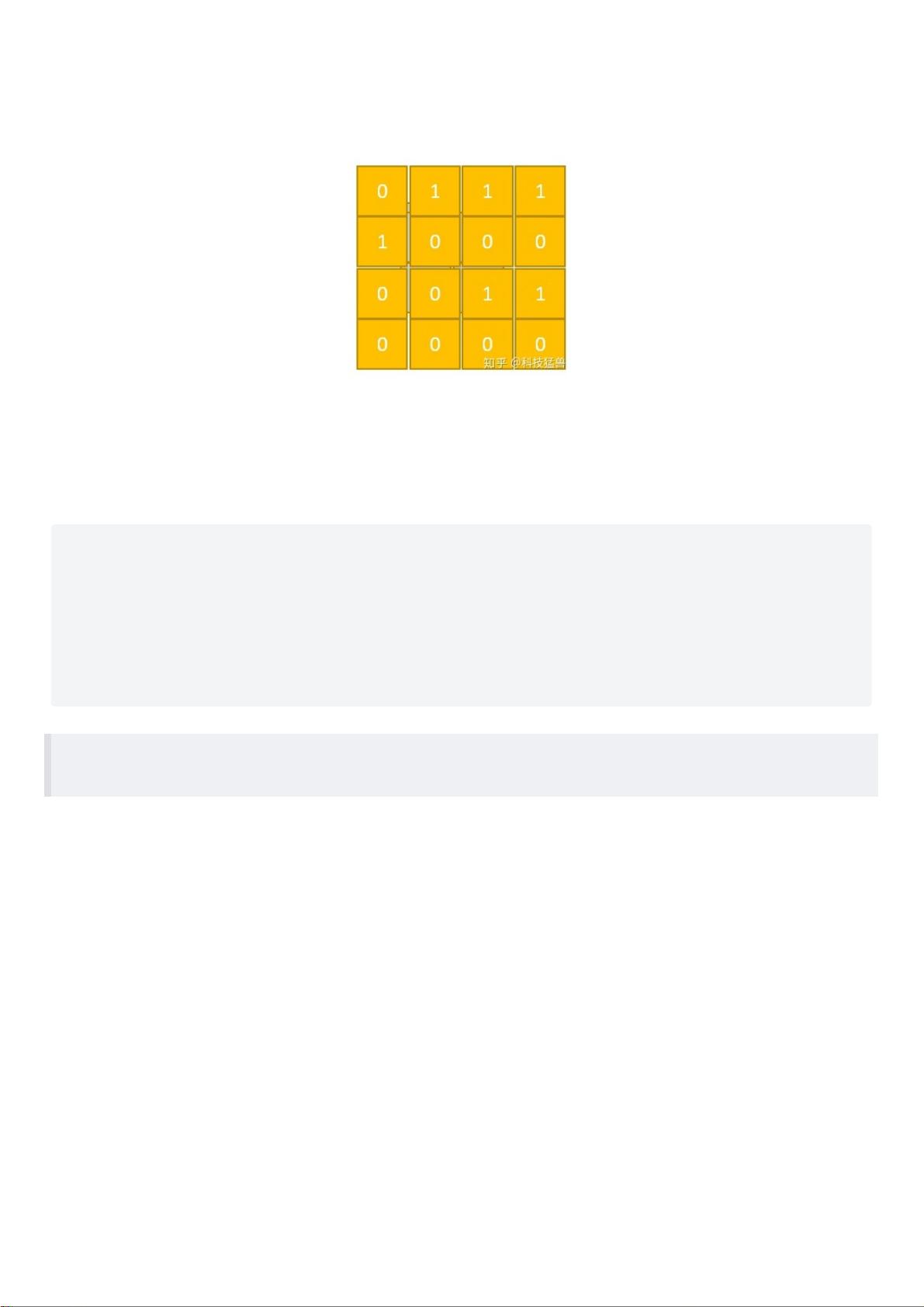

在进行目标检测任务之前,首先需要理解图像分类的基础,它涉及将输入图片映射成一个one-hot编码的向量,其中每个维度对应一个类别,值为1表示对应类别。针对图像分类,网络结构通常包括连续的卷积层(如cbrp,即convolution、batch normalization和ReLU激活)和全连接层,以逐步提取特征并最终做出分类决策。

YOLO系列模型的创新在于它将图像分类和物体定位结合在一起,形成一个单一的输出,消除了传统方法(如R-CNN)中的区域提议阶段,显著提高了速度。YOLOV1至V5的不同版本主要是在网络结构、精度优化和计算效率上不断迭代改进,例如增加更多的卷积层、调整锚框策略和采用更先进的特征金字塔结构等。

文章通过生动的比喻(如用葫芦娃的故事讲述模型的工作过程),使得复杂的技术内容易于理解,强调了知乎博客这类平台在传播技术知识时注重实用性和可读性的价值。同时,作者还分享了YOLOv5的实战应用——idetection app,用户可以实际体验不同模型大小带来的实时性和精度 trade-off。

总结来说,本文深入浅出地讲解了YOLO系列的目标检测模型,从起源、设计思想、关键组成部分到应用场景,为读者提供了一个全面且易懂的视角。

744 浏览量

点击了解资源详情

点击了解资源详情

135 浏览量

221 浏览量

点击了解资源详情

点击了解资源详情

2025-01-06 上传

2025-01-11 上传

ciervaa

- 粉丝: 50

- 资源: 1

最新资源

- 查看字符串在不同编码.zip

- springboot-swagger.zip

- schematics-go-sdk:GO SDK for IBM Cloud Schematics服务

- 2张精美3D立体的柱状图PPT模板

- SafeFlashlight

- 雷夫

- hexapdf, 面向 ruby的通用PDF创建和操作.zip

- fylo-landing-page-with-two-column-layout-master

- libspng:简单,现代的libpng替代方案

- m4l15-phan-quyen-Spring-boot-authentic

- 数控直流电源.7z数控直流电源.7z

- 粒子群算法用于解决山地路线规划问题

- install-nginx.tar.gz

- 西蒙游戏

- SanyamSwami123

- Ajax-WikiFinder.zip