人工神经网络发展史:前向多层BP算法与里程碑

需积分: 49 95 浏览量

更新于2024-07-21

收藏 610KB DOC 举报

人工神经网络(Artificial Neural Networks, ANN)的发展历程可以追溯到20世纪40年代,由McCulloch和Pitts提出的M-P模型为神经元模型奠定了基础。随后,Hebb规则引入了神经元之间突触联系的可变性,这是理解神经网络学习机制的重要一步。

Von Neumann在1946年的电子计算机发明后,提出了自动机网络的概念,预示了神经网络计算机的雏形。然而,到了50年代末,Perceptron感知机的实际应用遇到了挑战,F.Rosenblatt的工作并未如预期般解决所有问题,Minsky和Pappert对此提出了批评,强调深度学习的重要性。

60年代,Widrow的自适应滤波器(Adaline)和Hopfield神经网络的出现带来了新突破。Hopfield网络不仅展示了联想记忆功能,还首次将李亚普诺夫稳定性概念应用于神经网络,解决了旅行商问题。1974年,BP(Back-Propagation)算法的提出,由Werbos、Amari和Rumelhart等人贡献,极大地推动了多层前向网络的学习能力,打破了人们对神经网络性能的悲观看法。

进入80年代,Kohonen的自组织特征映射和Crossberg和Carpenter的自适应谐振理论(ART)进一步拓展了神经网络的应用范围。目前,人工神经网络的研究领域广泛,涵盖了神经生理科学、认知科学、数学物理科学以及信息处理和计算机科学等多个方向,尤其在新一代计算机和生物神经网络(BNN)的发展中起到了关键作用。

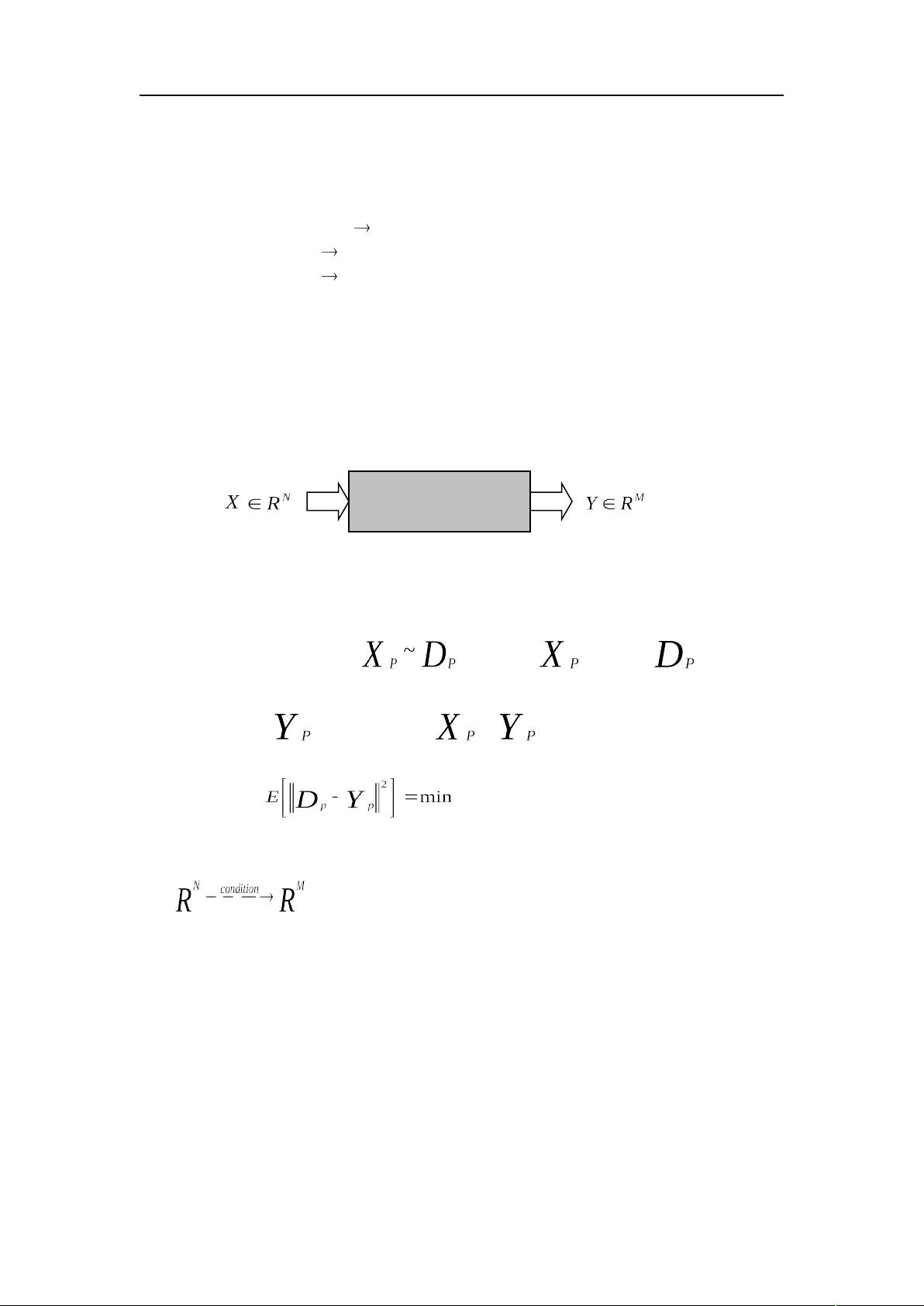

传统计算机与神经网络计算机之间的区别在于,传统计算机依赖于固定的算法和指令,而神经网络则模仿生物神经系统的并行处理和学习能力,能够处理非结构化问题,具有更强的适应性和泛化能力。随着BP算法的成熟,多层前向网络证明了它们在解决复杂问题上的优越性,为现代人工智能技术的进步奠定了基础。

392 浏览量

416 浏览量

102 浏览量

2021-09-26 上传

2024-04-19 上传

148 浏览量

110 浏览量

108 浏览量