PyTorch Task05: 深入理解卷积神经网络

7 浏览量

更新于2024-08-30

收藏 182KB PDF 举报

"本文主要介绍了PyTorch中的卷积神经网络Task05的相关知识,包括卷积神经网络的基础概念,如二维卷积层、填充和步幅、多输入通道和多输出通道,以及卷积层与全连接层的对比。此外,还提及了一些经典的卷积神经网络模型,如LeNet-5、AlexNet、VGG、GoogLeNet (Inception) 和ResNet,讨论了卷积神经网络中的退化问题以及残差网络的解决办法。"

卷积神经网络(CNN)是深度学习领域中用于图像处理和计算机视觉任务的重要模型。在PyTorch中,我们可以构建和训练自己的卷积神经网络模型。

1. **卷积神经网络基础**

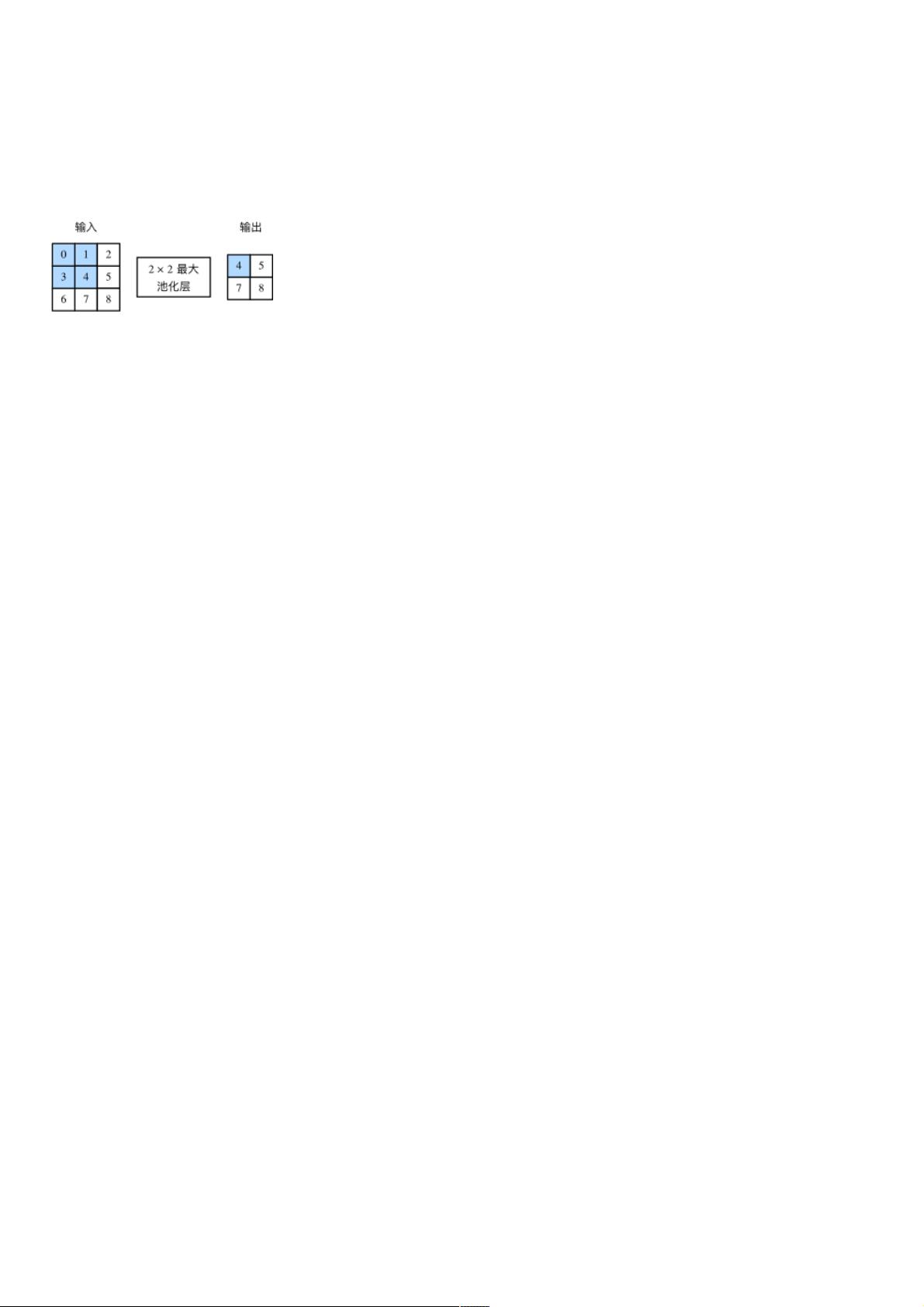

- **二维卷积层**:卷积层是CNN的核心组成部分,它通过二维互相关运算处理输入数据。卷积核在输入数组上滑动,对每个位置的输入子数组进行元素乘积并求和,生成输出数组的对应元素。这有助于提取输入数据的局部特征。

- **填充(padding)**:为了保持输出尺寸与输入相似或恒定,通常会在输入的边缘添加零元素,这样卷积核可以覆盖到输入的所有区域。

- **步幅(stride)**:卷积核移动的步长决定了输出元素的间隔。步幅越大,输出尺寸越小,捕获的信息越少;反之,步幅越小,输出尺寸越大,能捕捉到更多的细节。

2. **多输入通道和多输出通道**:在彩色图像中,输入通常有三个通道(红、绿、蓝)。卷积层可以设计成处理多个输入通道,并产生多个输出通道,形成特征图。每个输出通道可以捕获不同的特征。

3. **卷积层与全连接层对比**:全连接层处理全局信息,每个神经元与前一层的所有神经元相连。而卷积层则侧重于局部信息,通过卷积操作保持输入的空间结构,减少参数数量,有效防止过拟合。

4. **经典模型**

- **LeNet-5**:由Yann LeCun提出的早期CNN模型,主要用于手写数字识别。

- **AlexNet**:2012年ImageNet竞赛的获胜者,首次证明了深度CNN在大规模图像分类上的优势。

- **VGG**:由牛津大学Visual Geometry Group提出的模型,以深度和小卷积核为特点。

- **GoogLeNet (Inception)**:引入了Inception模块,通过并行不同大小的卷积来提高效率和性能。

- **ResNet**:解决了深度网络中的梯度消失问题,通过残差块实现非常深的网络训练。

5. **退化问题与残差网络**:随着网络深度增加,可能会出现性能下降的现象,称为退化问题。ResNet通过引入残差块,使得信号可以直接从输入传递到输出,解决了这个问题,使得训练极深的网络成为可能。

了解这些基础知识后,你可以用PyTorch构建自己的卷积神经网络模型,解决各种图像识别、目标检测等任务。在实践中,还需要结合正则化、优化器选择、损失函数等技术,以优化模型性能。

2021-01-07 上传

2021-01-06 上传

点击了解资源详情

点击了解资源详情

2021-01-20 上传

2021-01-20 上传

2021-01-06 上传

2021-01-06 上传

2021-01-06 上传

weixin_38706455

- 粉丝: 5

- 资源: 920

最新资源

- CoreOS部署神器:configdrive_creator脚本详解

- 探索CCR-Studio.github.io: JavaScript的前沿实践平台

- RapidMatter:Web企业架构设计即服务应用平台

- 电影数据整合:ETL过程与数据库加载实现

- R语言文本分析工作坊资源库详细介绍

- QML小程序实现风车旋转动画教程

- Magento小部件字段验证扩展功能实现

- Flutter入门项目:my_stock应用程序开发指南

- React项目引导:快速构建、测试与部署

- 利用物联网智能技术提升设备安全

- 软件工程师校招笔试题-编程面试大学完整学习计划

- Node.js跨平台JavaScript运行时环境介绍

- 使用护照js和Google Outh的身份验证器教程

- PHP基础教程:掌握PHP编程语言

- Wheel:Vim/Neovim高效缓冲区管理与导航插件

- 在英特尔NUC5i5RYK上安装并优化Kodi运行环境