探索RL与LLM融合:迈向AGI的世界模型详解

需积分: 0 106 浏览量

更新于2024-06-13

收藏 10.61MB PDF 举报

本文深入探讨了融合强化学习(RL)与大语言模型(LLM)思想在构建世界模型(WM)以迈向人工智能通用(AGI)和超人工智能(ASI)过程中的关键作用。作者吕明通过对AlphaDev、AlgorithmDistillation以及AlphaGO/Zero的研究,揭示了RL和LLM之间的潜在联系,并借鉴了不同领域的探索模式,如数学家陶哲轩的探索方式和欧几里得助手的概念。

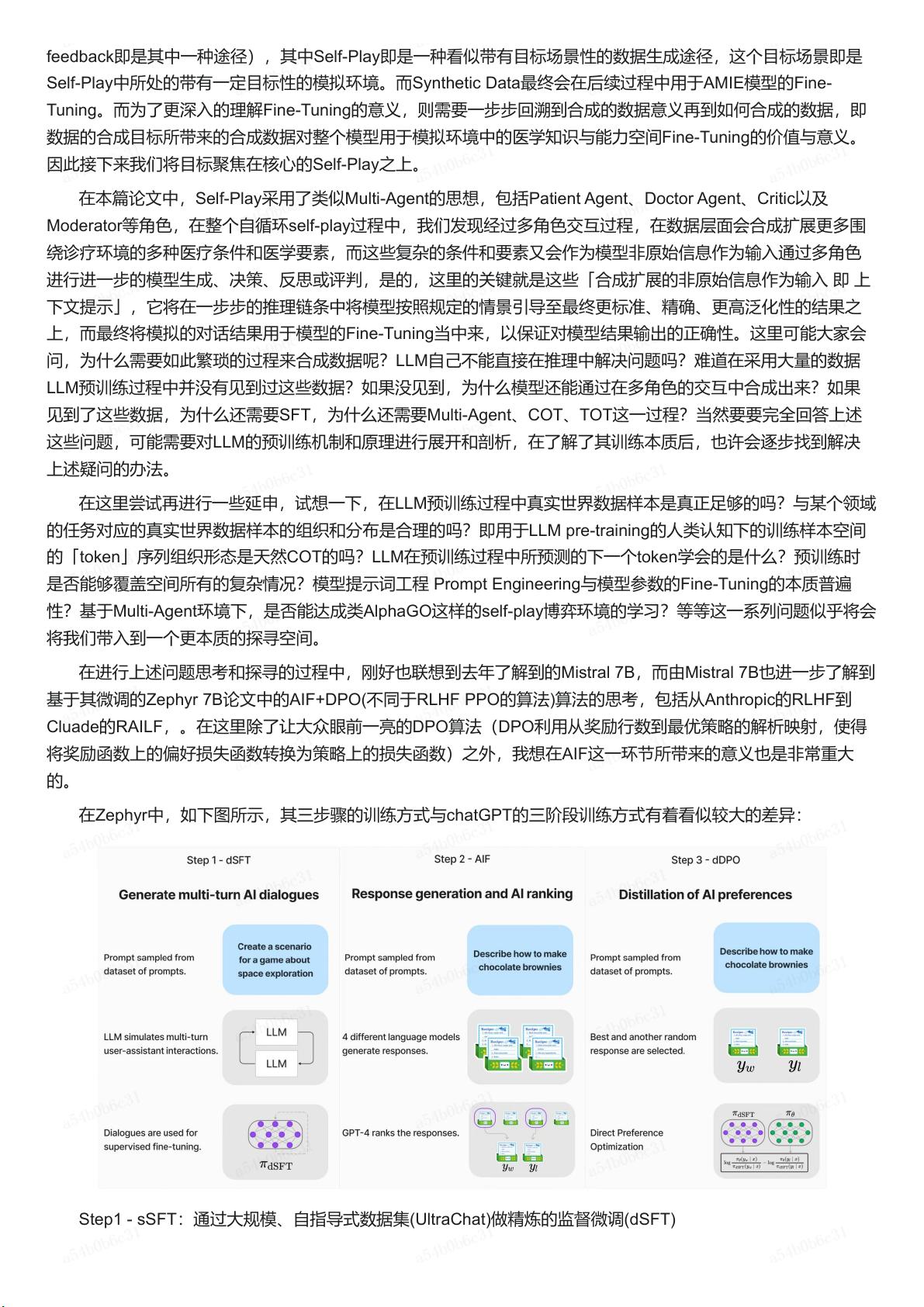

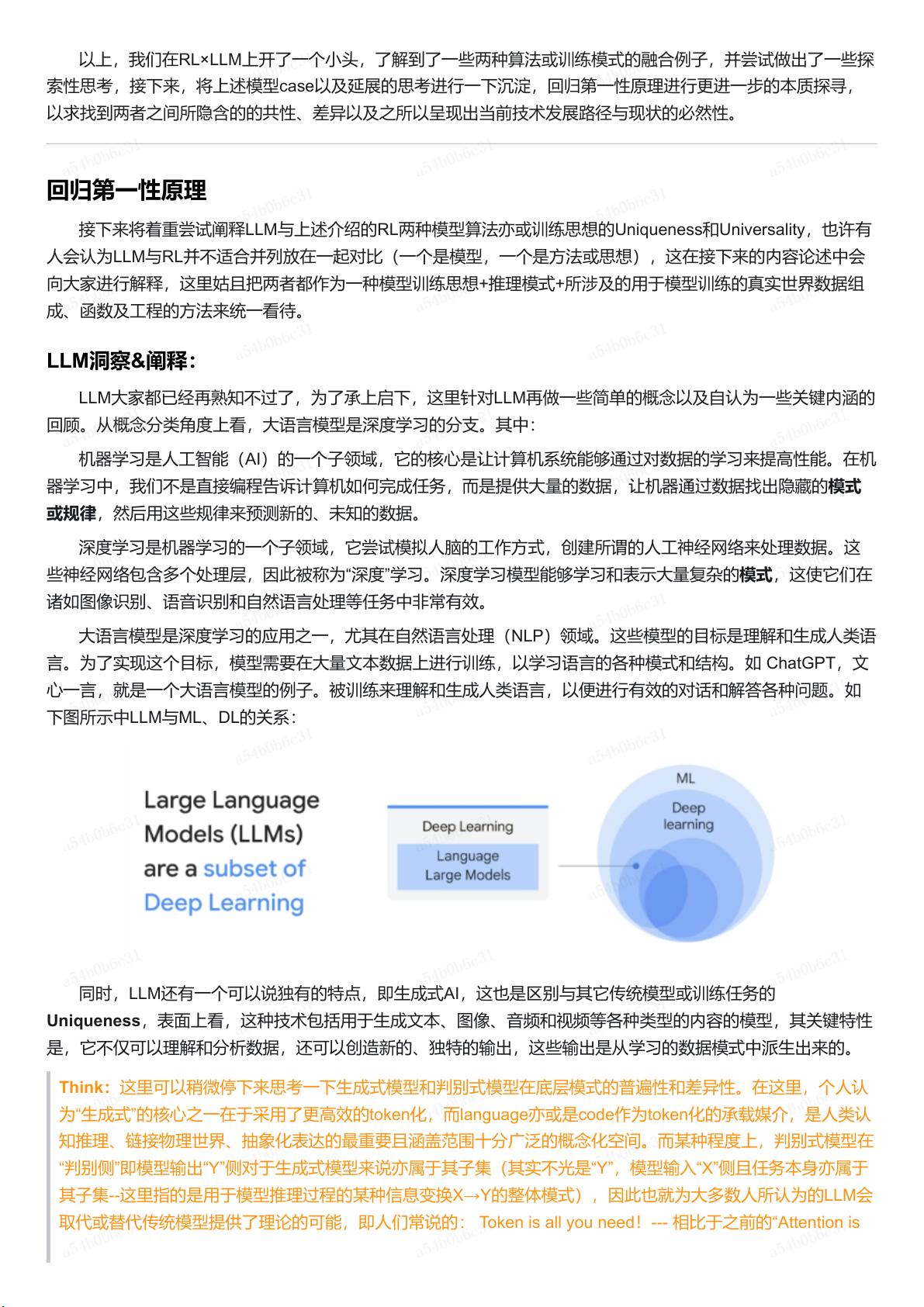

"上篇"部分,着重于AlphaDev的尝试,讨论了算法压缩(AlgorithmDistillation)如何启发了RL在围棋等复杂游戏中的应用,以及AlphaGO/Zero如何通过结合RL与LLM实现深度学习的进步。回归到第一性原理的分析,旨在理解这些技术背后的理论基础。

"中篇"深入剖析了RL与LLM融合的本质,通过对比"系统一"(快速直觉)与"系统二"(深思熟虑)的思考过程,探讨了如何将这两种方法整合在世界模型构建中,以便更好地模拟人类认知。文章还提及了世界模型的内涵,它是AI理解环境和预测未来的关键组成部分。

"下篇"则明确了文章的目的,即通过研究如ChatGPT等LLMs和Alpha系列(如AlphaDev)的AR和RL思想,探索推理过程学习的可能性,并扩展到快思考与慢思考的统一。文章引用李飞飞教授的观点,暗示人工智能正处在历史上的一个重要转折点,即将进入所谓的"牛顿时刻"。

作者通过这篇文章,不仅分享了技术细节,还试图提供一个全面的视角,将RL、LLM和世界模型的融合置于更广阔的理论框架内,为AI的未来发展提供了前瞻性的思考。阅读者可以通过文章的三个部分,深入了解这些技术在迈向AGI和ASI道路上的潜力和挑战。

点击了解资源详情

点击了解资源详情

点击了解资源详情

2023-05-18 上传

2023-06-19 上传

2024-04-12 上传

2024-10-18 上传

点击了解资源详情

2023-06-13 上传

吕小明么

- 粉丝: 685

- 资源: 1

最新资源

- cpu-clock-ticks:纯javascript实现以获取`sysconf(_SC_CLK_TCK))`值

- 十字路口:中国金融科技的新篇章》.rar

- think-config:配置ThinkJS 3.x

- Excel模板00科目汇总表.zip

- 毕业设计&课设--超市供销存管理系统,超市管理系统,供销存管理系统,进销存,JAVA+MySQL毕业设计.zip

- 高光谱图像分解:卷积神经网络的高光谱图像分解(无分叉,半成品)

- pex-helpers:为 pex 库调试网格生成器

- goertzeljs:Goertzel算法的纯JavaScript实现

- 同心视界-VR未来课堂-2019.4-51页.rar

- java_practice

- react-native-luna-star-prnt:React适用于LunaPOS的本机StarPRNT库

- Excel模板收据模板(样本).zip

- 毕业设计&课设--毕业设计之网上订餐系统.zip

- Real-time-log-analysis-system:基于spark stream + flume + kafka + hbase的实时日志处理分析系统(分为控制台版本和基于springboot,Echarts等的Web UI可视化版本)

- hyper-json:带有链接的 Json!

- 漂亮的配置x标准