分布式内存系统与编程简介

版权申诉

67 浏览量

更新于2024-06-25

收藏 1.08MB PDF 举报

"分布式内存系统与编程"

在计算机科学领域,分布式内存系统是处理大规模并行计算的一种重要方式。本讲座(Lecture7)主要探讨了分布式内存架构以及使用消息传递进行编程的相关概念,由James Demmel教授讲解,并参考了Kathy Yelick的讲义。在上一讲(Lecture6)中,主要介绍了共享内存多处理器系统,包括共享和分布式缓存,以及多核芯片中常见的共享缓存机制。共享缓存可以提高性能,但需要保持一致性,即多个缓存中的同一位置必须保持相同,这通常需要复杂的硬件支持。

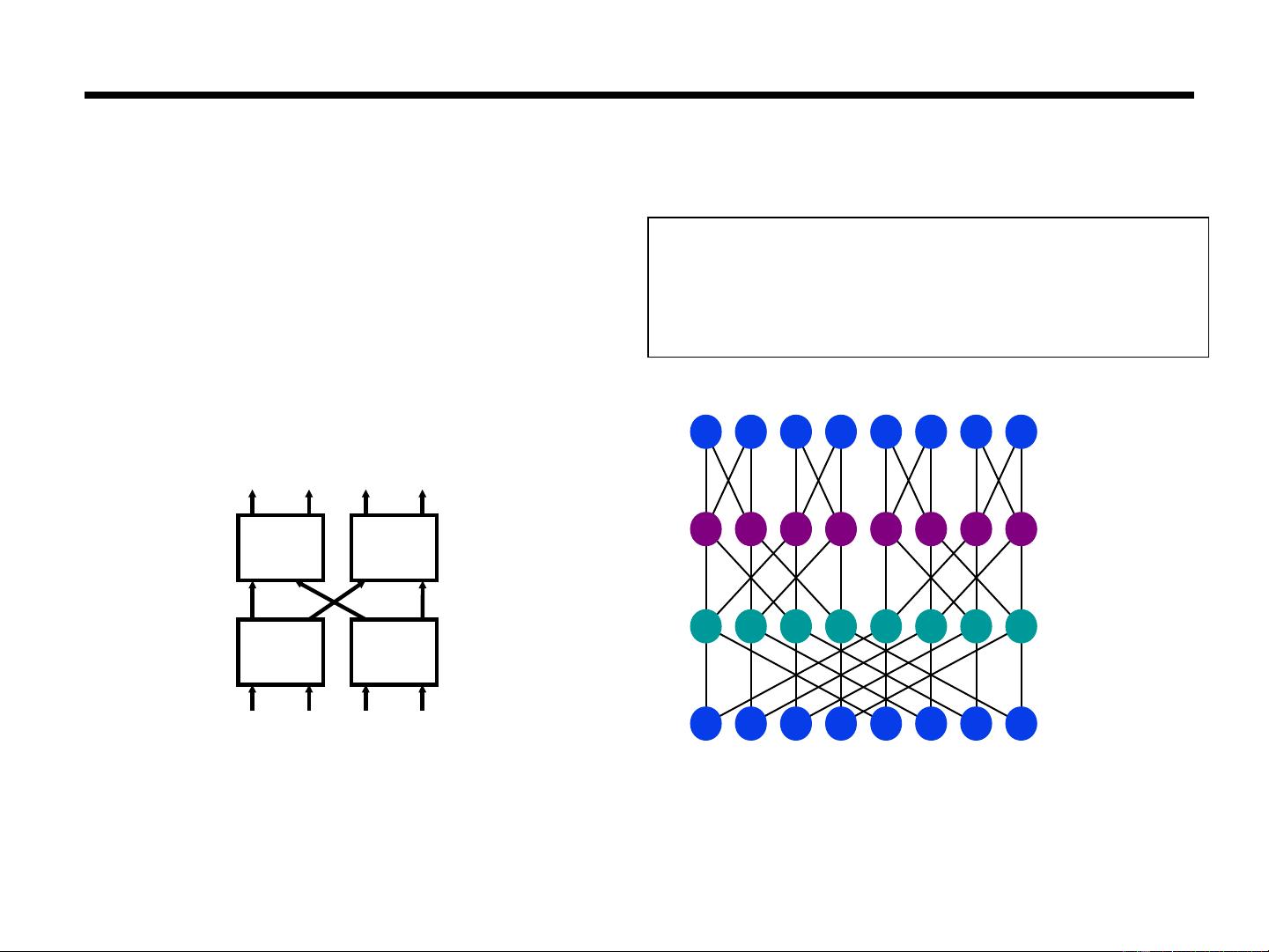

分布式内存架构与共享内存不同,每个处理器有自己的独立内存,它们之间通过通信网络进行数据交换。这种架构在扩展性方面表现优秀,可以支持数十到数百个处理器。然而,访问远程内存的代价远高于访问本地内存,因此优化通信效率成为关键。

本讲座的提纲包括以下几个部分:

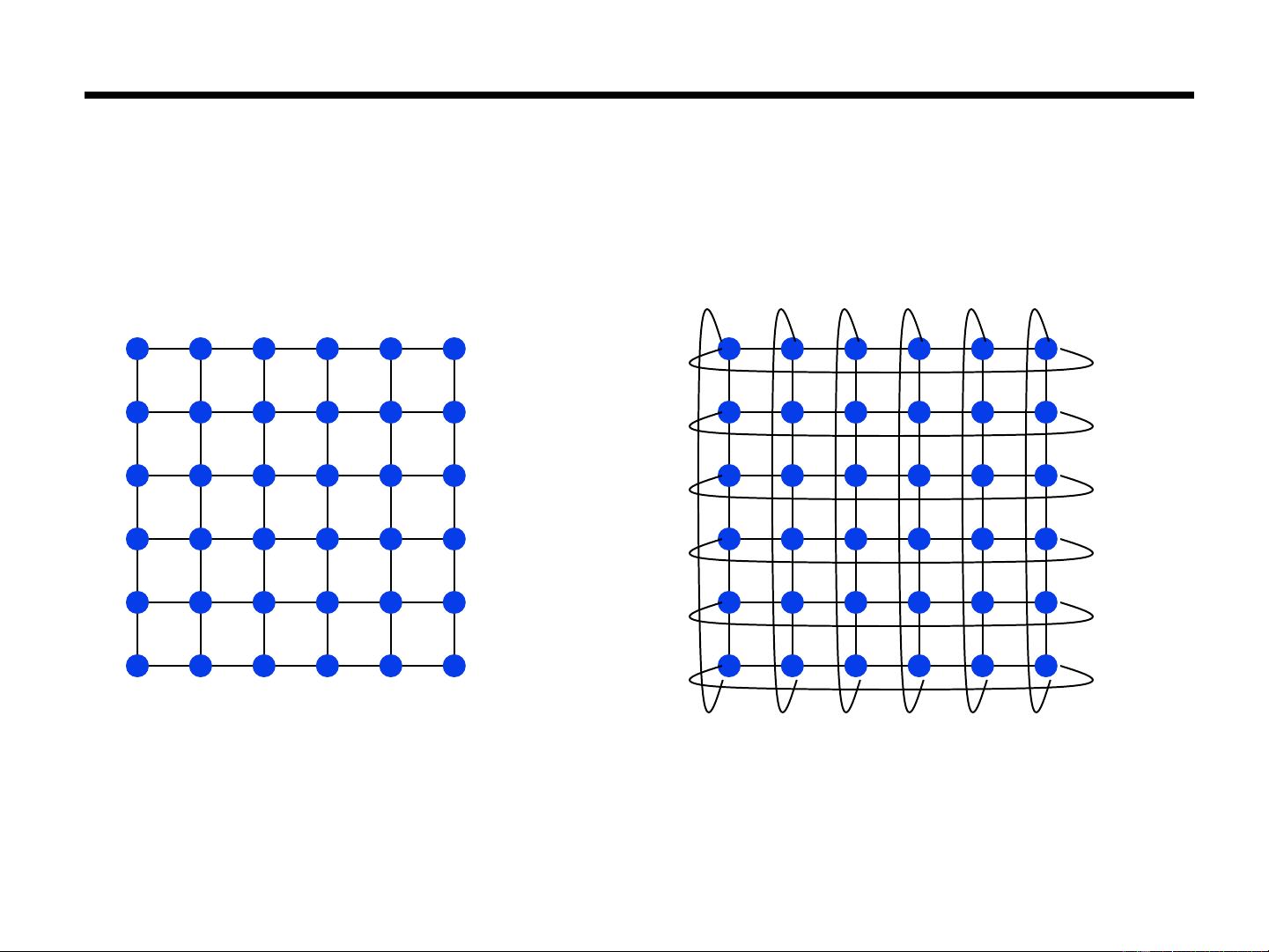

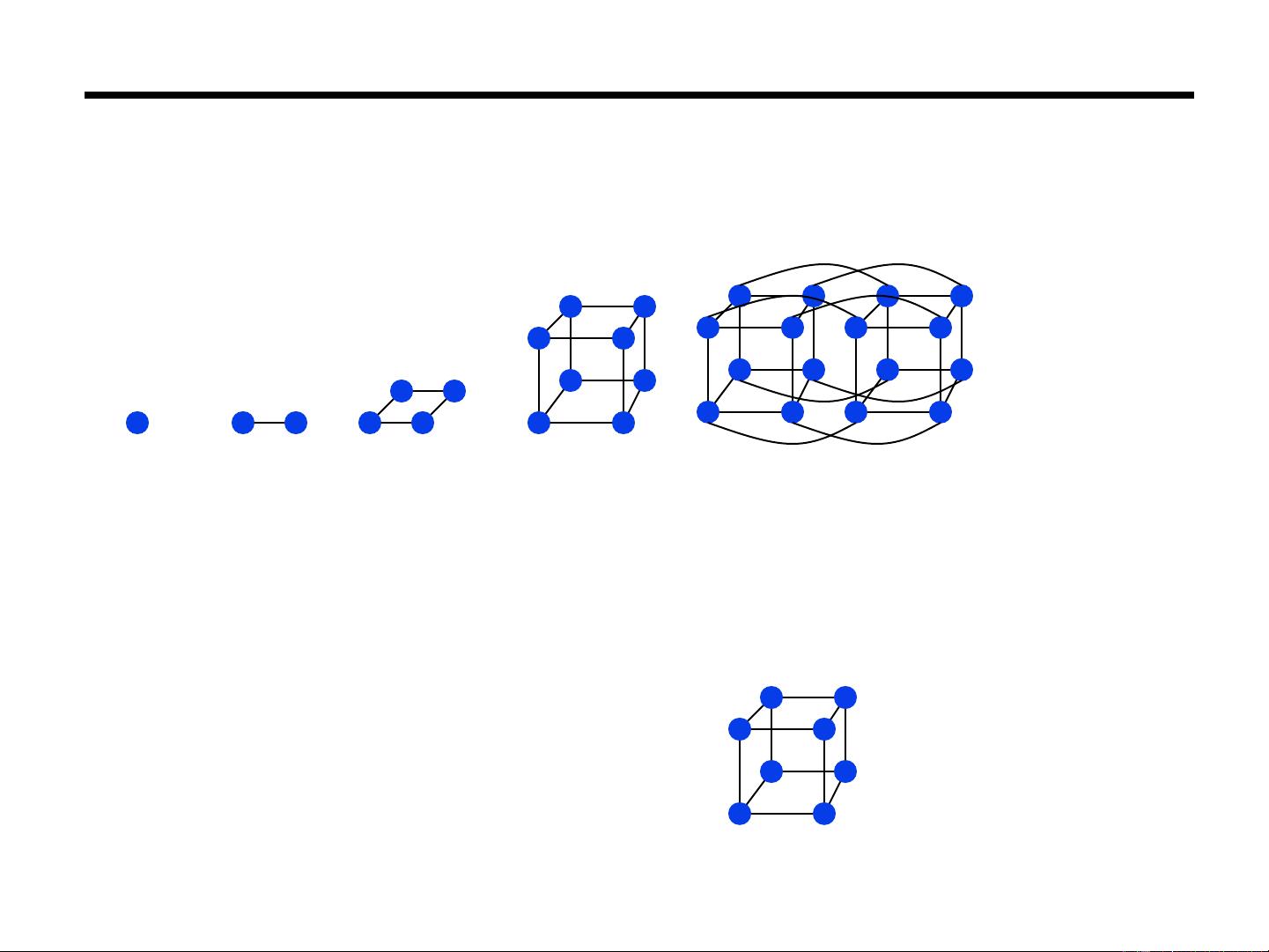

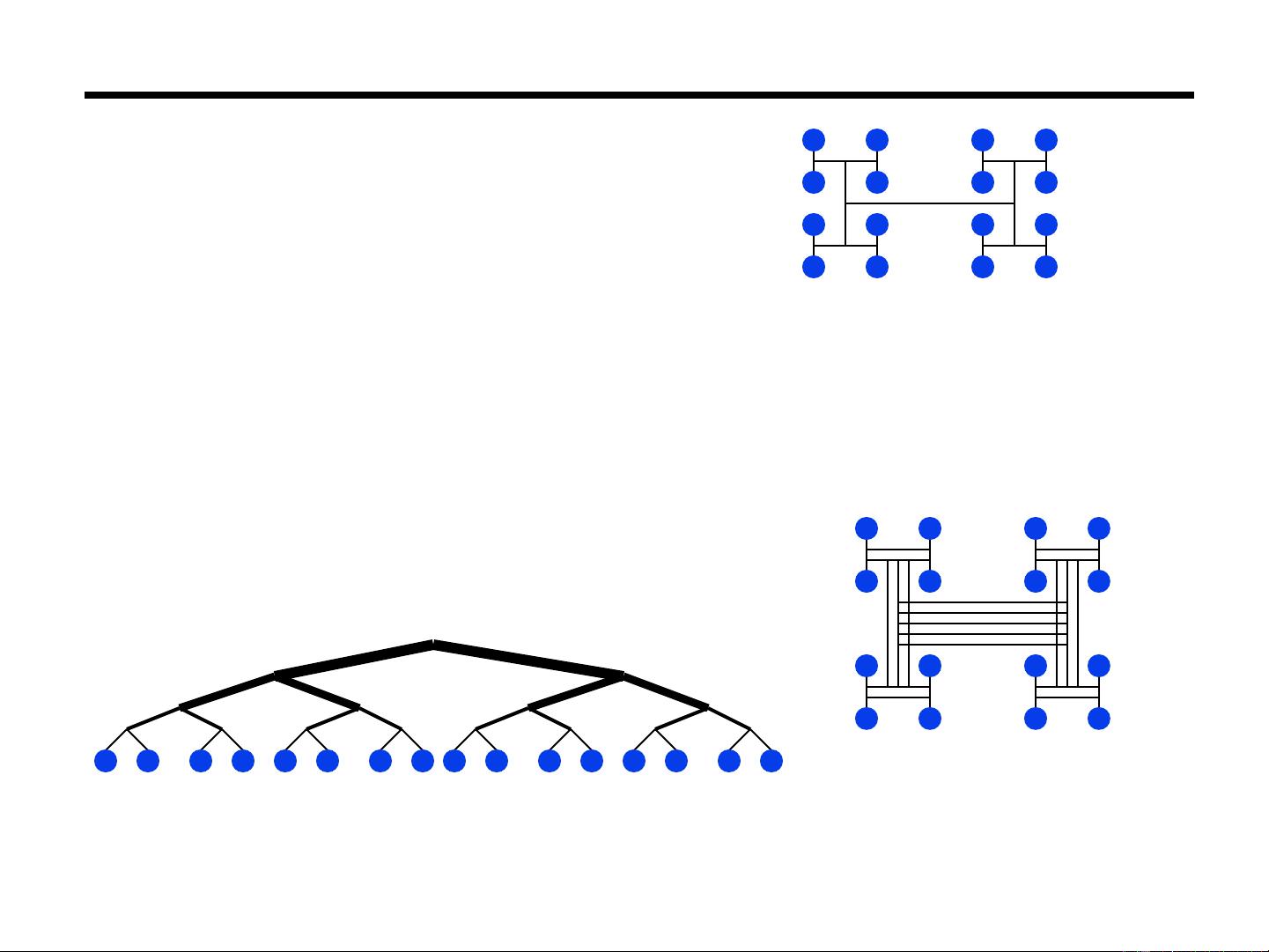

1. 分布式内存架构:这部分将深入讨论分布式内存系统的特性,如处理器之间的通信网络结构,以及这些网络如何影响系统的性能和可扩展性。

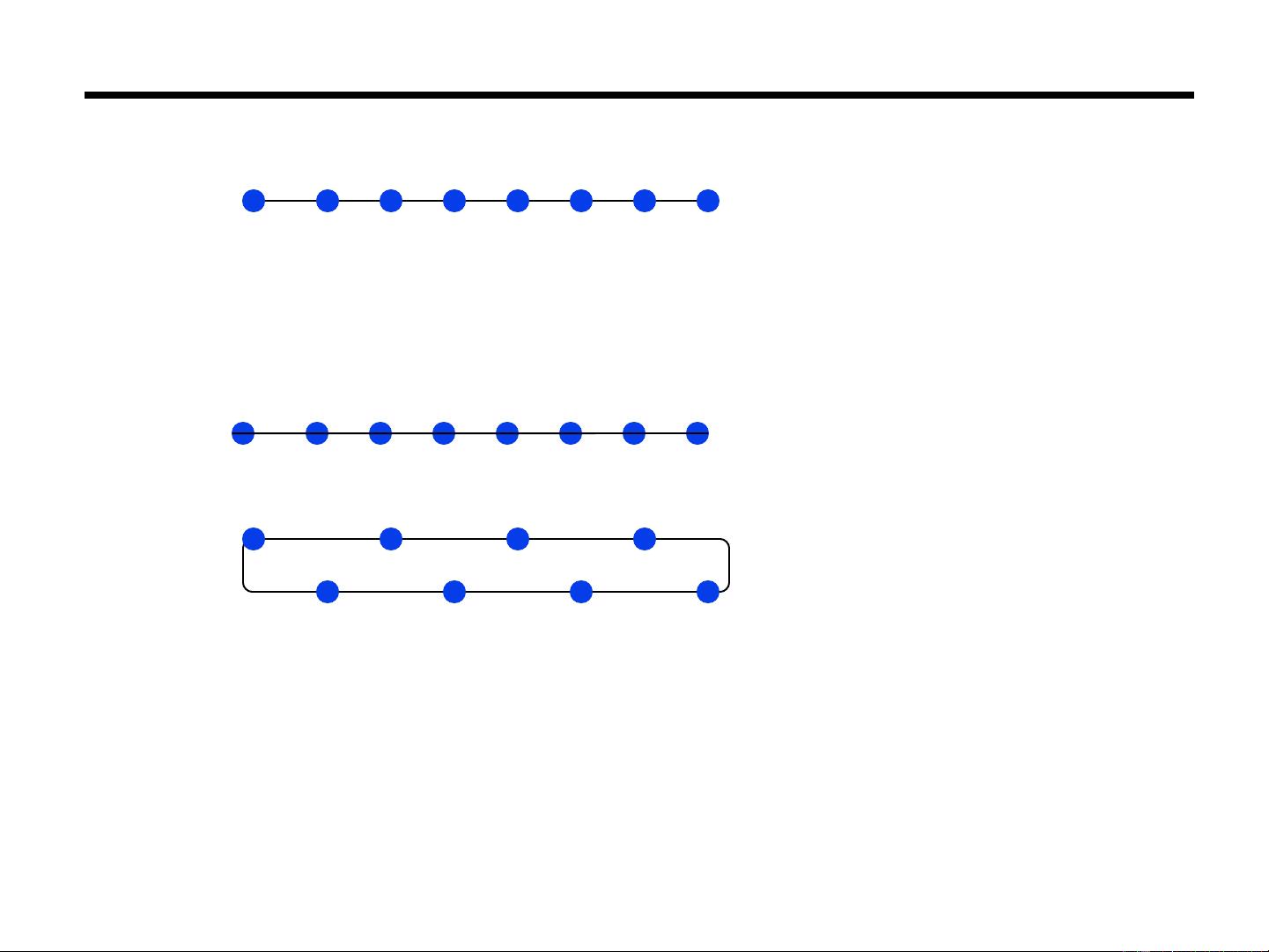

2. 通信网络属性:通信网络的拓扑结构(例如环形、星型、网格等)对通信延迟和带宽有显著影响。此外,还会讨论性能模型,以理解如何评估和预测不同通信操作的性能。

3. 使用消息传递编程分布式内存机器:这是分布式计算中的常见编程模型,其中进程通过发送和接收消息来协调其操作。这一部分会引入消息传递接口(MPI)的基本概念,这是一种广泛使用的标准库,用于编写并行程序。

4. 基本的发送/接收操作:MPI提供了基础的send和receive函数,允许进程间发送和接收数据,这是并行程序中最基本的通信操作。

5. 非阻塞通信:非阻塞通信允许进程在发送或接收消息的同时执行其他任务,提高了效率和并行度。

6. 集体通信操作:除了点对点通信,MPI还提供了诸如广播、收集、扫描和Reduce等集体操作,它们简化了在一组进程中同步和分发数据的复杂性。

通过深入理解和掌握这些概念,开发者能够有效地利用分布式内存系统,编写出高效且可扩展的并行程序,解决大规模计算问题。在实际应用中,理解通信网络的特性和选择合适的编程模型对于优化并行程序的性能至关重要。

2023-06-18 上传

2023-06-18 上传

2023-06-18 上传

2023-06-18 上传

2023-06-18 上传

2023-06-18 上传

卷积神经网络

- 粉丝: 365

- 资源: 8439

最新资源

- R语言中workflows包的建模工作流程解析

- Vue统计工具项目配置与开发指南

- 基于Spearman相关性的协同过滤推荐引擎分析

- Git基础教程:掌握版本控制精髓

- RISCBoy: 探索开源便携游戏机的设计与实现

- iOS截图功能案例:TKImageView源码分析

- knowhow-shell: 基于脚本自动化作业的完整tty解释器

- 2011版Flash幻灯片管理系统:多格式图片支持

- Khuli-Hawa计划:城市空气质量与噪音水平记录

- D3-charts:轻松定制笛卡尔图表与动态更新功能

- 红酒品质数据集深度分析与应用

- BlueUtils: 经典蓝牙操作全流程封装库的介绍

- Typeout:简化文本到HTML的转换工具介绍与使用

- LeetCode动态规划面试题494解法精讲

- Android开发中RxJava与Retrofit的网络请求封装实践

- React-Webpack沙箱环境搭建与配置指南