LightGBM深度解析:原理、优势与实战应用

版权申诉

13 浏览量

更新于2024-06-21

收藏 1.74MB PDF 举报

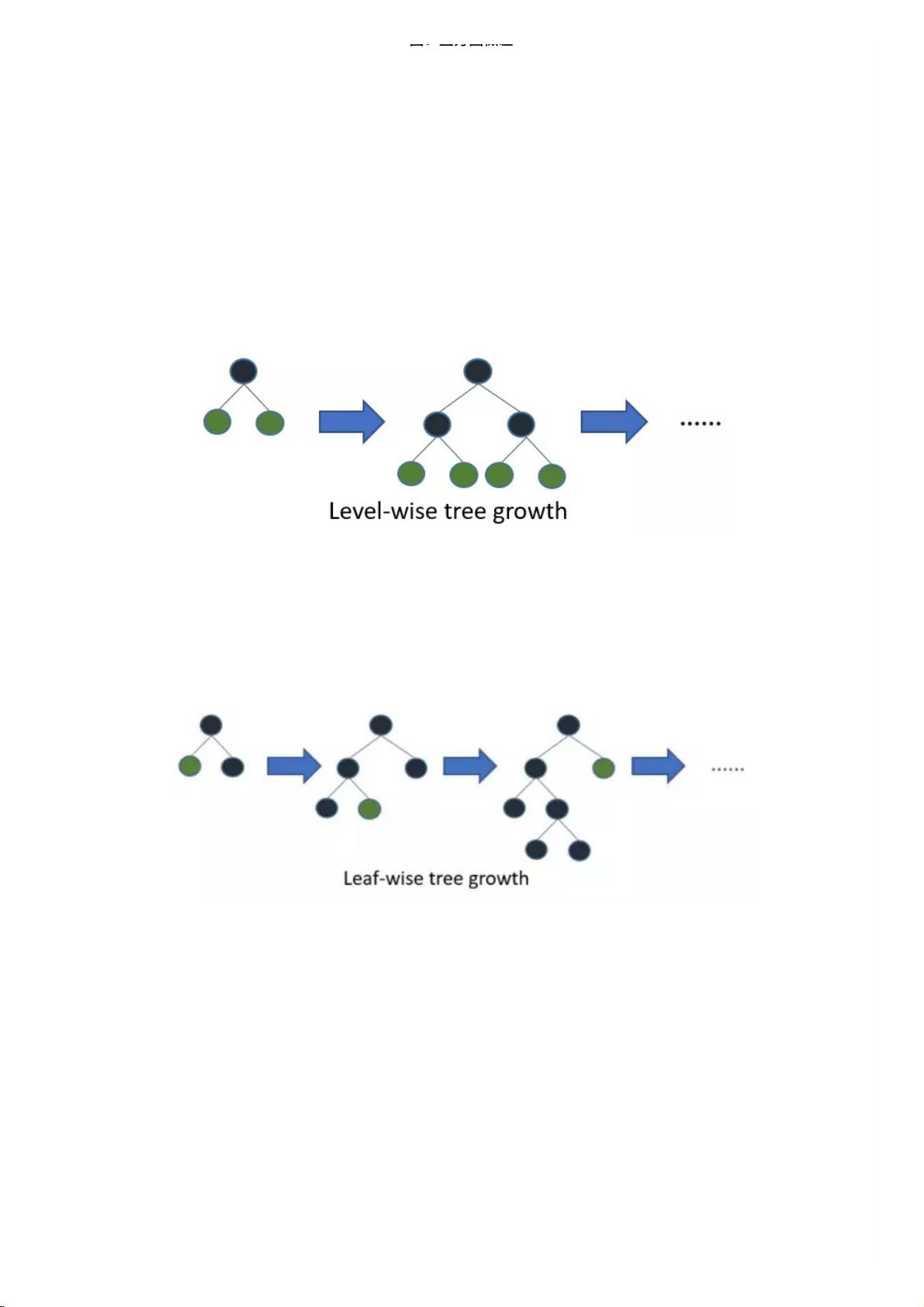

LightGBM最强解析深入探讨了这个高效、并行化的GBDT(梯度提升决策树)框架。首先,我们回顾了GBDT的基本概念,它作为机器学习中的经典模型,以其良好的训练效果和抵抗过拟合的能力,在诸如多分类、点击率预测和搜索排序等领域大放异彩。然而,传统的GBDT在处理大规模数据时面临挑战,因为每次迭代都需要遍历整个数据集,这在内存限制和时间效率上存在瓶颈。

LightGBM正是针对这一问题提出的解决方案。它旨在解决XGBoost(另一个知名GBDT工具)存在的问题,尤其是XGBoost依赖于预排序策略构建决策树,这虽然能精确找到分割点,但带来了显著的空间消耗,因为它需要存储特征值和特征的预排序信息。相比之下,LightGBM通过采用更优化的技术,如利用稀疏性减少内存占用,同时支持并行计算和分布式训练,实现了更快的训练速度和更低的内存需求。

LightGBM的核心优化包括:

1. **列式存储**:它采用了列式而非行式存储数据,减少了内存占用,因为每个特征的值只存储一次,而不是每个样本的所有特征。

2. **特征选择**:LightGBM采用了更聪明的特征选择策略,它仅在构建每个叶子节点时考虑一部分特征,这样既减少了计算量又保持了模型的准确性。

3. **叶子编码**:它使用一种称为“叶子编码”的方法,使得数据在叶子节点的表示更加紧凑,进一步减小内存占用。

4. **并行分发**:LightGBM支持多核并行计算,通过任务分解加速模型训练,特别是在大数据集上显著提高效率。

5. **优化算法**:LightGBM采用了一种新颖的优化算法,比如二阶泰勒展开,提高了模型训练的速度。

总结来说,LightGBM通过这些创新改进,不仅解决了GBDT在处理大规模数据时的性能瓶颈,还提升了模型的训练效率和准确性,使其成为工业级应用中的首选算法之一,特别是在Kaggle等数据挖掘竞赛中占据了主导地位。通过深入理解LightGBM的工作原理和代码实现,数据科学家和工程师可以更好地利用这个强大的工具来应对复杂的机器学习任务。

489 浏览量

2023-12-11 上传

2024-08-29 上传

2023-10-18 上传

2024-08-29 上传

1847 浏览量

2024-08-29 上传

245 浏览量

普通网友

- 粉丝: 1277

- 资源: 5623

最新资源

- 高速电路设计 A Practical Guide to High-Speed Printed-Circuit-Board

- 2006年4月二级C语言笔试试题.doc

- 华为编程规范.pdf

- Tapestry开发指南.pdf

- liferay portlet二次开发宝典

- C#自学笔记(崔北为)

- 一些软件公司的笔试题

- FORTRAN 77

- STATA 面板数据处理

- Beginning PHP and Oracle From Novice to Professional.2007

- C#,深入浅出全接触

- C#.NET 开发者手册

- 2410根文件系统实验

- C# Language Specification

- Flex 3 Cookbook 中文版.pdf

- s3c2410uboot移植实验