K-means聚类算法详解与Python实现

159 浏览量

更新于2024-08-31

1

收藏 334KB PDF 举报

"本文主要介绍了K-means聚类算法的基本概念、原理以及如何使用Python进行实现。"

K-means聚类算法是一种广泛应用的无监督学习方法,主要用于将数据集中的对象按照它们的相似性分成不同的组,即聚类。与分类不同,聚类并不依赖预先存在的标签,而是通过算法自身发现数据的内在结构。K-means算法基于距离度量相似性,认为距离相近的对象更有可能属于同一类。

1. 算法概述

K-means算法的核心在于寻找最佳的K个聚类中心,使得每个数据点到其所属聚类中心的距离平方和最小。通常,我们首先需要指定要创建的聚类数量K。算法初始阶段,随机选择K个数据点作为初始聚类中心。随后,进入迭代过程:

- 分配步骤:计算每个数据点到所有聚类中心的距离,将数据点分配到最近的聚类。

- 更新步骤:重新计算每个聚类的均值,作为新的聚类中心。

- 迭代继续,直到聚类中心不再显著变化或达到预设的最大迭代次数。

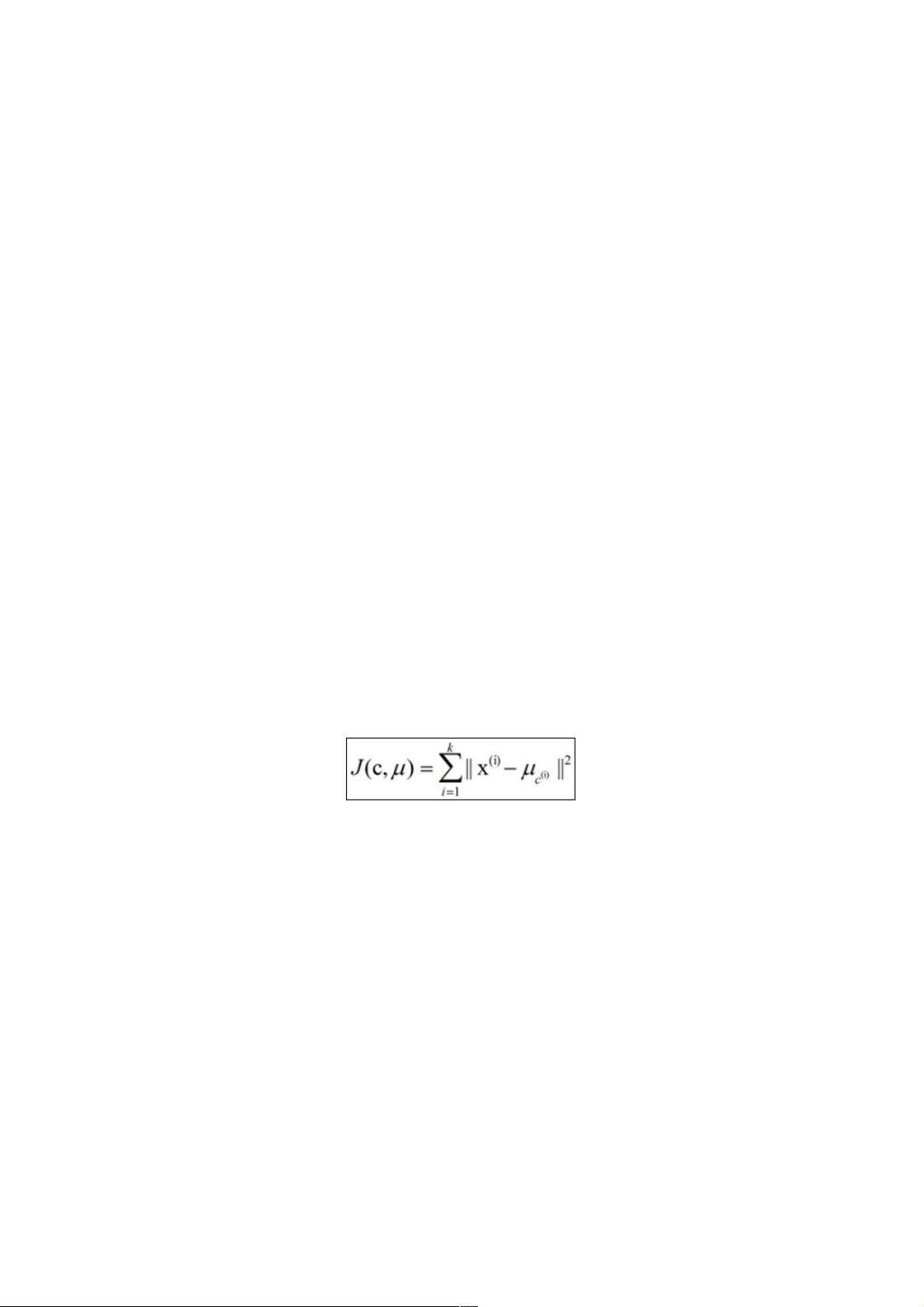

2. 成本函数

K-means算法的目标是最小化聚类误差平方和,也就是所有数据点与其所属聚类中心距离的平方和。这个成本函数可以表示为每个数据点到其所在聚类中心距离平方的总和,再除以数据点总数。通过不断迭代,算法尝试找到一个最小化此误差的聚类划分。

3. Python实现

在Python中,可以使用sklearn库的KMeans类来实现K-means算法。以下是一个简单的代码示例:

```python

from sklearn.cluster import KMeans

import numpy as np

# 假设X是你的数据集

X = np.array([[1, 2], [1, 4], [1, 0],

[4, 2], [4, 4], [4, 0]])

# 创建KMeans实例,指定K值

kmeans = KMeans(n_clusters=2)

# 拟合数据

kmeans.fit(X)

# 预测数据点的聚类

predictions = kmeans.predict(X)

# 打印聚类中心

centers = kmeans.cluster_centers_

print("Cluster Centers:", centers)

```

4. 算法优缺点

K-means算法简单且易于理解,对于大数据集的处理效率较高。然而,它也有一些局限性:

- 对初始聚类中心的选择敏感,可能导致不同的结果。

- 必须预先设定K值,而最佳K值的确定可能较为困难。

- 假设数据分布为凸形,对非凸或者异形的数据集效果不佳。

- 对异常值敏感,少量异常值可能会显著影响聚类结果。

- 只适用于数值型数据,不适用于类别或混合类型数据。

在实际应用中,我们可以通过多次运行K-means并选择最优结果,或者使用其他方法如Elbow Method来确定合适的K值。此外,还可以考虑使用更复杂的聚类算法,如DBSCAN或谱聚类,来应对K-means的不足。

2015-07-18 上传

2020-09-19 上传

2022-07-15 上传

点击了解资源详情

2023-06-03 上传

2021-09-11 上传

2022-11-29 上传

2020-09-16 上传

weixin_38669618

- 粉丝: 7

- 资源: 912

最新资源

- GoogleMaterialDesignIcons(iPhone源代码)

- 电信设备-基于邻域信息和平均差异度的Kmeans初始聚类中心优选方法.zip

- i-player:vuejs + vuetify ui编写的一套在线音乐播放器,接口来自第三方netease-cloud-music api

- MVCInputMask:使用 ASP.NET MVC 和服务器端属性动态屏蔽输入的测试项目

- 战舰

- MoodCatcher:通过丰富多彩的可视化显示您的情感和情感分析的日记

- superdesk:Superdesk是一个端到端的新闻创建,制作,策展,分发和发布平台

- Android 搜索内容保存历史记录

- netology-java-2.6-1

- 学习兴趣+数学游戏+数学建模+计算机学生学习动力

- 易语言-考试倒计时

- Python_RT:该程序利用Python的可变列表数据类型作为基础,在编译时通过光线跟踪渲染图像文件

- Vyrtex Quick Add-crx插件

- SpeechCast:由Yoshi先生创建的SpeechCast的略微附加版本

- TinEye-Java-API:TinEye Java API使用公钥和私钥对按图像URL搜索

- whereareyou:你在哪!?