西南交大机器学习实验9:决策树Bagging集成手写数字识别

124 浏览量

更新于2024-08-03

收藏 155KB DOCX 举报

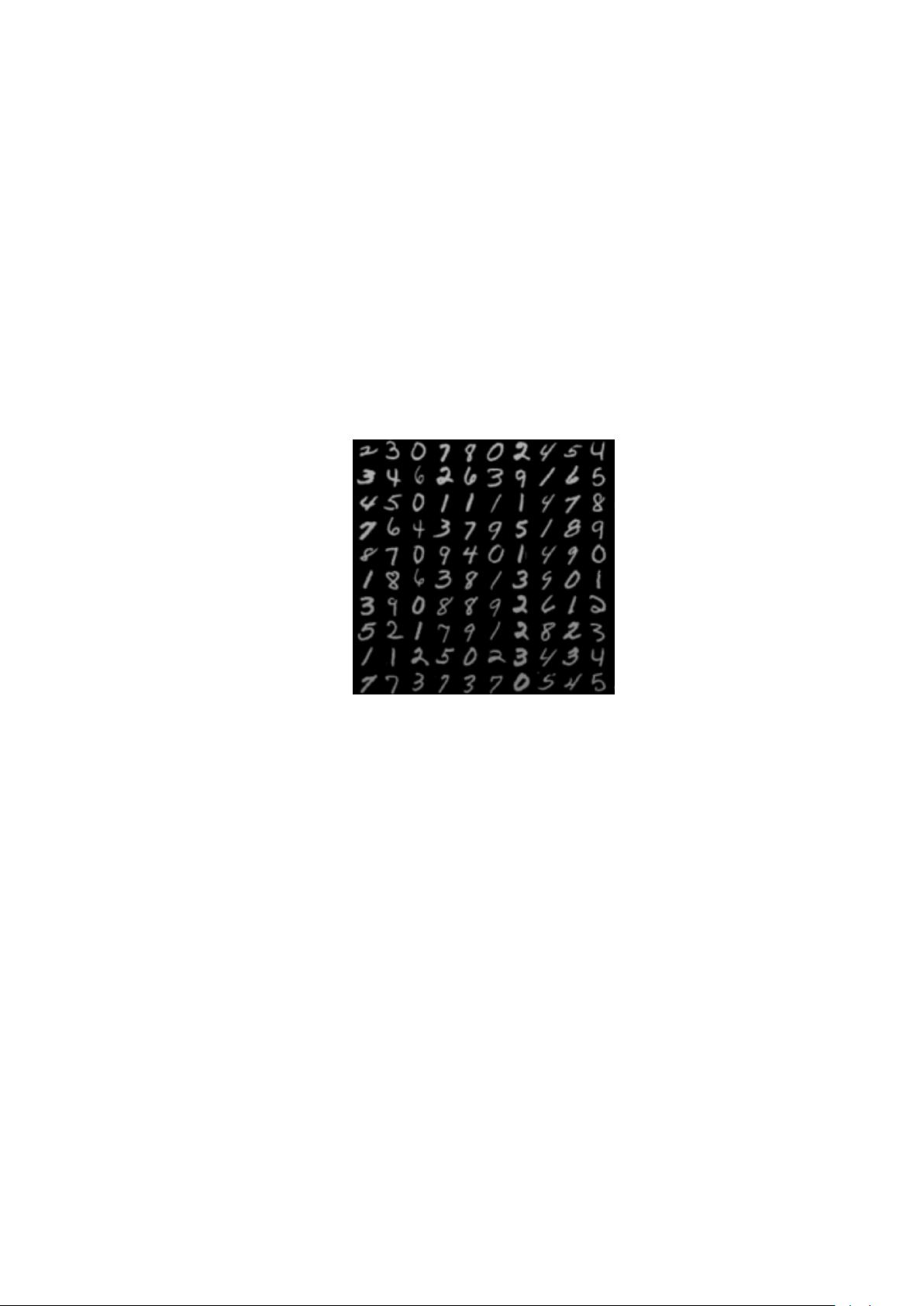

本实验是西南交通大学机器学习课程中的第九个实验,主题是 Bagging 集成学习,主要目标是通过参考随机森林算法,利用决策树作为基础学习器,构建一个集成模型来处理多分类任务。实验的核心目的是理解并实现 Bagging 技术如何通过组合多个弱分类器(在这里是决策树)来提高预测性能,特别是针对手写数字识别数据集。

实验的具体要求包括:

1. **编程实现**:学生需要使用 Python 语言,结合 numpy、pandas、matplotlib 和 sklearn 库来编写代码。这些库分别用于数据处理、可视化以及机器学习模型的构建。

2. **数据预处理**:实验使用的手写数字识别数据集分为训练集和测试集,首先通过 pandas 读取数据,然后将数据转换为 numpy 数组,对测试集的特征进行归一化处理。

3. **构建随机森林**:实验的核心是创建随机森林模型。学生需设置基模型为决策树,其中划分属性指标选择信息熵,随机选取的属性子集数目设为 50。对于不同的决策树数量(范围为 1 到 20),依次训练模型,记录每个模型在测试集上的精度。

4. **性能分析**:最后,学生需要绘制随机森林精度随基模型数量增加的变化曲线,观察随着决策树数量的增长,整体模型性能的变化趋势。

实验的关键代码部分包括数据读取、模型训练和评估、以及精度曲线的绘制。在代码中,学生需要重复训练 n 个决策树模型,每次从训练集中随机抽取样本进行训练,然后将训练好的模型添加到列表中。对于测试集,使用所有训练好的模型进行投票或平均预测,得到最终的预测结果,并记录精度值。

完成这个实验后,学生将不仅加深对决策树和 Bagging 方法的理解,还会提升编程实现和数据处理的能力,同时能够直观地看到集成学习模型如何通过多样性提升预测性能。此外,该实验也有助于培养数据可视化和模型评估的技能,这对于在实际工作中解决复杂的分类问题至关重要。

2023-07-17 上传

2023-07-17 上传

2023-07-17 上传

102 浏览量

2023-07-17 上传

2023-07-17 上传

2023-07-17 上传

2023-07-17 上传

2023-07-17 上传

老学长~

- 粉丝: 6

- 资源: 25

最新资源

- 校园优秀作品展示网页模板

- 毕业设计&课设-基于matlab的VLC系统仿真程序.zip

- 相关大数据框架内容.zip

- quizgrader:R套件,可自动进行测验评分和管理

- Quick Switch-crx插件

- 毕业设计&课设-文章题目为“通信时延和多址条件下的容错周期性事件触发共识”的MATLAB仿真代码….zip

- ReactNativeSample:React Native示例程序

- 橘黄色教育信息网页模板

- ColorGrad:这是供网站开发人员搜索颜色的网站

- MRF8P9040N_1_wrk.zip

- 华硕 P8H67D-M PRO驱动程序下载

- Randomizer-crx插件

- appresent:用于动画、缩放演示的 JavaScript 框架

- msu_prak:3个学期

- PyTestReport:PyTestReport

- HR Desk助手-crx插件