PCA降维详解:无监督学习中的主成分分析

145 浏览量

更新于2024-09-01

1

收藏 159KB PDF 举报

"无监督学习中的PCA降维技术是一种常用的数据分析方法,它通过转化高维数据为低维表示,简化复杂数据集,同时保留关键信息。PCA算法是这一过程的核心,广泛应用于数据可视化、数据压缩和预处理。在Python中,可以利用sklearn.decomposition库来实现PCA算法。"

在机器学习领域,无监督学习是处理未标记数据的一种方法,目的是发现数据内在的结构和模式。PCA(主成分分析)是无监督学习中的一个关键降维技术。它将具有相关性的高维数据转换为一组线性无关的低维变量,这些新变量被称为主成分,它们是原始数据的线性组合,并按照解释的方差大小排序。

PCA的步骤包括:

1. 数据预处理:对原始数据进行标准化,确保所有特征在同一尺度上。

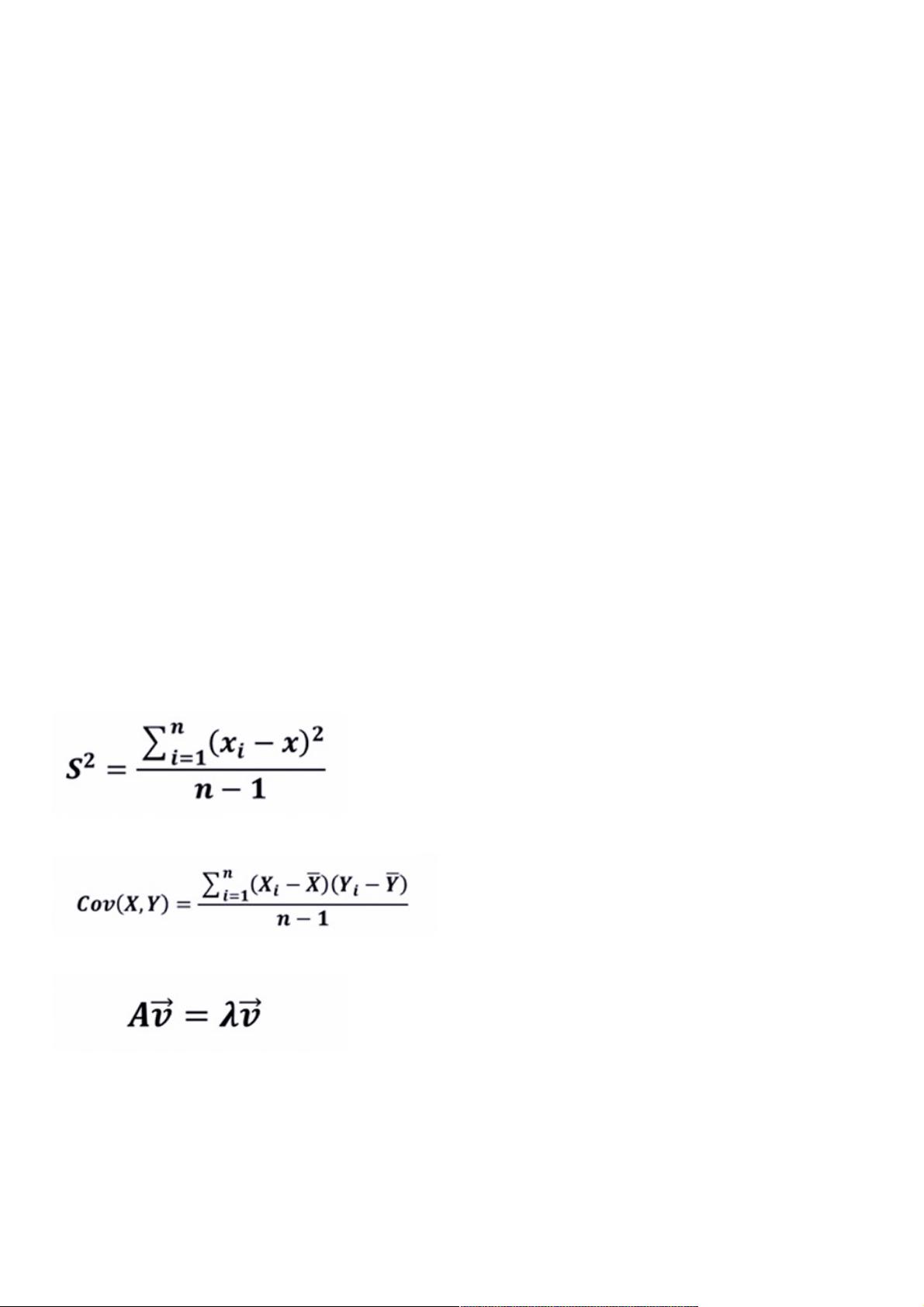

2. 计算协方差矩阵:这有助于理解不同特征之间的关系。

3. 求解特征向量和特征值:协方差矩阵的特征向量对应于数据变换的方向,特征值则反映了数据在该方向上的变化程度。

4. 选择主成分:按照特征值的大小选取前k个主成分,k是目标的降维维度。

5. 合成低维表示:使用选定的主成分重新构建数据集,形成新的低维空间。

主成分分析的作用包括:

- 降维:减少数据处理的复杂性,提高计算效率。

- 可视化:将高维数据映射到二维或三维空间,便于直观理解。

- 数据压缩:通过保留主要信息,减少存储需求。

- 回归分析:使用主成分作为新变量,构建更简单的模型。

在Python中,使用sklearn库的PCA模块可以轻松实现PCA降维。例如,导入PCA类后,可以通过调用fit()方法拟合数据,transform()方法用于转换数据,而explained_variance_ratio_属性则返回每个主成分解释的总方差的比例。

```python

from sklearn.decomposition import PCA

# 创建PCA对象

pca = PCA(n_components=2)

# 拟合和转换数据

transformed_data = pca.fit_transform(original_data)

# 查看主成分解释的方差比例

variance_ratios = pca.explained_variance_ratio_

```

PCA的实施需要考虑几个关键参数,如`n_components`,它指定了要保留的主成分数量,可以根据保留的总方差比例或实际应用需求来设定。此外,PCA还支持其他参数,如`svd_solver`用于选择不同的奇异值分解算法,以及`whiten`,它可以使主成分具有单位范数,适用于后续的分类或回归任务。

PCA是无监督学习中一种强大的工具,它通过对高维数据进行降维处理,帮助我们揭示数据的结构,简化分析流程,同时也为数据的可视化和理解提供了便利。在实际应用中,PCA常常与其他无监督学习算法如NMF(非负矩阵分解)和LDA(线性判别分析)结合使用,以应对不同场景的需求。

2022-09-21 上传

点击了解资源详情

点击了解资源详情

2022-07-14 上传

2021-01-20 上传

2022-09-19 上传

点击了解资源详情

2021-09-29 上传

weixin_38500090

- 粉丝: 4

- 资源: 963

最新资源

- 算法设计--蛮力法&&分治法求最近对问题(C++实现).rar

- EvaluationMetrics:标准信息检索评估指标实施 - Recall、Precision 和 MAP

- 基于python开发的工商数据免费软件v1.1.2下载

- HERMESHD:HERMESHD是用于纳米级流体模拟的不连续Galerkin 3D波动流体力学代码

- g11_metroevents

- zksync_with_notes:带有注释的zksync代码的分支

- OpenCV-python haar分类器人脸识别

- 算法-树形结构- 树与二叉树- 树的重心.rar

- calculator.zip

- PracticeRepository:当然是为了练习

- SmartyDocB-开源

- StyleTransfer-master.zip

- Price Tracker - Auto Buy, Price History-crx插件

- 算法-区间合并(信息学奥赛一本通-T1236).rar

- TrainClustering:机器学习问题

- ZQ_VirtualAD