机器学习特征工程:详解WOE编码原理、计算及实战应用

版权申诉

184 浏览量

更新于2024-08-08

收藏 508KB DOCX 举报

在机器学习的数据科学领域中,特征工程是一项关键任务,特别是在处理离散变量时。WOE编码(Weight of Evidence)是一种特殊的编码方法,用于有监督的学习场景,其目标是将离散的、非数值化的特征转化为可以被模型理解和处理的连续变量。WOE编码的核心思想是通过衡量某个特征值对于预测结果的影响,即类别集中度的改变来赋予每个取值一个权重分数。

(1) 定义与工作原理:

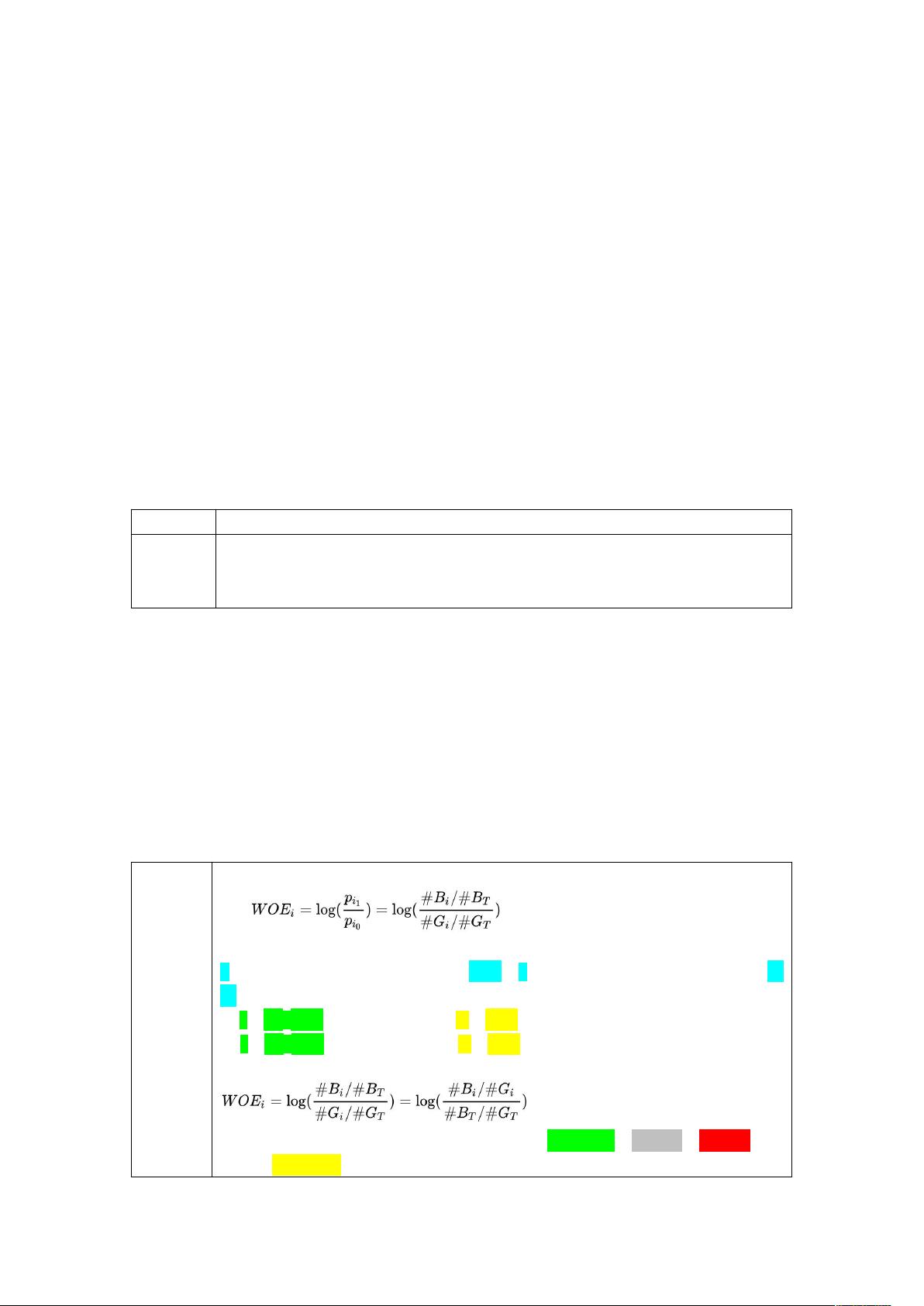

WOE本质上是对每个特征值进行排序,根据它在预测目标变量(如坏账率)中的分布情况计算权重。公式通常表示为:WOE = ln((Bad Rate for Group A / Bad Rate for Overall Population)),其中,Bad Rate是指特定组别中的负面事件发生率。WOE值越大,说明该特征值对于区分两类(例如,好客户与坏客户)的贡献越大。

(2) 案例理解:

通过实例,我们可以直观地看到WOE如何作用。例如,如果一个分箱中的坏客户比例远高于总体比例,那么这个分箱的WOE值就会较高,因为这表明该分箱的特征值对于预测坏账具有更强的指示力。

(3) 技术深度思考:

- WOE编码解决了数值型变量不能直接输入逻辑回归等模型的问题,通过非线性转换将其映射到近似线性空间,使模型更容易理解和优化。

- 评分卡模型中,WOE编码简化了业务人员对风险评估的理解和实施,他们可以根据模型提供的评分直接计算客户的信用风险。

(4) 选择理由:

采用WOE编码的原因在于它能够将类别型变量转化为逻辑回归所需的数值型输入,同时保持了特征之间的线性关系,从而提高模型的预测性能。

(5) 优势分析:

- 提升模型准确性:WOE编码针对逻辑回归这类模型的特性进行了优化,有助于提升模型在处理离散变量时的预测能力。

- 易于理解和应用:评分卡形式直观,使得业务人员能够方便地评估客户风险,无需深入理解复杂的模型细节。

- 反映变量贡献:通过WOE值,可以分析每个特征值对于风险预测的具体影响。

- 可分析相关性:编码后的连续变量便于进行进一步的统计分析和特征选择。

WOE编码在机器学习的特征工程中扮演着重要的角色,尤其是在评分卡模型中,它的优势在于将复杂性降低,使得非专业人士也能有效地应用到实际业务中,提高了模型的实用性和解释性。

点击了解资源详情

点击了解资源详情

点击了解资源详情

2020-09-18 上传

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

一个处女座的程序猿

- 粉丝: 126w+

- 资源: 59

最新资源

- 制作VC++启动界面——可显示图片的关于窗口

- Comprice:trade_mark: - 价格比较-crx插件

- webchallenge-vanillaJS

- 基于pytorch的图像修复校准

- software:软件

- GDataDB:Net的Google Spreadsheets的类似于数据库的界面

- hall_admin:我在GitHub上的第一个存储库

- Programmazione_di_Rete:网络编程项目 - Java RMI(罚款)

- vfs dropbox plugin:适用于Apache Commons VFS的Dropbox插件-开源

- YUV2RGB.dll YUV转换RGB算法的API封装

- Alitools Shopping Assistant-crx插件

- JinShop:Minecraft有趣而高效的PythonFlask商店

- googleImageSearch:使用谷歌图像搜索api并在网格交错视图中显示结果

- 免费倒酒:调酒师工具-图灵学校FEE计划MOD 3的Solofinal项目

- Windows日志外发配置

- 速卖通图片搜索-crx插件