深度学习焦点:卷积神经网络详解与应用

需积分: 16 49 浏览量

更新于2024-07-16

收藏 737KB PDF 举报

"这篇文档是关于卷积神经网络(CNN)的研究综述,详细探讨了CNN的历史、结构、改进模型以及在深度学习领域的应用。文章由周飞燕、金林鹏和董军等人撰写,他们专注于计算机辅助诊断和机器学习等领域。"

卷积神经网络(CNN)是深度学习的重要组成部分,其设计理念源于生物视觉系统,尤其是动物视觉皮层的组织结构。自上世纪90年代以来,随着计算能力和数据量的显著提升,CNN在许多领域取得了重大突破,如图像识别、目标检测、自然语言处理(NLP)、语音识别和语义分析。

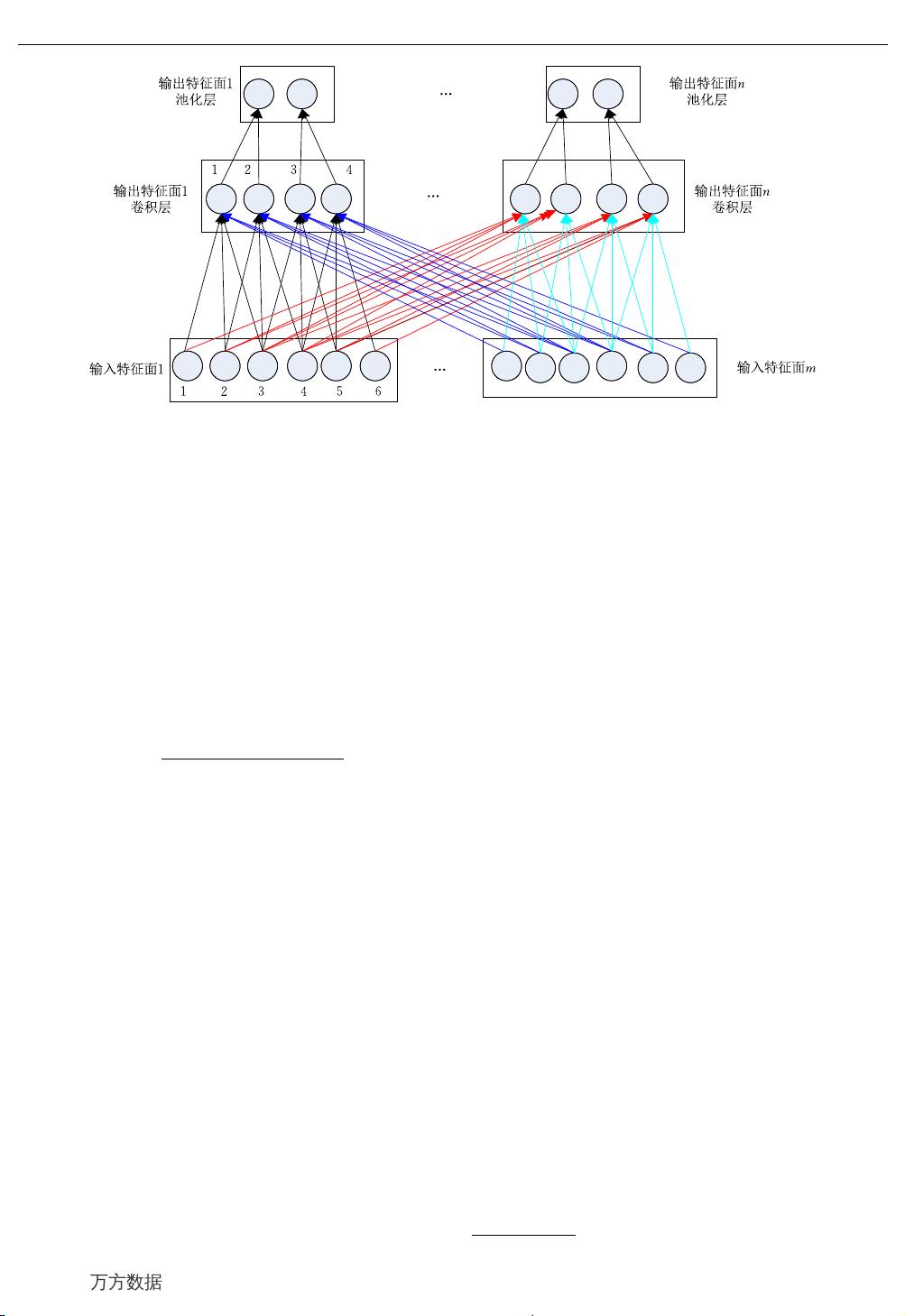

CNN的核心特性包括局部连接、权值共享和池化操作。局部连接允许网络只关注输入数据的小部分区域,降低了复杂性;权值共享则减少了需要训练的参数数量,有助于防止过拟合;而池化层则通过下采样进一步减小数据维度,增强了模型的不变性和鲁棒性。

CNN通常由卷积层、池化层和全连接层组成。卷积层通过滤波器提取图像特征,池化层则用于降维和特征选择,全连接层则将前面层的特征映射转化为分类或回归输出。这些层的不同组合使得CNN能够适应各种任务需求。

文中还提到了CNN的改进模型,如网中网(Net-in-Net)模型,它引入微网络作为基本单元,增强了模型的表达能力;空间变换网络(STN)允许模型动态地调整输入的空间布局,提高了模型的灵活性。

在训练方面,CNN既可以采用监督学习,通过大量带标签的数据进行训练,如图像分类和人脸识别任务;也可以采用无监督学习,通过自我学习来发现数据的内在结构。随着开源社区的发展,许多工具和框架,如TensorFlow、PyTorch和Keras,为CNN的实现提供了便利。

CNN的成功应用还包括自动驾驶、医学影像分析、文本情感分析等,极大地推动了人工智能(AI)的进步。在未来,随着硬件加速技术的进步和更多领域的大规模数据集的出现,CNN有望在更多复杂任务中发挥关键作用,继续引领深度学习的发展。

2020-04-27 上传

2022-08-03 上传

2021-09-25 上传

2021-09-25 上传

2021-09-25 上传

2021-09-25 上传

2021-09-26 上传

shaquexlxfreedom

- 粉丝: 14

- 资源: 84

最新资源

- Manning - Spring in Action (2007).pdf

- 食品类公司网站建设方案

- C# 日期函数 string.Format

- SAP财务成本知识库.pdf

- 很好的 学校网站方案

- 第11界全国青少年信息学奥林匹克联赛初赛试题(C语言)

- 协会学会网站建设方案

- 网上书店管理系统详细分析

- 软件需求分析 图形解释的

- S3C44B0X 中文数据手册

- 基于FLAASH的多光谱影像大气校正应用研究

- 基于J2EE的Ajax宝典.pdf

- 如何发表SCI论文,希望对大家有帮助!

- c# 提供面试题大全

- C++ Core 2000

- The MIT Press Essentials of Programming Languages 3rd Edition Apr 2008