深入解析Hadoop源代码:分布式计算基石

"Hadoop源码分析"

Hadoop作为开源的分布式计算框架,其核心在于分布式文件系统HDFS(Hadoop Distributed File System)和并行计算模型MapReduce。Hadoop的出现,受到了Google早期的一些关键性技术如Chubby、GFS、BigTable和MapReduce的启发,并在Apache社区发展成为一套成熟的解决方案。

Chubby是Google的一种分布式锁服务,对应开源社区的实现是ZooKeeper,它提供了高可用性和一致性保证。GFS(Google File System)是Google的分布式文件系统,Hadoop中的HDFS(Hadoop Distributed File System)则实现了类似的功能,用于存储大规模数据。BigTable是Google的分布式表格存储系统,Hadoop生态中的HBase则扮演了类似角色,支持实时查询和大数据存储。MapReduce是一种处理和生成大规模数据集的编程模型,Hadoop的MapReduce组件则实现了这一模型,使得开发者能方便地编写处理海量数据的程序。

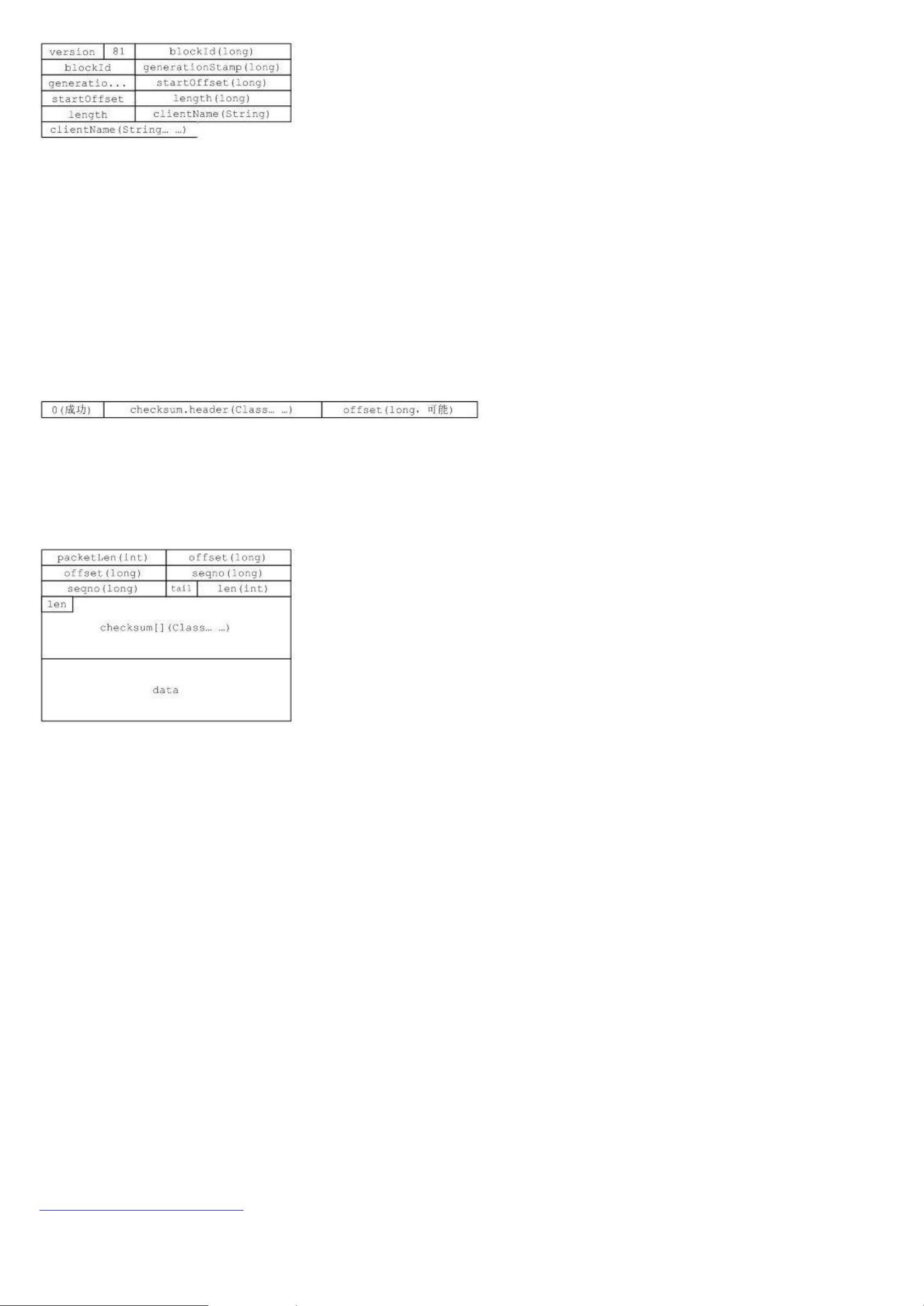

在Hadoop的源码分析中,HDFS是基础,它提供了一种可靠且可扩展的数据存储机制,通过数据块复制保证容错性。HDFS的API允许应用程序透明地访问分布式存储,同时支持多种底层文件系统,包括本地文件系统和云存储服务如Amazon S3。

MapReduce是Hadoop处理数据的主要方式,它将大型任务分解为可并行执行的Map任务和Reduce任务。Map阶段将输入数据拆分为键值对,应用用户定义的函数进行处理;Reduce阶段则汇总Map阶段的结果,生成最终输出。MapReduce的实现涉及多个组件,包括JobTracker负责任务调度,TaskTracker执行实际的任务,以及Task之间的通信机制。

Hadoop的包间依赖关系复杂,其中conf包用于读取系统配置,fs包抽象了不同文件系统的操作。这些包的相互依赖形成了复杂的网络结构,增加了源码分析的难度。然而,Hadoop的关键部分主要集中在MapReduce和HDFS相关的包中,例如dfs、io、mapred等,这些都是深入理解Hadoop工作原理的重点。

Hadoop还提供了各种工具,如DistCp用于分布式文件复制,archive用于创建数据归档。此外,Hadoop生态还包括诸如Hive这样的数据仓库工具,它基于HDFS和MapReduce,提供SQL-like接口,用于大数据分析和报表生成。

总结来说,Hadoop源码分析涵盖了HDFS的分布式存储机制、MapReduce的并行计算模型,以及相关组件和工具的实现细节。理解这些核心组件的内部工作原理,对于优化Hadoop性能、开发分布式应用程序,以及深入学习大数据处理技术至关重要。

773 浏览量

6675 浏览量

2022-03-12 上传

2024-09-10 上传

2023-07-13 上传

2024-01-06 上传

2023-06-13 上传

2024-06-28 上传

2023-05-09 上传

hgp2012

- 粉丝: 0

- 资源: 3

最新资源

- NIST REFPROP问题反馈与解决方案存储库

- 掌握LeetCode习题的系统开源答案

- ctop:实现汉字按首字母拼音分类排序的PHP工具

- 微信小程序课程学习——投资融资类产品说明

- Matlab犯罪模拟器开发:探索《当蛮力失败》犯罪惩罚模型

- Java网上招聘系统实战项目源码及部署教程

- OneSky APIPHP5库:PHP5.1及以上版本的API集成

- 实时监控MySQL导入进度的bash脚本技巧

- 使用MATLAB开发交流电压脉冲生成控制系统

- ESP32安全OTA更新:原生API与WebSocket加密传输

- Sonic-Sharp: 基于《刺猬索尼克》的开源C#游戏引擎

- Java文章发布系统源码及部署教程

- CQUPT Python课程代码资源完整分享

- 易语言实现获取目录尺寸的Scripting.FileSystemObject对象方法

- Excel宾果卡生成器:自定义和打印多张卡片

- 使用HALCON实现图像二维码自动读取与解码