Fast-MoCo:组合补丁加速自监督学习的对比学习

176 浏览量

更新于2024-06-19

收藏 19.36MB PDF 举报

"Fast-MoCo:基于组合补丁的对比学习提速自监督学习"

自监督学习是当前计算机视觉领域中的一个重要研究方向,尤其在对比学习方面取得了显著的成就。对比学习的方法通过区分不同实例的嵌入,使得正样本对之间的距离更接近,而负样本对之间的距离更远,以此来学习表示。MoCo(Momentum Contrast)是一种对比学习框架,它通过动量编码器保持一个大的负样本库,以增强模型的学习能力。

然而,现有的自监督学习方法通常需要大量的训练周期,例如MoCo v3可能需要800个训练周期才能达到理想的效果。这不仅对学术研究造成负担,也限制了自监督学习的快速迭代和发展。针对这一问题,Fast-MoCo提出了一种新的解决方案。

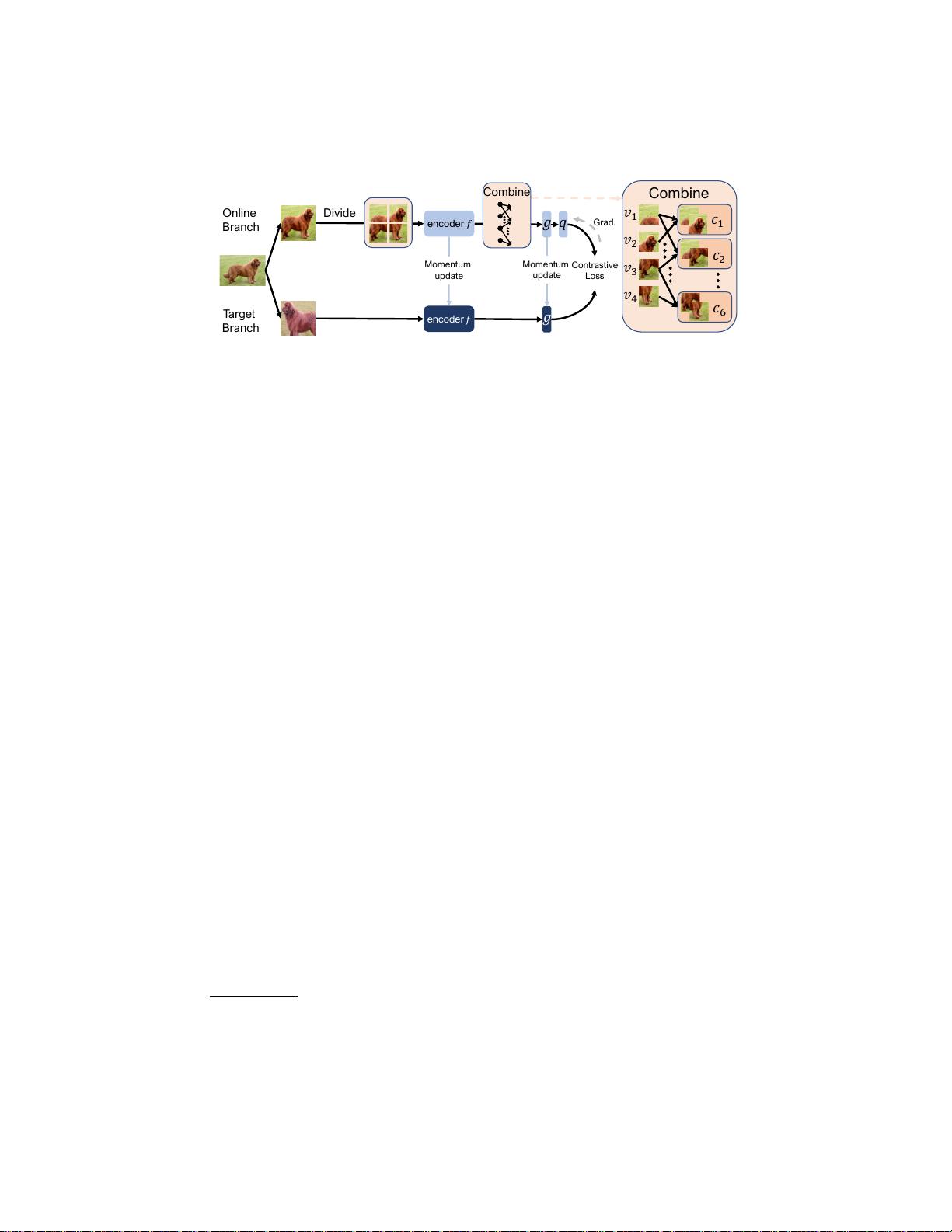

Fast-MoCo的核心创新在于利用组合补丁来构建多个正样本对。传统的对比学习通常从两个不同的增强视图中仅生成一个正样本对,而Fast-MoCo通过组合来自这两个视图的不同补丁,生成了丰富的正样本对,从而在几乎不增加计算成本的情况下,提高了监督信号的多样性。这种方法显著提升了学习效率。

实验结果显示,Fast-MoCo在仅100个训练周期后就能达到73.5%的线性评估准确性,这与MoCo v3经过800个周期训练后的性能相当。继续训练200个周期后,准确率进一步提升至75.1%,与当前最先进的方法相比肩。此外,Fast-MoCo在多个下游任务上的表现也验证了其有效性。

Fast-MoCo的提出,不仅为自监督学习的训练速度设定了新的标准,也为未来的研究开辟了新的方向。它展示了如何通过改进对比学习的采样策略,提高模型的训练效率,同时也降低了对大规模训练资源的需求。这使得研究人员能够更快地探索和优化自监督学习算法,推动整个领域的进步。

Fast-MoCo的源代码和预训练模型已在GitHub上公开,供研究者参考和使用,进一步促进了自监督学习的社区合作和研究发展。

点击了解资源详情

2021-05-29 上传

894 浏览量

128 浏览量

2021-06-03 上传

2021-02-12 上传

点击了解资源详情

点击了解资源详情

cpongm

- 粉丝: 5

- 资源: 2万+

最新资源

- CStrAinBP:2 个单元格串的重叠元素。 比 INTERSECT/ISMEMBER/SETDIFF 快 10-20 倍。-matlab开发

- SecKill-System:一个秒杀抢购项目:分别提供MySQL乐观锁,Redis分布锁和ZooKeeper分布锁共3种方案

- rt-thread-code-stm32f103-yf-ufun.rar,yf-ufun STM32F103 是优凡

- Gra_w_zgadywanie_liczb_2

- shuaishuai-book

- KaanBOT:KaanBOT是一款适度有趣的不和谐机器人

- ARFlower:AR花

- 建筑公司项目部施工管理制度汇编(流程图、岗位职责)

- 实现reload按钮效果源码下载

- PDFBookmark-1.0.2-final.zip

- 行间拖拽插件

- SFACC:阿西西圣法兰西斯天主教会加拉迪玛瓦网站

- CAD图块素材之电视背景墙、玄观、书柜详图

- API:GitHub上Viva Wallet开源项目的索引

- chokidar-cli:快速的跨平台cli实用程序,可监视文件系统的更改

- book_project