卷积神经网络CNN详解:从数学到深度学习应用

下载需积分: 9 | PDF格式 | 2.25MB |

更新于2024-07-17

| 172 浏览量 | 举报

“2.6_CNN.pdf机器学习”

卷积神经网络(Convolutional Neural Networks,简称CNN)是深度学习领域中一种专门处理具有网格结构数据的模型,如一维的时间序列数据和二维的图像数据。CNN的核心运算单元是卷积运算,它在神经网络中扮演着特征提取和学习的角色。

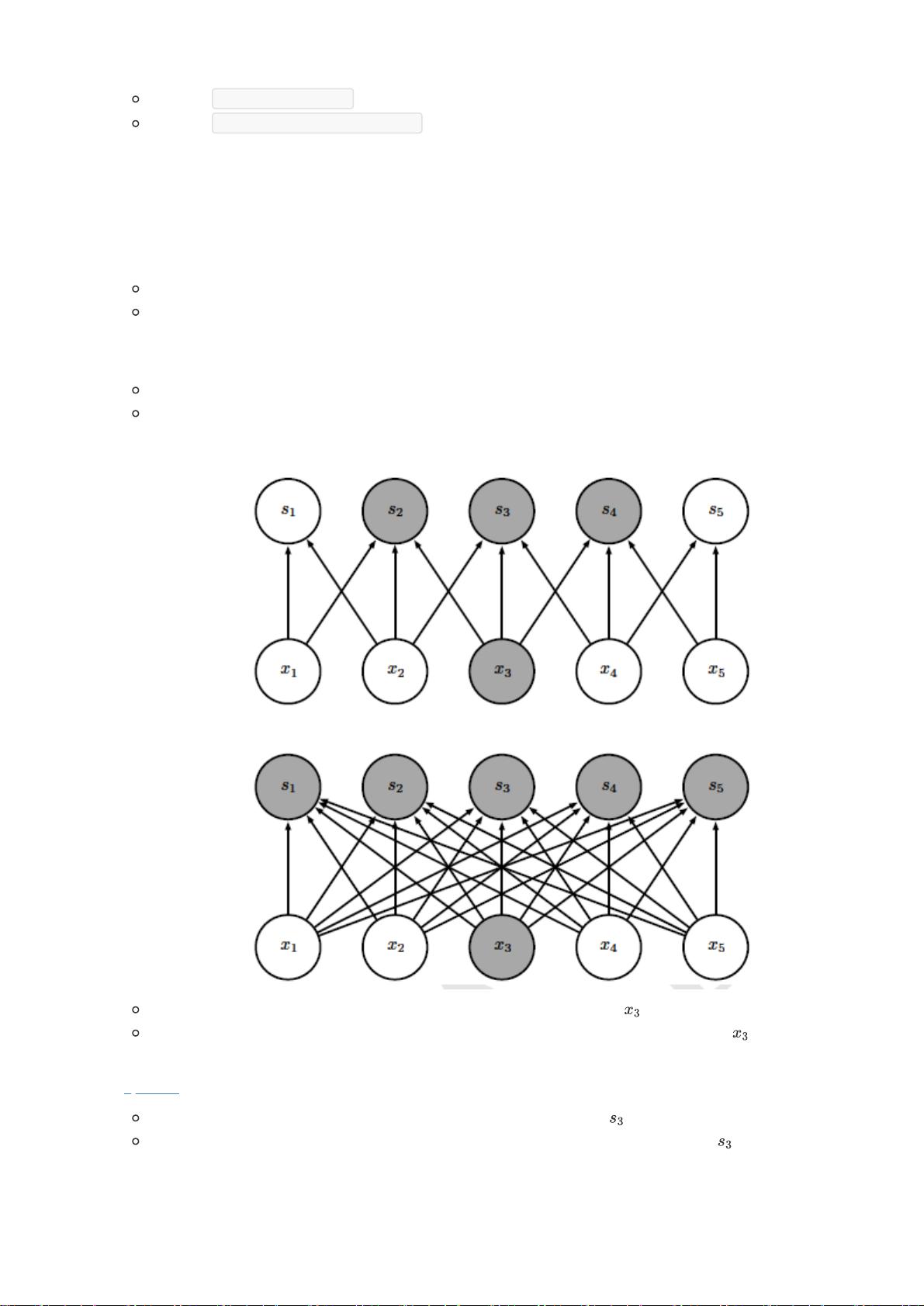

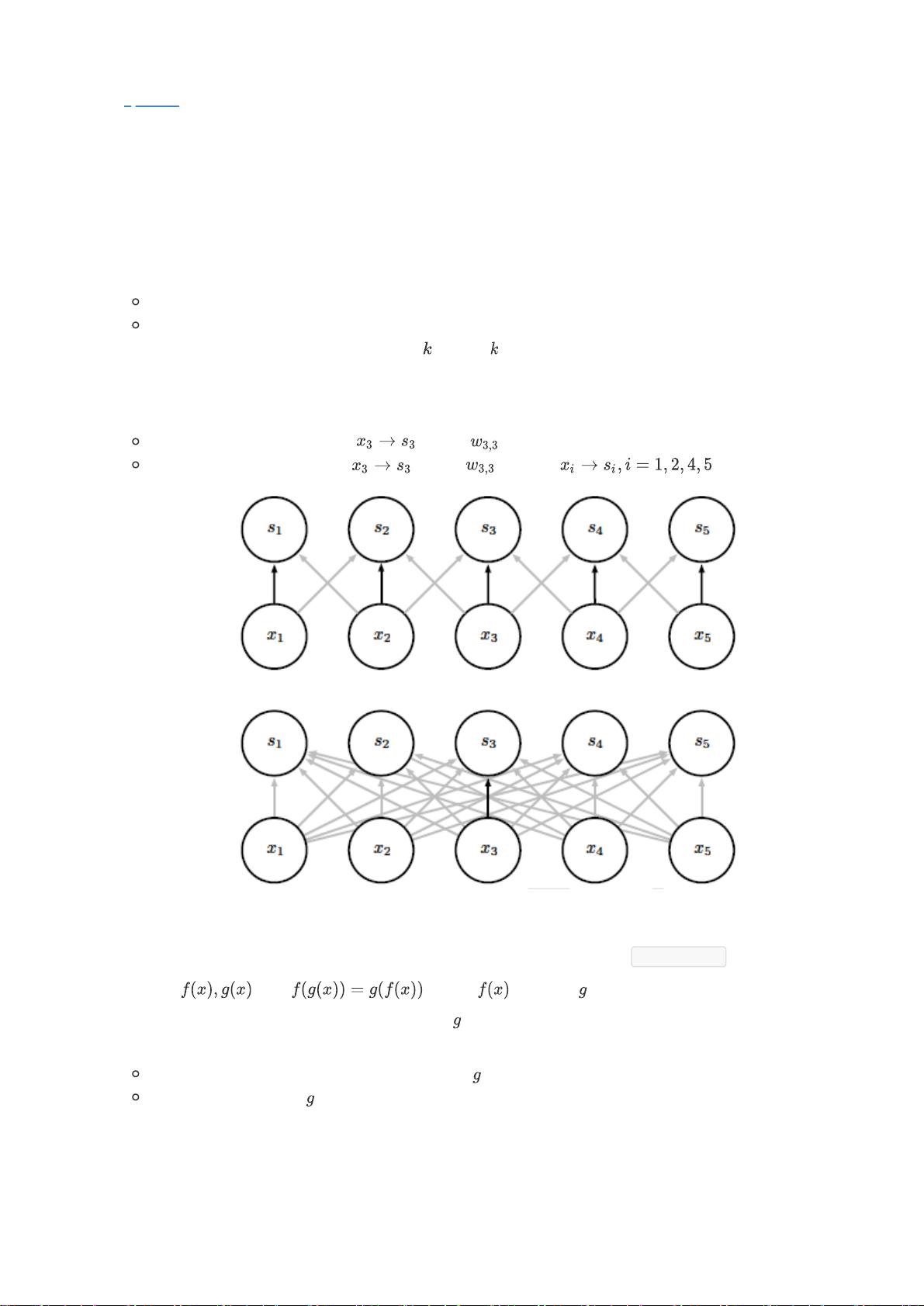

卷积运算在数学上的定义是一个线性转换过程,通过一个权重函数(也称为滤波器或核函数)对输入数据进行加权求和。在机器学习的上下文中,输入数据可以是图像的像素值,而核函数则用来检测特定的特征,如边缘、颜色或纹理。卷积运算的结果被称为特征映射(Feature Map),它体现了输入数据经过滤波器后的特征表示。

在连续数据的卷积中,假设输入函数是传感器的观测结果,而核函数则用来加权这些结果以估计目标位置。在离散数据处理中,卷积变成了对有限数据点的加权求和。例如,在二维图像的卷积中,一个小型的核函数会滑过图像的每个像素,通过按像素位置执行卷积运算生成新的特征映射。核函数的大小通常小于输入图像的尺寸,且在神经网络中,核函数的参数是学习到的,能够适应不同任务的需求。

在神经网络的实现中,卷积运算经常被等价地替换为互相关函数,两者的主要区别在于核函数是否翻转。尽管在数学上这是两个不同的概念,但在实际应用中,尤其是深度学习库中,两者通常混用,互相关函数常被称为卷积。

卷积运算的一个重要特性是其参数共享,这意味着同一个核函数可以应用于输入数据的不同部分,减少了模型的参数数量,降低了过拟合的风险,并且有助于学习到局部不变的特征。此外,卷积层通常与池化层(Pooling Layer)结合使用,进一步降低数据维度并保留关键信息。在深度CNN中,多层卷积和池化可以构建出复杂的特征表示,从而在图像识别、物体检测、自然语言处理等领域展现出强大的性能。

卷积神经网络是机器学习中一种强大的工具,通过卷积运算有效地捕获和学习数据中的模式,尤其适用于处理具有网格结构的高维数据。在实际应用中,CNN模型可以通过优化算法学习到适应任务的核函数,从而实现高效且准确的特征提取和分类。

相关推荐

来自远方的她

- 粉丝: 0

最新资源

- C++简单实现classloader及示例分析

- 快速掌握UICollectionView横向分页滑动封装技巧

- Symfony捆绑包CrawlerDetectBundle介绍:便于用户代理检测Bot和爬虫

- 阿里巴巴Android开发规范与建议深度解析

- MyEclipse 6 Java开发中文教程

- 开源Java数学表达式解析器MESP详解

- 非响应式图片展示模板及其源码与使用指南

- PNGoo:高保真PNG图像压缩新选择

- Android配置覆盖技巧及其源码解析

- Windows 7系统HP5200打印机驱动安装指南

- 电力负荷预测模型研究:Elman神经网络的应用

- VTK开发指南:深入技术、游戏与医学应用

- 免费获取5套Bootstrap后台模板下载资源

- Netgen Layouts: 无需编码构建复杂网页的高效方案

- JavaScript层叠柱状图统计实现与测试

- RocksmithToTab:将Rocksmith 2014歌曲高效导出至Guitar Pro