Apache Hadoop集群在Linux上的详细安装指南

需积分: 12 126 浏览量

更新于2024-07-17

收藏 1.71MB DOCX 举报

"Apache Hadoop 安装部署文档 V1.0 详细介绍了在Linux系统,特别是CentOS7上搭建Hadoop集群的步骤,包括JDK的安装、Hadoop、Zookeeper、Hbase、Hive、Spark和Sqoop等组件的配置与部署。文档还涉及了数据库连接(如MySql)、系统登录信息以及服务器配置和端口号的设定。"

Apache Hadoop 是一个开源的分布式计算框架,它允许在廉价硬件上存储和处理大量数据。在Linux系统上安装Hadoop集群是大数据处理的基础工作,而本文档提供了一个详细的指南。

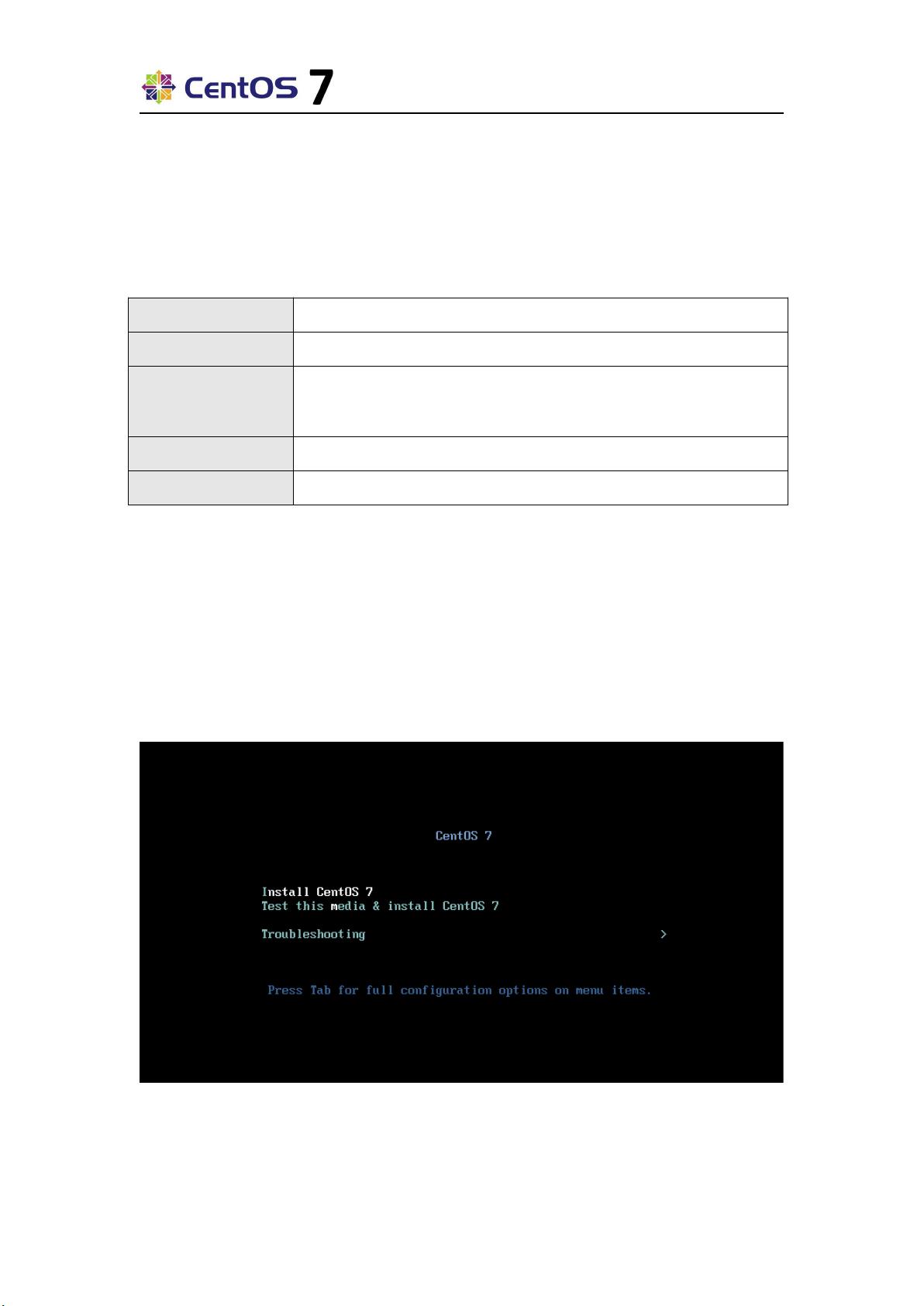

首先,安装环境准备,通常选择Linux发行版CentOS7作为基础操作系统。安装过程中需注意设置时区(例如Asia-China-Shanghai)、语言支持、安装源和软件选择。对于软件选择,最小化安装是常用选项,但可根据实际需求添加额外软件包。

JDK(Java Development Kit)是Hadoop运行所必需的,因此在部署Hadoop前必须先安装JDK。按照文档,用户需按照指定步骤下载并安装适合版本的JDK,确保环境变量配置正确,使得系统能够识别Java命令。

接着是Hadoop的安装。Hadoop主要由HDFS(Hadoop Distributed File System)和MapReduce两部分组成,它需要配置包括主机名、网络、Hadoop环境变量、配置文件(如hdfs-site.xml和core-site.xml)等。在安装过程中,需要手动分区,创建合适的数据节点(DataNode)和名称节点(NameNode)存储空间。

Zookeeper是协调服务,用于管理Hadoop集群中的命名服务、配置管理和群集同步。安装Zookeeper后,需配置相关设置,如数据目录和客户端连接地址。

Hbase是基于Hadoop的分布式数据库,适用于大规模结构化数据存储。安装Hbase需要配置Hadoop路径、Zookeeper地址等,并启动相关服务。

Hive是基于Hadoop的数据仓库工具,提供SQL-like查询接口处理大数据。安装Hive时需设置Hadoop和Metastore(存储元数据的数据库,通常用MySQL)的相关配置。

Spark是快速、通用且可扩展的大数据处理引擎,它可以运行在Hadoop上。安装Spark时,需配置Hadoop相关路径,以及设置Spark自身的工作模式。

Sqoop是用于在Hadoop和传统数据库之间导入导出数据的工具。安装完成后,需要配置Hadoop路径和数据库连接参数。

在安装过程中,附录部分提供了服务器服务端口号和配置信息,以便于检查和调试。确保所有服务正常启动并且能相互通信,集群才算部署成功。在整个过程中,每一步都需谨慎操作,确保配置无误,以保证Hadoop集群的稳定运行。

2008-11-02 上传

2023-07-13 上传

2023-05-11 上传

2023-07-20 上传

2023-09-14 上传

2023-05-19 上传

2023-03-28 上传

2023-07-23 上传

Listen_to_the_wind

- 粉丝: 1

- 资源: 3

最新资源

- C语言快速排序算法的实现与应用

- KityFormula 编辑器压缩包功能解析

- 离线搭建Kubernetes 1.17.0集群教程与资源包分享

- Java毕业设计教学平台完整教程与源码

- 综合数据集汇总:浏览记录与市场研究分析

- STM32智能家居控制系统:创新设计与无线通讯

- 深入浅出C++20标准:四大新特性解析

- Real-ESRGAN: 开源项目提升图像超分辨率技术

- 植物大战僵尸杂交版v2.0.88:新元素新挑战

- 掌握数据分析核心模型,预测未来不是梦

- Android平台蓝牙HC-06/08模块数据交互技巧

- Python源码分享:计算100至200之间的所有素数

- 免费视频修复利器:Digital Video Repair

- Chrome浏览器新版本Adblock Plus插件发布

- GifSplitter:Linux下GIF转BMP的核心工具

- Vue.js开发教程:全面学习资源指南