理解梯度推进树:XGBoost与Boosted Trees解析

需积分: 0 6 浏览量

更新于2024-08-04

收藏 900KB DOCX 举报

"这篇资源是关于Boost Tree的介绍,特别是XGBoost的梯度推进树概念,涵盖了监督学习的基础知识,包括模型、参数、目标函数和正则项,并以回归和分类为例阐述了损失函数。文章还强调了正则项在防止过拟合中的作用,并通过示例解释了其重要性。"

Boost Tree是一种集成学习方法,通过组合多个弱预测器形成一个强预测器。XGBoost是实现这种算法的一个高效工具,由陈天奇博士开发,其全称为 Extreme Gradient Boosting,强调了速度和性能。Friedman在2001年的论文中首次提出了“梯度推进”(Gradient Boosting)的概念,该方法在机器学习领域广泛应用。

在Boosted Trees中,每棵树的目标函数被定义为所有叶节点的贡献之和,其中叶节点的数据点集合决定了该树的预测。这个目标函数包含了损失函数和正则项,目的是最小化模型在训练数据上的预测误差并控制模型复杂度。

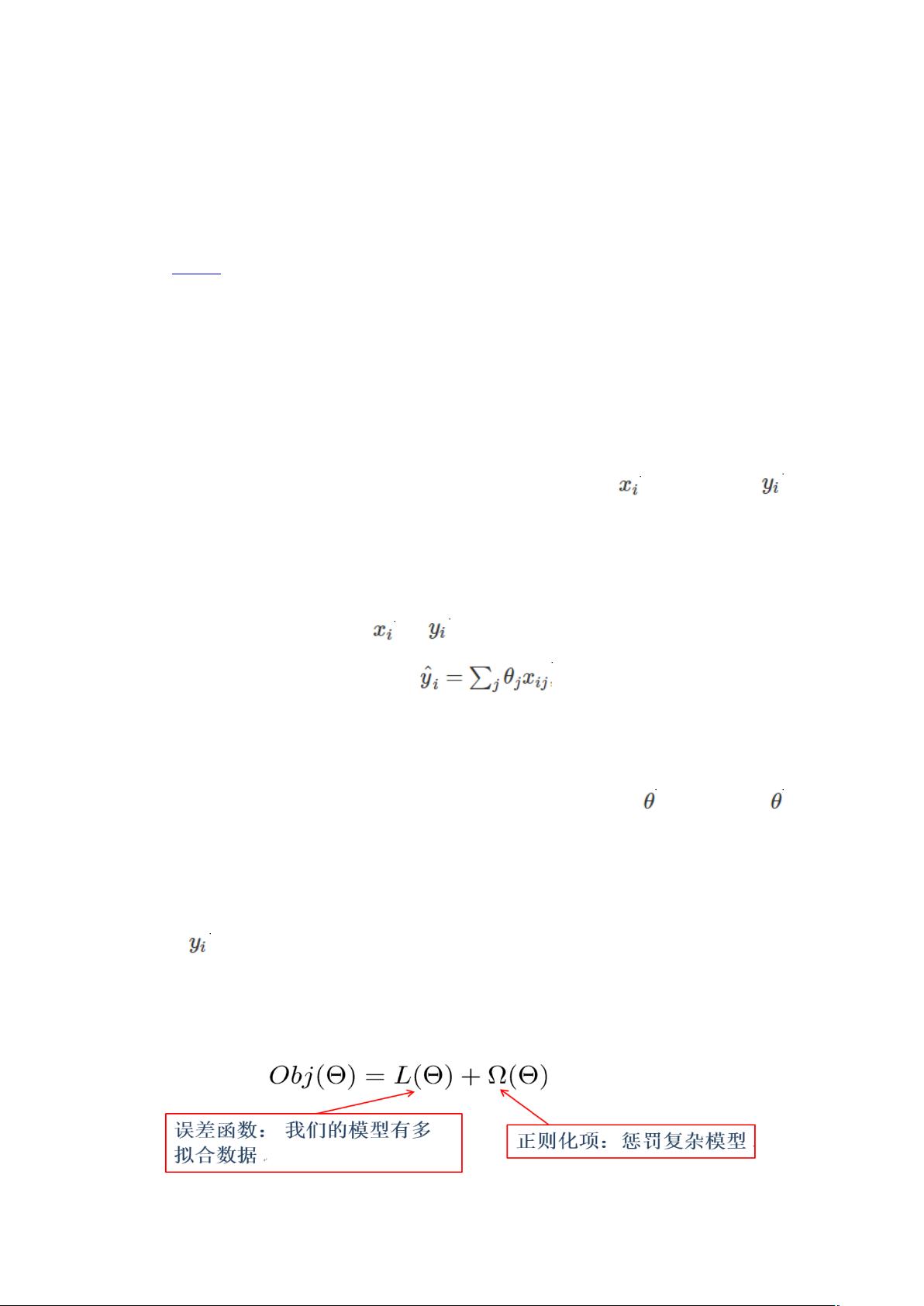

监督学习的核心是利用带有特征的训练数据来预测目标变量。模型是用于预测的数学结构,而参数是需要从数据中学习的未知量。线性模型是最常见的例子,其预测函数为特征的线性组合。不同的任务对应不同的损失函数,如回归任务中的均方误差和分类任务中的逻辑损失函数。

目标函数是评价模型性能的关键,它由训练损失和正则项组成。训练损失衡量模型在训练数据上的预测误差,而正则项则是为了防止过拟合,通过引入惩罚项限制模型的复杂度。例如,如果在拟合数据时没有正则项,可能会导致模型过于复杂,过度适应训练数据,如图中的情况,正则项能帮助选择简洁但有效的模型。

在实际应用中,XGBoost通过优化目标函数,迭代地构建树模型,每一步都针对前一步的残差进行优化,从而逐步提高整体预测能力。这样的过程使得Boost Tree在各种机器学习任务中展现出强大的性能,特别是在 Kaggle 等数据竞赛中被广泛采用。通过理解这些基本概念,我们可以更好地理解和使用XGBoost进行预测建模。

311 浏览量

769 浏览量

103 浏览量

180 浏览量

2023-06-09 上传

2023-06-09 上传

2023-06-09 上传

2023-05-29 上传

122 浏览量

王向庄

- 粉丝: 25

最新资源

- WebDrive v16.00.4368: 简易易用的Windows风格FTP工具

- FirexKit:Python的FireX库组件

- Labview登录界面设计与主界面跳转实现指南

- ASP.NET JS引用管理器:解决重复问题

- HTML5 canvas绘图技术源代码下载

- 昆仑通态嵌入版ASD操舵仪软件应用解析

- JavaScript实现最小公倍数和最大公约数算法

- C++中实现XML操作类的方法与应用

- 设计编程工具集:材料重量快速计算指南

- Fancybox:Jquery图片轮播幻灯弹窗插件推荐

- Splunk Fitbit:全方位分析您的活动与睡眠数据

- Emoji表情编码资源及数据库查询实现

- JavaScript实现图片编辑:截取、旋转、缩放功能详解

- QNMS系统架构与应用实践

- 微软高薪面试题解析:通向世界500强的挑战

- 绿色全屏大气园林设计企业整站源码与多技术项目资源