深度学习入门(7):递归神经网络解析与应用

需积分: 0 72 浏览量

更新于2024-06-30

收藏 1.71MB PDF 举报

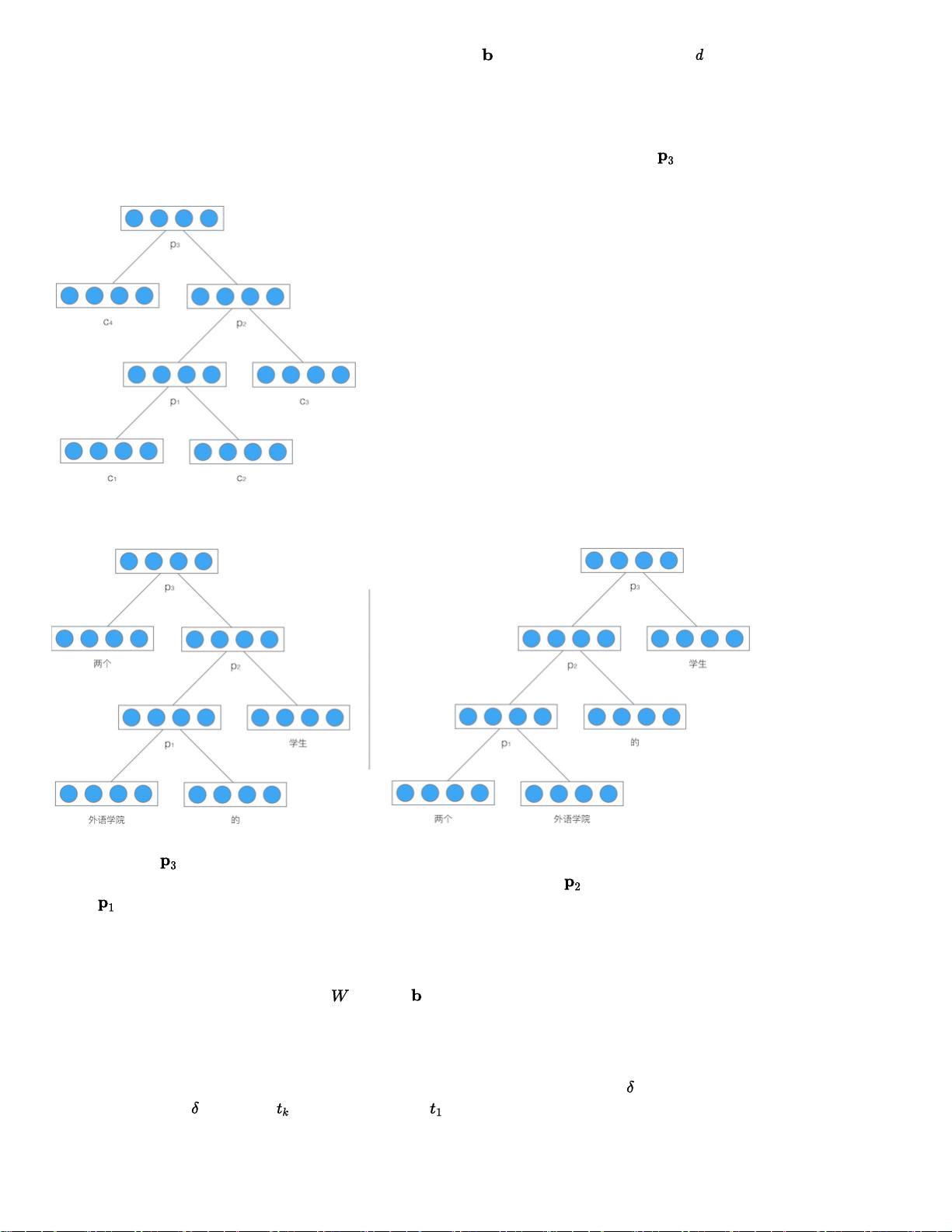

"这篇教程是《零基础入门深度学习》系列的第七部分,主要讲解了递归神经网络(Recursive Neural Network, RNN)的概念及其在处理递归结构数据中的应用。作者强调,此系列文章适合没有太多数学背景的程序员学习,通过代码实例帮助读者理解深度学习的基本原理。在之前的章节中,已经介绍了感知器、线性单元、梯度下降、神经网络、反向传播算法、卷积神经网络和循环神经网络。递归神经网络作为一种能够处理如树和图等复杂结构的网络,弥补了循环神经网络在这方面的不足,并引入了结构化反向传播(BPTS)的训练方法。"

在深度学习领域,递归神经网络(RNN)是一个重要的模型,尤其适用于处理具有序列或者层次结构的数据。与传统的前馈神经网络和循环神经网络不同,RNN的特点在于其内部状态可以依赖于自身之前的输出,形成一个循环结构。这使得RNN在处理时间序列数据(如语音识别、自然语言处理)时能保持长期依赖的记忆。

递归神经网络的核心在于其递归性质,这意味着网络可以对任意深度的结构进行建模。在处理树结构数据时,每个节点的输出不仅取决于当前输入,还取决于其子节点的输出,这在处理如语法分析、句法树构建等任务时非常有用。递归神经网络的一个经典应用场景是自然语言理解,比如解析句子的句法结构,理解嵌套短语的含义。

训练RNN时,由于其循环结构,反向传播算法需要考虑到时间维度的影响,这就是所谓的“反向传播通过时间”(Backpropagation Through Time, BPTT)。BPTT在计算梯度时会沿着时间轴展开网络,有效地将RNN转化为一个宽得多的前馈神经网络,然后应用标准的反向传播算法。这种方法虽然有效,但在处理长序列时可能会遇到梯度消失或爆炸的问题。

为了解决这些问题,后续发展出了一些改进版的RNN,例如长短时记忆网络(Long Short-Term Memory, LSTM)和门控循环单元(Gated Recurrent Unit, GRU)。这些模型通过引入额外的门控机制来更好地控制信息的流动,从而缓解了长时间依赖问题。

在实际应用中,递归神经网络还可以用于机器翻译、文本生成、情感分析等任务。通过调整网络结构和参数,RNN可以适应各种复杂的数据结构,为解决实际问题提供了强大的工具。对于程序员来说,掌握RNN的基本原理和实现方法是深入理解深度学习不可或缺的一部分。通过阅读《零基础入门深度学习》系列文章,即便没有深厚的数学基础,也能逐步建立起对深度学习的理解并掌握实践技能。

2022-07-25 上传

210 浏览量

197 浏览量

831 浏览量

1162 浏览量

141 浏览量

236 浏览量

1111 浏览量

1562 浏览量

思想假

- 粉丝: 34

- 资源: 325

最新资源

- 易语言超级列表框应用例程

- varlet

- tinyos:类似于UNIX的玩具操作系统在x86 CPU上运行

- Sales Navigator Search Plugin-crx插件

- boilerplate:我的个人项目样板

- 易语言超级列表框图标任意拖动

- spruct:使用可选的强类型字段清理 PHP 结构实现

- 霍尼韦尔三冲量控制器说明书

- robotfiiends-pwa:udemy课程-练习写作测试

- uri-template:https的Scala实现

- matlab附合导线平差_hillvwf_upwardc3i_附合导线_mountain864_matlab附合导线

- 皖宝集团中E文双语完整版

- 易语言超级列表框可编辑

- 软件集成工具(mysql+redis+nacos+consul)

- FoundersCard Chrome Extension-crx插件

- 詹金斯训练

已收录资源合集

已收录资源合集