"Flume ng是Apache Flume的新版本,主要用于日志数据的收集、聚合和传输。它具有分布式、可靠和可用的特点,基于流式数据流的架构,支持高容错性和多种故障恢复机制。其数据模型允许在线分析应用,提供灵活的数据处理能力。"

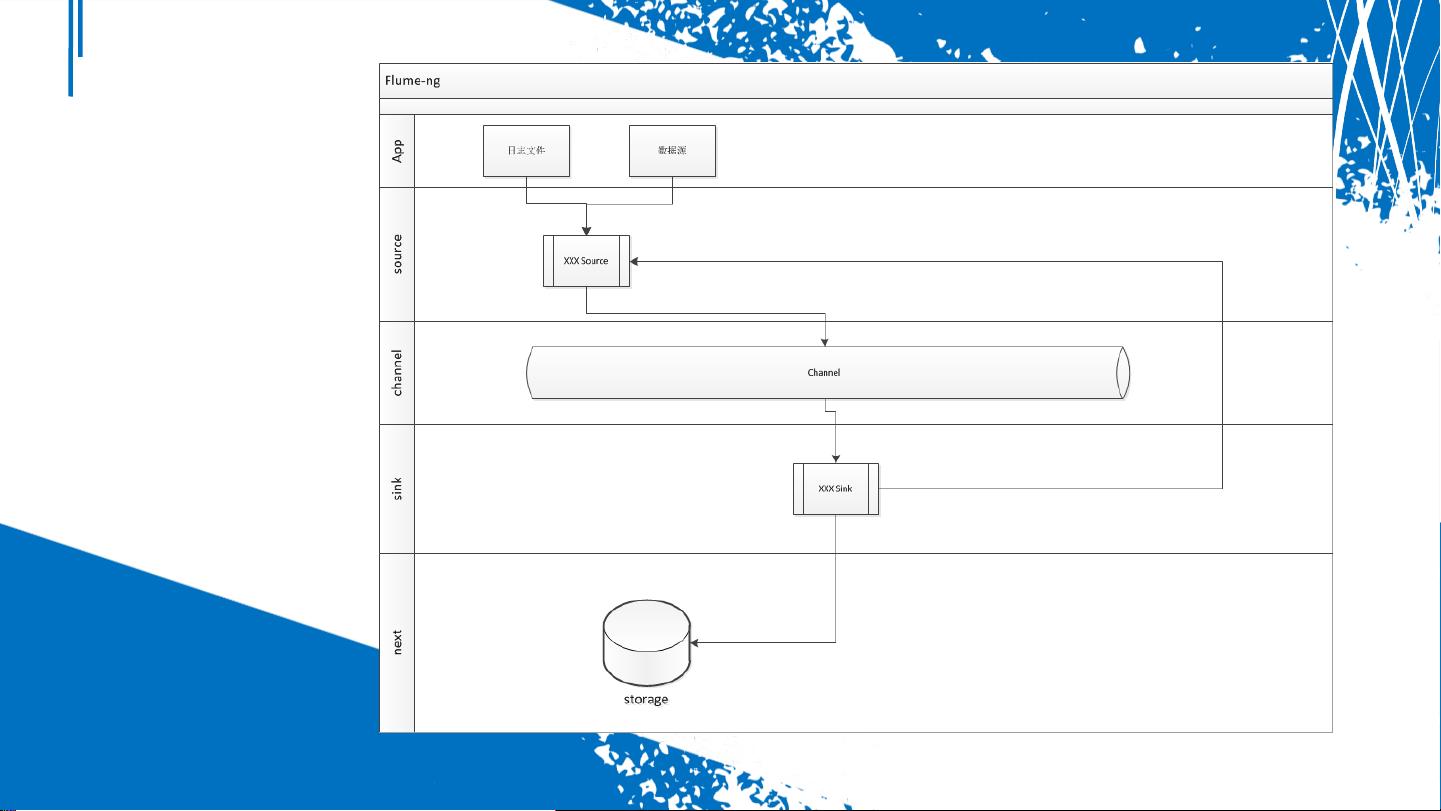

在Flume ng中,主要由三个核心组件构成:Source、Channel和Sink。

1. Source(数据源):Source是Flume系统中的数据采集器,负责从各种不同的数据源(如网络套接字、日志文件等)中获取数据。例如,ExecSource可以用来监听特定命令的执行结果。Source将收集到的数据发送到Channel。

2. Channel(数据缓冲区):Channel作为中介,存储Source接收到的数据,并在需要时传递给Sink。它确保了数据的可靠性,即使在Source和Sink之间发生故障,数据也不会丢失。MemoryChannel是一种内存中的Channel实现,适合小规模数据传输;而HDFSEventSink则将数据存储到HDFS中。

3. Sink(数据接收器):Sink负责将Channel中的数据传输到目标位置,如HDFS、Kafka或其他数据存储系统。CmccKafkaSink是一个例子,它将数据发送到Kafka主题。

Flume ng的工作流程大致如下:

- Source从数据源获取Event(事件),Event包含Header(键值对)和Body(字节数组)。

- Event通过Interceptor(拦截器)进行预处理,如过滤、转换等操作。

- 处理后的Event被放入Channel,可以是单个Channel或多个Channel的复用和复制。

- Sink从Channel中取出Event并将其发送到目标系统。

在源码层面,Flume ng的入口点通常是`bin/flume-ng agent`命令,通过配置文件指定Source、Channel和Sink。监控可以通过设置`flume.monitoring.type`和`flume.monitoring.port`来开启,如HTTP监控。

在深入源码分析时,我们可以关注以下几个关键点:

- ApplicationExecSource是Source的一种实现,用于执行命令并收集输出。

- HDFSEventSink实现了将数据写入HDFS的功能。

- MemoryChannel的Transaction机制保证了数据操作的原子性和一致性。

- CmccKafkaSink是自定义的Kafka Sink,展示了如何扩展Flume以支持新的数据输出目标。

Flume ng是一个强大的日志管理工具,通过其灵活的架构和组件设计,可以适应各种日志收集和处理需求,同时提供了源码级别的可扩展性,便于定制化开发。对于日志分析、大数据处理和实时监控等领域,Flume ng是一个非常有价值的工具。