可解释算法指的是通过对黑盒模型进行解释,揭示其内部运作机制和决策过程的算法。这些算法对于理解模型的预测结果和提高模型的可信度至关重要,尤其在需要满足监管、道德或商业需求的场景下。在实际应用中,可解释算法可以分为局部可解释和全局可解释两类。

全局可解释算法是指通过对整体数据集进行分析,揭示模型整体的特征重要性和影响因素。其中,PDP(Partial Dependence Plot)通过控制其他特征的取值,来展示某一特征对模型预测的影响程度;GS(Global Surrogate)则是通过训练一个相对简单的可解释模型来近似黑盒模型的预测过程;ALE(Accumulated Local Effects)是一种结合PDP和周围数据分布的方法,以更准确地描述特征与响应之间的关系;FI(Feature Interaction)则专注于发现特征之间的相互影响;最后,PFI(Permutation Feature Import)则是通过随机排列特征的值来测试其对模型预测的影响程度。

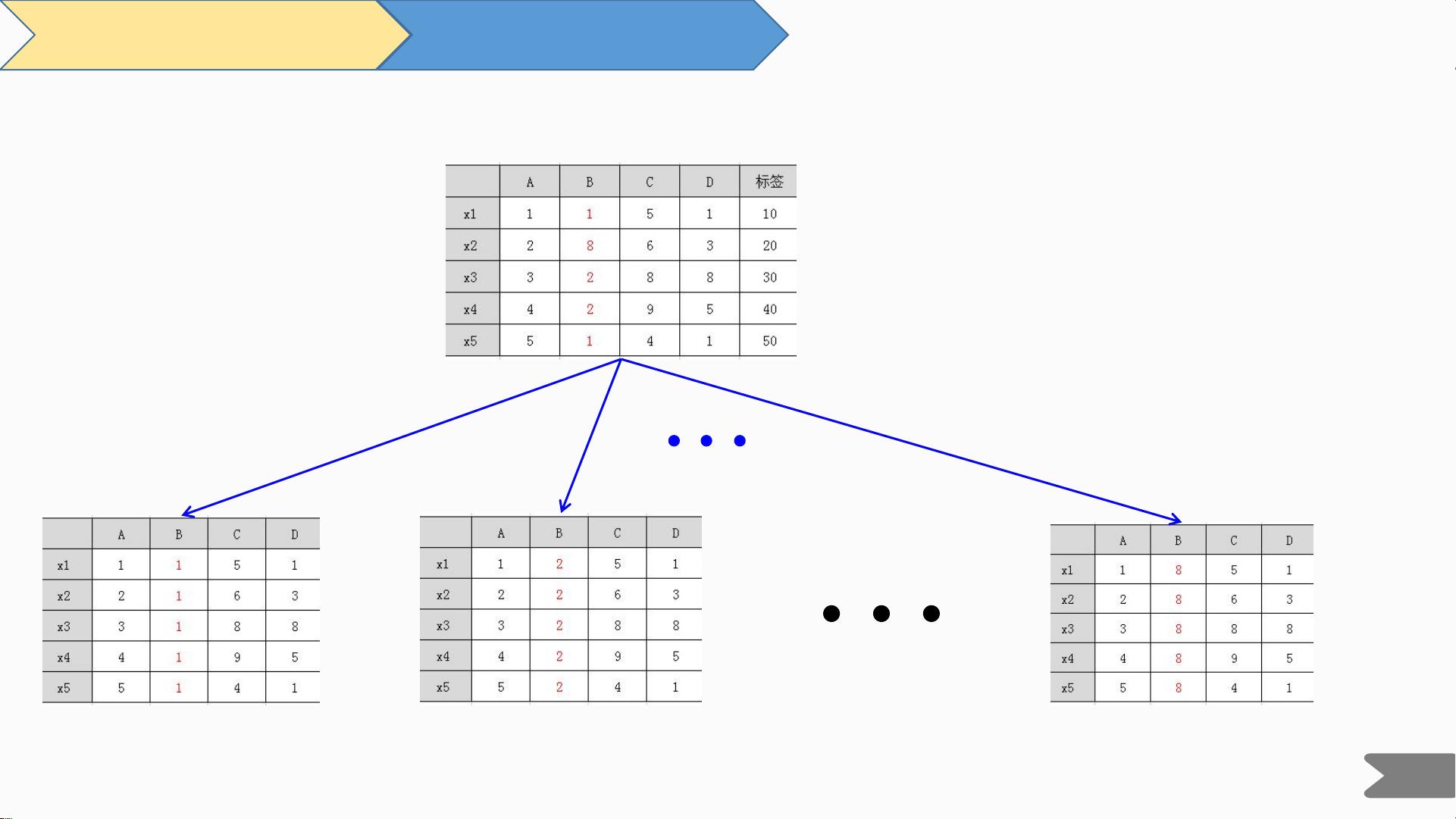

而局部可解释算法则是通过对个体数据点进行解释,揭示模型对于单个预测结果的影响因素。其中,ICE(Individual Conditional Expectation)通过对某一特征的值进行变化,来展示该特征对于单个个体预测结果的影响程度;LIME(Local Interpretable Model-agnostic Explanations)是通过寻找一个简单模型来近似黑盒模型的预测结果;Anchors(Scoped Rules)则是一种通过寻找一组简单规则来解释模型决策的方法。

这些可解释算法在机器学习和数据科学领域得到了广泛的应用,为模型解释和可信度提供了重要的支持。通过全局可解释算法,我们可以全面了解模型对于不同特征的依赖程度和重要性,从而更好地理解模型的决策过程;而局部可解释算法则可以为单个预测结果提供直观的解释和可信度评估。在日益重视模型可解释性的趋势下,这些可解释算法的研究和应用将会越来越受到重视。