深度学习后端架构与应用场景详解:分布式计算框架与实时/离线处理

版权申诉

87 浏览量

更新于2024-06-21

收藏 3.56MB PDF 举报

本章节深入探讨了深度学习在实际应用中的后端架构选型与场景。首先,它阐述了为何在深度学习项目中需要采用分布式计算,这是因为随着数据量的爆炸性增长和模型复杂性的提高,单机处理已无法满足需求。分布式计算通过将计算任务分解到多台机器上,提高了训练速度和模型扩展性。

章节列举了多个流行的深度学习分布式计算框架,包括:

1. PaddlePaddle:中国自主研发的开源深度学习框架,支持高效的模型训练和部署。

2. Deeplearning4j:由Apache软件基金会支持的Java库,专为大规模机器学习设计。

3. Mahout:Apache的开源机器学习库,也可用于深度学习任务。

4. SparkMLlib:Apache Spark的机器学习库,提供了深度学习工具。

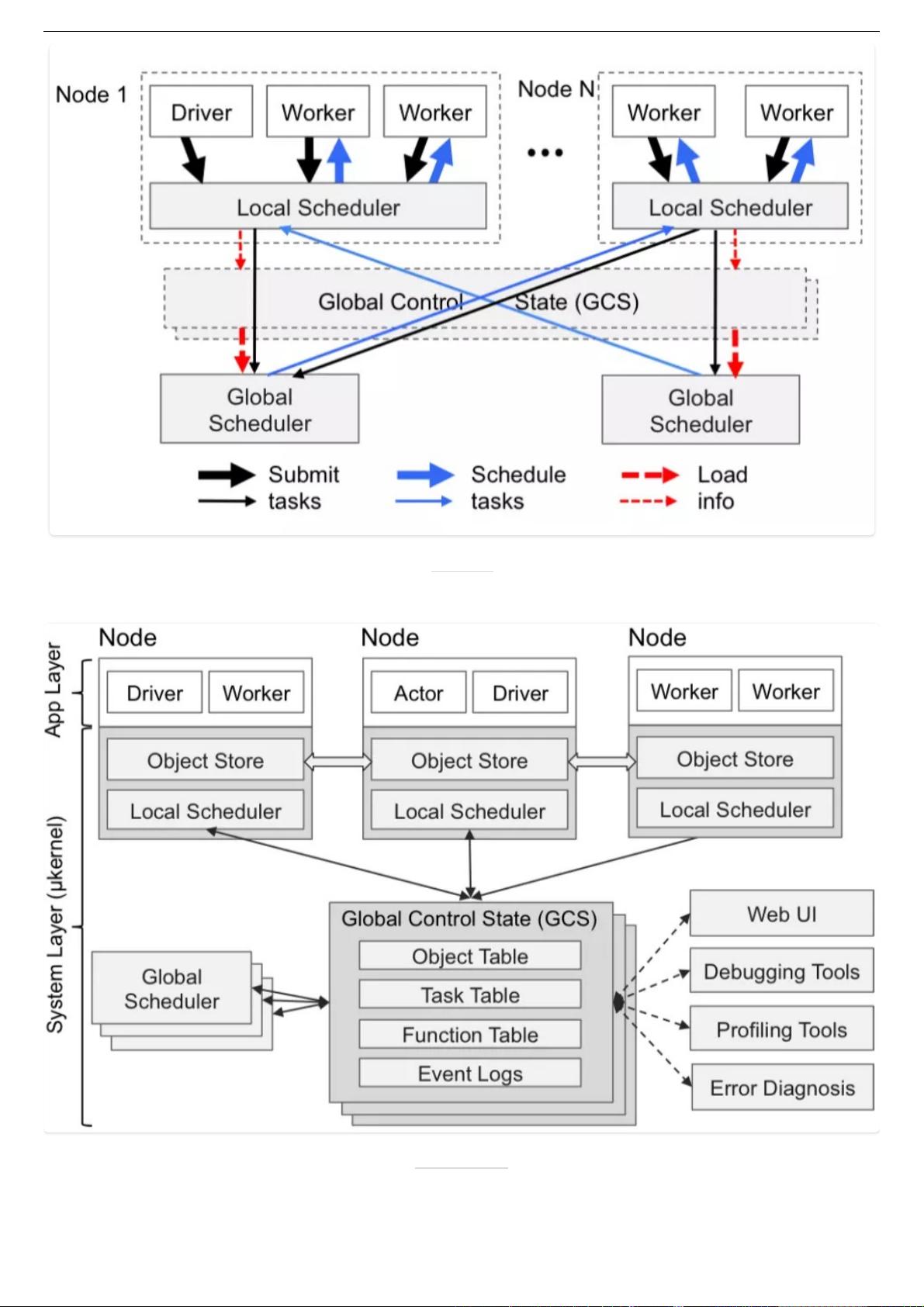

5. Ray:一个灵活的、开源的分布式系统库,适用于训练复杂的神经网络模型。

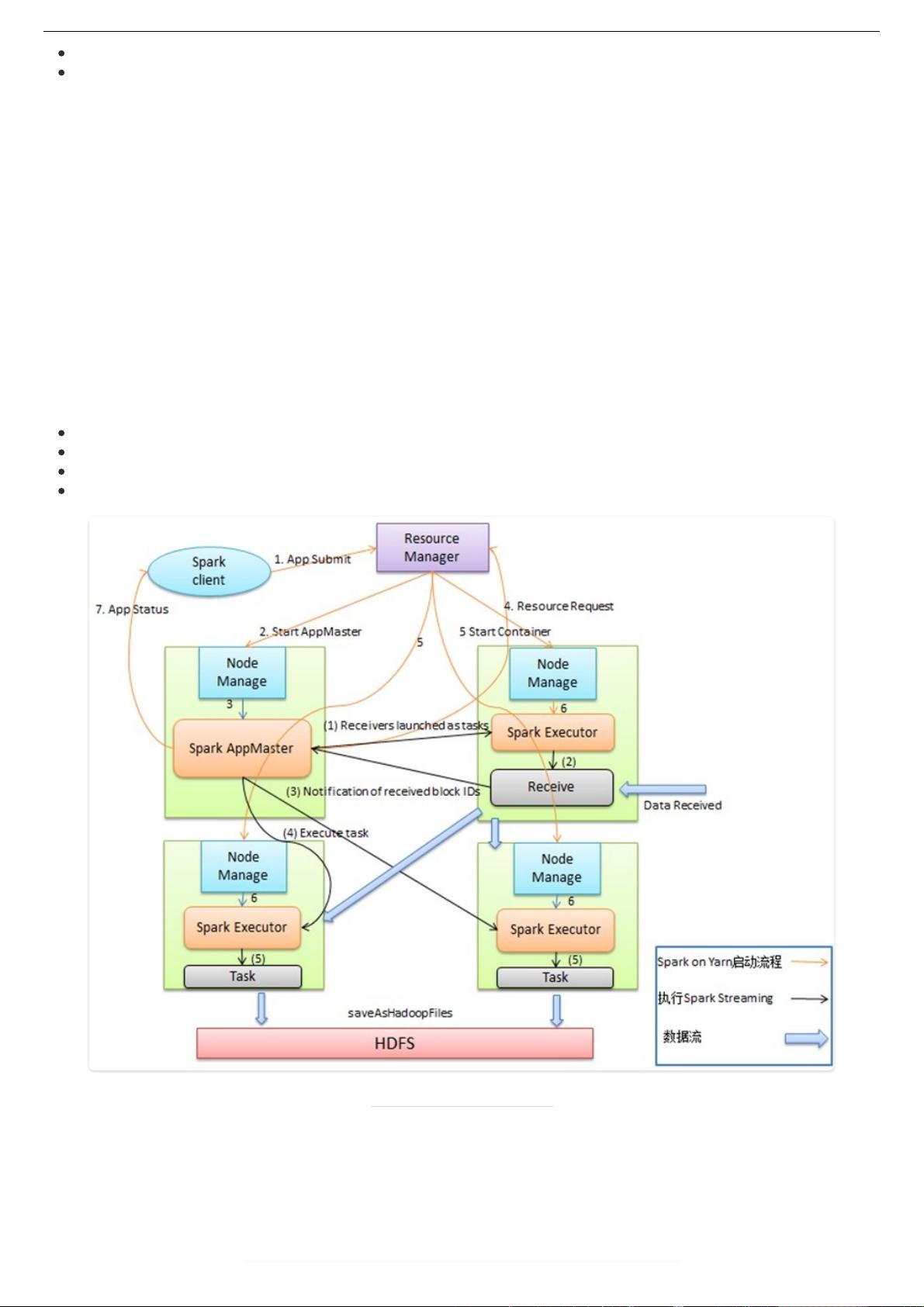

6. Sparkstream:Spark的实时流处理模块,可用于实时深度学习应用。

7. Horovod:Google开源的深度学习加速器,通过数据并行和模型并行优化训练。

8. BigDL:由华为开源的分布式深度学习框架,专注于大数据和边缘计算环境。

9. Petastorm:Apache的高效数据处理框架,与深度学习集成,提高数据读取效率。

10. TensorFlowOnSpark:将TensorFlow与Spark结合,扩展深度学习在大数据上的能力。

实时计算部分介绍了实时流计算的概念,以及数据采集、预处理、模型构建等步骤。而离线计算则关注数据的批量处理,包括ETL(提取、转换、加载)和工作流调度。

在设计人工智能应用,特别是人机交互系统时,章节详细讨论了问答引擎算法架构、长难句处理、错误纠正、指代消解、语义匹配、相似向量搜索、话术澄清、排序打分和系统效果评估。此外,个性化推荐系统的设计也是一大焦点,包括推荐引擎架构、召回模块、排序模块、用户画像、GBDT粗排、在线FM精排等算法,以及评价体系和案例分析。

整个章节不仅涵盖了深度学习技术的底层原理,还涉及到了如何将其应用于实际场景,帮助读者理解和选择合适的后端架构,以及如何优化和评估深度学习项目的性能和效果。

安全方案

- 粉丝: 2538

- 资源: 3960

最新资源

- dc-portfolio-site

- liteBox-开源

- c10lp_refkit_zephyr:在C10LP RefKit FPGA板上的litex vexriscv内核上运行的演示Zephyr应用程序

- Tasky

- UpGuard Cyber Security Ratings-crx插件

- 算法:基本算法和数据结构实现

- JQuerygantt,jquery甘特图

- 参考资料-基于RS485和单片机的排队机控制系统设计.zip

- JRDropMenu:JRDropMenu可快速实现下拉菜单功能

- 源代码深度学习入门:基于Python的理论与实现

- HUPROG:一个包含HUPROG'17(Hacettepe大学编程竞赛)的问题和该问题的解决方案的回购

- Spotify-Data:扩展下载Spotify数据时提供的基本流历史记录数据

- 编码方式

- simple.rar_按钮控件_Borland_C++_

- lua-table:具有超能力的lua表

- bitwarden-menubar:macOS菜单栏中的Bitwarden