一元与多元函数数值微分理论及Python代码示例

需积分: 0 24 浏览量

更新于2024-08-04

收藏 522KB PDF 举报

数值微分理论与实践

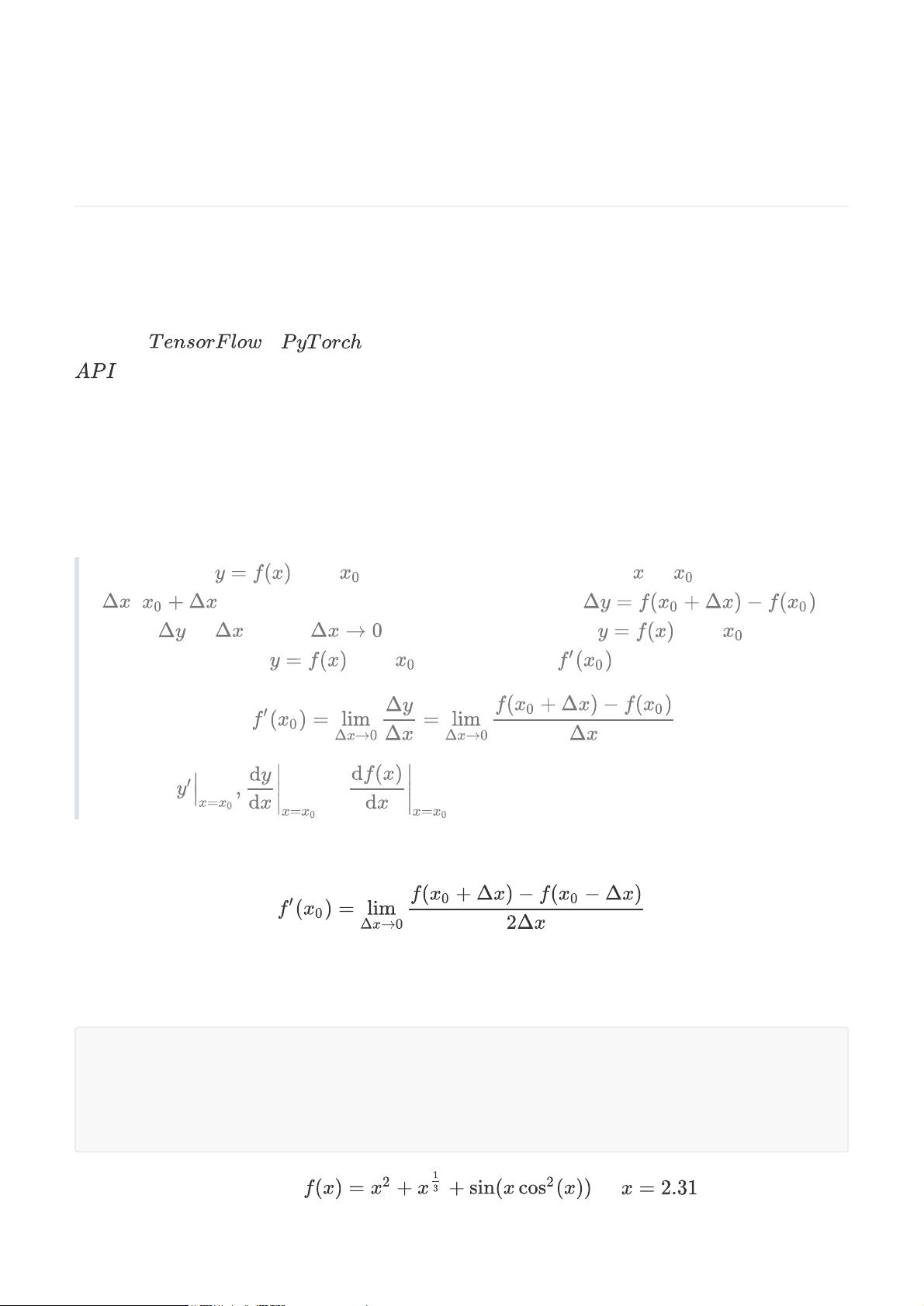

数值微分是数值分析中的一个重要概念,它允许我们在没有函数解析导数的情况下,通过计算函数在离散点上的值,估计函数在某一点的导数。这一方法对于那些难以直接求导或者解析形式复杂的函数特别有用,尤其是在机器学习和深度学习中,如梯度下降算法的应用,通常依赖于自动求导功能,但理解其底层原理仍有价值。

在一元函数中,数值微分的基本思想是利用函数在两个非常接近的点上函数值的差异来近似导数。根据导数的定义,如果函数 \( f(x) \) 在点 \( x_0 \) 处可导,那么当 \( h \) 趋于0时,\( \frac{f(x_0 + h) - f(x_0)}{h} \) 的极限就是 \( f'(x_0) \)。在实际编程中,我们通常使用一个足够小的 \( \delta \) 来近似这个极限,如 `numerical_grad_1d` 函数所示:

```python

def numerical_grad_1d(f, x, delta=1e-6):

f_l = f(x + delta)

f_r = f(x - delta)

grad = (f_l - f_r) / (2 * delta)

return grad

```

为了验证计算的准确性,我们可以将这个数值微分的结果与自动微分(如TensorFlow中的`tape.gradient`)的结果进行比较。

对于多元函数,情况类似。偏导数是多元函数导数的一个组成部分,表示函数对每个独立变量的局部变化率。例如,对于函数 \( f(x, y) \),在点 \( (x_0, y_0) \) 处对 \( x \) 的偏导数记作 \( \frac{\partial f}{\partial x}(x_0, y_0) \)。数值上,我们可以对每个变量分别应用一元函数的数值微分方法。以下是一个简单的例子,展示了如何使用`numpy`和`tensorflow`库来计算多元函数的偏导数:

```python

import numpy as np

import tensorflow as tf

f = lambda x: x**2 + x**(1/3) + np.sin(x * np.cos(x)**2)

# 对x=2.31的偏导数

numerical_grad_1d(f, 2.31, axis=0) # 假设axis=0代表对x求偏导

x = tf.Variable(2.31)

with tf.GradientTape() as tape:

g = x**2 + x**(1/3) + tf.sin(x * tf.cos(x)**2)

grad = tape.gradient(g, x)

grad.numpy()[0] # 获取对x的偏导数

```

数值微分虽然直观且易于实现,但由于计算机浮点运算的有限精确性,其结果可能存在一定的误差。因此,实际应用时需要注意选择合适的 \( \delta \) 值以及处理误差问题。同时,对于更复杂的函数和高维空间,可能需要采用更高级的数值微分方法,如中心差分、复合辛普森法则等,以提高精度。

176 浏览量

点击了解资源详情

133 浏览量

309 浏览量

2023-08-10 上传

457 浏览量

175 浏览量

154 浏览量

2023-10-21 上传

王者丶君临天下

- 粉丝: 20

最新资源

- MakeCode项目教程:new-fall-guys-8-bit-v80

- JavaScript实现剪刀石头布游戏解析

- LabVIEW制作中国象棋游戏实例教程

- MD5_Check与SUN_MD5Check:文件完整性校验工具解析

- 西门子SITRANS LG240探头操作与维护手册下载

- 免费下载 HelveticaNeueLTStd-Roman 字体文件

- lambdex:扩展Python lambda功能实现多行代码执行

- 深入理解前端算法:JS版剑指offer题解全解析

- HiJson - 高效Json格式化与多标签操作工具

- 传智播客Android智慧北京第4日视频教程

- 李春葆《数据结构教程》实验题答案解析

- 西门子SITRANS LG270探针操作与维护指南

- 掌握theposhery-devcontainer:开发顶级容器的简便方法

- 基于MERNG堆栈开发的Sick Fits网络商店介绍

- Qt4全面教程:图形设计与嵌入式系统开发

- Braspag GitHub站点:API文档与FAQ全解析