多模态COVID-19检测:深度学习方法实现97.8%精度

83 浏览量

更新于2024-06-18

收藏 3.03MB PDF 举报

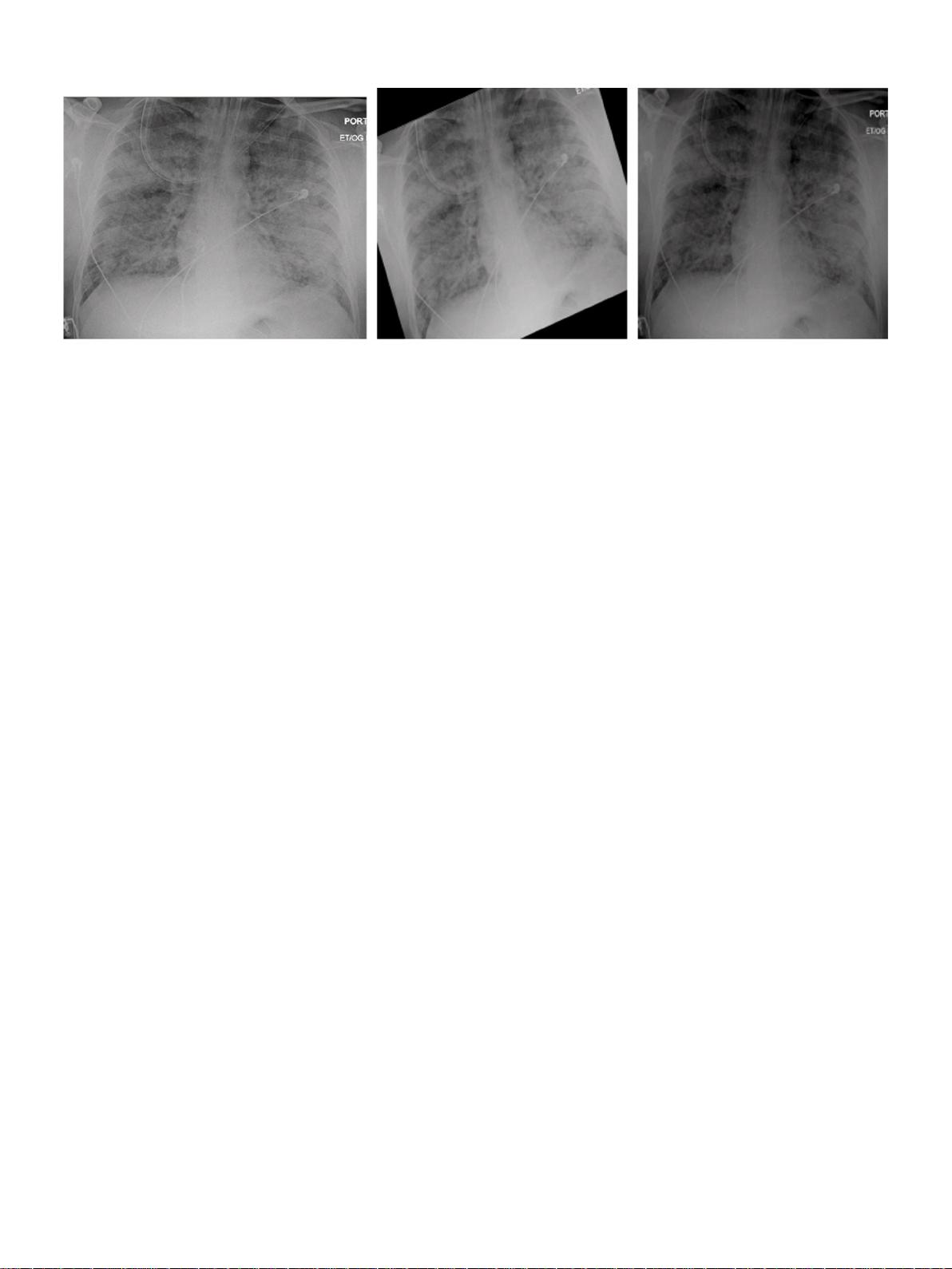

随着COVID-19疫情的全球肆虐及其不断变异带来的挑战,准确、快速的病例识别成为公共卫生的关键需求。本文研究探讨了利用智能系统和机器学习技术对COVID-19病例进行多模态图像分类的方法。研究者们结合了胸部X线和CT扫描图像,以及相关的临床记录,构建了一个双模式检测系统。

该研究采用数据扩充技术来扩大数据集的范围,通过增加样本多样性来提高模型的泛化能力。他们运用了迁移学习策略,结合了Adam优化器和二进制交叉熵损失函数,这两种技术对于提升模型性能和稳定训练过程至关重要。研究团队尝试了五种不同类型的图像和文本模型,包括VGG16、ResNet50、InceptionResNetV2、和MobileNetV2等预训练模型,这些模型在医疗图像识别领域有着广泛的应用。

通过实验,最终的多模态方法实现了高达97.8%的测试准确性,证明了这种方法在识别COVID-19病例方面的有效性。值得注意的是,这种方法仅依赖于扫描图像和相关的临床注解,减少了依赖实验室测试的时间成本,并且可能在资源有限的地区提供更便捷的筛查手段。

整个研究分为两个主要部分:首先,介绍了COVID-19的起源和传播方式,强调了快速检测的重要性;其次,详细阐述了研究方法和所取得的成果,突出了多模态技术在医疗领域的潜力和实际应用价值。这一研究为COVID-19的早期诊断和管理提供了创新思路,同时也展示了人工智能在公共卫生应急响应中的积极作用。

2023-02-09 上传

2021-04-24 上传

2024-02-29 上传

2024-10-13 上传

点击了解资源详情

点击了解资源详情

点击了解资源详情

2021-08-25 上传

cpongm

- 粉丝: 5

- 资源: 2万+

最新资源

- Java集合ArrayList实现字符串管理及效果展示

- 实现2D3D相机拾取射线的关键技术

- LiveLy-公寓管理门户:创新体验与技术实现

- 易语言打造的快捷禁止程序运行小工具

- Microgateway核心:实现配置和插件的主端口转发

- 掌握Java基本操作:增删查改入门代码详解

- Apache Tomcat 7.0.109 Windows版下载指南

- Qt实现文件系统浏览器界面设计与功能开发

- ReactJS新手实验:搭建与运行教程

- 探索生成艺术:几个月创意Processing实验

- Django框架下Cisco IOx平台实战开发案例源码解析

- 在Linux环境下配置Java版VTK开发环境

- 29街网上城市公司网站系统v1.0:企业建站全面解决方案

- WordPress CMB2插件的Suggest字段类型使用教程

- TCP协议实现的Java桌面聊天客户端应用

- ANR-WatchDog: 检测Android应用无响应并报告异常