"提高Oracle中SQL及存储过程效率的OraleSQL编程规范与命名规则"

Oracle的编程规范对于提高SQL及存储过程的效率至关重要。在编程过程中,遵循一定的命名规范能够提高代码的可读性和维护性,从而对系统性能有着积极的影响。在Oracle编程规范中,包括了对于命名规范的要求,其中包括了基本命名规则、定制对象命名规则以及变量命名规则等内容。

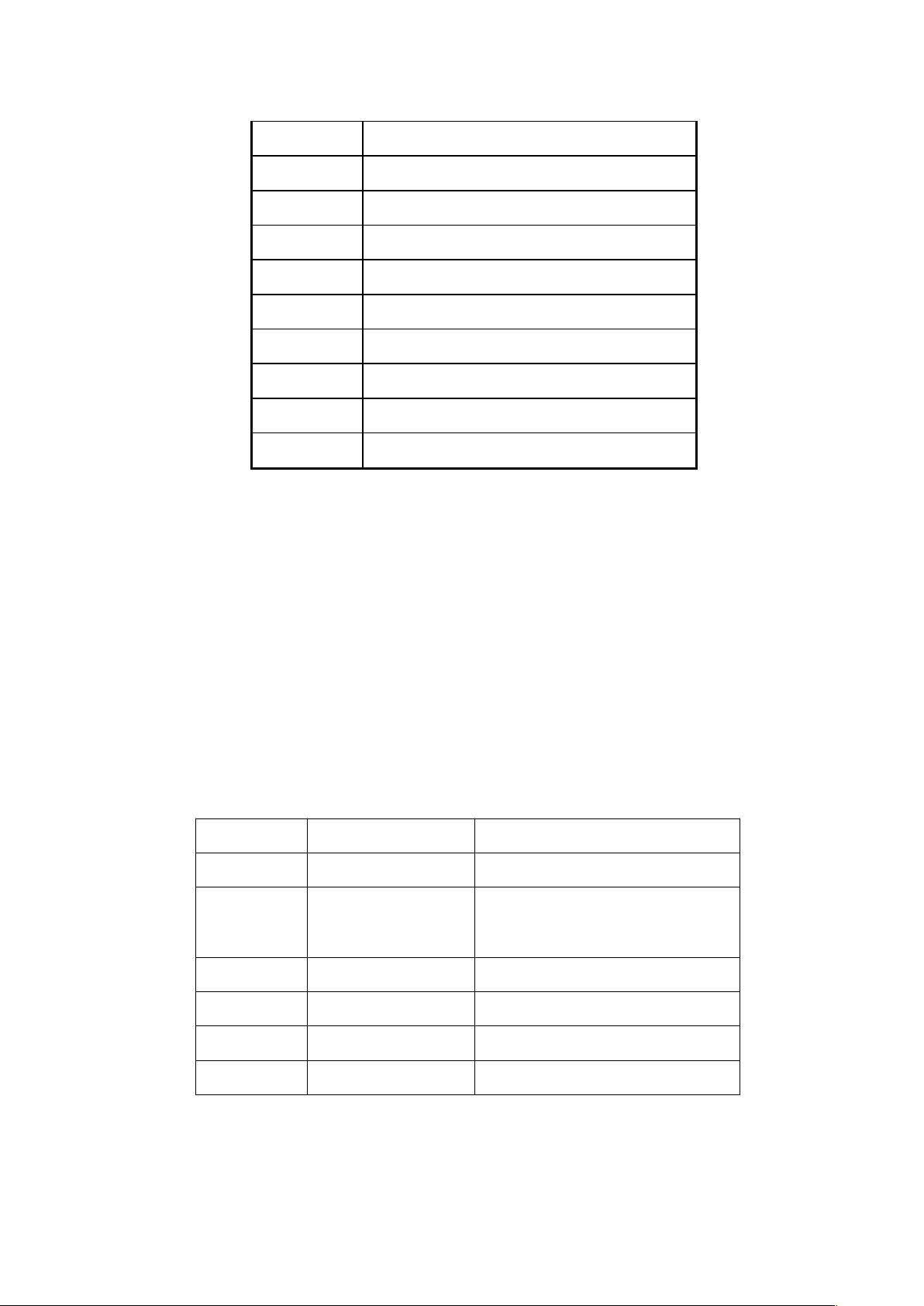

在命名规范中,基本命名规则是指命名的基本要求,包括了命名长度、命名字符的限制等方面的规定。定制对象命名规则则是在不同类型的对象中对命名进行了更加具体的规定,比如对于表、视图、索引等对象的命名要求有所不同。而变量命名规则则是对于变量的命名进行了规范,包括了对于命名的语义要求,以及命名长度等方面的规定。

遵循这些规范能够使得代码的命名更加规范和语义化,提高了代码可读性;同时也有利于后期的代码维护和修改,减少了潜在的错误发生的可能性。另外,对于Oracle的编程规范还包括了对于SQL及存储过程的一些具体规范,比如代码布局规范、注释规范等,这些规范的遵循也有助于代码的可维护性和可测试性。总的来说,遵循Oracle的编程规范对于编写高效、易维护的代码是非常有帮助的。

另外,Oracle编程规范还包括了对于异常处理、性能优化等方面的要求,这些内容更加突出了编程规范的重要性。异常处理是程序中非常重要的一部分,合理的异常处理能够保证系统在发生异常的情况下能够有条不紊的进行处理,减少了系统因为异常而崩溃的情况。性能优化则是对于代码效率的提出了具体的要求,这一部分内容涵盖了很多方面的知识,包括了SQL优化、索引优化等内容,这些对于程序员来说都是非常宝贵的知识。

最后,Oracle编程规范也包括了对于代码审查、测试等方面的要求,这些内容进一步强调了编程规范的重要性。代码审查和测试是保证代码质量的重要手段,遵循规范的代码更容易通过代码审查,并且更容易进行测试。代码的质量对于系统性能和稳定性来说是至关重要的,因此这些内容的加入进一步确立了Oracle编程规范的重要性。

总的来说,Oracle编程规范是非常重要的,它不仅能够提高代码的可读性、可维护性,还能够保证代码的质量和性能。因此,开发人员在编写Oracle代码的时候一定要遵循相关的编程规范,这对于开发出高质量的系统是非常有帮助的。

2014-12-19 上传

2024-09-21 上传

2024-09-21 上传

2024-09-21 上传

fwen_soft

- 粉丝: 0

- 资源: 1

最新资源

- ExtJS 2.0 入门教程与开发指南

- 基于TMS320F2812的能量回馈调速系统设计

- SIP协议详解:RFC3261与即时消息RFC3428

- DM642与CMOS图像传感器接口设计与实现

- Windows Embedded CE6.0安装与开发环境搭建指南

- Eclipse插件开发入门与实践指南

- IEEE 802.16-2004标准详解:固定无线宽带WiMax技术

- AIX平台上的数据库性能优化实战

- ESXi 4.1全面配置教程:从网络到安全与实用工具详解

- VMware ESXi Installable与vCenter Server 4.1 安装步骤详解

- TI MSP430超低功耗单片机选型与应用指南

- DOS环境下的DEBUG调试工具详细指南

- VMware vCenter Converter 4.2 安装与管理实战指南

- HP QTP与QC结合构建业务组件自动化测试框架

- JsEclipse安装配置全攻略

- Daubechies小波构造及MATLAB实现