MapReduce与Spark Shuffle原理详解:数据转换关键

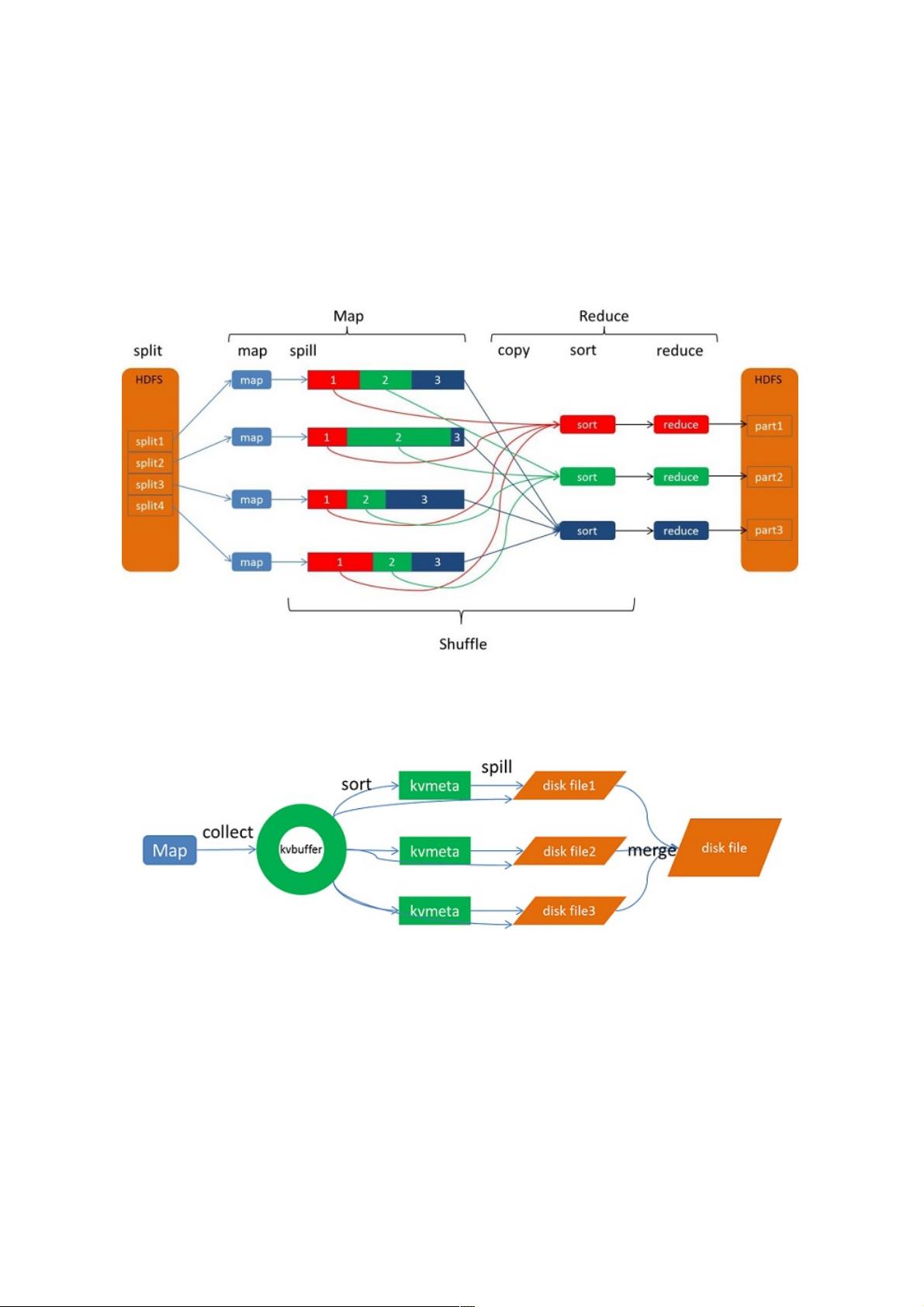

MapReduce和Spark都是分布式计算框架,其中Shuffle是一个核心组件,它在数据处理过程中扮演着至关重要的角色。Shuffle的本质是打破数据原有的有序性,将其打乱后重新组织,以便于在不同的计算阶段进行高效的数据分布和聚合。 在MapReduce模型中,Shuffle的过程主要发生在Map阶段和Reduce阶段之间的数据交换环节。Map阶段,每个Mapper会将输入数据按照预定义的键(key)进行分割和处理,生成一系列中间结果(<key, value>对)。这些中间结果通常是无序的,因为Mapper的任务是尽可能地生成所有可能的键值对。当Mapper处理完数据后,会把这些数据写入磁盘,这一过程即为Spill(溢写),目的是防止内存溢出。 Spill过程中,数据会被排序并写入磁盘,同时生成索引以记录每个键值对在磁盘上的位置。这些索引是关键,因为在Reduce阶段,Reducer需要根据键(key)来收集相关的值(value)。为了高效查找,Reduce任务会先从磁盘读取索引,然后通过索引找到对应键的值,这个过程通常涉及到数据的复制(copy)和排序(sort)操作。 Spark的Shuffle机制相比MapReduce有所改进。Spark引入了一种称为“Broadcast shuffle”和“Resilient Distributed Datasets (RDD)”的优化。Broadcast shuffle允许某些常用数据在集群节点之间共享,减少了网络通信量。而RDD的设计使得数据分区和缓存成为可能,从而减少了Shuffle的开销。此外,Spark的Shuffle过程通常在内存中进行,直到达到阈值才溢写到磁盘,这进一步提高了性能。 MapReduce和Spark的Shuffle机制都是为了克服分布式计算中的数据分布不均匀问题,通过调整数据的顺序和分布,使得Reduce任务能够高效地聚合数据。理解这些原理对于优化大规模数据处理任务至关重要,因为它们直接影响到系统的吞吐量和计算效率。

下载后可阅读完整内容,剩余6页未读,立即下载

- 粉丝: 349

- 资源: 2万+

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- OptiX传输试题与SDH基础知识

- C++Builder函数详解与应用

- Linux shell (bash) 文件与字符串比较运算符详解

- Adam Gawne-Cain解读英文版WKT格式与常见投影标准

- dos命令详解:基础操作与网络测试必备

- Windows 蓝屏代码解析与处理指南

- PSoC CY8C24533在电动自行车控制器设计中的应用

- PHP整合FCKeditor网页编辑器教程

- Java Swing计算器源码示例:初学者入门教程

- Eclipse平台上的可视化开发:使用VEP与SWT

- 软件工程CASE工具实践指南

- AIX LVM详解:网络存储架构与管理

- 递归算法解析:文件系统、XML与树图

- 使用Struts2与MySQL构建Web登录验证教程

- PHP5 CLI模式:用PHP编写Shell脚本教程

- MyBatis与Spring完美整合:1.0.0-RC3详解

信息提交成功

信息提交成功