PyTorch深度学习实践:卷积神经网络详解

103 浏览量

更新于2024-08-30

收藏 705KB PDF 举报

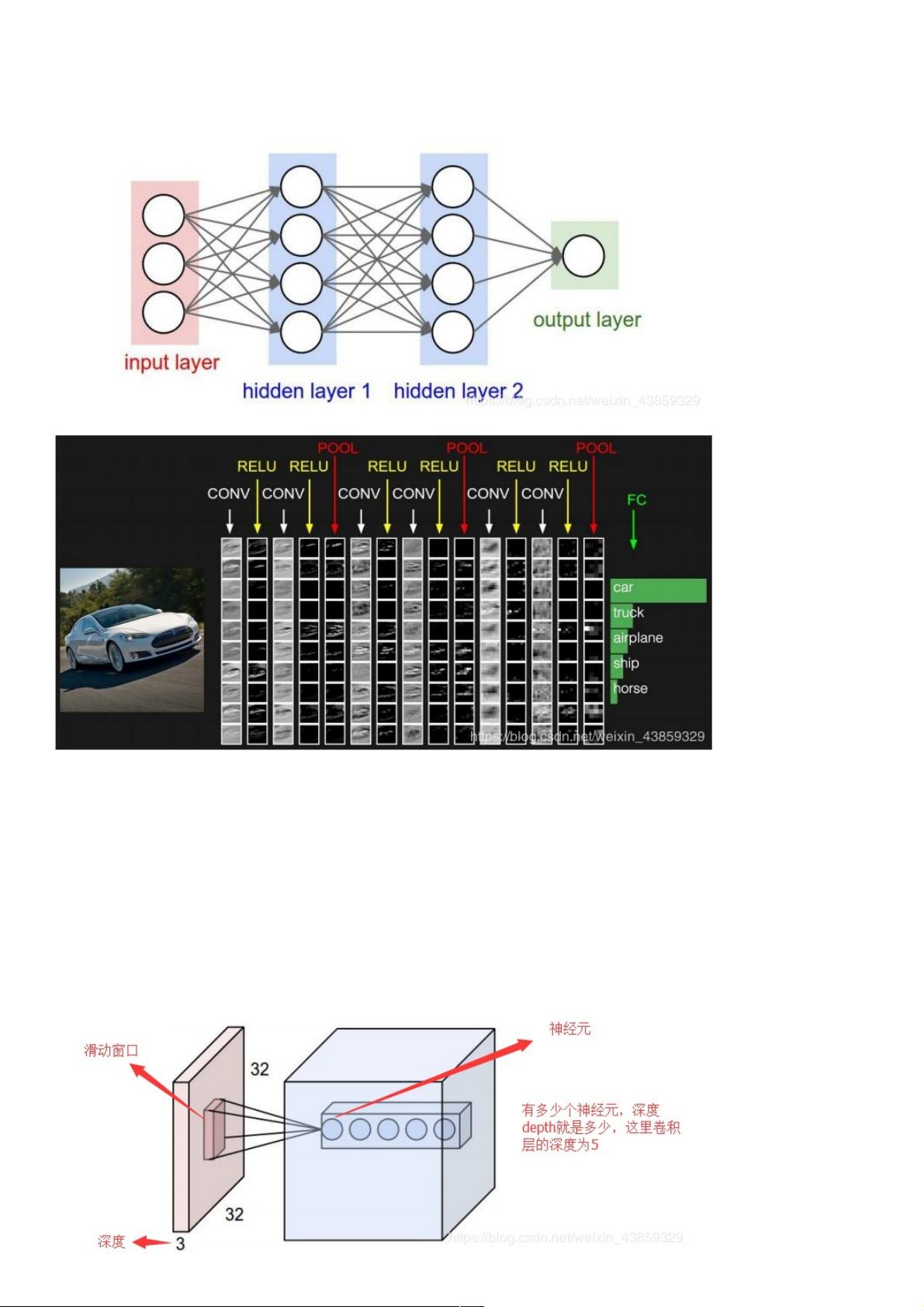

卷积神经网络(CNN)是深度学习中的一个重要分支,它在计算机视觉任务中表现出色,尤其是在图像识别和分析领域。CNN的独特之处在于其层级结构的创新,特别是卷积计算层,它是整个网络的核心。

卷积神经网络的结构包括以下几个关键组件:

1. **数据输入层** (Input Layer):这是神经网络接受原始输入数据的第一层,比如图像数据。

2. **卷积计算层** (CONV Layer):这个层次是CNN的名字来源,它通过局部关联性和窗口滑动机制进行工作。每个神经元(或称滤波器)处理输入数据的局部区域,像一个小的滤波器一样扫描图像,提取特定的特征。

- **局部关联**:滤波器只关注输入数据的一小块区域,而不是全局特征。

- **窗口滑动**:滤波器在输入数据上以一定的步长移动,重复此过程以捕捉不同位置的特征。

3. **ReLU激励层** (ReLU Layer):激活函数,通常使用ReLU(Rectified Linear Unit),非线性地增加网络的表达能力。

4. **池化层** (Pooling Layer):减小特征映射的空间尺寸,降低计算复杂度,同时保留关键特征。

5. **全连接层** (FC Layer):通常位于卷积层之后,用于分类或回归等任务,将之前处理过的特征映射转换成最终的预测结果。

在卷积神经网络的示例中,使用PyTorch构建了一个简单的二维卷积层应用场景。通过创建一个6x8的二值图像,其中中间4列为黑色,其余为白色,目标是检测边缘。卷积层的卷积核用于检测边缘变化,例如,一个6x7大小的卷积核可能被设计为检测连续像素值的突变。在实际应用中,卷积核的大小、步长和填充值(zero-padding)都是可调参数,影响着特征提取的细节和性能。

总结来说,卷积神经网络通过卷积层特有的局部特征提取和降维技术,有效地处理图像数据,广泛应用于诸如图像分类、物体检测、图像分割等各种计算机视觉任务中。学习理解卷积神经网络的工作原理和参数设置是深度学习中不可或缺的一部分。

2021-01-20 上传

2021-01-06 上传

2021-01-06 上传

2021-01-06 上传

2021-01-20 上传

2021-01-06 上传

2021-01-07 上传

2021-01-06 上传

2021-01-20 上传

weixin_38739919

- 粉丝: 4

- 资源: 903

最新资源

- 前端协作项目:发布猜图游戏功能与待修复事项

- Spring框架REST服务开发实践指南

- ALU课设实现基础与高级运算功能

- 深入了解STK:C++音频信号处理综合工具套件

- 华中科技大学电信学院软件无线电实验资料汇总

- CGSN数据解析与集成验证工具集:Python和Shell脚本

- Java实现的远程视频会议系统开发教程

- Change-OEM: 用Java修改Windows OEM信息与Logo

- cmnd:文本到远程API的桥接平台开发

- 解决BIOS刷写错误28:PRR.exe的应用与效果

- 深度学习对抗攻击库:adversarial_robustness_toolbox 1.10.0

- Win7系统CP2102驱动下载与安装指南

- 深入理解Java中的函数式编程技巧

- GY-906 MLX90614ESF传感器模块温度采集应用资料

- Adversarial Robustness Toolbox 1.15.1 工具包安装教程

- GNU Radio的供应商中立SDR开发包:gr-sdr介绍