Requests库入门与网络爬虫基础

需积分: 0 77 浏览量

更新于2024-08-05

收藏 409KB PDF 举报

"本资源是关于Python网络爬虫的初步介绍,主要讲解了Requests库的使用,包括其主要方法和get方法的详细说明,以及爬取网页的一般代码框架,并提到了异常处理和Response对象的重要属性。"

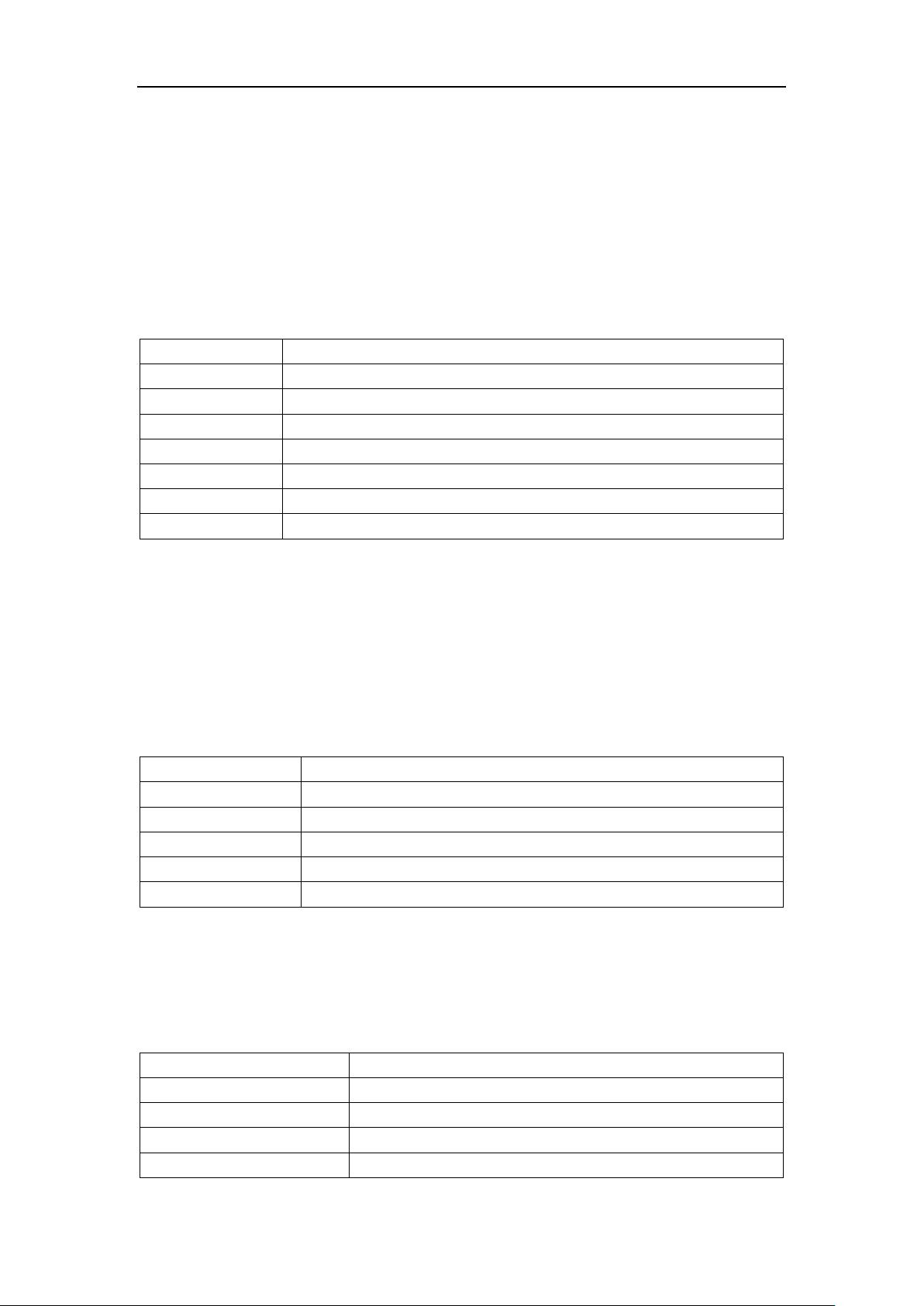

在Python的网络爬虫开发中,Requests库是一个不可或缺的工具,它为开发者提供了方便快捷的方式来发送HTTP请求。本资源首先概述了Requests库的7个主要方法,包括request(), get(), head(), post(), put(), patch()和delete(),这些方法对应了HTTP协议中的不同请求类型。其中,get()方法是最常用的方法,用于获取HTML网页的内容。通过requests.get(url, params=None, **kwargs)可以发起一个GET请求,url指定要访问的网页地址,params用于传递URL参数,而**kwargs则包含其他控制参数。

Requests库的get()方法返回一个Response对象,该对象包含了服务器的响应信息。Response对象有多个重要属性,例如status_code表示HTTP请求的返回状态,常见的成功状态码是200;text属性提供HTTP响应内容的字符串形式,即网页的实际内容;encoding属性是根据HTTP header猜测的响应内容编码方式,而apparent_encoding则是根据实际内容分析出的编码方式。需要注意的是,如果header中未指定charset,Requests库会默认编码为ISO-8859-1。

在进行网络爬虫开发时,了解一个通用的代码框架是必要的。通常,一个基本的爬虫代码会包括发起请求、处理响应和异常处理等步骤。例如,当尝试获取网页时可能会遇到网络连接错误,这时需要捕获requests.ConnectionError这样的异常。此外,对于网页内容的解析,可能需要结合BeautifulSoup或正则表达式等工具来完成。

网络爬虫的规模可以从小到大,从简单的单页面抓取到复杂的多层级遍历。在实际应用中,可能会涉及到向搜索引擎如百度提交搜索请求,以及爬取和存储网络图片等问题。对于网络图片的爬取,需要考虑如何正确下载并保存,同时要遵循网站的robots.txt规则和版权法规,确保合法且道德地进行爬取活动。

在学习网络爬虫的过程中,除了掌握Requests库的使用,还需要理解HTML基础知识,熟悉HTTP协议,以及了解网络爬虫可能遇到的反爬策略和相应的应对方法。Python的网络爬虫涉及的知识点广泛,包括网络编程、数据解析、存储以及相关的法律法规等,是一个深入且有趣的领域。

2022-08-03 上传

2022-08-03 上传

2022-08-03 上传

2021-10-19 上传

2022-11-17 上传

2021-10-02 上传

2022-03-03 上传

2022-03-10 上传

Friday永不为奴

- 粉丝: 20

- 资源: 317

最新资源

- 构建基于Django和Stripe的SaaS应用教程

- Symfony2框架打造的RESTful问答系统icare-server

- 蓝桥杯Python试题解析与答案题库

- Go语言实现NWA到WAV文件格式转换工具

- 基于Django的医患管理系统应用

- Jenkins工作流插件开发指南:支持Workflow Python模块

- Java红酒网站项目源码解析与系统开源介绍

- Underworld Exporter资产定义文件详解

- Java版Crash Bandicoot资源库:逆向工程与源码分享

- Spring Boot Starter 自动IP计数功能实现指南

- 我的世界牛顿物理学模组深入解析

- STM32单片机工程创建详解与模板应用

- GDG堪萨斯城代码实验室:离子与火力基地示例应用

- Android Capstone项目:实现Potlatch服务器与OAuth2.0认证

- Cbit类:简化计算封装与异步任务处理

- Java8兼容的FullContact API Java客户端库介绍