HB_SMOTE:一种改进的非平衡数据SVM训练方法

PDF格式 | 393KB |

更新于2024-09-02

| 58 浏览量 | 举报

"基于混合重采样的非平衡数据SVM训练方法通过改进传统SVM算法,解决了非平衡数据集分类中的问题。HB_SMOTE方法结合分类超平面和SMOTE过采样,首先利用WSVM找到超平面,再剔除特定负类样本,提升正负类样本的分类准确率。实验表明,与RU_SMOTE等比较,HB_SMOTE有更高的分类性能。"

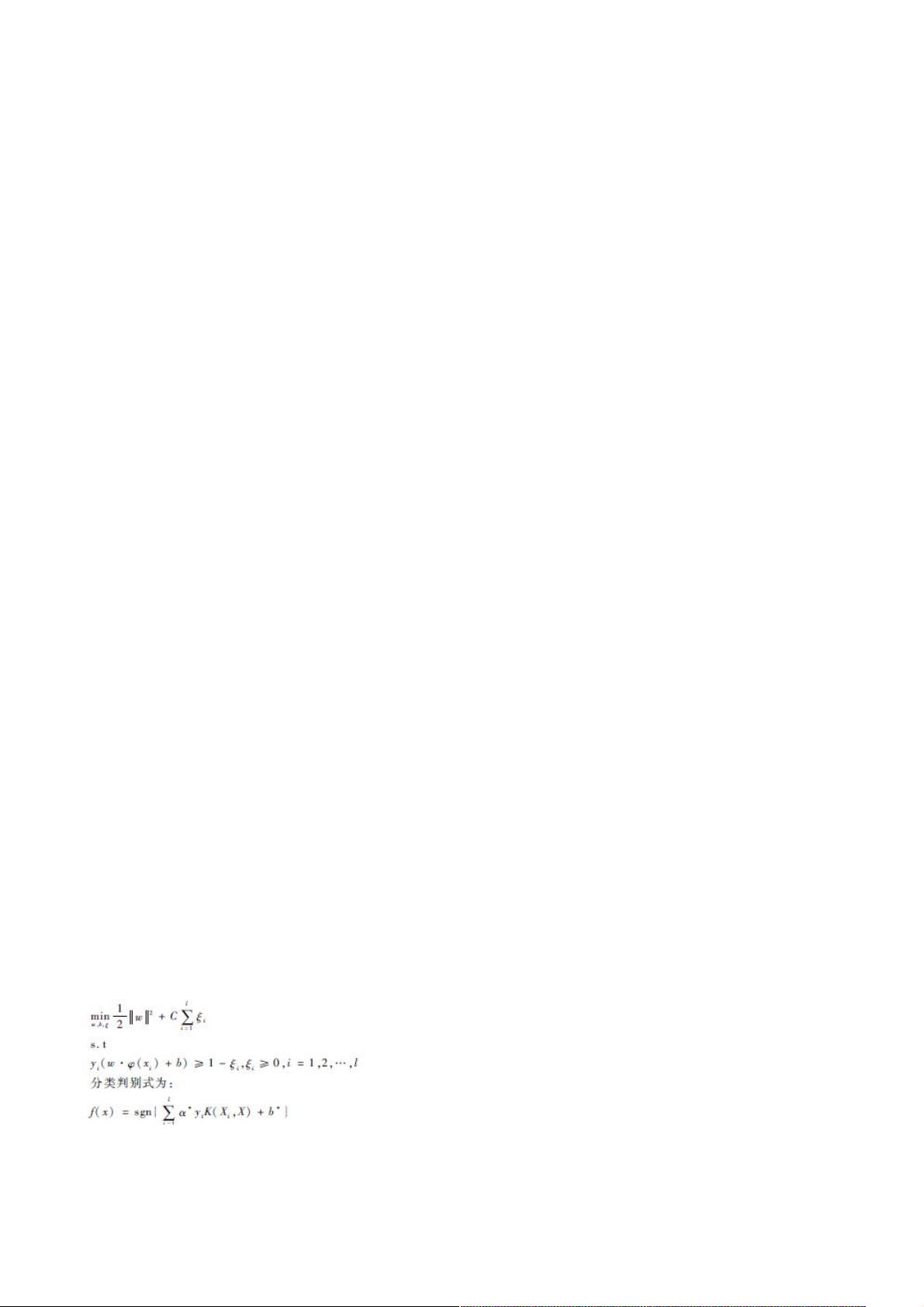

本文主要探讨了在非平衡数据集上支持向量机(SVM)分类效果不佳的挑战,并提出了一种名为HB_SMOTE的新型训练方法。支持向量机是一种广泛应用的机器学习算法,以其强大的泛化能力和理论基础受到青睐。然而,在现实世界的数据集中,正负样本比例不均等的情况非常普遍,这导致传统SVM在处理这些问题时,可能会偏向多数类,从而影响少数类的分类准确率。

为了解决这个问题,研究者们已经尝试了多种策略,包括代价敏感性方法和数据重采样技术。代价敏感性方法通过调整不同类别错误的成本来优化模型,但可能牺牲整体分类效果。而数据重采样,如过采样和欠采样,旨在平衡样本数量。过采样技术如SMOTE虽能保持原始信息,但可能导致过拟合和计算复杂度增加;欠采样则可能丢失重要信息,影响分类准确性。

HB_SMOTE方法则结合了过采样和分类超平面的概念,首先使用加权SVM(WSVM)确定分类边界,然后依据特定标准剔除负类中的一部分样本,如被错误分类的、靠近超平面的和远离超平面的样本。这种策略旨在保留更有区分力的样本,减少噪声和过拟合的风险。

实验结果显示,HB_SMOTE在UCI数据集上与RU_SMOTE等其他重采样方法对比,表现出对正类和负类样本更高的分类准确率。这表明混合重采样与分类超平面相结合的方法可能更为有效,尤其是在处理非平衡数据集时。

此外,文献指出,位于分类边界附近的样本对于分类至关重要,而远离边界的样本和噪声样本对分类信息的贡献较小。因此,HB_SMOTE通过精心设计的采样策略,专注于关键样本,提高了模型的泛化性能。

HB_SMOTE方法为非平衡数据集的SVM分类提供了一种新的思路,它通过智能的样本筛选和重采样,提升了模型的分类效果,有望在实际应用中解决非平衡数据集的挑战,特别是在入侵检测、文本分类、医疗诊断等领域。未来的研究可能进一步优化这一方法,以适应更多类型和规模的非平衡数据集。

相关推荐

weixin_38623919

- 粉丝: 6

最新资源

- ITween插件实用教程:路径运动与应用案例

- React三纤维动态渐变背景应用程序开发指南

- 使用Office组件实现WinForm下Word文档合并功能

- RS232串口驱动:Z-TEK转接头兼容性验证

- 昆仑通态MCGS西门子CP443-1以太网驱动详解

- 同步流密码实验研究报告与实现分析

- Android高级应用开发教程与实践案例解析

- 深入解读ISO-26262汽车电子功能安全国标版

- Udemy Rails课程实践:开发财务跟踪器应用

- BIG-IP LTM配置详解及虚拟服务器管理手册

- BB FlashBack Pro 2.7.6软件深度体验分享

- Java版Google Map Api调用样例程序演示

- 探索设计工具与材料弹性特性:模量与泊松比

- JAGS-PHP:一款PHP实现的Gemini协议服务器

- 自定义线性布局WidgetDemo简易教程

- 奥迪A5双门轿跑SolidWorks模型下载