使用黏菌算法优化的SMA-CNN-LSTM多头注意力模型进行时间序列预测

下载需积分: 0 | PDF格式 | 2.34MB |

更新于2024-08-03

| 80 浏览量 | 举报

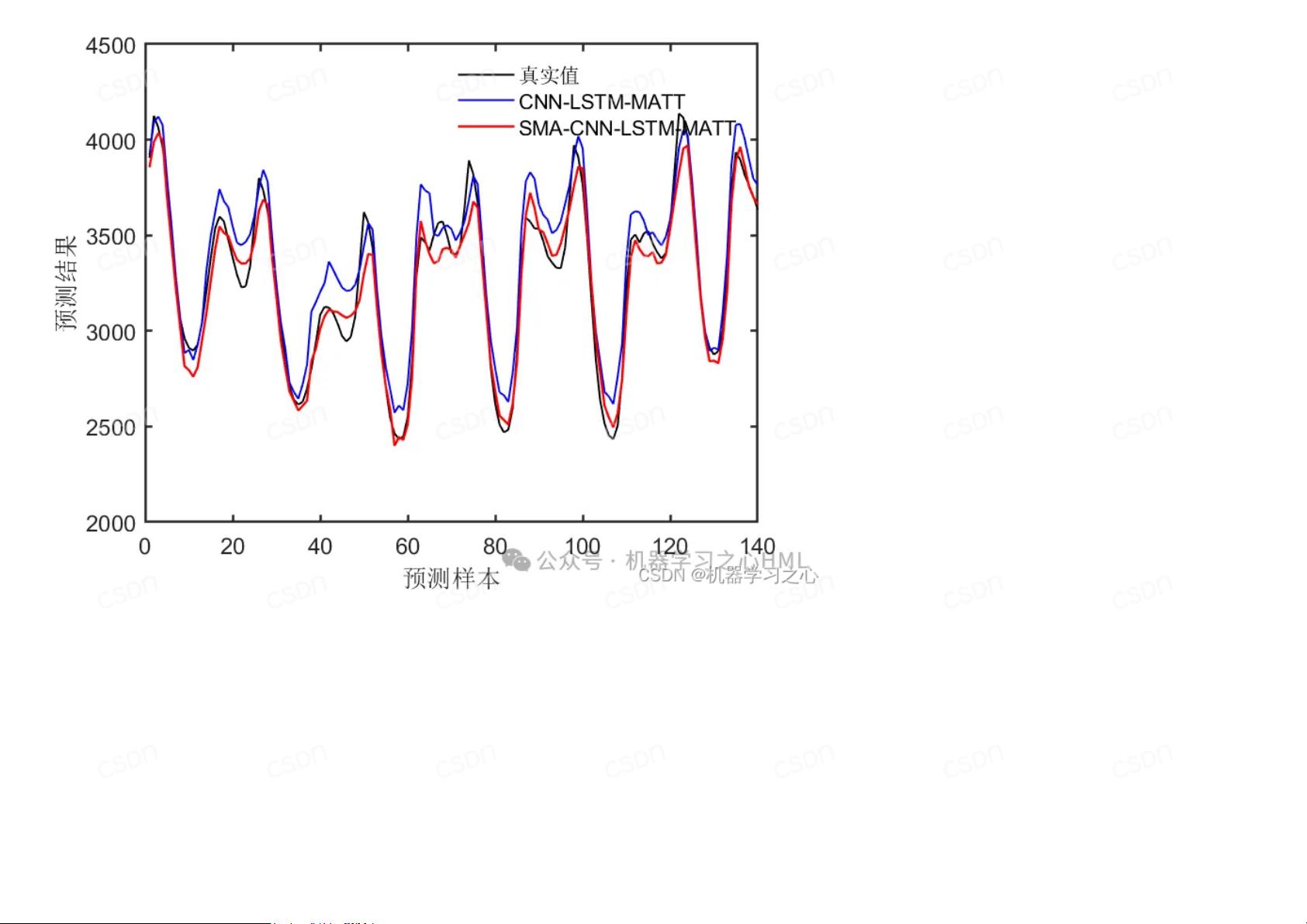

"这篇文章主要介绍了如何使用Matlab实现一种基于SMA-CNN-LSTM-Mutilhead-Attention模型的黏菌算法优化的卷积长短期记忆神经网络,用于多变量时间序列预测。该模型结合了黏菌算法、卷积神经网络(CNN)、长短期记忆网络(LSTM)以及多头注意力机制,旨在提升时间序列预测的准确性和效率。"

在机器学习和深度学习领域,时间序列预测是一个重要的任务,尤其在金融、天气预报、电力需求预测等多个行业中具有广泛的应用。本文提到的SMA-CNN-LSTM-Mutilhead-Attention模型是一种高级的预测方法,它融合了多种技术来处理复杂的序列数据。

首先,卷积神经网络(CNN)在图像处理和文本分析等领域表现出色,其在时间序列预测中可以捕获局部特征,通过滤波器学习到输入序列中的模式和结构。CNN的卷积层和池化层有助于提取有效特征,减少数据的维度,从而降低计算复杂性。

其次,长短期记忆网络(LSTM)是循环神经网络(RNN)的一种变体,特别适合处理具有长期依赖性的序列数据。LSTM通过门控机制来解决梯度消失问题,能够在长时间跨度内记住重要信息,忽略不相关的细节。

接着,多头注意力机制(Multi-head Attention)是Transformer架构的核心组件,它可以同时关注输入序列的不同部分,提供更全面的上下文理解。多头注意力允许模型并行处理多个信息子空间,提高了模型的表达能力和泛化能力。

最后,黏菌算法是一种生物启发的优化算法,源自黏菌寻找食物的过程。在模型优化中,黏菌算法可以帮助找到CNN和LSTM参数的最佳组合,以提升整体预测性能。

文章中提到的Matlab实现提供了具体代码示例,这为研究人员和实践者提供了方便,使他们能够快速理解和复现这一先进的预测模型。通过黏菌算法的优化,模型可以更好地适应不同的时间序列数据,提高预测的准确性和稳定性。

SMA-CNN-LSTM-Mutilhead-Attention模型结合了多种强大的工具,为时间序列预测提供了一种综合解决方案。这种模型在处理多变量、非线性、复杂的时间序列数据时,有望取得优于传统方法的预测效果。通过Matlab的实现,研究者和工程师可以更便捷地进行实验和应用,推动相关领域的研究进步。

相关推荐

机器学习之心

- 粉丝: 2w+

- 资源: 1079

最新资源

- Contents-Codes

- 作品答辩多彩扁平化毕业答辩.rar

- notify_tv_shows

- 易语言MakePL源码,易语言Play源码,易语言AVI播放器

- MovingPandas - 基于GeoPandas的移动轨迹绘制-python

- evolutility-ui-react:使用REST或GraphQL的CRUD的模型驱动的Web UI

- spectral clustering谱聚类_spectralclustering_聚类_谱聚类_

- Gogo Ghost-crx插件

- word2word:3,564种语言对的易于使用的词对词翻译

- zicer-demonstration

- ASP+ACCESS学生管理系统通过答辩的毕业设计(源代码+LW).zip

- Trader---Desktop

- nostalgy-xpi:怀旧附加组件已针对Thunderbird 68(现在为Thunderbird 78-86)进行了更新。Alain Frisch的原始代码

- testTravis

- 易语言bass内存音效

- 作品答辩海天一色学术蓝稳重模板.rar