XGBoost可扩展性解析:树学习优化与系统设计

需积分: 0 6 浏览量

更新于2024-06-30

收藏 1.57MB PDF 举报

"这篇内容是关于XGBoost论文的阅读总结,主要关注其可扩展性、系统优化和算法优化。文章提到了XGBoost在处理大规模数据时的高效性,包括并行化、分布式计算和核外计算能力。此外,还介绍了几个关键的创新点,如新的树学习算法、加权分位数略图过程、稀疏感知算法以及内存感知块结构。"

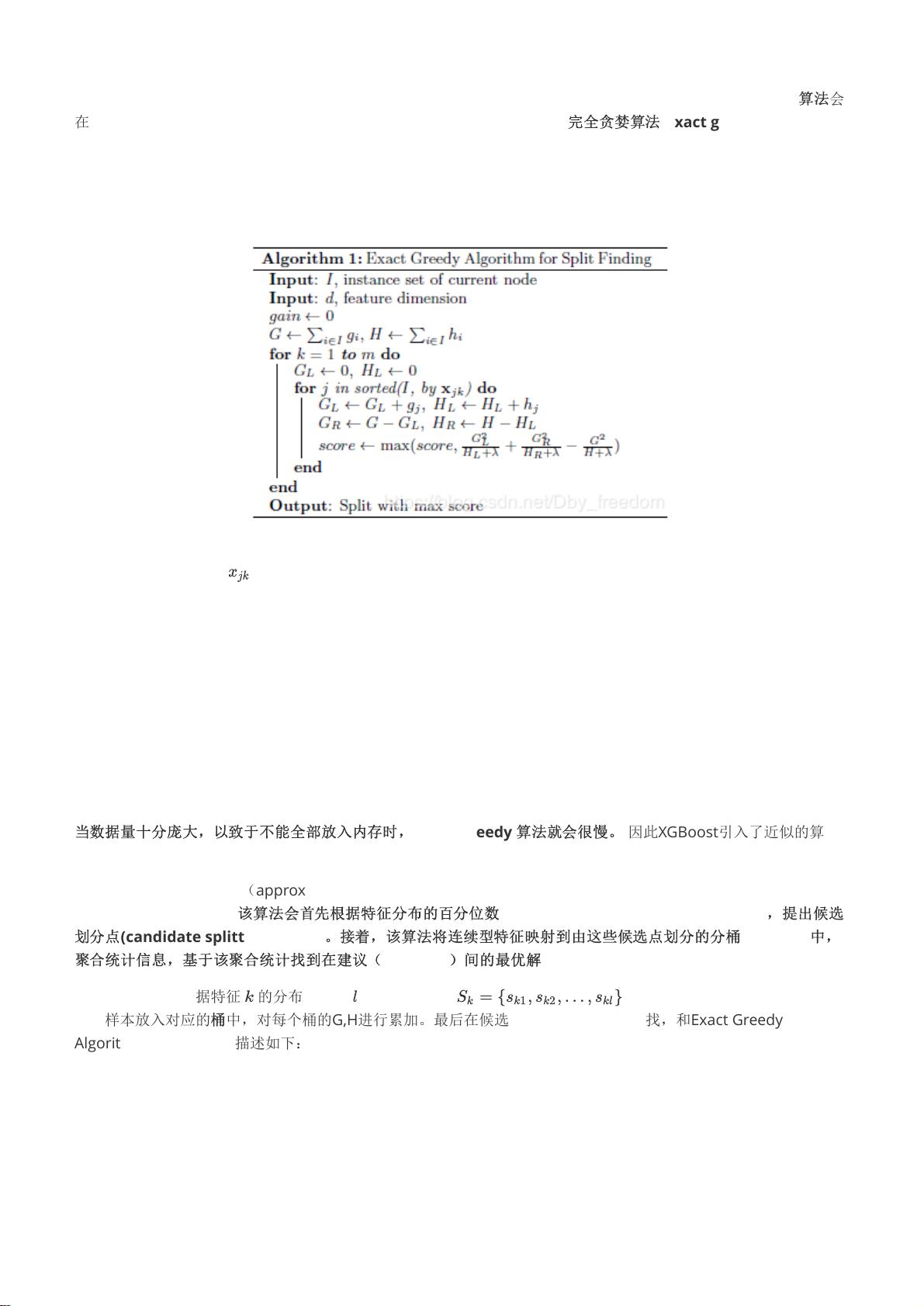

XGBoost是一种广泛使用的梯度提升框架,尤其因其在大数据集上的优秀性能而备受推崇。在论文中,作者讨论了XGBoost如何通过一系列的系统和算法优化实现其强大的可扩展性。首先,他们提出了一种新的树学习算法,该算法特别针对稀疏数据进行了优化,这对于处理现代机器学习问题中常见的大量缺失值非常有用。这一优化使得XGBoost能够在处理稀疏特征时保持高效。

其次,论文引入了一个理论正确的加权分位数略图过程,这个过程在预计算阶段提高了效率,特别是在近似的树学习中处理实例权重。这允许XGBoost快速有效地构建决策树,而不牺牲准确性。

另外,XGBoost实现了一种稀疏感知算法,这使得树学习可以并行进行,大大加快了训练速度。这种算法能够智能地处理那些包含大量零值或缺失值的特征,从而减少计算开销。

再者,为了应对大内存需求,XGBoost采用了内存感知块结构来支持核外计算。这种方法使得在有限的内存资源下处理超出内存大小的数据集成为可能,极大地拓展了XGBoost的应用场景。

在算法层面,XGBoost的核心是其正则化的目标函数。它基于Friedman的二阶泰勒展开,通过对每个树结构添加正则项来防止过拟合。每个决策树的输出是通过叶子节点的分值来确定的,这些分值会在每次迭代中更新,以最小化目标函数。

XGBoost的高效性和可扩展性使其成为数据科学竞赛和实际项目中的首选工具。通过这些创新技术,XGBoost不仅能在单机上处理大规模数据,还能扩展到集群,为解决复杂的机器学习问题提供了强大的支持。对于进行毕业设计的学生来说,理解并掌握XGBoost的这些核心特性对于提高项目质量和效率至关重要。

2022-08-03 上传

265 浏览量

319 浏览量

265 浏览量

265 浏览量

508 浏览量

455 浏览量

114 浏览量

华亿

- 粉丝: 51

最新资源

- 全面详实的大学生电工实习报告汇总

- 利用极光推送实现App间的消息传递

- 基于JavaScript的节点天气网站开发教程

- 三星贴片机1+1SMT制程方案详细介绍

- PCA与SVM结合的机器学习分类方法

- 钱能版C++课后习题完整答案解析

- 拼音检索ListView:实现快速拼音排序功能

- 手机mp3音量提升神器:mp3Trim使用指南

- 《自动控制原理第二版》习题答案解析

- 广西移动数据库脚本文件详解

- 谭浩强C语言与C++教材PDF版下载

- 汽车电器及电子技术实验操作手册下载

- 2008通信定额概预算教程:快速入门指南

- 流行的表情打分评论特效:实现QQ风格互动

- 使用Winform实现GDI+图像处理与鼠标交互

- Python环境配置教程:安装Tkinter和TTk