MySQL线上常见故障剖析深入探讨了MySQL数据库在生产环境中可能遇到的各种问题及其解决策略。本文档涵盖了多个关键领域,包括但不限于:

1. 应用层面的故障:例如,应用无法获取连接池的问题。这可能是由于连接池大小设置不合理,或者并发访问过高导致资源耗尽。解决这类问题时,需要检查MySQL的配置(如max_connections),同时监控活动进程列表(processlist)以确认是否有长时间占用连接的查询。

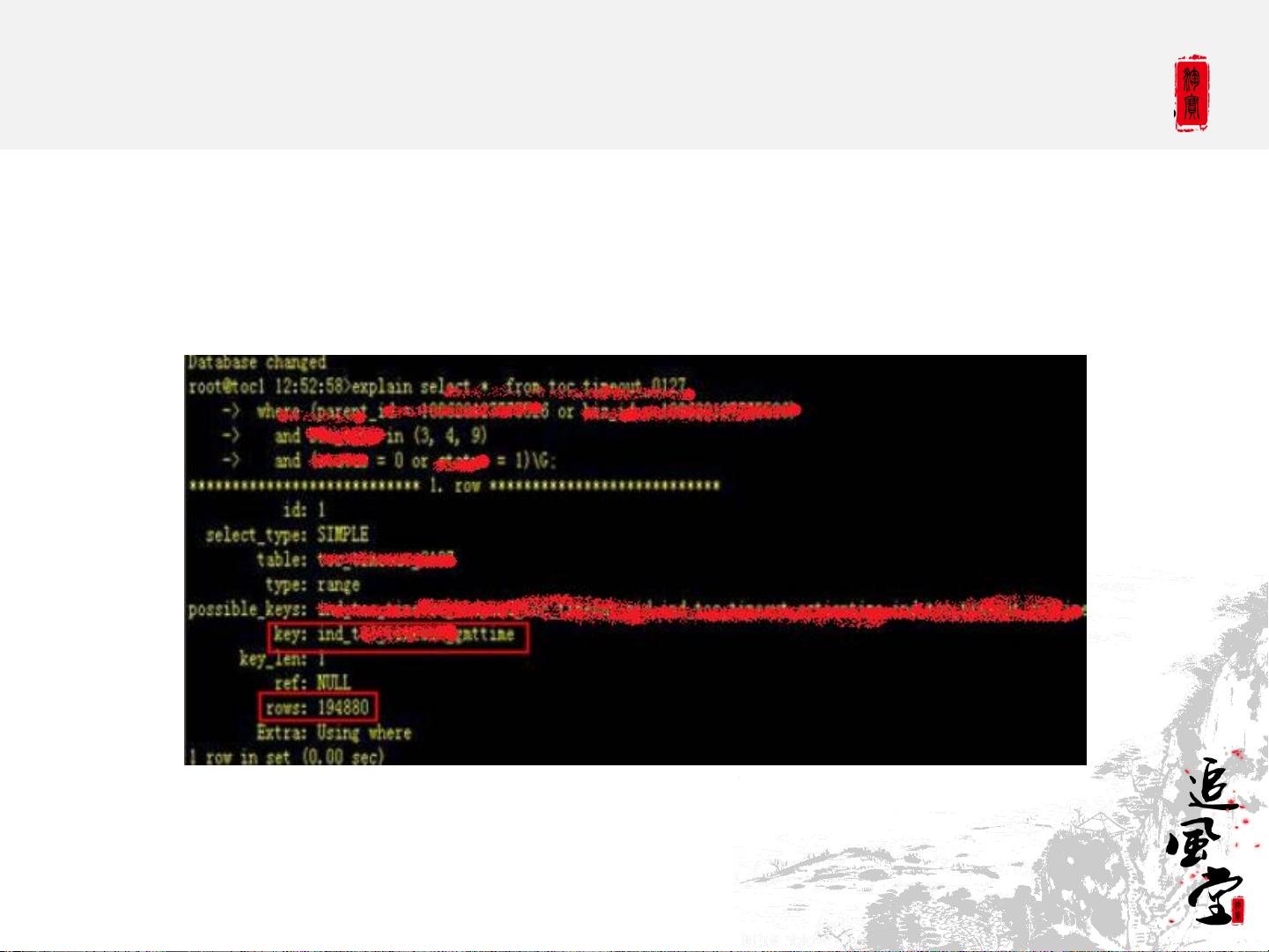

2. 性能瓶颈:数据库响应慢或SQL执行缓慢,通常涉及SQL查询优化。通过分析explain计划可以发现是否选择了不合适的索引,或者存在复杂的子查询导致性能下降。同时,启用全局slow_query_log记录长时间运行的查询,以便进行后续分析。

3. 系统负载与资源管理:高负载(load)和交换空间(SWAP)使用可能预示着内存不足。通过查看内存状态(meminfo)和磁盘I/O统计(iostat),可以了解资源分配和I/O瓶颈。另外,定期监控CPU使用率(ps)也是必要的。

4. 数据库内部状态:InnoDB引擎的物理读和逻辑读可以帮助识别数据操作的性能瓶颈。同时,查看innodb_status提供了深入的引擎内部信息。

5. 参数配置优化:对MySQL的参数进行调整,比如innodb_buffer_pool_size、query_cache_size等,以适应业务需求并避免过度消耗系统资源。

6. 错误排查工具:堆栈跟踪(stacktrace)和源代码可以帮助定位代码层面的问题,而Profiler工具(如oprofile、gprof)则用于程序性能分析。

7. 事件案例分析:

- Case1: 连接池满的情况,可以通过iostat监控磁盘I/O,slowlog查看慢查询,以及Mk-query-digest工具分析查询语句,同时执行explain查看执行计划,找出造成阻塞的原因。

- Case2: 线程卡住,主要通过processlist检查每个线程的状态和执行的SQL,找出可能无限循环或阻塞的操作。

8. 其他辅助工具:除了上述方法,还可以利用通用日志(generallog)、二进制日志(binlog)追踪更改和异常,以及网络诊断工具tcpdump配合Mk-query-digest进行更深入的网络通信分析。

MySQL线上常见故障的剖析涉及多方面因素,包括数据库性能监控、配置管理、日志分析、错误定位和性能优化。通过综合运用这些工具和技术,可以有效地定位和解决线上MySQL系统的各种问题。