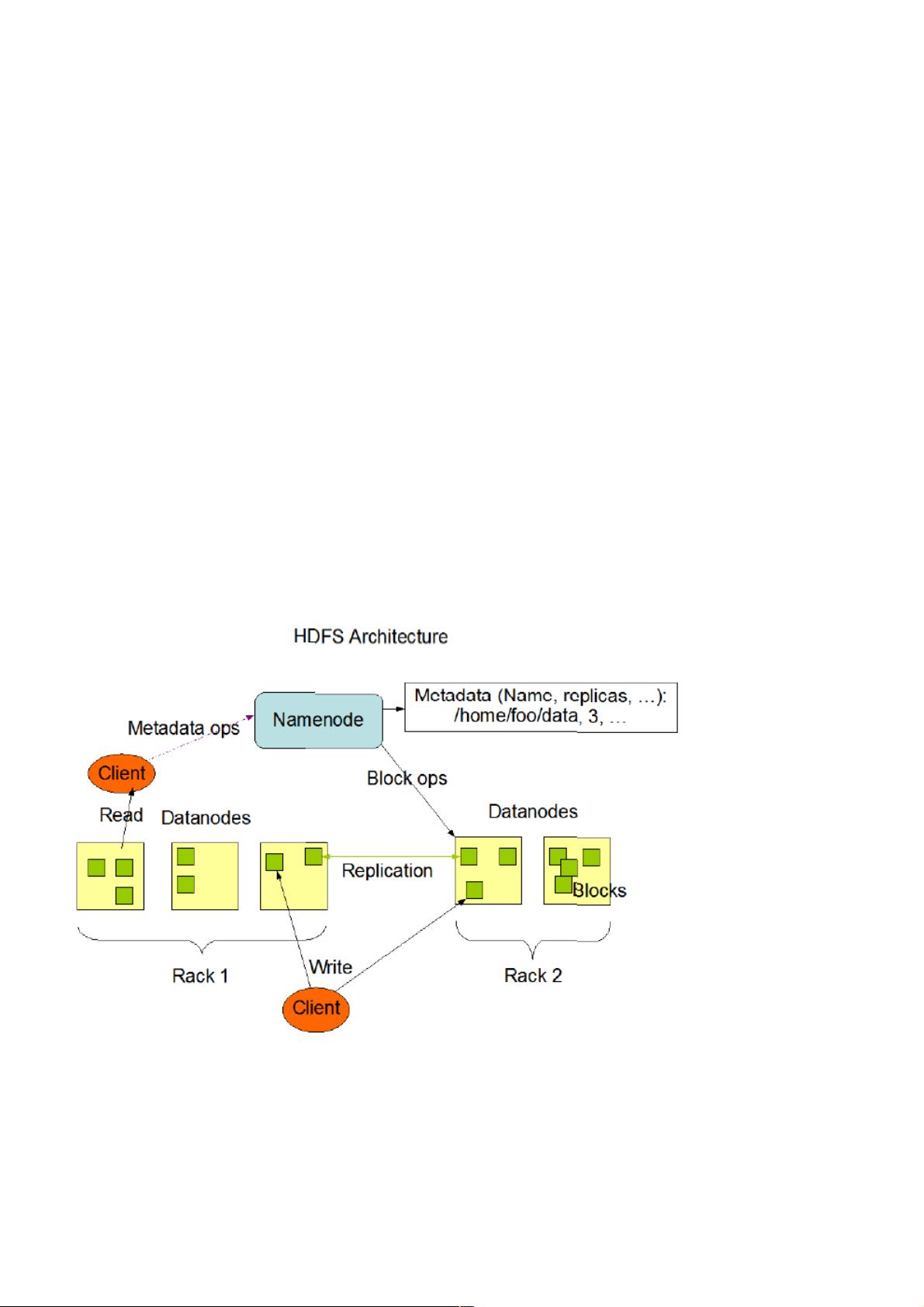

"Hadoop分布式文件系统:架构和设计要点" Hadoop分布式文件系统(HDFS)是Apache Hadoop项目的核心组件之一,旨在处理和存储大量数据。它的设计目标和架构特性使其特别适合大规模数据处理应用。 一、设计目标 1. 高容错性:HDFS假设硬件故障频繁,因此其设计重点在于错误检测和快速自我恢复。通过冗余存储,当某个节点故障时,数据仍能被访问。 2. 高吞吐量:HDFS优化了批量数据处理,而不是追求低延迟访问。这使得它适合于大数据分析任务,如MapReduce。 3. 支持大数据:HDFS旨在存储GB至TB级别的大文件,并能容纳数千万个文件在一个实例中。 4. write-once-read-many模型:文件一旦写入并关闭,就不再修改,简化了数据一致性管理,保证了高效率的读取操作。 5. 计算向数据靠拢:HDFS允许计算靠近数据,减少大规模数据传输的开销,提高性能。 6. 跨平台兼容性:HDFS的设计考虑了在不同软硬件环境下的可移植性。 二、HDFS架构 HDFS采用了主从结构(master/slave),由Namenode和Datanode组成。 - Namenode:作为中心服务器,它维护文件系统的命名空间(namespace)和文件块的映射信息。Namenode负责文件的创建、删除、重命名等操作,以及决定文件块如何分配到各个Datanode。 - Datanode:在每个节点上运行,管理本地存储的文件块。它们响应Namenode的指令,执行文件块的创建、删除和复制。Datanode还会定期向Namenode发送心跳信息,报告其状态和存储信息。 HDFS是用Java编写,因此可以在各种操作系统上运行。通常,Namenode部署在单独的机器上,而Datanode则在集群中的所有其他机器上运行,每个机器运行一个Datanode实例。虽然理论上一台机器可以运行多个Datanode,但实际部署中这种情况并不多见。 在HDFS中,文件被分割成多个固定大小的块(默认128MB或256MB),这些块会被复制到多个Datanode上以确保容错性。通常,默认的复制因子是3,这意味着每个文件块都会在集群中的三个不同的Datanode上存在副本。 总结来说,Hadoop分布式文件系统通过其独特的架构设计,实现了大规模数据存储、高容错性和高效的批处理能力,为大数据处理提供了坚实的基础。

下载后可阅读完整内容,剩余3页未读,立即下载

- 粉丝: 6

- 资源: 888

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- 达梦数据库DM8手册大全:安装、管理与优化指南

- Python Matplotlib库文件发布:适用于macOS的最新版本

- QPixmap小demo教程:图片处理功能实现

- YOLOv8与深度学习在玉米叶病识别中的应用笔记

- 扫码购物商城小程序源码设计与应用

- 划词小窗搜索插件:个性化搜索引擎与快速启动

- C#语言结合OpenVINO实现YOLO模型部署及同步推理

- AutoTorch最新包文件下载指南

- 小程序源码‘有调’功能实现与设计课程作品解析

- Redis 7.2.3离线安装包快速指南

- AutoTorch-0.0.2b版本安装教程与文件概述

- 蚁群算法在MATLAB上的实现与应用

- Quicker Connector: 浏览器自动化插件升级指南

- 京东白条小程序源码解析与实践

- JAVA公交搜索系统:前端到后端的完整解决方案

- C语言实现50行代码爱心电子相册教程

信息提交成功

信息提交成功