深度学习序列模型:RNN, LSTM, GRU

需积分: 0 23 浏览量

更新于2024-06-30

收藏 5.47MB PDF 举报

"14-第五课 序列模型1"

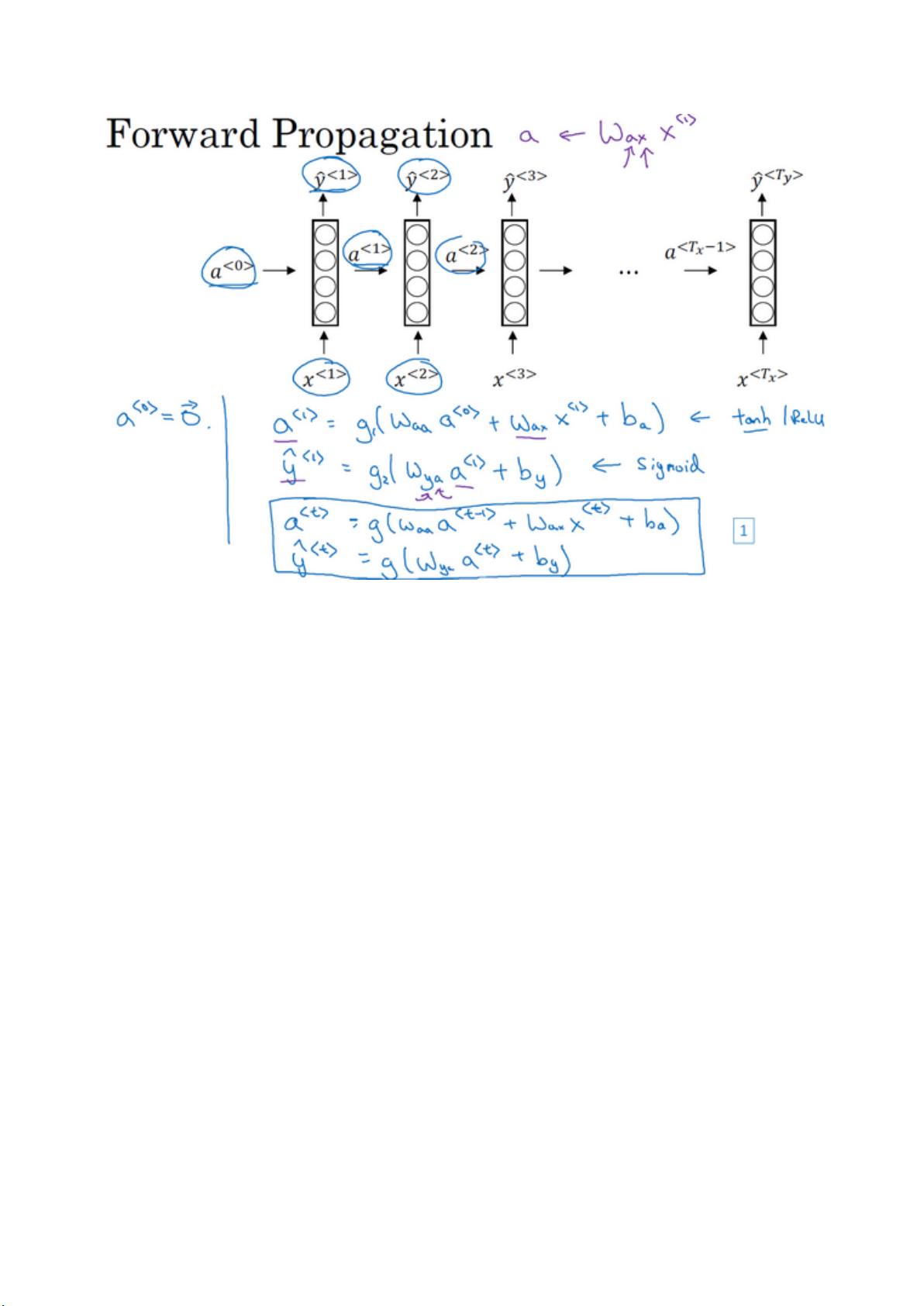

序列模型是深度学习中的一个重要概念,尤其在处理时间序列数据和自然语言处理任务时发挥着关键作用。本课程主要关注循环神经网络(Recurrent Neural Networks, RNN),包括其不同变体和应用。RNN是一种能够处理序列数据的神经网络,其内部结构允许信息在时间上流动,从而能够捕捉序列中的长期依赖关系。

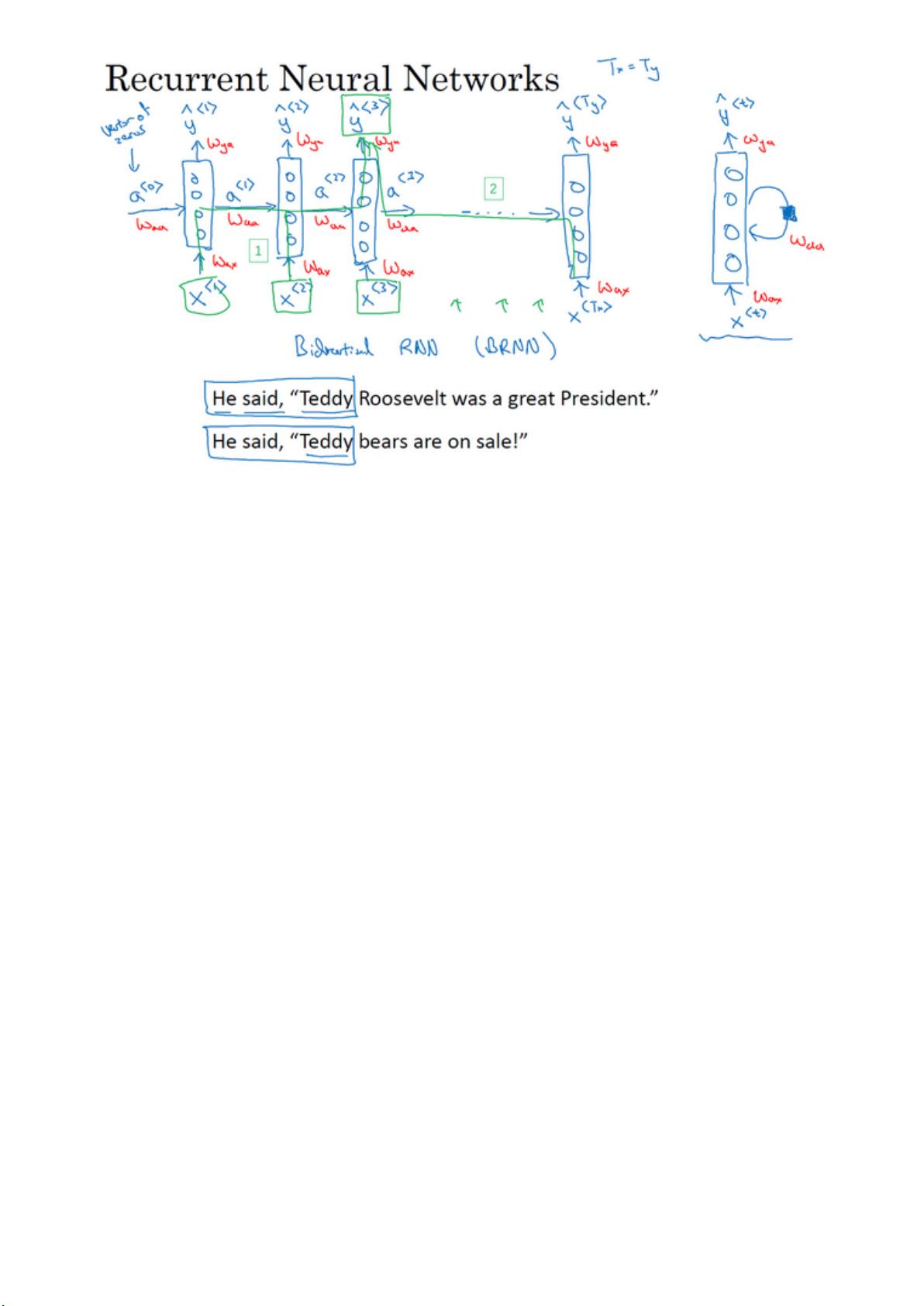

1.5 不同类型的循环神经网络(Different types of RNNs):

RNN有多种不同的结构,例如基本的RNN、长短时记忆网络(LSTM)和门控循环单元(GRU)。这些变体旨在解决传统RNN中的梯度消失问题,使得网络能够更好地学习和存储长期依赖。

1.8 循环神经网络的梯度消失(Vanishing gradients with RNNs):

在标准RNN中,由于反向传播过程中信息的衰减,网络往往难以捕捉远距离的依赖关系,导致梯度消失问题。这限制了RNN在处理长序列数据时的效果。

1.9 门控循环单元(Gated Recurrent Unit, GRU):

GRU是为了解决RNN的梯度消失问题而提出的一种结构。它通过引入“重置门”和“更新门”来控制信息的流动,使得网络在保持历史信息的同时,能够有效地学习新的输入。

1.10 长短时记忆网络(LSTM, long short-term memory unit):

LSTM是另一种解决梯度消失问题的方法,它通过“输入门”、“遗忘门”和“输出门”来控制单元状态的更新,更有效地保留和遗忘信息,适合处理复杂的长期依赖。

1.11 双向循环神经网络(Bidirectional RNN):

双向RNN同时考虑了序列的前向和后向信息流,提高了模型对序列上下文的理解,特别适用于自然语言处理任务。

1.12 深层循环神经网络(Deep RNNs):

通过堆叠多层RNN,可以构建深层RNN,以捕获不同层次的序列模式,增强了模型的表达能力。

1.13 为什么使用序列模型?(Why Sequence Models?)

序列模型在语音识别、自然语言处理、音乐生成、情感分析、DNA序列分析和机器翻译等众多领域有着广泛的应用。它们能够处理具有时间顺序的数据,无论是输入还是输出,甚至两者都是序列形式。

例如,在语音识别中,输入是连续的音频信号,输出是对应的文本转录。音乐生成则相反,输入可能是一个简单的数字(代表音符或节拍),而输出是连续的音符序列。情感分析任务中,输入是文本,模型需要预测文本的情感极性。在DNA序列分析中,通过RNN可以预测特定序列可能编码的蛋白质。而在机器翻译任务中,模型需要将一种语言的句子转换成另一种语言的对应句子。

序列模型通过捕捉和利用时间序列数据中的模式,极大地扩展了深度学习在处理动态和时间相关问题的能力。通过学习和理解RNN的各种变体,开发者可以构建更强大的模型来解决现实世界中的复杂问题。

326 浏览量

165 浏览量

106 浏览量

2022-08-04 上传

2022-08-04 上传

106 浏览量

103 浏览量

坑货两只

- 粉丝: 1023

最新资源

- 昆仑通态MCGS嵌入版_XMTJ温度巡检仪软件包解压教程

- MultiBaC:掌握单次与多次组批处理校正技术

- 俄罗斯方块C/C++源代码及开发环境文件分享

- 打造Android跳动频谱显示应用

- VC++实现图片处理的小波变换方法

- 商城产品图片放大镜效果的实现与用户体验提升

- 全新发布:jQuery EasyUI 1.5.5中文API及开发工具包

- MATLAB卡尔曼滤波运动目标检测源代码及数据集

- DoxiePHP:一个PHP开发者的辅助工具

- 200mW 6MHz小功率调幅发射机设计与仿真

- SSD7课程练习10答案解析

- 机器人原理的MATLAB仿真实现

- Chromium 80.0.3958.0版本发布,Chrome工程版新功能体验

- Python实现的贵金属追踪工具Goldbug介绍

- Silverlight开源文件上传工具应用与介绍

- 简化瀑布流组件实现与应用示例