Java/Web调用Hadoop MapReduce实践与示例代码解析

118 浏览量

更新于2024-09-02

收藏 483KB PDF 举报

"Java/Web调用Hadoop进行MapReduce的示例代码,通过Spring、SpringMVC、MyBatis框架实现文件上传,并在Hadoop上执行MapReduce任务。"

在现代大数据处理中,Hadoop MapReduce是一种分布式计算框架,常用于处理海量数据。通过Java编程接口,我们可以编写MapReduce作业并在Hadoop集群上执行。本文主要讨论的是如何将这种功能集成到Java或Web应用程序中,让用户可以方便地上传文件,触发MapReduce作业,然后获取处理结果。

首先,确保你已经正确搭建了Hadoop环境。这通常包括安装Hadoop软件,配置集群,并确保NameNode和DataNode正常运行。你可以参考链接中的文章来完成这个步骤。

为了使Java或Web应用能调用Hadoop MapReduce,你需要创建一个可执行的JAR文件,其中包含你的MapReduce作业类。这个类应该包含main方法,接收输入参数,例如输入文件路径和输出文件路径。当用户上传文件后,这些参数会被传递给MapReduce作业。

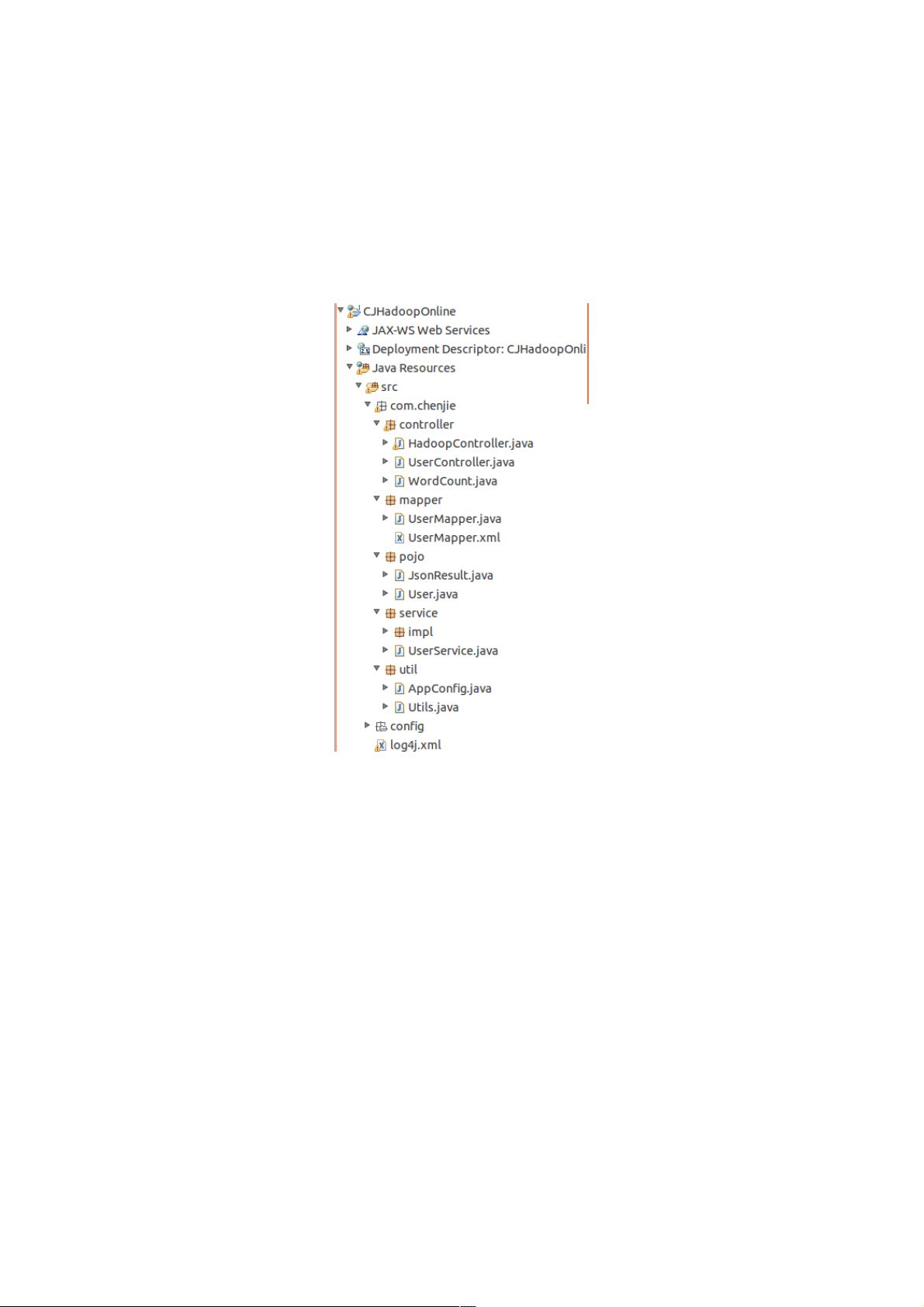

接着,构建一个JavaWeb工程,这里使用了Spring、SpringMVC和MyBatis作为基础框架。这些框架可以帮助你管理依赖、处理HTTP请求以及与数据库交互。尽管框架的选择不是必需的,但它们可以简化开发过程。

在Spring配置文件中,你需要配置一个MultipartResolver,以支持文件上传。`CommonsMultipartResolver`是Spring用来处理多部分HTTP请求(如文件上传)的组件。设置默认编码为UTF-8,最大上传文件大小,以及内存中存储的最大文件大小。

创建一个登录页面(login.jsp),用户登录后会进入console.jsp。在登录成功后,程序会在Hadoop文件系统中为该用户创建一个文件夹。这是一个安全措施,确保每个用户的文件分开存储。在`com.chenjie.controller`包下的控制器类中,处理登录逻辑,并执行创建用户文件夹的操作。

用户文件上传后,文件会被使用Hadoop的Java API(如`FileSystem`类)put到Hadoop文件系统中。然后,调用Hadoop的`Job`类提交MapReduce作业,指定输入和输出路径。MapReduce作业会读取输入文件,执行map和reduce操作,并将结果写入到指定的输出路径。

在MapReduce作业完成后,可以使用Hadoop的Java API再次从文件系统中获取结果文件。最后,这些结果可以通过Web界面展示给用户,或者以其他适当方式提供给用户下载。

总结来说,这个示例展示了如何结合Java/Web应用和Hadoop MapReduce,实现用户友好的文件处理服务。通过封装Hadoop调用,用户可以直接在Web界面上上传文件,启动MapReduce作业,然后查看处理结果。这种方法极大地提升了用户体验,并简化了大数据处理流程。

2013-05-12 上传

2015-12-01 上传

2016-12-27 上传

771 浏览量

2020-04-23 上传

2011-10-25 上传

2018-04-27 上传

2016-12-05 上传

点击了解资源详情